魏红斌

已加入开发者社区1592天

勋章

专家博主

专家博主

星级博主

星级博主

乘风问答官

乘风问答官

技术博主

技术博主

学习博主

学习博主

开发者认证勋章

开发者认证勋章

门派掌门

门派掌门

我关注的人

粉丝

游客25n7ic26wbhls

游客25n7ic26wbhls

xiaowuyun

xiaowuyun

konel518

konel518

banjin1010

banjin1010

游客ji5jiuiemmmse

游客ji5jiuiemmmse

aliyun0641063962-48771

aliyun0641063962-48771

nick5084733268

nick5084733268

游客adweoqnn45a7

游客adweoqnn45a7

游客5fdji2pvmf8888

游客5fdji2pvmf8888

1814523600948320

1814523600948320

柚子归来

柚子归来

技术能力

兴趣领域

- API

- Linux

- 容器

- 关系型数据库

- 数据库管理

- 运维

- 负载均衡

- 云栖大会

- 达摩院

- 开发者

擅长领域

-

容器

高级

能力说明:

熟练掌握Docker各类高级特性,包括容器数据卷、DockerFile构建等;熟练使用Docker封装MySQL、Redis、Tomcat、Apache等镜像,并可在公有云或私有云部署并保持稳定运行。

-

Linux

高级

能力说明:

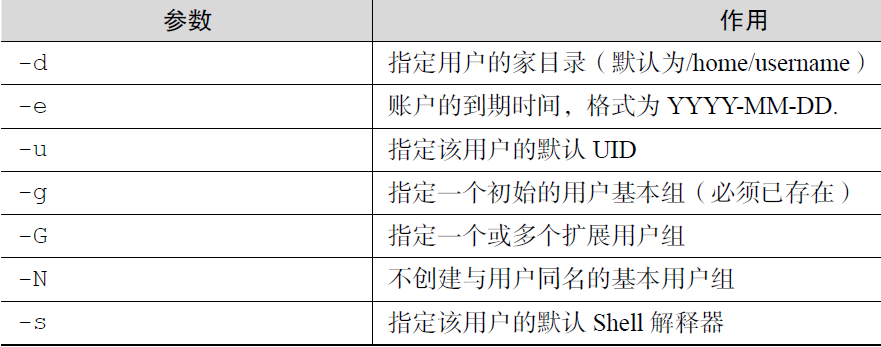

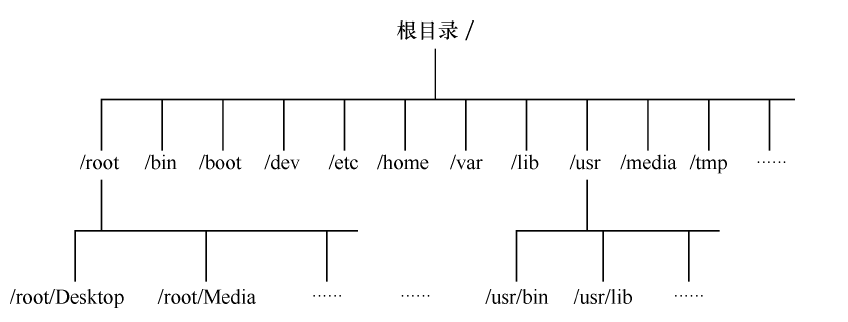

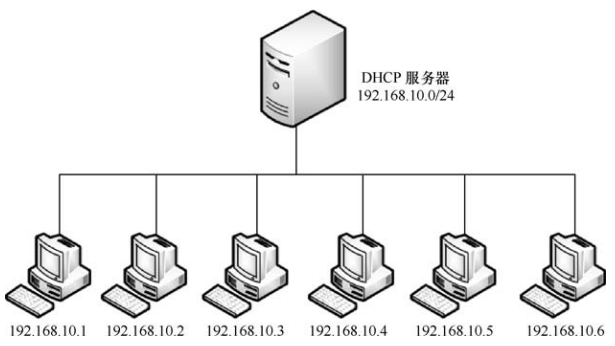

熟练掌握Linux常用命令、文件及用户管理、文本处理、Vim工具使用等,熟练掌握企业IP规划、子网划分、Linux的路由、网卡、以及其他企业级网络配置技术,可进行Web服务器(Nginx),以及数据库(My SQL)的搭建、配置、应用,可根据需求编写Shell脚本,通过常用工具进行linux服务器自动化运维。

-

数据库

高级

能力说明:

掌握Java开发环境下所需的MySQL高级技巧,包括索引策略、innodb和myisam存储引擎,熟悉MySQL锁机制,能熟练配置MySQL主从复制,熟练掌握日常SQL诊断和性能分析工具和策略。可对云数据库进行备份恢复与监控、安全策略的设置,并可对云数据库进行性能优化。掌握主要NOSQL数据库的应用技术。

技术认证

-

-

弹性计算Clouder认证:使用OpenAPI管理云上资源

获得于2023-11-20 18:07:41

弹性计算Clouder认证:使用OpenAPI管理云上资源

获得于2023-11-20 18:07:41 -

云原生Clouder认证:SAE的功能与使用入门

获得于2023-11-09 14:56:42

云原生Clouder认证:SAE的功能与使用入门

获得于2023-11-09 14:56:42 -

云原生Clouder认证:Serverless应用快速体验

获得于2023-11-09 14:07:57

云原生Clouder认证:Serverless应用快速体验

获得于2023-11-09 14:07:57 -

弹性计算Clouder认证:服务器迁移上云

获得于2023-11-01 10:12:49

弹性计算Clouder认证:服务器迁移上云

获得于2023-11-01 10:12:49 -

弹性计算Clouder认证:企业级ECS集群构建

获得于2023-10-27 23:01:05

弹性计算Clouder认证:企业级ECS集群构建

获得于2023-10-27 23:01:05

-

天下风云出我辈,一入江湖岁月催,皇图霸业谈笑中,不胜人生一场醉。

暂无更多

暂无更多信息

2025年10月

-

10.31 13:36:38

发表了文章

2025-10-31 13:36:38

发表了文章

2025-10-31 13:36:38

14章收尾过程组

题 -

10.30 17:50:22

发表了文章

2025-10-30 17:50:22

发表了文章

2025-10-30 17:50:22

13章监控

题 -

10.29 14:02:15

发表了文章

2025-10-29 14:02:15

发表了文章

2025-10-29 14:02:15

12章刷题

题 -

10.27 15:46:04

发表了文章

2025-10-27 15:46:04

发表了文章

2025-10-27 15:46:04

集成综合速记第二章

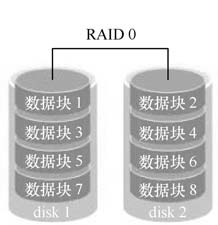

本章系统介绍信息技术核心内容,涵盖计算机软硬件、通信与网络基础、OSI/TCP/IP模型、SDN、5G、存储技术、数据库与数据仓库、信息安全、加密技术、网络安全防护、大数据、云计算、物联网、区块链及人工智能等关键技术原理与发展应用。 -

10.27 15:45:25

发表了文章

2025-10-27 15:45:25

发表了文章

2025-10-27 15:45:25

错题本11章

本内容涵盖项目管理核心知识,包括需求管理、WBS分解、进度与成本基准制定、质量管理、风险识别与应对、沟通及资源规划等关键过程,强调需求可跟踪性、变更控制、干系人参与及多维度风险分析,助力项目全过程科学管控。

2025年09月

-

09.29 17:36:41

发表了文章

2025-09-29 17:36:41

发表了文章

2025-09-29 17:36:41

集成综合速记第一章

本章系统阐述信息化知识,涵盖信息定义、质量属性、传输模型及生命周期;解析国家信息化体系、新型基建、工业互联网、智慧城市与数字中国建设内涵,助力数字化转型。

2025年05月

-

05.22 21:57:57

发表了文章

2025-05-22 21:57:57

发表了文章

2025-05-22 21:57:57

-

05.22 20:35:20

发表了文章

2025-05-22 20:35:20

发表了文章

2025-05-22 20:35:20

2023年5月监理

fd -

05.19 22:49:39

发表了文章

2025-05-19 22:49:39

发表了文章

2025-05-19 22:49:39

2022年下半年解析

记忆 -

05.19 00:05:32

发表了文章

2025-05-19 00:05:32

发表了文章

2025-05-19 00:05:32

22年上半年信监真题

坚持就是胜利 -

05.18 16:29:31

发表了文章

2025-05-18 16:29:31

发表了文章

2025-05-18 16:29:31

21年下半年监理真题解析

42 -

05.17 16:25:18

发表了文章

2025-05-17 16:25:18

发表了文章

2025-05-17 16:25:18

在云端 阿里云谷歌首页插件下载地址

简要记录 -

05.17 16:09:53

发表了文章

2025-05-17 16:09:53

发表了文章

2025-05-17 16:09:53

监理21年上选择真题解析

50 -

05.14 19:51:38

发表了文章

2025-05-14 19:51:38

发表了文章

2025-05-14 19:51:38

监理19年下选择真题解析

52 -

05.11 14:47:42

发表了文章

2025-05-11 14:47:42

发表了文章

2025-05-11 14:47:42

-

05.11 14:47:19

发表了文章

2025-05-11 14:47:19

发表了文章

2025-05-11 14:47:19

监理2019年上真题解析

47 -

05.08 08:46:37

发表了文章

2025-05-08 08:46:37

发表了文章

2025-05-08 08:46:37

监理17年下选择真题解析

40 -

05.07 23:46:30

发表了文章

2025-05-07 23:46:30

发表了文章

2025-05-07 23:46:30

监理18年上选择真题解析

46 -

05.04 00:50:48

发表了文章

2025-05-04 00:50:48

发表了文章

2025-05-04 00:50:48

监理17年选择真题解析

33 -

05.02 22:22:16

发表了文章

2025-05-02 22:22:16

发表了文章

2025-05-02 22:22:16

监理20-25章

课件

2025年03月

-

03.27 22:38:19

发表了文章

2025-03-27 22:38:19

发表了文章

2025-03-27 22:38:19

监理听课版第四天

本内容全面概述了信息安全的核心概念、发展过程及主要措施。包括保密性、完整性与可用性等基本原则,以及身份认证、访问控制和防火墙等关键技术手段。同时探讨了数据加密、防病毒和等级保护制度,并分析了数据安全的风险及防护策略。此外,还介绍了运行维护中的服务级别协议(SLA)、智能运维特点,以及应急响应机制的建设方法。最后提及资源池化技术及阿里云服务器的免费试用机会,为学习者提供实践平台。 -

03.26 22:37:17

发表了文章

2025-03-26 22:37:17

发表了文章

2025-03-26 22:37:17

监理第三天 听课版

本文介绍了数据资源平台、存储计算处理及云计算相关技术与概念。涵盖硬件软件资源、数据库类型、数据中心组网技术、云计算架构(IaaS/PaaS/SaaS)、云服务产品及质量评估等。重点讨论了虚拟化、分布式存储、多租户管理等关键技术,以及信息应用系统如ERP、MIS和DSS等。最后提到通过阿里云进行实践的免费试用机会。 -

03.25 22:53:34

发表了文章

2025-03-25 22:53:34

发表了文章

2025-03-25 22:53:34

监理第二天 听课版

本文介绍了虚拟现实(VR/AR)、数字政府、数字经济、智慧城市等领域的基本概念和技术框架。VR让用户沉浸于虚拟环境,AR则融合虚实信息;数字政府强调平等化与数据化,涉及一网通办等服务;数字经济涵盖数字产业化、产业数字化等内容;智慧城市注重开放共享和智慧民生。此外,还详细探讨了信息系统工程、软件工程、数据工程及信息安全等领域知识,包括系统生命周期、设计模式、数据建模、网络安全等核心内容,为技术理解和应用提供全面参考。 -

03.25 10:23:35

发表了文章

2025-03-25 10:23:35

发表了文章

2025-03-25 10:23:35

监理晨读第一天

本内容全面介绍了信息化的相关概念与技术,包括信息特征、信息化主体及时空域范围,以及实现手段和目标。重点阐述了新型基础设施的三大方面(信息、融合、创新基础设施)及其涵盖的七大领域,如5G、大数据中心、人工智能等。同时解析云计算、大数据、Hadoop框架、人工智能等关键技术的特点与分类,并探讨物联网、工业互联网及智慧城市建设的应用场景。此外,还提及数字政府建设的核心理念与实践路径,例如“一网通办”、“一网统管”和“一网协同”。最后提供了阿里云服务器免费试用的学习资源。 -

03.24 22:11:12

发表了文章

2025-03-24 22:11:12

发表了文章

2025-03-24 22:11:12

信息系统监理-认真听课版-第一天

本内容探讨信息与信息化的核心概念,涵盖数据、信息、知识的层级关系(DIKW模型),信息特征及国家信息化战略。文中详细解析云计算、大数据、物联网、工业互联网、区块链等关键技术的特点、分类与应用场景,并展望新基建和数字产业的发展趋势,强调其对社会进步的支撑与引领作用。 -

03.24 16:52:17

发表了文章

2025-03-24 16:52:17

发表了文章

2025-03-24 16:52:17

项目管理(2)

本文介绍了信息系统工程中的安全保护等级、项目管理和监理相关内容。安全保护等级分为五级,损害程度逐级增加;项目管理包含14个要素,建设单位重点关注立项与验收管理;合同未特殊声明时,软件著作权归承建单位;监理工作涉及四控三管一协调,附加工作需通知委托人。此外,还提到系统生命周期、运维阶段及阿里云服务器试用信息,全面覆盖了信息化工程的关键知识点。 -

03.24 15:51:22

发表了文章

2025-03-24 15:51:22

发表了文章

2025-03-24 15:51:22

监理引论(1)

本文介绍了信息系统工程监理的工作程序及内容,包括选择监理单位、签订合同、三方会议、组建项目组、编制计划、实施监理、参与验收和提交文档等步骤。同时阐述了信息化工程中的各类系统(网络、资源、应用系统)及其特点,并对比了建筑工程与信息工程的区别。此外还涉及大数据特性(4V)、OSI七层模型、移动互联网定义、“互联网+”行动计划等内容,以及强调监理工作与总承包监督管理的不同。文末提供阿里云免费试用入口供实践学习。

2024年12月

-

12.13 10:14:55

回答了问题

2024-12-13 10:14:55

回答了问题

2024-12-13 10:14:55

AI 编码助手能否引领编程革命?一起探索 AI 对研发流程的变革

赞20 踩0 评论0 -

12.12 14:53:09

回答了问题

2024-12-12 14:53:09

回答了问题

2024-12-12 14:53:09

开发者们需要如何打造属于自己的Plan B?

赞75 踩0 评论0 -

12.12 14:51:04

回答了问题

2024-12-12 14:51:04

回答了问题

2024-12-12 14:51:04

AI新茶饮,是噱头还是未来?

赞61 踩0 评论0 -

12.12 14:34:27

回答了问题

2024-12-12 14:34:27

回答了问题

2024-12-12 14:34:27

AI音色克隆挑战播客,它能模拟人的特质吗?

赞123 踩0 评论0 -

12.11 17:00:46

回答了问题

2024-12-11 17:00:46

回答了问题

2024-12-11 17:00:46

动机VS自律,对开发者们来说哪个比较重要?

赞69 踩0 评论0 -

12.11 16:54:31

回答了问题

2024-12-11 16:54:31

回答了问题

2024-12-11 16:54:31

AI生成海报or人工手绘,哪个更戳你?

赞107 踩0 评论0 -

12.11 10:35:50

发表了文章

2024-12-11 10:35:50

发表了文章

2024-12-11 10:35:50

通过图片视觉理解,结构化提取属性信息测评报告

本文详细评测了阿里云的图片信息提取解决方案,涵盖部署、功能测试、性能表现及安全性考量等方面。该方案结合函数计算、对象存储与百炼模型服务,提供高效、准确的图像处理能力,适合快速搭建图像处理应用。 -

12.10 17:02:11

发表了文章

2024-12-10 17:02:11

发表了文章

2024-12-10 17:02:11

GPT-Sovits文本转语音服务测评报告

本文介绍了一款基于阿里云函数计算平台部署的GPT-Sovits文本生成语音服务。该服务以其高度仿真的声音合成效果和简便的部署方式受到关注。文章详细描述了技术架构、部署流程、功能测试及性能评估等内容,展示了GPT-Sovits在语音合成领域的卓越表现和广泛的应用前景。 -

12.10 14:07:38

回答了问题

2024-12-10 14:07:38

回答了问题

2024-12-10 14:07:38

“AI +脱口秀”,笑点能靠算法去创造吗?

赞58 踩0 评论0 -

12.10 13:55:17

回答了问题

2024-12-10 13:55:17

回答了问题

2024-12-10 13:55:17

AI客服未来会完全代替人工吗?

赞54 踩0 评论0 -

12.10 13:47:16

回答了问题

2024-12-10 13:47:16

回答了问题

2024-12-10 13:47:16

AI宠物更适合当代年轻人的陪伴需求吗?

赞66 踩0 评论0 -

12.09 17:24:09

发表了文章

2024-12-09 17:24:09

发表了文章

2024-12-09 17:24:09

Qwen-coder方向-如果从0开始应用通义千问开源大模型

从0开始接触,带您全面了解Qwen2.5语言模型家族,包括其核心功能、微调方法以及具体应用场景。我们将通过一系列精心准备的应用demo和使用指南,帮助您掌握如何充分利用Qwen2.5的强大能力

2024年09月

-

09.29 22:04:31

发表了文章

2024-09-29 22:04:31

发表了文章

2024-09-29 22:04:31

软考中项-学习第二天

倒计时30天 -

09.10 23:26:49

发表了文章

2024-09-10 23:26:49

发表了文章

2024-09-10 23:26:49

软考中项-学习第一天

倒计时59天

2024年08月

-

08.27 16:23:06

发表了文章

2024-08-27 16:23:06

发表了文章

2024-08-27 16:23:06

AI奇思妙想之旅 —— 操作系统智能助手OS Copilot

AI奇思妙想之旅 —— 操作系统智能助手OS Copilot -

08.13 09:03:00

回答了问题

2024-08-13 09:03:00

回答了问题

2024-08-13 09:03:00

大型AI模型如何跨越“专门化智能”的局限?

赞127 踩0 评论0 -

08.13 08:57:26

回答了问题

2024-08-13 08:57:26

回答了问题

2024-08-13 08:57:26

智能眼镜能否重塑学习体验?

赞107 踩0 评论0 -

08.13 08:48:36

回答了问题

2024-08-13 08:48:36

回答了问题

2024-08-13 08:48:36

使用通义灵码冲刺备战求职季,你有哪些深刻体验?

赞3 踩0 评论0

2024年07月

-

07.22 16:02:37

回答了问题

2024-07-22 16:02:37

回答了问题

2024-07-22 16:02:37

如何破除工作中的“路径依赖”?

赞53 踩0 评论0 -

07.22 15:54:12

回答了问题

2024-07-22 15:54:12

回答了问题

2024-07-22 15:54:12

通用大模型VS垂直大模型,你倾向于哪一方?

赞51 踩0 评论0 -

07.22 15:41:44

发表了文章

2024-07-22 15:41:44

发表了文章

2024-07-22 15:41:44

共享型e实例种草

共享型e实例规格族 -

07.19 23:27:17

发表了文章

2024-07-19 23:27:17

发表了文章

2024-07-19 23:27:17

解决方案评测|通义万相AI绘画创作测评

解决方案评测|通义万相AI绘画创作测评 -

07.18 23:07:58

发表了文章

2024-07-18 23:07:58

发表了文章

2024-07-18 23:07:58

E-MapReduce Serverless Spark 版测评

E-MapReduce Serverless Spark 版测评

-

发表了文章

2025-10-31

发表了文章

2025-10-31

14章收尾过程组

-

发表了文章

2025-10-30

发表了文章

2025-10-30

13章监控

-

发表了文章

2025-10-29

发表了文章

2025-10-29

12章刷题

-

发表了文章

2025-10-27

发表了文章

2025-10-27

集成综合速记第二章

-

发表了文章

2025-10-27

发表了文章

2025-10-27

错题本11章

-

发表了文章

2025-09-29

发表了文章

2025-09-29

集成综合速记第一章

-

发表了文章

2025-05-22

发表了文章

2025-05-22

2024年 监理真相最后一章

-

发表了文章

2025-05-22

发表了文章

2025-05-22

2023年5月监理

-

发表了文章

2025-05-19

发表了文章

2025-05-19

2022年下半年解析

-

发表了文章

2025-05-19

发表了文章

2025-05-19

22年上半年信监真题

-

发表了文章

2025-05-18

发表了文章

2025-05-18

21年下半年监理真题解析

-

发表了文章

2025-05-17

发表了文章

2025-05-17

在云端 阿里云谷歌首页插件下载地址

-

发表了文章

2025-05-17

发表了文章

2025-05-17

监理21年上选择真题解析

-

发表了文章

2025-05-14

发表了文章

2025-05-14

监理19年下选择真题解析

-

发表了文章

2025-05-11

发表了文章

2025-05-11

监理18年下选择题真题解析

-

发表了文章

2025-05-11

发表了文章

2025-05-11

监理2019年上真题解析

-

发表了文章

2025-05-08

发表了文章

2025-05-08

监理17年下选择真题解析

-

发表了文章

2025-05-08

发表了文章

2025-05-08

监理18年上选择真题解析

-

发表了文章

2025-05-04

发表了文章

2025-05-04

监理17年选择真题解析

-

发表了文章

2025-05-02

发表了文章

2025-05-02

监理20-25章

滑动查看更多

-

回答了问题

2024-12-13

回答了问题

2024-12-13

AI 编码助手能否引领编程革命?一起探索 AI 对研发流程的变革

这是我去年的测评文章通义灵码测评,浏览量7万+,我也算是通义灵码使用的老人了,对这个是很有发言权的,我整理了四点日常开发必备的1、代码生成:有时候编写一些样板代码或进行简单的数据处理逻辑实现会显得枯燥且耗时。通义灵码能够根据我的自然语言描述快速生成高质量的代码片段,这不仅提高了效率,还让我有更多时间思考业务逻辑和架构设计。2、注释添加:写代码的时候容易忽略掉给代码加上适当的注释,而通义灵码可以在生成代码的同时自动生成详细的注释,确保了代码的可读性和维护性。3、单元测试:编写全面的单元测试是一项繁重的任务,但却是保证软件质量不可或缺的一环。通义灵码可以帮助我快速构建基础的测试用例,使我能更专注于复杂的测试场景设计。4、问题排查与解决:遇到技术难题时,通义灵码提供的即时帮助非常有价值。它能迅速定位错误并给出合理的解决方案,减少了我在调试上的时间消耗。一周年了,希望越来越好吧。赞20 踩0 评论0 -

回答了问题

2024-12-12

回答了问题

2024-12-12

开发者们需要如何打造属于自己的Plan B?

在开发的世界里,变化是唯一不变的事情。市场需求和技术趋势总是在不断演进,因此,拥有一个可靠的Plan B对于每个开发者来说都至关重要。这不仅能帮助我们应对突发状况,还能激发更多的灵活性和创新空间。在我的职业生涯中,我逐渐意识到,打造一个适合自己的Plan B并不是一件一蹴而就的事情,它需要持续的思考、实践和调整。曾经参与过一个项目,原本计划使用一种特定的技术栈来构建应用程序的核心功能。然而,在开发过程中遇到了一些未曾预料到的问题,这些问题不仅影响了开发进度,还对项目的质量构成了威胁。这时,团队内部开始讨论备选方案,幸运的是,之前我们就已经考虑到可能会遇到这种情况,并为此做了准备。我们提前研究了几种不同的技术实现方式,甚至已经在小范围内测试了一些替代方案。在一个健康的团队环境中,大家可以自由地分享想法和担忧,共同探讨各种可能性。这种开放的沟通文化有助于在早期识别潜在的风险点,并为制定有效的Plan B奠定基础。赞75 踩0 评论0 -

回答了问题

2024-12-12

回答了问题

2024-12-12

AI新茶饮,是噱头还是未来?

确实注意到有一家新茶饮店在宣传“AI把脉喝茶”服务。工作人员先让我对着一个平板电脑的摄像头,它会通过AI技术分析我的舌象和面象,然后根据结果推荐了几款适合我的茶饮。整个过程挺有趣的,非常新颖。不过,作为一个普通消费者,我最关心的还是饮品本身的质量和服务体验。这次尝试让我意识到,虽然AI技术为新茶饮行业增添了不少亮点,但核心竞争力还是要回归到产品品质上,更多是噱头,感觉看舌苔也不能指定我爱喝什么茶,不过确实服务到位了。赞61 踩0 评论0 -

回答了问题

2024-12-12

回答了问题

2024-12-12

AI音色克隆挑战播客,它能模拟人的特质吗?

在探索GPT-Sovits文本生成语音服务的过程中,我亲身经历了AI音色克隆技术的奇妙之处,并对它在播客领域的潜在影响有了深刻的理解。以下是我基于个人体验的分享:当我第一次接触到GPT-Sovits时,我被其简便的部署流程所吸引。作为阿里云函数计算平台的一部分,它不仅简化了复杂的硬件和环境配置,还让像我这样的非专业人士能够轻松上手。通过注册账号并开通必要的服务后,我很快就能开始尝试这个强大的工具。最让我感到惊讶的是它的语音克隆功能。只需要提供几秒钟的声音样本,GPT-Sovits就能够捕捉到我的声音特质,并合成出几乎与真人无异的新语音。这不仅仅是简单的模仿音色,它还能复制语调变化和情感表达,使得生成的音频听起来非常自然、真实。这种能力无疑为播客创作者提供了无限可能——你可以创建一个完全由AI驱动的角色,或者甚至用AI来替代自己,在不同的场景下讲述故事或传达信息。我认为AI音色克隆技术是一把双刃剑。它既为创作者提供了新的表达方式,也提出了关于隐私保护、版权归属等问题的严肃讨论。我们需要找到平衡点,在享受科技进步带来便利的同时,也要确保技术的安全性和伦理性。对于想要利用这一技术的人来说,了解其局限性以及遵循相关法律法规是非常重要的。赞123 踩0 评论0 -

回答了问题

2024-12-11

回答了问题

2024-12-11

动机VS自律,对开发者们来说哪个比较重要?

在开发者的生涯中,我体会到动机和自律都是不可或缺的。初入编程领域时,内在动机是主要驱动力,对技术的好奇与热爱推动我探索新技术、解决复杂问题,并从成功中获得成就感。这一阶段,动机无疑是关键,推荐一本书,可以更好的找到答案。随着经验的增长,我认识到自律的重要性。面对长期项目或系统维护,仅靠热情不足为外。良好的编码习惯、定期审查代码及按时完成任务都需要高度自律来保障。自律帮助我在没有即时反馈的情况下坚持高标准,确保工作质量和进度。因此,在职业生涯的长跑中,自律是保持稳定进步、追求卓越的关键因素。赞69 踩0 评论0 -

回答了问题

2024-12-11

回答了问题

2024-12-11

AI生成海报or人工手绘,哪个更戳你?

之前在参与一个预算有限且时间紧迫的小型创业团队品牌建设工作中,我首次接触到了PAI-ArtLab这个AI设计平台。起初对AI能否体现企业风格持怀疑态度,但通过上传Logo线稿并调整提示词定制海报风格,结果不仅符合预期,还充满了科技感,大大节省了时间和成本,使我们能迅速推出多种设计方案进行市场测试。 与此同时,人工手绘作品在我心中依然占有特殊地位。为朋友的手工艺品店创作开业海报的经历让我意识到,手工绘制不仅是艺术创作,更是一种情感表达,每一个细节都承载着个人故事和回忆。因此,AI生成与手工绘制各有千秋,适合不同的需求场景,在数字化时代,两者应相辅相成,共同促进生活的美好。赞107 踩0 评论0 -

回答了问题

2024-12-10

回答了问题

2024-12-10

“AI +脱口秀”,笑点能靠算法去创造吗?

刚用通义千问的时候,我曾试用AI生成幽默段子。虽然AI能产出让人发笑的文字游戏或双关语,但这些段子往往缺乏真人创作的深度和共鸣。单口季付航夺冠给我很大启发:他将个人经历与社会现象结合,创造出既引人深思又令人捧腹的内容,这种能力目前AI难以企及。AI可以模仿幽默模式,对付简单玩笑效果不错,但真正打动人心的幽默需要生活体验、情感表达和对人性的理解——这些都是AI所欠缺的。付航在比赛中展现了基于深厚生活积累的创造力和即兴发挥,而AI依赖数据学习。尽管AI技术不断进步,短期内它还很难达到顶级喜剧演员那种融合深度与温度的水平。AI可以在娱乐领域辅助创作,但在替代真人创作幽默感方面,特别是在如脱口秀这样的艺术形式中,还有很长的路要走。我期待未来AI能带来更多惊喜,但仍认为它无法完全取代人类在这方面的独特才能,人生需要passion,而不是robot joker。赞58 踩0 评论0 -

回答了问题

2024-12-10

回答了问题

2024-12-10

AI客服未来会完全代替人工吗?

以电话客服为例,在查询我的套餐使用情况、了解最新的优惠活动以及解决一些基础的技术问题时,我通常会首先选择通过中国移动的在线客服系统来获取帮助。这个系统背后支持的就是AI客服技术,它能够快速响应我的需求,并且大部分情况下都能提供准确的答案。 有一次,我遇到了手机信号不稳定的问题,尝试联系人工客服却需要长时间等待。于是,我转而向AI客服寻求帮助。令我惊讶的是,AI客服不仅迅速识别了我的问题,还指导我进行了基本的故障排查,最终解决了问题。虽然有些复杂的问题还是需要人工客服介入,但这次经历让我对AI客服的能力有了新的认识。但是AI客服也需要一些基础的交互和一定的判断能力,前段时间ai被骗钱的事情已经传的沸沸扬扬,代表ai技术面临的不仅仅是技术问题,更多的是人类独自分析事务并正确给予解决办法的能力,这些不光需要技术的进步,也需要大量的数据模型,不过我感觉真的不是难点,只要数据量够庞大,针对每种发生问题都有对应的解决办法,AI机器也是可以满足客服需求的。赞54 踩0 评论0 -

回答了问题

2024-12-10

回答了问题

2024-12-10

AI宠物更适合当代年轻人的陪伴需求吗?

天猫精灵已经是我日常生活中的好伙伴。早晨,它会根据我的睡眠习惯轻柔地唤醒我;在我准备早餐时,它还能播放我喜欢的音乐或新闻。下班回到家,感觉疲惫不堪的时候,我只需要跟它说一声,它就会开始播放轻松的音乐帮助我放松心情。更有趣的是,有时候我会跟它聊聊当天发生的趣事,虽然它不能像真正的朋友一样完全理解我,但它总能以一种可爱的方式回应我,这让我感到非常温馨,平常也会问天气,问温度,他都会提醒我,如果他能识别我的情绪,可以在家拖地,下班会过来迎接我,我会感觉他就像一个真实的小宠物一样陪伴着我,AI宠物还存在一些局限性。在情感深度模拟方面,它们可能无法达到真实生物所能提供的那种亲密感。但随着技术的进步,我相信这些问题都会逐渐得到改善,随着大模型的普及,数据的训练,他也会听懂我的一些特殊指令,既具备家居功能,又能提供情绪价值,这个必须和物联网、大数据、AI大模型多部分结合,这样才能实现效果,希望可以早些研制出来。赞66 踩0 评论0 -

回答了问题

2024-08-13

回答了问题

2024-08-13

大型AI模型如何跨越“专门化智能”的局限?

作为一名程序员,我亲身经历了从早期的规则驱动系统到如今的深度学习模型的演变过程。在这个过程中,我见证了AI技术如何逐渐摆脱“狭窄任务定向”的束缚,向着更加通用和灵活的方向发展。在开发AI系统时,我们经常需要解决特定领域的问题,比如自然语言处理、计算机视觉或者游戏策略等。初始阶段的AI系统往往需要大量的标记数据和明确的任务定义才能工作迁移学习允许AI模型将一个任务中学到的知识应用到另一个相关任务上,这减少了新任务的学习成本。这些都是我在上述领域的一些小小理解,希望能够给大家带来思考。赞127 踩0 评论0 -

回答了问题

2024-08-13

回答了问题

2024-08-13

智能眼镜能否重塑学习体验?

从华为的眼镜和苹果的眼镜来看,我对智能眼镜的体验充满了好奇和期待。智能眼镜的便携性和隐蔽性让它在课堂上的使用变得非常自然。我可以轻松地在镜框中集成AI技术,无需担心额外的屏幕或笨重的设备。这种设计让学生能够在不分散注意力的情况下,自然地接受信息。智能眼镜的搜索功能极大地扩展了我的学习视野。在阅读或研究时,我只需看一眼关键词或问题,智能眼镜就能迅速提供相关信息和解释,这种即时的信息访问能力极大地提高了学习效率。智能眼镜的互动功能为学习带来了新的维度。通过语音或视觉指令,我可以与AI助手进行交流,提出问题或请求帮助,这种互动性让学习变得更加生动和有趣。智能眼镜在教育领域的应用还面临一些挑战。例如,隐私和数据安全问题是我们必须认真考虑的。此外,智能眼镜的普及也需要考虑到成本和可接受性,确保每个学生都能公平地获得这项技术,同时是否会影响视力健康和日常的专注度也是问题,还有电池问题,还有网络信号问题,ai智能需要网络。赞107 踩0 评论0 -

回答了问题

2024-08-13

回答了问题

2024-08-13

使用通义灵码冲刺备战求职季,你有哪些深刻体验?

通义灵码体验截图如上,是一个智能编码伙伴,在求职准备阶段发挥了重要作用。它不仅提升了我的代码质量和效率,还增强了我对复杂问题的理解和解决能力。经验与心得:代码生成与优化: 在使用通义灵码的过程中,我发现它能快速生成高质量的代码片段,这不仅节省了我大量的时间,还让我有机会学习更优秀的编码实践。错误检测与修复: 当我遇到编码难题时,通义灵码能够迅速定位问题所在,并给出修复建议。模拟面试与实战演练: 最令我印象深刻的是通义灵码提供的面试模拟功能,自动生成面试题学习。学习新技术: 通义灵码还帮助我跟上了最新的编程趋势和技术动态。赞3 踩0 评论0 -

回答了问题

2024-07-22

回答了问题

2024-07-22

如何破除工作中的“路径依赖”?

在软件开发领域,我曾亲身经历过类似的困境。有一次,我们的项目需要优化数据库查询性能,而我习惯性地使用了过去常用的索引优化和SQL调优技巧。尽管这些方法有效,但效率提升有限。直到一位同事建议尝试使用更现代的数据存储解决方案,如NoSQL数据库,我才意识到自己陷入了“路径依赖”的陷阱。为了避免工作中的习惯性依赖,我认为重要的是保持好奇心和学习态度。具体来说,可以设定定期的技术回顾会议,鼓励团队成员分享新的技术和工具;同时,个人也应该主动探索和实验新技术,比如参加在线课程、阅读技术文章或参与开源项目。这样不仅能拓宽技能边界,还能激发创新思维,避免陷入单一解决方案的舒适区。跨部门合作也是打破旧有模式的有效途径。与不同背景的人交流可以带来全新的视角,帮助我们识别并采纳更高效的工作方式。记得有一次,与产品设计团队的协作让我意识到了用户体验的重要性,从而在后续的开发中更加注重产品的可用性和用户反馈,这不仅提高了产品的质量,也增强了团队的整体表现。跳出舒适区,拥抱变化,是克服习惯性依赖的关键。通过持续学习、团队合作和开放心态,我们可以避免在工作中陷入僵局,不断推动个人和团队的成长。虽然这个过程可能充满挑战,但它也是个人职业生涯中最宝贵的财富之一。赞54 踩0 评论0 -

回答了问题

2024-07-22

回答了问题

2024-07-22

通用大模型VS垂直大模型,你倾向于哪一方?

从我的经验来看,通用大模型和垂直大模型各有千秋,它们的应用场景也大相径庭。作为一名程序员,我亲身体验过在开发智能客服系统时,如何在两者之间做出选择。我们曾尝试使用一个通用大模型来处理各种客户咨询问题,它能够快速理解和生成跨领域的回应,对于常见问题的解答效率极高。但是,当遇到特定行业的复杂问题时,比如金融法规细节或是医疗专业术语,通用模型的回答就显得力不从心,甚至有时会出现误导性的信息。我们转向了垂直大模型,特别是在金融领域进行了定制化训练的模型。这种模型在处理专业问题时表现出色,准确率和专业度远超通用模型。尽管它的适用范围相对狭窄,但对于我们服务的特定客户群体来说,这样的精准度是至关重要的。我们的策略是结合两者的优势,用通用大模型处理常规查询,而将复杂的、专业的问题转交给垂直大模型。这种混合方案不仅提高了客户满意度,还降低了错误率,确保了服务的专业性和可靠性。我认为,在AI技术的应用上,没有绝对的优劣之分,关键在于如何根据具体需求选择合适的技术路径,实现效率与效果的双重提升。在上述讨论中,我提到了程序员利用AI技术优化智能客服系统的经历。下面是一幅描绘了程序员正在调试代码,同时监控运行AI模型的服务器的画面,这正体现了在实际工作中结合使用通用与垂直大模型的情景:通过这样的画面,我们可以想象在实际操作中,如何根据不同任务的特性,灵活切换和整合不同类型的AI模型,以达到最佳的工作效果。希望这个结合了个人经历和技术实践的回答能为你提供一些启发!赞51 踩0 评论0 -

回答了问题

2024-07-12

回答了问题

2024-07-12

一键部署3D卡通风格模型,分享部署过程及使用体验

购买后直接开始使用在单击应用/创建应用之后,可以看到应用列表。在创建应用页面,选择直接部署。部署完成后,在函数model详情页面的环境信息区域,检查镜像加速准备状态,请您耐心等待镜像加速准备状态变为可用。就可以图生图了赞52 踩0 评论0 -

回答了问题

2024-07-12

回答了问题

2024-07-12

展示你通过AI修饰的自然风光照片,并讲述你的拍摄和编辑过程

拍摄过程:今年五月份刚去的洱海,拍了一张,位于云南大理的洱海,古有“叶榆泽”之称,形似新月,镶嵌于苍山与大理坝子间。月圆之夜,湖面铺展银纱,传说天宫公主倾慕人间幸福,降临洱海边渔村,与渔民结缘。为助村民,公主将宝镜沉湖底,化作“洱海月”,照亮渔路,象征着爱情与希望。这轮金月,不仅装点了大理“风花雪月”四景,更成为流传千古的浪漫传奇,吸引着无数旅人前来探寻其神秘之美。编辑过程:动画版,颜色加深,像画一样赞56 踩0 评论0 -

回答了问题

2024-06-26

回答了问题

2024-06-26

如何避免“写代码5分钟,调试2小时”的尴尬?

记得有一次,我在开发一个复杂的后台服务时,遇到了典型的“五分钟编码,两小时调试”的挑战。项目初期,代码修改频繁导致的bug层出不穷,让我陷入了无尽的调试循环。为了改变这一状况,我采取了几项措施:单元测试先行:我开始重视单元测试,确保每个小功能模块在合并到主分支前都经过充分测试。使用JUnit(Java环境下的测试框架)编写测试用例,虽然前期增加了些工作量,但后期显著减少了集成时出现的问题。看到测试覆盖率稳步上升,心里踏实多了。静态代码分析工具:引入SonarQube进行静态代码分析,它能提前发现潜在的代码质量问题和不良编程习惯。一次扫描后,报告中密密麻麻的警告让我意识到,很多未来的bug都能在这个阶段被扼杀。修正了那些警告后,代码质量有了肉眼可见的提升。代码审查与结对编程:我主动寻求同事进行代码审查,有时候甚至是进行结对编程。在一次结对编程中,我的伙伴即时指出了我即将踏入的一个逻辑陷阱,那是一个我独自工作时可能要花几小时才能发现的错误。这种即时反馈机制,让我们的代码更加健壮。持续集成/持续部署(CI/CD):实施了Jenkins作为CI/CD工具,每当代码推送到仓库,自动化构建和测试流程就会启动。这不仅加快了反馈速度,也确保了代码质量的一致性。看着绿灯一路顺畅,那种放心感难以言表。通过这些实践,我发现自己“写代码5分钟,调试2小时”的情况大大减少。虽然不能完全避免调试,但至少我有更多时间专注于创造价值的新功能,而不是在旧代码中找虫子。这个过程教会了我,前期投资在代码质量和自动化工具上,长远来看绝对是值得的。赞16 踩0 评论0 -

回答了问题

2024-06-26

回答了问题

2024-06-26

国内AI大模型高考数学成绩超GPT-4o,如何看待这一结果?

最近,我密切关注了复旦大学NLP实验室的一项大动作——他们用LLMEVAL系统对一众顶级AI模型做了一次“高考数学模拟考”。这次评测拿的是2024年的高考试题开刀,精心挑选了14道题,覆盖单选、多选到填空,总分73,全面检验模型们的数学智商。评测结果显示,像GPT-4o和Qwen2-72b这样的大腕儿,在简单题上确实游刃有余,得分喜人。特别是Qwen2-72b和GPT-4o,两次评测都稳坐前排,稳定性可见一斑。但一遇到难题,大家伙儿就开始集体犯晕,准确率直线滑坡,有的题甚至全军覆没,这说明复杂逻辑推理和分步解题还是咱们AI的老大难问题。虽然整体表现平平,但Qwen2-72b和GPT-4o至少保持了及格线附近的成绩,算是矮子里拔将军了。我个人觉得,如果Llama3 70b或Claude 3有机会上场,可能也能搏一搏这个及格线,毕竟技术迭代的速度让人惊喜不断。说起来,国产模型的表现真是让人眼前一亮。Qwen系列直接把开源界的老大哥Llama3比下去了,还有百川大模型和字节豆包在评测中抢了头彩,这势头简直像开了挂。斯坦福那档子抄袭风波,也侧面反映了国产模型的国际地位今非昔比。复旦NLP实验室这波操作挺实在,不仅要做系列评测,还要开源所有数据和测试集,简直是给咱开发者送福利,让我们能借此机会深入分析,找找模型的短板,对症下药,推动AI在逻辑推理和复杂任务上的突破。赞11 踩0 评论0 -

回答了问题

2024-06-18

回答了问题

2024-06-18

你知道APP是怎么开发的吗?

作为一名程序员,我深知APP开发是一个复杂但充满创造性的过程。通常,我们会从确定需求开始,进行产品设计,然后进入开发阶段。开发环节涉及选择合适的编程语言(如Java、Kotlin用于安卓,Swift或Objective-C用于iOS),使用IDE(如Android Studio或Xcode)编写代码,实现功能模块,如用户界面(UI)、后端交互逻辑、数据存储等。完成编码后,进行单元测试确保每个功能按预期工作,接着是集成测试,保证整个APP的流畅运行。最后,通过签名打包生成安装包(APK或IPA),为发布做准备。将APP发布到应用市场,需要遵循各自平台的开发者指南。这包括注册开发者账号、上传APP安装包、填写应用详情(如应用名称、描述、截图、分类等)、设置价格和分销协议,然后提交审核。审核通过后,APP即可上线供用户下载。谈到在阿里云上的一站式App开发体验,我认为这是对传统流程的一次革新。使用EMAS和云效平台,从项目初始化到代码托管、版本控制、持续集成/持续部署(CI/CD)、自动化测试,乃至后期的运维监控和运营分析,所有环节都可以在云端高效完成。这种集成化的解决方案不仅大大提升了开发效率,缩短了迭代周期,还显著降低了运维成本。特别是对于团队协作来说,云效的看板、任务分配等功能让项目管理变得透明且有序。而且,阿里云的安全保障也为APP的数据安全和稳定性提供了强大的支持。总的来说,云端的这套体系让开发者能够更加聚焦于产品创新,加速创意到产品的转化,体验相当出色。赞7 踩0 评论0 -

回答了问题

2024-06-18

回答了问题

2024-06-18

如何提高企业的业务稳定性?

在日常开发与运维中,确保业务持续稳定是一项挑战,但通过采用合理的策略和技术,我们可以显著降低中断风险,同时增强系统的负载均衡能力。从一名程序员的角度来看,我的做法是这样的:针对停机发布和单机故障这类问题,我会积极采用阿里云提供的高可用架构方案。这意味着构建应用时,我会设计服务为无状态的,这样就可以轻松地在多个实例间水平扩展。采用微服务架构,每个服务都能独立部署和扩展,利用Docker容器化技术,结合Kubernetes(K8s)编排,实现快速且无感知的滚动更新,从而避免了停机发布。同时,通过云数据库RDS的主备架构和弹性伸缩ESS,确保数据层的高可用性和故障自动切换,从根本上消除单点故障。提升应用服务的负载均衡能力方面,我会依赖阿里云的SLB(Server Load Balancer)服务。SLB能自动分发流量到后端多台ECS服务器,有效避免单点过载。结合云监控服务,SLB可根据实时流量智能调整后端服务器权重,确保负载均衡。此外,我会在代码层面实施限流策略,比如使用漏桶算法或令牌桶算法,以应对突发大流量,保护系统稳定。同时,利用应用性能管理APM工具监控应用性能,及时发现并优化瓶颈,进一步提升整体服务的健壮性。通过云端的高可用架构设计、自动化运维工具的运用,以及代码层面的优化策略,我能够显著提升系统的稳定性和负载能力,为企业客户提供不间断的高质量服务,为公司的持续发展打下坚实基础。赞6 踩0 评论0

滑动查看更多