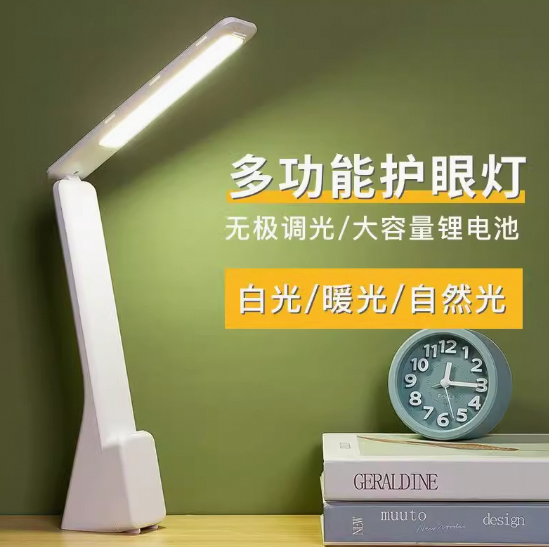

4000积分,护眼灯*2,花朵坐垫*3

4000积分,护眼灯*2,花朵坐垫*3

在当前人工智能领域,深度学习框架作为支撑众多创新研究和技术应用的重要基石。然而,从底层原理出发,亲手构建一个现代深度学习框架无疑是一项极具挑战性的任务,那么,如果想要从零开始构建这样一个能够高效支持各类神经网络模型训练、推理及部署的现代深度学习框架,应该如何着手呢?

本期奖品:截止2024年5月28日24时,参与本期话题讨论,将会选出 2 个优质回答获得护眼台灯,3 名幸运用户获得花朵坐垫。快来参加讨论吧~

幸运用户获奖规则:本次中奖楼层百分比为45%、65%、95%的有效留言用户可获得互动幸运奖。如:活动截止后,按照回答页面的时间排序,回复为100层,则获奖楼层为 100✖35%=35,依此类推,即第35位回答用户获奖。如遇非整数,则向后取整。 如:回复楼层为81层,则81✖35%=28.35,则第29楼获奖。

优质讨论获奖规则:不视字数多,结合自己的真实经历分享,非 AI 生成。

未获得实物礼品的参与者将有机会获得 10-100 积分的奖励。

注:楼层需为有效回答(符合互动主题),灌水/复制回答将自动顺延至下一层。字数不得少于15 字,言之无物无效(例如:加油、我觉得挺好等等),如有复制抄袭、不当言论等回答将不予发奖。阿里云开发者社区有权对回答进行删除。获奖名单将于活动结束后5个工作日内公布,奖品将于7个工作日内进行发放,节假日顺延。

中奖用户:

截止到5月28日共收到118条有效回复,获奖用户如下

优质回答:anisbob、魏红斌

幸运用户:神秘海盗、Carl_奕然、lihongtao1212121

恭喜以上用户!感谢大家对本话题的支持~

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

从0构建很难呢。构建一个现代深度学习框架是一个技术密集型任务,需要对机器学习、软件工程以及硬件架构有深入的理解。以下是构建这样一个框架的步骤。概念与规划阶段

明确你希望框架解决的核心问题,比如易用性、性能、可扩展性等。

分析现有框架的优势和不足,以及市场需求。

选择适合的语言(如Python、C++)、库(如NumPy、CUDA)和工具。

架构设计阶段

设计一个模块化、可扩展的架构,包括前端API、后端执行引擎、计算图等。

确定框架的创新点,如新的神经网络架构支持、优化算法等

开发与实现阶段

开发一个基础原型,实现核心功能,如基本的神经网络训练。

将框架拆分为多个模块,如数据处理、模型构建、训练等。

实现一个高效的自动微分系统,支持复杂模型的梯度计算。

测试与优化阶段

对每个模块进行详尽的单元测试,确保功能正确性。这样就可以了吧

想从0开始不简单呀。构建一个现代深度学习框架是一个复杂的工程项目,涉及多个技术领域。以下是构建这样一个框架的步骤,我们将尝试以一种更系统化和创新的方式来阐述:初始阶段:概念化与规划,初始阶段:概念化与规划

然后就是设计阶段呀框架架构设计:

设计一个灵活的架构,支持多种深度学习模型和算法。

核心组件规划:

确定框架的关键组件,如自动微分、优化器、计算图等

最后就是开发和测试了,弄完就搞定了

我认为很复杂的过程,需要做很多准备呢。

首先 阶段一:需求分析与规划

市场调研:

研究现有的深度学习框架,了解它们的功能、用户群体和市场定位。

确定你的框架将解决的独特问题或提供的独特价值。

定义框架愿景:

确定框架的核心理念,例如易用性、性能、可扩展性或特定领域的优化。

技术预研:

研究深度学习的基础理论和算法。

探索最新的深度学习技术和趋势

然后呢阶段二:技术栈选择与原型设计

选择编程语言:

根据性能需求和开发者社区选择编程语言,如Python、C++等。

确定核心组件:

确定需要实现的核心组件,如自动微分引擎、优化器、损失函数等。

设计原型架构:

设计一个初步的框架架构,包括数据流、计算图、执行引擎等。

开发最小可行产品(MVP):

开发一个简单的原型,实现基础功能,如单层神经网络的训练。

最后就是核心功能的开发了,这是一个很复杂的内容

我认为呀,要构建一个现代的深度学习框架,这是一项复杂而系统的工作,需要深厚的计算机科学、数学和工程知识,应该有这些内容:定义框架目标和功能:确定你的框架将支持哪些类型的神经网络(如卷积神经网络、循环神经网络等)。

确定框架的性能目标(如训练速度、内存使用效率等)。

确定框架的可扩展性和灵活性,以适应未来可能的需求变化。

还应该学习现有框架:研究现有的深度学习框架,如TensorFlow、PyTorch、Keras等,了解它们的设计原则和实现细节。

学习它们的优势和不足,这将帮助你设计出更好的框架, 一般我认为就是这样的。

构建一个现代深度学习框架确实是一个复杂的过程,涉及计算机科学、数学、软件工程等多个领域的知识。以下是从零开始构建深度学习框架的一般步骤:

在开始之前,需要深入理解现有深度学习框架的设计和实现,如TensorFlow、PyTorch、Keras等。这包括它们的架构、API设计、核心算法、性能优化技术等。

构建深度学习框架是一个长期且持续的过程,需要不断学习最新的研究成果和技术进展,同时也需要强大的软件工程能力来保证框架的稳定性和可用性。

我觉得主要还是得明确具体的应用场景,查阅了一些资料,主要分成以下几步

学习深度学习原理:深入学习深度学习的基本原理,包括神经网络的结构、前向传播、反向传播、激活函数、损失函数等。熟悉常见的神经网络模型和它们的应用场景。

理解计算图和自动微分:深入了解计算图的概念,它是深度学习框架的核心。学习自动微分算法,了解如何计算节点的梯度,以支持反向传播和参数更新。

设计框架的结构:确定您的框架的结构和组件,包括计算图表示、模型定义、层和操作实现、优化算法等。考虑如何支持张量计算、并行计算和高效的内存管理。

选择编程语言和工具:选择适合您的需求的编程语言,如Python、C++等,并选择合适的工具和库来加速开发,如NumPy、CUDA等。

实现计算图和自动微分:根据您的设计,实现计算图的表示和操作,以及自动微分算法。确保计算图能够正确地构建和执行,并能够计算节点的梯度。

构建网络层和模型:实现常见的神经网络层和模型,如全连接层、卷积层、循环层等。确保它们能够正确地组合和连接,并支持前向传播和反向传播。

设计优化算法:实现常用的优化算法,如梯度下降、随机梯度下降、动量优化等。考虑如何支持学习率调度、权重初始化、正则化等功能。

支持多种数据类型和计算设备:考虑支持处理不同类型的数据,如图像、文本等,并支持在不同计算设备上运行,如CPU、GPU等。

实现高级功能和接口:逐步实现更高级的功能,如批归一化、Dropout、数据增强等,并提供用户友好的API和接口,方便用户使用和扩展框架。

进行测试和优化:编写测试用例来验证框架的正确性,并进行性能优化,以提高框架的效率和可扩展性。

1从数学基础开始,实现常用线性代数操作,如矩阵乘法、卷积等。这是其他模块的基础。

2设计支持自动求导的计算图系统,可以代表模型为无循环图实现前向和反向传播。

3搭建通用的层结构系统,如全连接层、卷积层等基础层类型。支持自定义层。

4支持常见损失函数如交叉熵,和优化算法如SGD,Adam等。

5搭建数据读取、预处理及增强的通用模块。支持数据集管理。

6实现示例模型LeNet或MLP证明基础功能可行。

7逐步完善到支持CNN、RNN等主流模型。

8开源发布,吸引社区完善。

从零开始构建一个现代深度学习框架确实是一项极具挑战性的工程,需要深厚的理论基础和丰富的实践经验。

数学基础

深入掌握线性代数、微积分、概率统计等数学基础知识,为框架的核心算法打下坚实基础。

核心数据结构与算法

设计高效的张量数据结构,支持多维数据的存储和计算。

实现前向传播、反向传播等深度学习核心算法。

自动微分系统

构建一个能够自动计算梯度的系统,支持复杂模型的反向传播。

可以参考现有框架如TensorFlow、PyTorch的自动微分机制。

神经网络层实现

实现各种常见的神经网络层,如全连接层、卷积层、池化层等。

提供灵活的API,方便用户定义和组合各种层。

优化器和正则化

支持各种优化算法,如SGD、Adam等,帮助模型高效训练。

实现dropout、L1/L2正则化等常见的正则化技术。

模型保存和加载

提供模型的序列化和反序列化功能,支持模型的保存和加载。

计算图构建和执行

设计一套计算图系统,支持复杂神经网络拓扑的定义和执行。

内存管理和并行化

实现高效的内存管理机制,充分利用CPU和GPU的并行计算能力。

可扩展性和部署

确保框架具有良好的可扩展性,支持在云环境等不同场景部署。

调试和可视化工具

提供丰富的调试和可视化工具,帮助用户高效地开发和调优模型。

明确目标需求。深度学习有多种应用场景,定位明确有助架构设计。

搭建模块化的基础设施。比如数学运算、数据预处理等通用库。

实现重要模型。如CNN、RNN等经典模型,是 framework的基石。

提供自动微分功能。推导计算图和梯度是机器学习的灵魂。

设计模块间交互接口。比如层—层、模型—优化等,松耦合高内聚。

支持多端部署。论文研究、移动端、服务器端等全生命周期。

注重开发效率。如自动求导、模型串行化和并行等智能功能。

以开源社区为依托。借助用户力量完善生态体系。

不断实践升级与个性化。成就一个真正强大的框架。

我觉得这是一个非常有难度的事情,首先数学基础得扎实,了解各种算法和数据结构,根据不同的应用方向选择不同的模型,然后就是根据自己的需要训练模型,这中间会耗费大量的人力物力

构建一个现代深度学习框架是一项复杂而庞大的任务,需要深入了解深度学习原理、计算图、自动微分、优化算法等多个领域。大概的步骤就是确定目标,选择合适的模型,设计优化算法,提供应用层入口

如何从零构建一个现代深度学习框架?

从零构建一个现代深度学习框架是一个复杂而艰巨的任务,涉及到多个层面的技术和知识。以下是构建深度学习框架所需经历的步骤和考虑因素:

构建一个现代的深度学习框架需要深入了解深度学习原理、神经网络结构和计算图等概念,同时需要掌握编程语言和计算库的知识。以下是一个从零构建深度学习框架的基本步骤:

确定框架的目标和功能:明确你要构建的深度学习框架的目标和功能。这可以包括支持的神经网络类型、优化算法、计算图构建等方面。

了解深度学习原理:深入学习深度学习的基本原理,包括前向传播、反向传播、损失函数、激活函数等。熟悉各种类型的神经网络,如卷积神经网络(CNN)、循环神经网络(RNN)等。

学习计算图:了解计算图的概念和构建过程。计算图是深度学习中用于描述神经网络结构和计算过程的图形模型。

选择编程语言和工具:选择一种适合深度学习框架开发的编程语言,如Python。熟悉相关的编程库和工具,如NumPy、TensorFlow或PyTorch等。

实现底层数据结构:构建深度学习框架的基本数据结构,如张量(Tensor)和计算图节点。张量是深度学习中的核心数据结构,用于存储和操作数据。

实现前向传播:根据选择的神经网络类型,实现前向传播算法。这涉及将神经网络的层结构连接起来,并编写相应的计算代码。

实现反向传播:实现反向传播算法以计算梯度。反向传播是训练神经网络的核心算法,通过计算损失函数相对于网络参数的梯度来更新参数。

实现优化算法:选择并实现梯度下降的优化算法,如随机梯度下降(SGD)或Adam等。优化算法用于更新网络参数以最小化损失函数。

添加其他功能:根据你的框架目标,可以添加其他功能,如批量归一化(Batch Normalization)、正则化、自定义损失函数等。

进行测试和性能优化:编写测试用例来验证框架的正确性,并进行性能优化以提高计算效率和训练速度。

请注意,构建一个现代的深度学习框架是一项复杂的任务,需要深入的知识和大量的工作。在实际应用中,通常建议使用已有的成熟深度学习框架,如TensorFlow、PyTorch或Keras等。这些框架已经经过广泛测试和优化,并提供了丰富的功能和工具,支持更高效的深度学习开发。

1.定义架构

构建深度学习模型的第一步,也是最重要的一步就是成功定义网络和架构。根据所执行任务的类型,一般倾向于使用特定类型的体系结构。

在此步骤中,还可以决定整个深度学习架构的模型构建结构类型。执行此操作的三个主要步骤是顺序模型(Sequential Models)、功能性API或用户定义的自定义架构。

2.编译模型

首选架构构建完成后,将继续进行构建模型的第二个步骤——编译模型。编译步骤通常是TensorFlow深度学习框架中的一行代码,可以采用model.compile函数进行编译。

在深度学习中,编译的要求是配置模型,以便成功完成拟合/训练过程。正是在编译中,为评估程序定义了培训程序的一些关键组成部分。

列举一些必要参数,下一步需要分配损耗、优化器和指标。损耗的种类取决于所遇问题的类型以及亟待解决的问题。优化器通常是指用于计算的adam、RMSprop或类似优化器;指标是指用于分析的准确性度量或任何其他由用户定义的衡量标准。

3.拟合模型

成功定义整体架构并编译模型后,第三个逻辑步骤是在训练数据集上拟合模型。拟合功能可在固定数量的周期(数据集上的迭代)内训练模型。借助拟合功能,可以确定训练周期的数量、输入和输出数据、验证数据等重要参数。拟合功能可用于计算和估算这些基本参数。

在培训过程中,必须持续评估拟合步骤。重要的是要确保所训练的模型在提高准确性和减少整体损失的同时,运行良好。

同样重要的是,要考虑到该模型没有以任何方式被过度拟合。为此,必须使用Tensorboard之类的工具进行持续评估,以分析各种图表,并了解这些模型是否有可能被过度拟合。一旦训练完成并对固定数量的周期进行分析后,就可以继续进行第四个步骤——评估并使用训练好的模型进行预测。

4.评估和预测

评估深度学习模型是检验构建模型是否按预期工作的一个十分重要的步骤。构建的深度学习模型在现实应用程序中可能运行不佳。因此,评估深度学习模型变得至关重要。

评估深度学习模型的一个主要方法是,确保模型对预处理步骤开始时,将分割测试数据所做的预测考虑在内,以验证训练模型的有效性。除测试数据外,还必须用可变数据和随机测试对模型进行测试,以查看其在未经训练的数据上的有效性,以及其性能效率是否符合预期要求。

5.部署模型

部署阶段是构建任何模型的最后一步。一旦成功完成模型构建后,如果想要保留模型或进行部署,以面向更广泛的受众,这便是一个可选的步骤。部署方法各不相同,可以将其部署为跨平台传输的应用程序,也可以使用amazon提供的AWS云平台进行部署,或者使用嵌入式系统部署。

如果想要部署监控摄像头之类的东西,则可以考虑使用类似树莓派的嵌入式设备与摄像头模块共同执行此功能。带有人工智能的嵌入式系统是部署物联网项目的常用方法。

使用flask、Django或任何其他类似框架构建深度学习模型后,也可以选择在网站上部署这些深度学习模型。另一个有效部署模型的方法是为智能手机用户开发一个android或iOS应用程序,以覆盖更广泛的用户。

构建任何深度学习模型都需遵循这些步骤,至少包含前述五个中的四个。对于新手或初级项目而言,部署步骤是可选步骤,但在相关行业和公司中,该步骤却是极其重要,不可或缺。

需要格外注意的是,在构建和使用深度学习模型前,必须考虑数据预处理、探索性数据分析以及其他强制性清理步骤。模型的构建步骤必须在完成所有数据的预处理后才可以执行。

从零构建一个现代深度学习框架涉及以下关键步骤:首先,明确框架的目标和需求。其次,掌握深度学习的理论基础。然后,选择合适的编程语言和工具。接着,设计框架的结构和API。之后,实现基本的数学运算和自动微分机制。紧接着,添加支持不同神经网络的层和优化器。再处理数据,实现模型的训练和验证。之后,优化性能并编写详尽的文档。最后,建立社区并根据反馈不断完善框架。

如何从零构建一个现代深度学习框架?

构建深度学习框架涉及理解深度学习原理(如神经网络、反向传播),设计框架结构(数据处理、模型定义等),实现自动微分,构建基本神经网络层,优化器,模型的保存与加载,以及并行和分布式训练。还需实现模型推理与部署,以及不断扩展如更多层、优化器和硬件支持。

如何从零构建一个现代深度学习框架?

构建现代深度学习框架涉及理解基础概念、设计框架结构、实现关键组件(如层、模型、损失函数和优化器),核心是建立自动求导机制。还包括数据管理、模型训练与评估、性能优化、部署与扩展性考虑,以及提供API接口。

如何从零构建一个现代深度学习框架?

构建现代深度学习框架涉及理解深度学习原理,掌握Python及NumPy,设计框架结构包括数据处理、模型定义、训练和推理模块。实现功能如数据处理、模型定义、训练与推理,添加GPU加速、自动求导等优化,通过测试验证正确性。此外,编写文档并发布。

如何从零构建一个现代深度学习框架?

构建现代深度学习框架涉及理解神经网络原理,如前向传播和反向传播,以及不同网络结构(CNN、RNN、LSTM、Transformer)。设计框架架构,包括数据加载、模型定义、训练和推理模块,以及模块间接口。实现核心组件,如张量操作、自动微分和优化器。支持神经网络层和高层API,设计训练循环,包含分布式训练。实现推理功能,提供部署工具。持续优化性能,扩展功能,进行测试和维护,并根据用户反馈和新技术发展迭代更新。这是一个长期、复杂且需持续关注最新技术趋势的过程。

如何从零构建一个现代深度学习框架?

构建一个现代深度学习框架是一项复杂而庞大的任务,需要深入理解深度学习的原理、算法和技术,并具备扎实的编程和软件工程能力。

理解深度学习原理:深度学习是建立在神经网络模型上的机器学习方法。

设计框架结构:典型的深度学习框架包括图计算引擎、自动求导、模型层、数据处理和工具库等模块。需要决定如何组织这些模块之间的交互。

自动求导:需要实现反向传播算法,计算梯度并更新模型参数。

添加数据处理功能:深度学习模型通常需要大量的数据进行训练。

一、遇到的问题 创建应用需改参数并重启集群 修改 wal_level、polar_max_super_conns 会触发集群重启,高峰期操作有风险,新手容易踩坑。 网络配置略繁琐 应用默认不能访问外网,必须手动配 NAT 网关 + SNAT;应用白名单和集群白名单独立,要重复配置。 控制台入口较深 Dashboard 账号密码藏在配置页里,不好找;创建应用等待 3–5 分钟无进度提示。 Qo...

作为服务华为的运营工程师,使用 ODPS 两年,深刻体会其在通信设备运维场景的支撑力。华为基站设备日志日均增量超 TB 级,供应链数据跨 12 个区域节点,ODPS 的湖仓一体架构让分散数据实现统一调度,这是保障 5G 基站稳定运行的关键。 AI 爆发倒逼运维模式升级。过去设备故障分析依赖 T+1 报表,如今需实时预判潜在风险,这要求 ODPS 跳出传统计算框架。 ODPS 有引领数据革命的...

🎁嘿,大家好!👋 ,今天跟大家聊聊AI技术如何助力短剧领域的创新发展。随着AI技术的飞速发展,短剧创作迎来了前所未有的变革。这不仅仅是技术的进步,更是创意和效率的双重提升。🚀 AI助力短剧领域的创新 智能编剧辅助 创意生成:AI可以基于大数据分析,生成多种剧情梗概和创意点子。这对于编剧来说,就像是一个无穷无尽的创意宝库,可以激发更多的灵感。💡 剧本优化:AI还可以帮助编剧优化剧本,检...

P人出游,你是否需要一个懂你更懂规划的AI导游呢? LLaMA Factory是一款低代码大模型微调框架,集成了百余种开源大模型的高效微调能力,使您无需深入理解复杂算法即可轻松进行模型微调。阿里云的人工智能平台PAI提供一站式机器学习服务,覆盖从数据预处理到预测的全流程,并支持多种深度学习框架与自动化建模,大幅降低了使用难度。通过结合PAI与LLaMA Factory,用户能够充分发挥二者优...

嘿,大家好!👋 今天跟大家分享一些关于开发者的“100件小事”。作为一名程序员,我亲身经历了很多有趣和难忘的事情。下面就来聊聊我体会最深的几件小事吧!😎 开发者的强迫症 代码格式:每次写完代码,我总会不自觉地检查缩进、空格和括号的位置,确保代码整洁美观。有时候,一行代码的格式不对,我就会觉得整个项目都不完美。🛠️ 命名规范:变量和函数的命名一定要有意义,不能随便用a、b、c这样的名字。...