Qwen3:小而强,思深,行速

Qwen3(千问3)于北京时间4月29日凌晨发布,是Qwen系列大型语言模型的最新成员,具备全系列、开源最强、混合推理等特性。它包括两款MoE模型(Qwen3-235B-A22B和Qwen3-30B-A3B)及六个Dense模型,支持119种语言。Qwen3在代码、数学和通用能力测试中超越行业顶尖模型,如DeepSeek-R1和Grok-3。其旗舰版Qwen3-235B-A22B仅需4张H20即可本地部署,成本为DeepSeek-R1的35%。此外,Qwen3原生支持思考模式与非思考模式切换,降低复杂任务门槛,并支持MCP协议优化Agent架构。

全新开源通义千问Qwen3,它来了!

Qwen3是通义千问系列的最新模型,融合推理与非推理模式,兼具QwQ和Instruct模型能力。提供多种尺寸,包括235B-A22B、30B-A3B及六个Dense模型,大幅提升数学、代码、逻辑推理和对话能力,达到业界领先水平。旗舰模型Qwen3-235B-A22B在多场景测试中表现优异,小型模型如Qwen3-4B性能媲美大模型。用户可在阿里云百炼平台免费体验各100万Token。

阿里云百炼Qwen3.7-Max简介:能力、优势、支持订阅计划参考

Qwen3.7-Max是阿里云百炼面向智能体时代推出的新一代旗舰模型,对标GPT-5.5、Claude Opus 4.7等闭源旗舰。该模型支持百万级token上下文窗口,具备顶级推理能力、多模态搜索与视觉理解增强、流式输出低延迟响应等核心优势,覆盖编程、办公、长周期自主执行等复杂场景。同时支持OpenAI接口兼容,便于系统快速迁移。用户可通过Token Plan团队或节省计划等订阅方式灵活调用,适合企业级高要求场景使用。

2026年智能体(Agent)怎么学?从入门到实战的全景避坑指南

2026年,AI进入“智能体元年”。本文系统解析智能体四大核心架构与Agentic Workflow设计模式,涵盖开发者、产品经理到业务人员的实战路径,助力把握AI代理红利期,实现从工具应用到架构创新的跃迁。

【完全免费】VS Code 最好用的 12 款 AI 代码提示插件!!!

🎉 探索12款免费VSCode AI代码提示插件:Codeium、Codegeex、CodeFuse、TONGYI Lingma、Comate、iFlyCode、Fitten Code、Bito AI、Mintlify Doc Writer、Kodezi AI、aiXcoder、IntelliCode。这些插件提供智能补全、代码生成、注释、优化,支持多种语言,提升编程效率!🚀👩💻👨💻

阿里云百炼千问Qwen3.7-Max全面解析:核心能力、技术特性与订阅使用全指南

在智能应用与AI智能体飞速发展的2026年,大模型的推理能力、长文本处理、多模态理解以及工具调用能力,已经成为企业开发、科研创作、自动化办公的核心刚需。阿里云百炼正式推出**Qwen3.7-Max**旗舰大模型,作为通义千问系列综合实力最强的版本,直接对标国际主流高端闭源大模型,专为复杂逻辑推理、长周期自主任务、多模态分析、企业级业务场景打造。

Claude Code 快速上手指南(新手友好版)

AI编程工具卷疯啦!Claude Code凭借任务驱动+终端原生的特性,成了开发者的效率搭子。本文从安装、登录、切换国产模型到常用命令,手把手带新手快速上手,全程避坑,30分钟独立用起来。

Claude Code 官方工作原理与使用指南

Claude Code 不是传统代码补全工具,而是 Anthropic 推出的终端 AI 代理,具备代理循环、双驱动架构(模型+工具)、全局项目感知、6 种权限模式等核心能力,本文基于官方文档系统解析其工作原理与高效使用技巧。

阿里云Qwen3.6-27B是什么?阿里云Qwen3.6-27B 解析:稠密架构、百万上下文与企业级部署

阿里云Qwen3.6-27B是通义千问团队推出的一款**270亿参数稠密型多模态大语言模型**,以“小参数、强性能”为核心定位,在编程能力、长文本处理、多模态理解与智能体执行等方面实现突破性表现,是面向开发者与企业的新一代开源旗舰模型。该模型采用Apache 2.0开源协议,支持完全商用、本地部署与二次开发,凭借稠密架构的简洁性、百万级上下文能力与媲美千亿模型的智能体表现,成为当前开源社区的热门选择。以下从技术架构、核心能力、性能表现、部署方式与应用场景等维度,全面解析Qwen3.6-27B的全貌。

阿里云Qwen3.6 MoE大模型全新开源详解:模型特性、ECS/ACS/计算巢部署流程、vLLM配置与代码调用全教程

阿里云Qwen3.6系列是通义千问团队推出的新一代混合专家(MoE)架构大语言模型,凭借稀疏激活、高效推理、多规格覆盖、原生支持智能体与多语言能力,成为企业私有化部署、AI应用开发、智能体构建的理想选择。该系列全面开源,依托阿里云计算巢平台可实现三步一键部署专有版,搭配vLLM推理框架大幅提升吞吐效率,FP8量化版本更让显存占用降低约一半,兼顾顶尖性能与极致成本优势。本文从模型定位、核心优势、规格选型、阿里云计算巢部署流程、API调用代码、环境配置、常见问题全方面展开,为开发者与企业提供完整可落地的实战指南。

MNN × Qwen 实战:离线运行大模型的正确姿势

本期教程带你用MNN+Qwen在手机端部署大模型,从安装MNN Chat体验离线对话,到源码编译、模型转换与推理测试,再到Android/iOS移动端部署全流程实战,并提供精度与性能调优秘籍,助力端侧AI创新挑战赛。

阿里云百炼Qwen3.7-Max简介:智能体时代旗舰模型,面向真实生产力场景,后付费限时5折

阿里云百炼Qwen3.7-Max旗舰模型的能力与优惠参考:该模型参数量超万亿,支持256K超长上下文,采用高效MoE架构,在编程、办公自动化、长周期任务执行等场景表现卓越,当前限时5折(输入6元/百万tokens,输出18元/百万tokens)。用户可通过Token Plan团队版Credits抵扣或按量付费,支持缓存、Batch调用等降本策略,现在开通享后付费限时5折优惠。

大模型应用:大模型与智能体(Agent)的核心差异:从定义到实践全解析.34

本文深入解析大模型(LLM)与智能体(AI Agent)的本质区别:大模型是“智能大脑”,专注语言理解与生成,被动响应、无记忆、无工具调用;智能体是“闭环系统”,以大模型为核心,集成规划、记忆、工具调用与反思能力,可主动执行复杂现实任务。通过概念、流程、实例多维对比,厘清二者在技术定位、能力边界与应用场景上的根本差异。

ollama + qwen2.5-coder + VS Code + Continue 实现本地AI 辅助写代码

本文介绍在Apple M4 MacOS环境下搭建Ollama和qwen2.5-coder模型的过程。首先通过官网或Brew安装Ollama,然后下载qwen2.5-coder模型,可通过终端命令`ollama run qwen2.5-coder`启动模型进行测试。最后,在VS Code中安装Continue插件,并配置qwen2.5-coder模型用于代码开发辅助。

阿里云千问大模型是什么?阿里云千问大模型全解析:核心功能、价格配置与使用方法详解

阿里云千问大模型(Qwen)是阿里巴巴通义实验室自主研发的超大规模语言与多模态模型体系,是阿里云AI生态的核心引擎,覆盖文本生成、代码开发、视觉理解、音频处理、视频创作等全场景能力。从早期的通义千问到最新的Qwen3.6、Qwen3.7系列,千问已形成从开源轻量版到闭源企业级的完整矩阵,支持个人开发者、中小团队与大型企业的全链路AI需求。

Token 到底是什么?搞懂这个“AI 最小货币单位”,省钱又省心

纯干货,用“乐高积木”比喻,3分钟讲透AI核心概念——Token:它是什么、怎么拆、为何影响输入长度、API费用和AI记忆力。附4个实测省钱技巧,助你省30%以上成本,轻松处理长文本。

AgentScope 1.0 全面进化,从原型走向产业落地!

AgentScope全新升级,打造生产级智能体生态:推出开箱即用的Alias、EvoTraders等应用,支持多场景落地;强化基建,实现动态技能扩展、白盒化运行与多语言支持;集成语音交互、数据工程等能力,提供从开发到部署的全链路解决方案。

Docker+vLLM内网离线部署Qwen3 流程

本教程详解如何在A10四卡内网环境中,通过Docker+ vLLM离线部署Qwen3-32B/Qwen3-VL-30B-Instruct大模型。涵盖环境准备、镜像离线导入、模型下载、容器启动及参数调优,支持FP8/KV缓存/张量并行等高性能配置,助力安全高效私有化推理

阿里云Qwen3.7-Max的模型能力、模型表现、适用场景,最新5折起等优惠活动介绍

Qwen3.7-Max是阿里云面向智能体时代的旗舰大模型,在推理、代码生成、多语言理解及长周期自主执行等方面全面升级,已接入百炼平台和MaxCompute等产品,适用于企业办公、电商营销、创意媒体、数据分析等多元场景。当前阿里云推出多重优惠:推理服务后付费限时5折,Token Plan团队版Credits消耗减半等活动,大幅降低用户AI应用落地门槛。

使用 yt-dlp 二次开发, 快速下载 YouTube等平台高清视频工具开发

想从多个平台下载高清无水印视频?本文教你使用 `yt-dlp` 工具轻松实现!支持 YouTube、B站、抖音等主流平台,提供代码示例与解析,涵盖批量下载、字幕提取、音频分离等高级功能。无论你是开发者还是普通用户,都能快速上手,高效获取所需视频资源。

高效部署通义万相Wan2.1:ComfyUI文生/图生视频实战,工作流直取!

通义万相Wan2.1开源不到一周,已登顶HuggingFace Model 和 Space 榜双榜首,在HuggingFace和ModelScope平台的累计下载量突破100万次,社区热度持续攀升!为响应小伙伴们对ComfyUI工作流运行Wan2.1的强烈需求,社区开发者整理了实战教程👇

一个提示词模板,搞定抖音短视频脚本创作

专为技术人打造的抖音脚本提示词模板,结构化拆解短视频创作套路,结合DeepSeek、通义千问等AI工具,快速生成可执行脚本框架,助力技术分享、产品演示高效落地,30秒讲清重点,开头抓人、节奏紧凑、完播率提升。

大模型微调技术综述与详细案例解读

本文是一篇理论与实践结合的综述文章,综合性全面介绍大模型微调技术。本文先介绍大模型训练的两类场景:预训练和后训练,了解业界常见的模型训练方法。在后训练介绍内容中,引出模型微调(模型微调是属于后训练的一种)。然后,通过介绍业界常见的模型微调方法,以及通过模型微调实操案例的参数优化、微调过程介绍、微调日志解读,让读者对模型微调有更加直观的了解。最后,我们详细探讨数据并行训练DDP与模型并行训练MP两类模型并行训练技术,讨论在实际项目中如何选择两类并行训练技术。

阿里百炼千问Qwen3.7-Max功能及定价详解 原价与5折优惠费率完整评测说明

2026年阿里云百炼正式推出旗舰级大模型Qwen3.7-Max,这款产品专为AI智能体场景深度打造,在长周期自主执行、智能编程、办公自动化、多框架兼容适配等方面具备顶尖实力。凭借超强综合能力,Qwen3.7-Max在全球权威Arena大模型盲测评测榜单中稳居国产模型首位,综合实力超越同期多款主流大模型,包括Kimi-K2.6、DeepSeek-v4-pro、GLM-5.1等知名竞品,成为企业、开发者搭建AI应用、智能体服务的首选旗舰模型。

阿里云千问Qwen3.7-Max深度实测 智能体能力升级与成本优惠全解析

在AI智能体快速普及的当下,企业与开发者对于大模型的需求早已跳出简单对话、文案生成的基础范畴,更多聚焦于长周期任务自主执行、复杂代码工程处理、办公流程自动化等高阶场景。但长期以来,高端旗舰模型调用成本居高不下,成为众多团队规模化落地AI应用的最大阻碍。

vLLM 架构学习指南

本指南深入解析vLLM高性能推理引擎架构,涵盖核心创新PagedAttention与连续批处理技术,结合代码结构、学习路径与实践建议,系统指导用户从入门到贡献源码的全过程。

淘宝 API 接口是什么?2026 最新接口文档及接入方法

淘宝API是淘宝官方开放的安全数据通道,支持商品管理、订单处理、物流同步、营销推广等200+自动化能力。本文详解2026最新接入流程、权限申请、签名规则、常用接口及Python调用示例,新手也能零基础快速上手。(239字)

阿里云Qwen3.6全新开源,三步完成专有版部署!

Qwen3.6是阿里云全新MoE架构大模型系列,稀疏激活显著降低推理成本,兼顾顶尖性能与高性价比;支持多规格、FP8量化、原生Agent及100+语言,开箱即用。

阿里云百炼Qwen3.7-Max 详解:核心能力、技术优势与订阅计划全解析

2026年,AI技术已全面进入智能体时代,大模型不再局限于基础对话与信息检索,而是朝着自主执行复杂任务、长周期持续推理、多工具协同协作的方向深度演进。阿里云百炼平台于近期正式推出通义千问系列最新旗舰模型——Qwen3.7-Max,作为通义千问3.7系列中规模最大、综合能力最强的版本,该模型直接对标GPT-5.5、Claude Opus 4.7等国际顶级闭源旗舰,是当前国产大模型中性能标杆级产品。

大模型应用:本地部署 vs 云端调用:成本、隐私、效率、方式的综合考量.60

本文深入对比大模型本地部署与云端调用:前者数据自主、隐私强、长期成本低,但需高性能硬件和运维能力;后者开箱即用、免维护、算力弹性,但存在隐私风险与持续费用。结合成本、隐私、效率三维度,提供清晰选型建议及代码示例。

最新版matlab r2025b安装图文教程(附安装包下载)方法

MATLAB R2025b发布:聚焦质量与稳定性提升,优化工具箱性能,修复R2025a已知Bug,增强可靠性。安装包已整合,可前往xu5软件库(www.xu5.cc)一键下载,附详细图文安装及激活教程。

阿里云百炼Qwen3.7-Max全面解读 核心能力、产品优势与订阅计划详解

人工智能产业持续高速发展,各行各业对于大语言模型的综合能力、推理精度、运行稳定性以及使用成本都提出了更高要求。作为国内自主研发大模型的代表,阿里云通义千问系列不断迭代升级,Qwen3.7-Max作为该系列定位最高的旗舰版本,依托阿里云百炼大模型平台正式面向市场推出。这款模型集合了多年技术积累与算法优化成果,在逻辑推理、内容创作、长文本处理、多模态交互、代码开发等多个维度实现能力突破,不仅能够满足个人用户日常使用需求,更可支撑企业复杂业务场景、智能体开发、专业数据分析等高阶应用。

Claude Code 必知的 14 个高效工作流,让你的开发效率提升 300%

掌握 Claude Code 的 14 个高效工作流,覆盖代码理解、开发调试、安全重构、计划模式、自动化测试、PR 创建、文档生成等全流程。从陌生项目快速上手的探索技巧,到子代理委派、思考模式、图像辅助开发等进阶玩法,一文带你解锁 Claude Code 的真正实力,让 AI 从聊天工具变成真正的开发伙伴。

大模型应用:大模型本地化部署与API调用:打包迁移到服务器的多种方式实践.47

本文详解大模型从本地运行到云端API服务的全链路部署:涵盖硬件要求(GPU/CPU/内存)、软件环境(Python/FastAPI/Transformers)、模型选型(Qwen/ChatGLM等),并提供脚本部署、EXE打包(PyInstaller)和Docker容器化三种方案,支持局域网调用与接口文档自动生成,助力零基础用户快速实现“开箱即用”的稳定API服务。

别再让 Claude 乱改代码了!Claude Code 这 7 个权限配置让你的项目再也不翻车

还在为 Claude Code 的混乱操作头疼?本文总结 7 个核心权限配置,从上下文管理、提示技巧到环境配置全覆盖,让你的 AI 编程助手真正听话不翻车。

90% 的人还不知道!Claude Code 藏着的 /goal 命令,能帮你省下 80% 的指挥时间

Claude Code 的 /goal 命令可以一键设定目标,让 AI 全自动多轮迭代直到任务完成。本文详细讲解 /goal 的核心概念、使用方法和最佳实践,帮你省下 80% 的指挥时间。

别再被AI Agent配置折腾了!Hermes Agent 保姆级攻略,10分钟避坑上手

本文从快速配置、核心模块详解、常用示例、问题排查四方面,带你完成Hermes Agent全流程配置。新手用 hermes setup 快速上手,进阶用户可手动编辑 config.yaml 定制记忆、网关、安全等模块。

2026年OpenClaw(养龙虾)+ 钉钉对接:保姆级全链路操作指南

本指南详解2026年OpenClaw(AI智能体)与钉钉深度对接的全链路实践:从环境搭建、钉钉应用配置、OpenClaw本地部署,到中间件开发与内网穿透,实现“钉钉发令—龙虾执行—自动回传”的24小时数字员工闭环。安全、可控、零数据出域。

大模型应用:大模型内存与显存深度解析:我们该如何组合匹配模型与显卡.63

本文深入解析大模型本地部署中内存与显存的核心逻辑,涵盖参数-显存精准计算公式、INT4/FP16等精度占用对比、RTX 4090/5090专属部署代码及多卡分片实践,破除“显存需等于内存”等常见误区,助你科学选型、高效落地。

三分钟让Dify接入Ollama部署的本地大模型!

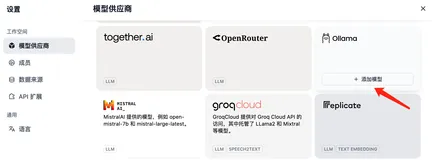

本文详细介绍了如何在 Dify 中接入 Ollama 模型,包括模型添加、参数配置及常见问题解决。通过运行 Ollama 服务并与 qwen2:0.5b 模型交互,实现本地化大模型应用开发。同时提供了 Docker、Mac、Linux 和 Windows 平台上 Ollama 的部署与环境变量设置指南,帮助开发者快速上手。更多实战技巧可访问[编程严选网](http://www.javaedge.cn/)或关注作者的 Github 仓库。

阿里云Qwen Cloud正式发布 面向Agent时代全新云服务全解析

随着AI智能体技术迎来爆发式增长,智能体已经不再是辅助工具,逐步演变成为云服务消费的核心主体。传统云平台以人类用户为中心设计的界面交互、操作逻辑,已经难以适配AI Agent无规律弹性调用、短时任务瞬时启停、自动化流程高频运行的全新需求。面对全球市场AI算力需求持续攀升,智能体带动模型调用量与云资源消耗呈指数级增长的行业现状,阿里云于5月26日在新加坡面向全球市场正式重磅推出Qwen Cloud全新云服务平台。

大模型应用:CLIP 模型全维度解析:理解理论基础强化基础范例.16

CLIP是OpenAI提出的跨模态模型,通过对比学习将图像与文本映射至统一语义空间,实现零样本图文对齐。无需微调即可完成图像分类、图文检索等任务,显著降低标注成本,成为多模态AI的核心基础。

2025年前端框架是该选vue还是react?有了大模型-例如通义灵码辅助编码,就不用纠结了!vue用的多选react,react用的多选vue

本文比较了Vue和React两大前端框架,从状态管理、数据流、依赖注入、组件管理等方面进行了详细对比。当前版本和下载量数据显示React更为流行,但Vue在国内用户量增长迅速。Vue 3通过组合式API提供了更灵活的状态管理和组件逻辑复用,适合中小型项目;React则更适合大型项目和复杂交互逻辑。文章还给出了选型建议,强调了多框架学习的重要性,认为技术问题已不再是选型的关键,熟悉各框架的最佳实践更为重要。

大模型应用:从零构建医疗AI智能体:大模型驱动的医疗辅助系统全流程解析.125

本文系统阐述医疗AI智能体的落地实践:聚焦高敏感、高合规的医疗场景,提出“大模型+专业知识+安全规则”三位一体架构,涵盖需求规划、模型选型、RAG增强、幻觉抑制、五层技术架构及多模态交互设计,强调稳扎稳打、合规优先的工程化路径。

Agent与大模型的区别

本文详细对比了人工智能领域的两个重要概念——Agent和大模型。大模型如GPT-3、BERT等,擅长自然语言处理任务,如文本生成、翻译等;Agent则是自主的软件实体,能够在特定环境中感知、决策并执行任务,如管理日程、控制智能家居等。文章介绍了它们的定义、功能、技术架构及应用场景,并总结了两者的核心差异和未来发展方向。

千问APP来咯!会聊天,能办事,还免费!!

千问APP公测上线!基于全新Qwen3模型,打造全能AI助手,覆盖办公、地图、健康、购物等多场景,免费畅享智能聊天与办事体验。即刻下载,让AI成为你的日常伙伴。