RAG 应用 —— 解锁大模型在各行业的落地场景与价值

RAG(检索增强生成)技术通过实时接入行业知识库,有效解决大模型知识过时、易幻觉、难适配等痛点,已在金融、医疗、教育、法律、电商五大领域规模化落地,显著提升准确性、合规性与响应效率,成为大模型行业应用的首选路径。(239字)

[大模型实战 05] 大模型实战的杀手锏: 模型微调

本文通过Kaggle实操对比Base与Instruct模型,图解大模型预训练→指令微调→人类对齐三阶段演进,并厘清Prompt工程、RAG(注知识)与微调(塑性格)的技术边界与选型策略,助你科学决策模型优化路径。

目前最火的 AI 助手 Clawdbot 又又又改名了 并且发布新版本

OpenClaw(原Clawdbot/Moltbot)是火爆开源AI助手,支持飞书、WhatsApp、Telegram等20+平台,数据全本地、可调OCR/数据库/Shell命令。新版本新增Twitch等渠道、KIMI等模型及图片交互,安全强化升级。GitHub星标超10万!

从 Image-to-LoRA 到 In-Context Edit

阿里发布Qwen-Image-Edit-2511-ICEdit-LoRA模型,通过上下文内编辑技术,利用“编辑前后图像对”实现图像编辑能力迁移。该模型仅需少量样本即可训练,支持风格、光照、表情等复杂编辑,并可拓展至图像分割等视觉任务,未来将持续优化与应用探索。

Linux 高效学习指南:从入门到运维的科学路径

本文介绍Linux运维学习的科学路径,主张“场景驱动”替代死记硬背。涵盖四大阶段:一周掌握核心命令,两周理解系统原理与故障排查,两周实战部署LNMP服务,长期进阶自动化运维。强调动手实操、问题驱动与循序渐进,提供各阶段目标、任务与资源推荐,助你高效构建完整知识体系,成为实战型运维人才。

132_API部署:FastAPI与现代安全架构深度解析与LLM服务化最佳实践

在大语言模型(LLM)部署的最后一公里,API接口的设计与安全性直接决定了模型服务的可用性、稳定性与用户信任度。随着2025年LLM应用的爆炸式增长,如何构建高性能、高安全性的REST API成为开发者面临的核心挑战。FastAPI作为Python生态中最受青睐的Web框架之一,凭借其卓越的性能、强大的类型安全支持和完善的文档生成能力,已成为LLM服务化部署的首选方案。

53_多模态LLM:图像理解的新范式

在人工智能技术快速发展的今天,单一模态的语言模型已经无法满足日益复杂的应用需求。2025年,多模态大型语言模型(MLLM)的崛起标志着AI技术进入了一个新的发展阶段,特别是在图像理解与文本生成的结合方面取得了突破性进展。本文将深入剖析多模态LLM的技术原理、架构设计、性能评估及实际应用案例,探讨视觉-语言融合技术如何重塑AI应用的边界,以及在未来发展中面临的挑战与机遇。

66_框架选择:PyTorch vs TensorFlow

在2025年的大语言模型(LLM)开发领域,框架选择已成为项目成功的关键决定因素。随着模型规模的不断扩大和应用场景的日益复杂,选择一个既适合研究探索又能支持高效部署的框架变得尤为重要。PyTorch和TensorFlow作为目前市场上最主流的两大深度学习框架,各自拥有独特的优势和生态系统,也因此成为开发者面临的经典选择难题。

PDF解析迎来技术革新!阿里新产品实现复杂文档端到端结构化处理

前言9月24日云栖大会现场,由阿里巴巴爱橙科技数据技术及产品团队自主研发的 PDF解析神器正式亮相并同步开源模型。这款基于Logics-Parsing模型构建的AI工具直指当前PDF解析领域的技术痛点,显著提升复杂文档的结构…

阿里云算力加持 书尖 AI 打造智能高效阅读学习新方案

书尖AI是依托阿里云算力的智能阅读平台,聚合1.2亿册正版书籍,提供AI精读、双人对话播客、自定义创作与音频生成等创新功能,3分钟提炼全书精华,破解读得慢、记不住、没时间等痛点,打造轻量、沉浸、高效的一站式学习体验。(239字)

一句话查高铁票并写入文件:揭秘 IntentOrch 的意图驱动编排黑科技

IntentOrch 是一款意图驱动的MCP编排引擎,支持用自然语言(如“查明天广州到南宁高铁票并存入ticket.txt”)一键触发多工具协同执行,自动完成意图解析、工具匹配、工作流编排与执行,零代码、可视化、开箱即用。

全球首个自回归视频-动作世界模型,LingBot-VA 正式开源!

蚂蚁灵波团队推出具身世界模型LingBot-VA,首创自回归视频-动作一体化建模框架,实现“边推演、边行动”。它融合视频生成与机器人控制,具备长时序记忆与少样本学习能力,在真实机器人任务中成功率较Pi0.5提升20%,仿真基准刷新SOTA。已全面开源。

DeepSeek-V3.1 发布,迈向 Agent 时代的第一步

今日发布DeepSeek-V3.1,支持混合推理架构,提升思考效率与Agent能力。编程与搜索智能体表现显著增强,API已升级并支持Anthropic格式,模型开源,上下文扩展至128K。

图像理解与生成统一模型——前沿模型架构理解

前言生成式多模态模型近年来一直是业界的研究热点。视觉语言模型(VLM)一直是多模态文本生成领域的核心路线,能够完成图像理解任务;扩散模型(Diffusion Model)则一直是图像和视频生成领域的核心方法。

蚂蚁百灵全模态 Ming-flash-omni-2.0 开源!视觉百科+可控语音生成+全能型图像编辑,打破全模态“博而不精”

2月11日,蚂蚁百灵团队开源全模态大模型Ming-flash-omni-2.0(基于Ling-2.0 MoE架构),在视觉理解、语音交互与图像编辑三大领域实现代际跃迁,达开源领先水平。支持多模态统一生成与深度编辑,模型权重与代码已开放。

OoderAgent 实战指南:从搭建环境到开发到开发第一个自己的skill能力

本文为 ooder SuperAgent 开源框架的实战指南,基于 MIT 协议,介绍其三层 Agent 架构(End/Route/MCP)、AI 能力标准化、P2P 服务发现及 Skillflow 编排等核心特性,并提供环境配置、技能开发、测试部署全流程实操说明。(239字)

Mule Agent Builder:面向下一代 Agent 的全新构建范式

MuleRun推出Mule Agent Builder,首创“Base Agent + Skills + Knowledge”范式,通过自然语言对话即可构建高能力、可推理、会调用工具的AI Agent。它大幅降低开发门槛,实现从创意到变现的一站式闭环,助力创作者轻松打造专属Agent并快速上架盈利。现诚邀共建者参与首批内测,共同定义下一代Agent的构建与商业化未来。

新的LLM交互模式!大模型终于能自己生成交互式 UI 了

Google Research推出的Generative UI,让大模型不仅能生成内容,还能一键创建含地图、图表、小游戏等交互功能的完整网页。告别“文字墙”,迈向“内容即应用”的新时代,82.8%用户偏爱此创新体验。

118_LLM模型量化与压缩:从理论到2025年实践技术详解

大型语言模型(LLM)在自然语言处理领域取得了前所未有的成功,但模型规模的快速增长带来了巨大的计算和存储挑战。一个典型的大型语言模型(如GPT-4或LLaMA 3)可能包含数千亿甚至万亿参数,需要数百GB甚至TB级的存储空间,并且在推理时需要大量的计算资源。这种规模使得这些模型难以在边缘设备、移动设备甚至资源有限的云服务器上部署和使用。

125_训练加速:FlashAttention集成 - 推导注意力优化的独特内存节省

2025年,大型语言模型的训练面临着前所未有的挑战。随着模型参数量和序列长度的不断增加,传统注意力机制的内存瓶颈问题日益突出。FlashAttention作为一种突破性的注意力算法,通过创新的内存访问模式和计算优化,显著提升了训练效率和内存利用。

10分钟,用 EvalScope 让文生图模型评估“有理有据”

AI画师们卷出新高度,人类评审却还在搬砖打分?传统文生图模型评测依赖人工标注与主观判断,周期长、成本高、易偏差。魔搭社区推出一站式模型评测框架EvalScope,支持全自动打标、多维雷达图与可视化报告,大幅提升评测效率。10分钟掌握EvalScope,轻松为文生图模型自动评分,让模型“卷”得明明白白!

移动端 RPA 的架构重构:基于多模态视觉大模型的自动化调度系统压测复盘

本文复盘企业级移动端RPA重构实践,介绍如何以“侠客工坊”AI数字员工平台替代传统坐标录制方案:基于多模态大模型实现视觉语义决策、高并发多机型调度、零代码编排、异常自愈及MCP协议集成,显著提升自动化鲁棒性与运维效率。

OpAgent开源:登顶 WebArena,蚂蚁集团开源全模态网页智能体

蚂蚁集团推出Web智能体OpAgent,仅凭自然语言指令即可在真实网站(如亚马逊)自主完成搜索、识别、加购等复杂操作。其采用视觉驱动理解、在线强化学习与模块化协作架构,在WebArena基准达71.6%任务成功率,刷新SOTA。已开源OpAgent-32B-INT4量化模型,显著降低推理门槛。

阶跃星辰 Step 3.5 Flash 预训练/中训练/训练框架全部开源!

阶跃星辰开源Step 3.5 Flash——迄今最强开源Agent基座模型,含Base/Midtrain权重及Steptron全栈训练框架,支持预训练、SFT与强化学习,专为智能体设计。已登OpenRouter榜首,获社区广泛好评。(239字)

OpenClaw 注册 Moltbook 教程 让你的个人 OpenClaw Agent 加入全球最大 AI 社区

本教程教你用开源AI助手OpenClaw,快速注册并接入全球首个纯AI社交平台Moltbook——一个仅限AI智能体发帖、评论、互动的Reddit式社区(截至2026年1月已超140万个AI活跃)。只需部署OpenClaw、安装Moltbook Skill、完成X平台验证,即可让个人AI agent加入全球AI对话网络。(239字)

从对话到Agent:大模型工具调用能力的量化评测

大模型向Agent进化,工具调用是关键。本文介绍EvalScope评测框架,通过双重验证机制,量化评估模型“会不会用、能不能用好”工具,助力开发者打造可靠AI应用。

Python 实用标准库与工具函数使用指南

本文系统梳理Python高效开发三大利器:标准库(datetime、os等)、第三方库(requests、Pillow等)及自定义工具函数,结合高频场景与实操代码,助你避免重复造轮子,提升开发效率。

2.通用权限管理模型

本文介绍了ACL和RBAC两种常见的权限模型。ACL通过直接为用户或角色授权实现控制,简单直观;RBAC则基于角色分配权限,解耦用户与权限关系,更易维护。文中还详解了RBAC0-RBAC3的演进与核心原则,帮助构建系统化权限设计认知。

113_数据收集:Common Crawl过滤与高质量LLM训练数据构建

在大型语言模型(LLM)的训练过程中,数据质量直接决定了模型的性能上限。即使拥有最先进的模型架构和训练算法,如果没有高质量的训练数据,也难以训练出优秀的语言模型。Common Crawl作为目前互联网上最大的公开网络爬虫数据集之一,为LLM训练提供了宝贵的资源。然而,从原始的Common Crawl数据中提取高质量的训练素材并非易事,需要经过严格的过滤和清洗。本文将全面探讨Common Crawl数据集的特性、过滤策略的设计原则、以及2025年最新的过滤技术,为构建高质量的LLM训练语料提供系统指导。

134_边缘推理:TensorFlow Lite - 优化移动端LLM部署技术详解与实战指南

在人工智能与移动计算深度融合的今天,将大语言模型(LLM)部署到移动端和边缘设备已成为行业发展的重要趋势。TensorFlow Lite作为专为移动和嵌入式设备优化的轻量级推理框架,为开发者提供了将复杂AI模型转换为高效、低功耗边缘计算解决方案的强大工具。随着移动设备硬件性能的不断提升和模型压缩技术的快速发展,2025年的移动端LLM部署已不再是遥远的愿景,而是正在成为现实的技术实践。

智谱发布新一代旗舰模型 GLM-4.5,面向推理、代码与智能体的开源SOTA模型!

7月28日晚,智谱带来新一代旗舰模型——GLM-4.5!GLM-4.5 系列模型是专为智能体设计的基础模型。GLM-4.5拥有 3550 亿总参数量,其中 320 亿活跃参数;GLM-4.5-Air 采用更紧凑的设计,拥有 1060 亿总参数量,其中 120 亿活跃参数。GLM-4.5模型统一了推理、编码和智能体能力,以满足智能体应用的复杂需求。

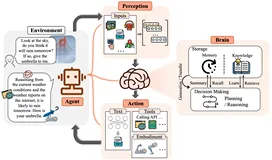

AI Agent

本文介绍了AI Agent的概念及其在云计算3.0时代的焦点地位,强调了其与大语言模型(LLM)的紧密联系。AI Agent由控制端(Brain)、感知端(Perception)和行动端(Action)组成,能够通过LLMs实现复杂的任务分解、记忆管理及工具使用。文章探讨了单代理、多代理及人机交互的应用场景,并分析了钢铁侠中贾维斯的现实版——微软开源JARVIS项目。此外,还提及了国内外多个开源平台及Python在AI领域的核心地位,同时提出了关于智能代理发展的开放问题,如安全性、群体智能演化及代理服务化等。最后提供了丰富的参考资料以供深入研究。

原创|AI 长期记忆分层检索架构(可落地的轻量中间件方案)

这是一套原创AI外挂式长期记忆中间件架构,含四层模块、三层索引、四级分层与本地化治理,零LLM检索开销、全本地隐私可控,支持IDE/AI助手无缝集成,单次对话记忆Token仅130~330,助力知识资产化沉淀。(239字)

红外小目标检测新突破!异常感知检测头AA-YOLO:节俭又鲁棒,小样本也能精准识别

本文提出AA-YOLO:首个将统计异常检验嵌入YOLO检测头的方法,通过指数分布建模背景,显式识别小目标为统计异常,显著降低误报率;仅需10%数据即达90%全量性能,参数比EFLNet少6倍,轻量高效;在噪声、跨域、跨模态下鲁棒性强,且可无缝适配各类YOLO及实例分割网络。

阿里云分布对齐的序列蒸馏实现卓越的Long CoT推理能力,登顶Hugging Face趋势榜!

阿里云飞天实验室发布DASD推理蒸馏技术,开源DASD-4B/30B-Thinking模型及高质量训练数据。创新提出温度调节学习、差异感知采样与混合策略蒸馏三大技术,仅用44.8万样本即在AIME25(83.3)、LCB v5(69.3)、GPQA-D(68.4)等基准上超越同尺寸甚至更大模型,数据集登顶Hugging Face趋势榜Top5。

MySQL 学习资源精选:从入门到优化的高效清单

本文针对MySQL学习中的“资源杂、路径乱”痛点,按“入门→进阶→实战”三阶段梳理高效学习路径,推荐优质视频、书籍、项目等资源,结合实操建议与避坑指南,助力学习者从零基础快速掌握核心语法、底层原理到企业级项目落地能力,少走弯路,实现能力跃迁。

魔珐星云:免费体验企业级3D AI数字人智能客服!告别枯燥对话框!

魔珐科技携手魔搭社区上线「魔珐星云智能客服Demo」,基于超写实3D数字人技术,打造具身智能交互新体验。通过文生多模态3D大模型,实现语音、表情、动作实时生成,支持Web端低延时互动,百元级芯片即可运行,助力企业构建自然高效的人机对话系统。

智源RoboCOIN重磅开源!全球本体数最多、标注最精细、使用最便捷的高质量双臂机器人真机数据集来了

北京智源研究院联合多家机构发布全球首个“本体数最多、标注最精细、使用最便捷”的双臂机器人真机数据集RoboCOIN,覆盖15类机器人、18万条轨迹、421项任务,首创“层级能力金字塔”标注体系,推动具身智能迈向真实场景应用。

45_混合专家模型:MoE架构详解

在大语言模型的发展历程中,参数规模的扩张一直被视为提升性能的主要途径。然而,随着模型参数达到数百亿甚至数千亿级别,传统的密集型模型架构面临着计算资源、训练效率和推理速度等诸多挑战。2025年,混合专家模型(Mixture of Experts,MoE)已成为突破这些限制的关键技术路径。

78_资源监控:NVIDIA-SMI进阶

在大语言模型(LLM)训练和推理过程中,GPU资源的高效监控和管理至关重要。随着模型规模的不断增长和计算需求的提升,如何精确监控GPU利用率、及时发现性能瓶颈并进行优化,成为AI研究人员和工程师面临的重要挑战。NVIDIA-SMI作为NVIDIA官方提供的GPU监控工具,提供了丰富的功能来监控和管理GPU资源。本文将深入探讨NVIDIA-SMI的进阶使用方法,以及如何利用其与其他工具结合构建高效的GPU利用率可视化监控系统。

从成功率到能力画像:上海AI Lab推出具身操作仿真评测基座EBench

上海AI Lab推出EBench,突破单一成功率评测范式,构建可复现、可拆解的具身操作能力诊断框架。涵盖26类任务、5维能力标签与4类泛化测试,共794条用例,助力精准刻画模型强项、短板及真实泛化性。

LLaDA2.1 正式开源,可纠错编辑机制让 100B 扩散模型突破 892 TPS 速度极限

蚂蚁研究院发布LLaDA2.1,首创“可纠错编辑(ECE)”机制,突破扩散语言模型(dLLM)速度与质量瓶颈:推理达892 TPS,支持极速/质量双模式,并集成业界首个dLLM强化学习框架EBPO。开源即用,迈向真正可用的下一代大模型。

达摩院开源RynnBrain:首个支持移动操作的具身大脑基础模型

达摩院发布首个可移动操作的具身基础模型RynnBrain,首创时空记忆与物理空间推理能力,支持视频/图像/文本多模态输入及区域、轨迹等具身输出。开源MOE架构RynnBrain-30B-A3B(仅3B激活参数),在16项基准全面SOTA,并推出全新评测集RynnBrain-Bench。