问题一:有没有遇到flink cdc Oracle number 字段报错?咋解决呢?

有没有遇到flink cdc Oracle number 字段报错?咋解决呢?

参考回答:

在Flink CDC中,如果遇到Oracle number字段报错,可能的原因有以下几点:

- Oracle的number类型与Flink CDC不兼容。Oracle的number类型是固定长度的,而Flink CDC需要处理变长的数字类型。可以尝试将Oracle的number类型转换为Flink CDC支持的变长数字类型,例如decimal或bigdecimal。

- Flink CDC版本与Oracle数据库版本不兼容。确保Flink CDC和Oracle数据库的版本匹配,并且已经安装了相应的JDBC驱动。

- Oracle数据库的配置问题。检查Oracle数据库的配置文件(例如tnsnames.ora),确保配置正确,并且可以正常连接到数据库。

- Flink CDC的配置问题。检查Flink CDC的配置文件(例如flink-conf.yaml),确保配置正确,并且可以正常连接到Oracle数据库。

解决方法:

- 如果需要将Oracle的number类型转换为Flink CDC支持的变长数字类型,可以在创建MongoDBSource时,使用

setNumberType()方法设置正确的数字类型。例如:

MongoDBSource<MyRecord> source = new MongoDBSource<>( new DebeziumOracleComponentBuilder() .hostname("localhost") .port(3306) .username("username") .password("password") .databaseList("mydb") .tableList("mytable") .debeziumProperties(props) .numberType(DecimalType.BIG_DECIMAL) // 设置正确的数字类型 .build(), new MongoClientSettings.Builder().build());

- 确保Flink CDC和Oracle数据库的版本匹配,并且已经安装了相应的JDBC驱动。

- 检查Oracle数据库的配置文件(例如tnsnames.ora),确保配置正确,并且可以正常连接到数据库。

- 检查Flink CDC的配置文件(例如flink-conf.yaml),确保配置正确,并且可以正常连接到Oracle数据库。

关于本问题的更多回答可点击原文查看:

https://developer.aliyun.com/ask/574049

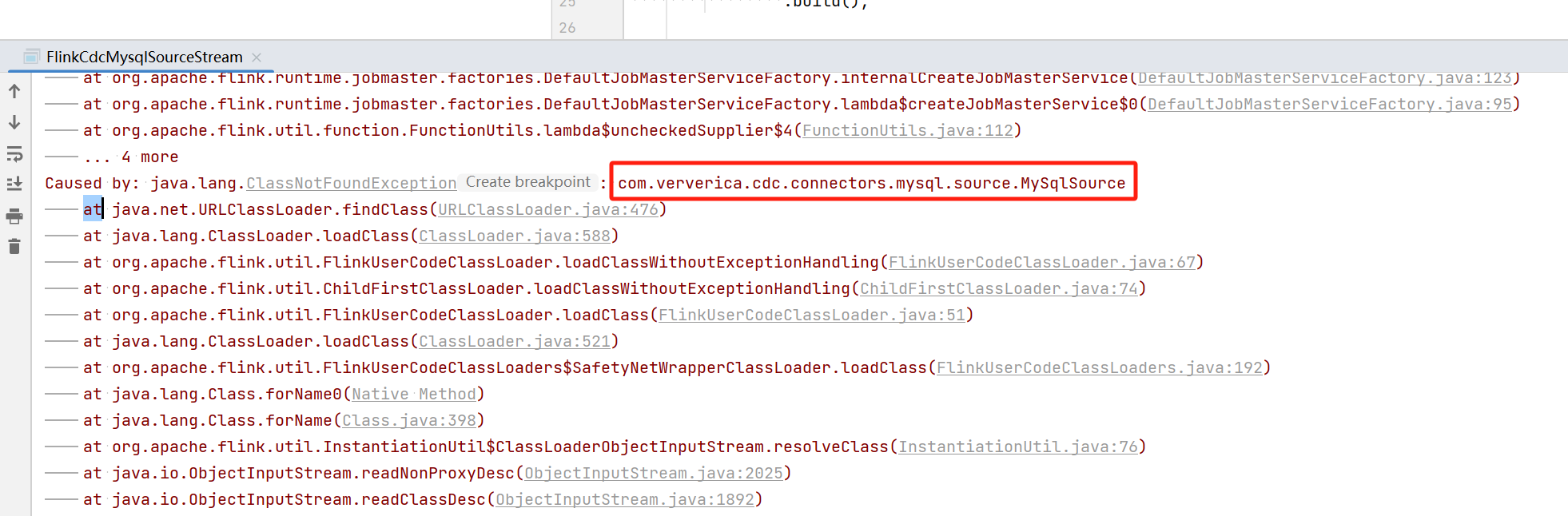

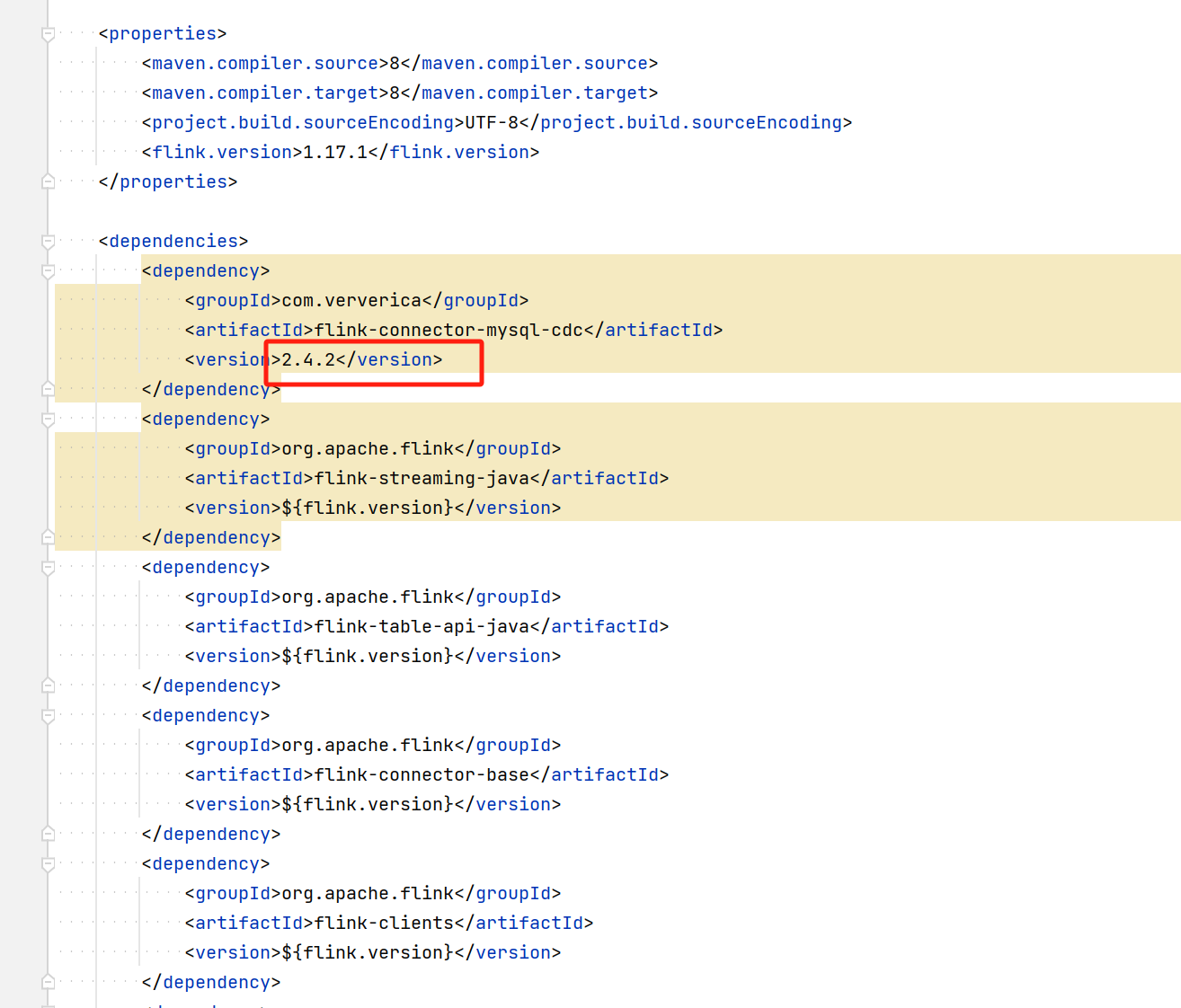

问题二:这个是flink-cdc 2.4引入的。我用的就是这个版本,咋还报这个错误?

这个是flink-cdc 2.4引入的。我用的就是这个版本,咋还报这个错误?

且在这个没问题

StreamExecutionEnvironment env = StreamExecutionEnvironment.getExecutionEnvironment();

连远端就有问题

StreamExecutionEnvironment env = StreamExecutionEnvironment.createRemoteEnvironment("192.168.0.235", 8081);

参考回答:

这个错误可能是由于Flink CDC 2.4版本与您的MySQL连接器版本不兼容导致的。您可以尝试以下方法解决这个问题:

- 确保您使用的MySQL连接器版本与Flink CDC 2.4兼容。您可以查看Flink CDC官方文档,了解支持的MySQL连接器版本。

- 如果问题仍然存在,您可以尝试降级Flink CDC的版本,以找到一个与您的MySQL连接器版本兼容的版本。

- 检查您的项目依赖,确保所有必要的库都已正确添加。如果您使用的是Maven或Gradle,请确保在

pom.xml或build.gradle文件中添加了正确的依赖项。

关于本问题的更多回答可点击原文查看:

https://developer.aliyun.com/ask/574048

问题三:Flink CDC 过期时间是 7天,但是还是报了拉取不到 binlog?

Flink CDC mysql cdc 上游的 polarDB binlog 最新的,过期时间是 7天,但是还是报了拉取不到 binlog?

参考回答:

这个问题可能是由于以下几个原因导致的:

- PolarDB binlog 的过期时间设置不正确。请检查 PolarDB binlog 的过期时间是否设置为7天,如果不是,请修改为正确的值。

- Flink CDC 的配置问题。请检查 Flink CDC 的配置文件,确保上游的 PolarDB binlog 配置正确。

- PolarDB binlog 的数据量过大。如果 PolarDB binlog 的数据量非常大,可能会导致 Flink CDC 无法拉取到最新的 binlog。可以尝试优化 PolarDB binlog 的数据量,或者增加 Flink CDC 的并行度来提高拉取 binlog 的速度。

- PolarDB binlog 的数据格式问题。请检查 PolarDB binlog 的数据格式是否正确,如果数据格式有误,可能会导致 Flink CDC 无法解析 binlog。

- Flink CDC 的版本问题。请检查 Flink CDC 的版本是否与 PolarDB binlog 兼容,如果不兼容,请升级或降级 Flink CDC 的版本。

建议按照以上步骤逐一排查问题,找到问题的根源并进行修复。

关于本问题的更多回答可点击原文查看:

https://developer.aliyun.com/ask/574047

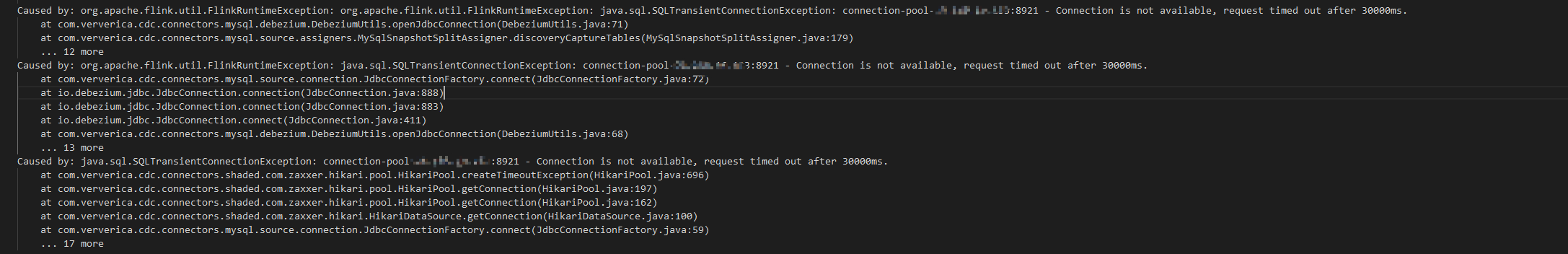

问题四:Flink CDC有使用cdc连mysql数据库遇到这个问题的吗?

Flink CDC有使用cdc连mysql数据库遇到这个问题的吗?异常Connection is not available, request timed out after 30000ms.

参考回答:

这个错误提示“Connection is not available, request timed out after 30000ms”通常出现在数据库连接超时的情况下。这可能是因为数据库服务器没有响应,或者网络连接出现了问题。

以下是一些可能的解决方案:

- 检查数据库服务器的状态:确认数据库服务器正在运行,且能够正常接收请求。

- 检查网络连接:确认客户端和服务器之间的网络连接正常。如果可能,尝试更换网络或者使用不同的网络连接方式。

- 增加连接超时时间:在Flink的配置文件中,可以调整连接超时时间。你可以尝试增加这个超时时间,看看是否能够解决问题。

- 优化数据库性能:如果数据库服务器负载过高,可能会导致连接超时。你可以尝试优化数据库性能,例如通过增加内存、优化查询语句等方式。

- 增加连接池大小:如果可能,你可以尝试增加数据库连接池的大小,以便有更多的连接可供使用。

总的来说,这个错误提示可能是因为数据库连接问题或者网络问题导致的。你需要根据具体情况进行排查,找到问题的根源,然后针对性的进行解决。

关于本问题的更多回答可点击原文查看:

https://developer.aliyun.com/ask/574044

问题五:Flink CDC报这个错怎么解决?

Flink CDC报这个错怎么解决?asynchronous part of checkpoint 16 could not be completed.java.util.concurrent.ExecutionException: java.io.IOException: Size of the state is larger than the maximum permitted memory-backed state. Size=12447708, maxSize=5242880. Consider using a different checkpoint storage, like the FileSystemCheckpointStorage.

参考回答:

这个错误是由于Flink CDC在执行过程中,检查点16的异步部分无法完成。原因是状态的大小超过了允许的最大内存支持大小(5242880字节)。为了解决这个问题,你可以尝试以下方法:

- 增加Flink集群的内存分配。可以通过调整

taskmanager.memory.process.size和taskmanager.memory.fraction参数来增加每个TaskManager的内存分配。例如,将taskmanager.memory.process.size设置为2048m,将taskmanager.memory.fraction设置为0.7。 - 使用不同的检查点存储,如FileSystemCheckpointStorage。在Flink配置文件中,将

state.backend参数设置为fs,并配置相应的文件系统路径。例如:

state.backend: fs state.backend.fs.checkpointdir: hdfs://localhost:9000/flink/checkpoints

- 如果问题仍然存在,可以考虑优化Flink作业的配置,以减少内存使用。例如,减少并行度、减少状态后端的缓冲区大小等。

关于本问题的更多回答可点击原文查看:

https://developer.aliyun.com/ask/574039

问题六:Flink CDC 1.17是版本有问题还是时区有问题,时区我改了很多次,报错还是原状?

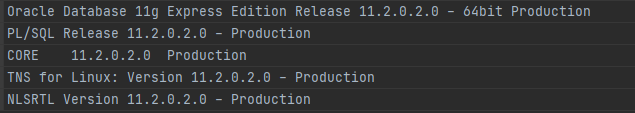

,oracle-cdc2.4.2 oracle是docker拉的oracle11

,我本地跑程序能正常捕获数据,提交到远程flink环境,就报了以下错误

Flink CDC 1.17是版本有问题还是时区有问题,时区我改了很多次,报错还是原状?

参考回答:

这个错误提示看起来像是一个Oracle数据库的错误,而不是Flink或FlinkCDC的问题。这个错误提示"ORA-25745: CDB$ROOT version 11.2 does not match with file format version 19.0"表示你的Oracle数据库的版本(11.2)和你的CDB$ROOT表的版本(19.0)不匹配。

这可能是由于你在不同的环境中使用了不同的Oracle版本,或者是由于你的Oracle数据库升级了,但是你的CDB$ROOT表没有被正确地更新。

解决这个问题的方法是确保你的Oracle数据库的版本和你的CDB$ROOT表的版本一致。你可以尝试重新创建你的CDB$ROOT表,或者升级你的Oracle数据库到正确的版本。

关于本问题的更多回答可点击原文查看: