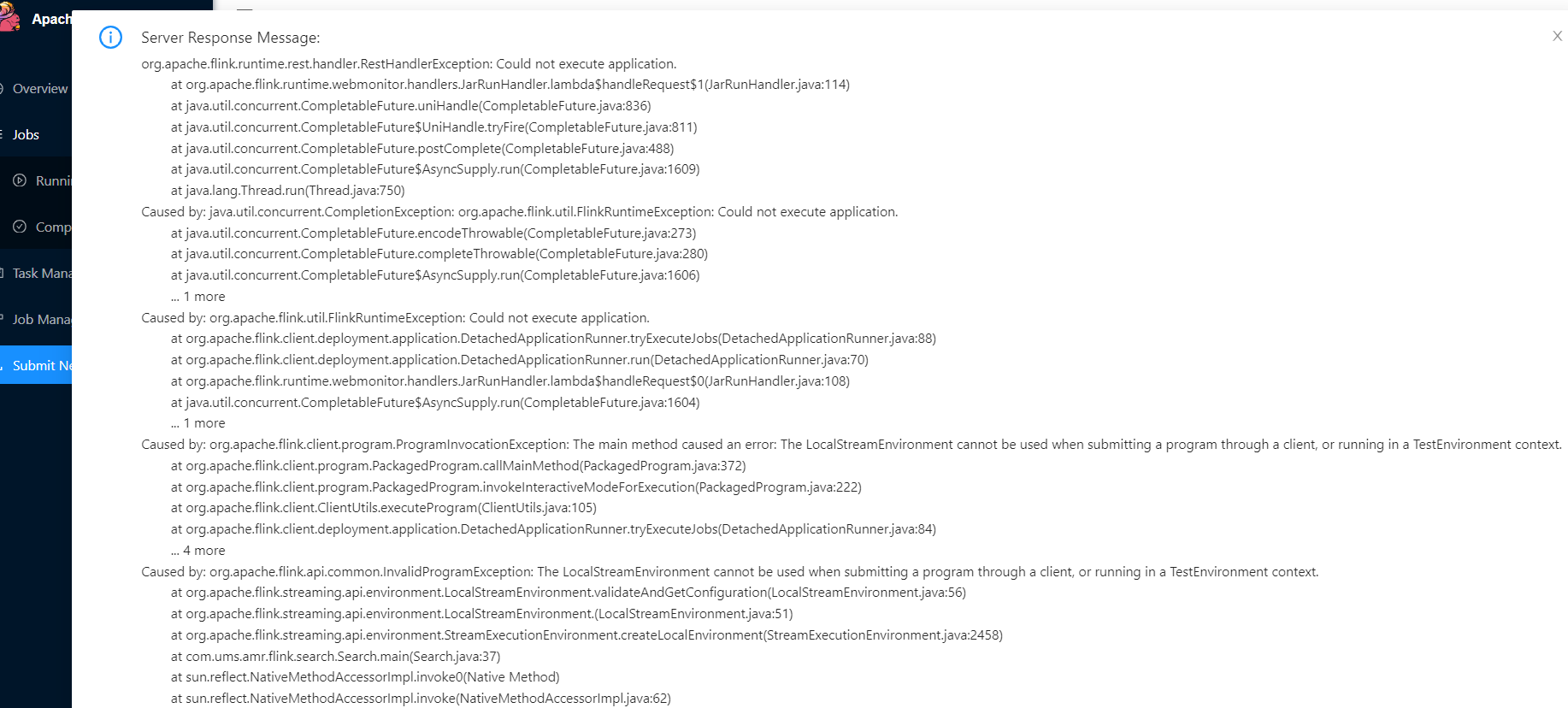

问题一:Flink CDC谁知道这是啥错吗?从页面上传jar包以后提交就报错?

Flink CDC谁知道这是啥错吗?从页面上传jar包以后提交就报错?Caused by: org.apache.flink.api.common.InvalidProgramException: The LocalStreamEnvironment cannot be used when submitting a program through a client, or running in a TestEnvironment context.

参考回答:

这个错误是因为在提交程序时使用了LocalStreamEnvironment,而LocalStream这个错误是因为在提交程序时使用了LocalStreamEnvironment,而LocalStreamEnvironment只能在客户端或TestEnvironment上下文中运行。要解决这个问题,你需要使用RemoteStreamEnvironment来替代LocalStreamEnvironment。

关于本问题的更多回答可点击原文查看:

https://developer.aliyun.com/ask/577455

问题二:Flink CDC源表字段类型为date?

Flink CDC源表字段类型为date?结果表字段类型为TIMESTAMP,使用Flink SQL做转换CAST(date AS TIMESTAMP(6))报错,数据库长度为TIMESTAMP(6)

参考回答:

在Flink SQL中,可以使用CAST函数将date类型转换为TIMESTAMP(6)类型。但是,如果数据库中的DATE类型长度为TIMESTAMP(6),则可能会出现转换错误。为了解决这个问题,可以尝试使用TO_TIMESTAMP函数进行转换,如下所示:

SELECT TO_TIMESTAMP(CAST(date AS VARCHAR), 'yyyy-MM-dd HH:mm:ss') AS timestamp FROM source_table;

这里,我们首先使用CAST函数将date类型转换为VARCHAR类型,然后使用TO_TIMESTAMP函数将其转换为TIMESTAMP(6)类型。请根据实际情况调整日期格式。

关于本问题的更多回答可点击原文查看:

https://developer.aliyun.com/ask/577452

问题三:Flink CDC中mysql cdc 抽取报这个错?

Flink CDC中mysql cdc 抽取报这个错?Caused by: io.debezium.DebeziumException: Failed to deserialize data of EventHeaderV4{timestamp=1701966853000, eventType=TABLE_MAP, serverId=512343306, headerLength=19, dataLength=146, nextPosition=510850789, flags=0}应该是背压的问题 是上游数据库突然产生大量的数据吗?

参考回答:

这个错误可能是由于背压问题导致的。背压是指在数据流处理过程中,上游数据产生的速度大于下游处理速度,导致下游处理系统无法及时处理上游产生的数据。在Flink CDC中,Debezium作为MySQL的CDC连接器,负责从MySQL数据库中抽取数据并转换为Flink可以处理的数据格式。如果上游数据库(如MySQL)突然产生大量的数据,可能会导致Debezium无法及时处理这些数据,从而引发上述错误。

为了解决这个问题,你可以尝试以下方法:

- 检查上游数据库(如MySQL)的性能,确保其能够承受大量数据的处理。如果可能的话,可以考虑优化数据库性能,例如增加内存、优化查询语句等。

- 调整Flink CDC的配置参数,例如增加背压缓冲区的大小、调整任务并行度等,以提高数据处理能力。

- 如果问题仍然存在,可以考虑使用其他CDC工具,如Apache Kafka Connect、Apache Nifi等,来替代Debezium进行数据抽取和转换。

关于本问题的更多回答可点击原文查看:

https://developer.aliyun.com/ask/577448

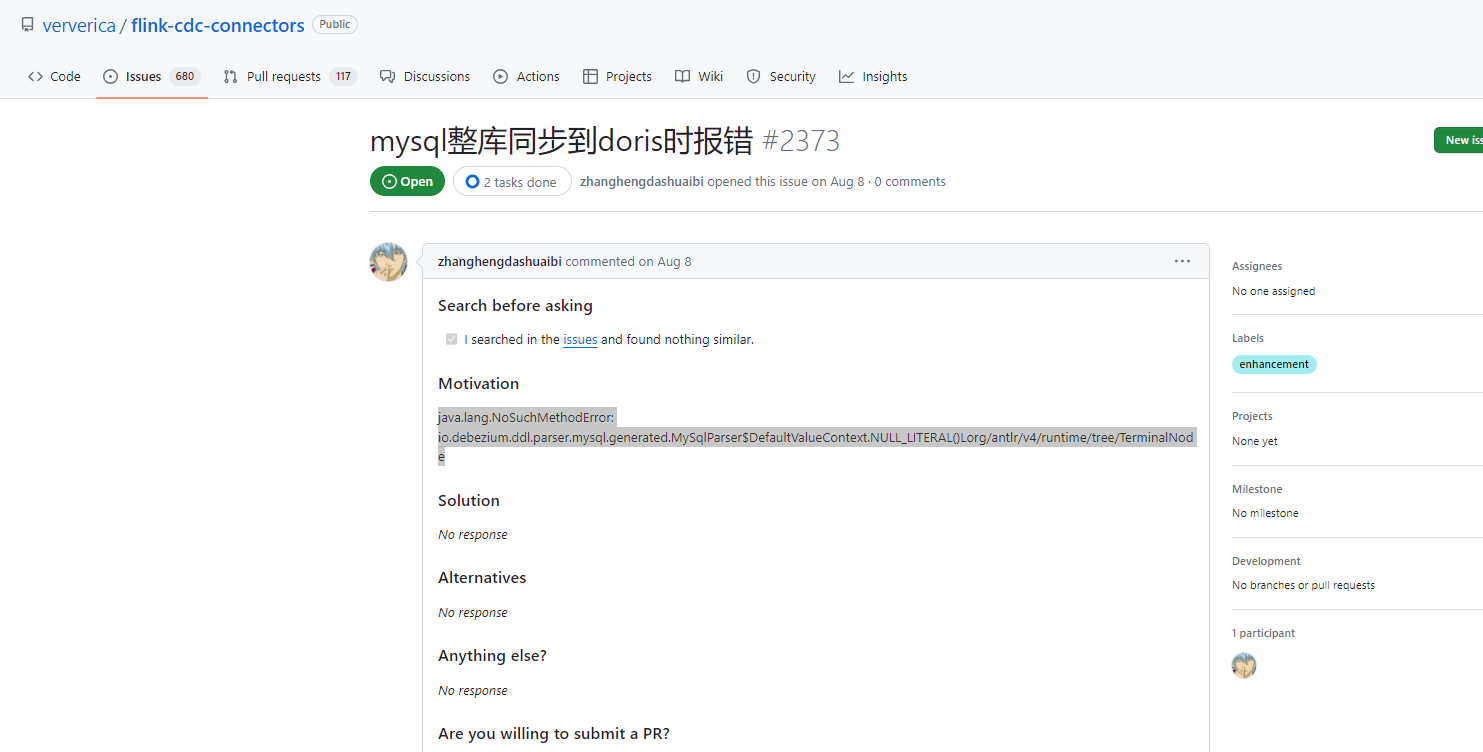

问题四:Flink CDC不是再往Doris写,这个错误只是我在github 看到的相同的错误?

Flink CDC不是再往Doris写,这个错误只是我在github 看到的相同的错误?找了debezium.debezium-json.map-null-key.literal = ''这个参数并设置,然后又报了java.lang.NoSuchMethodError: io.debezium.config.Field.withType(Lorg/apache/kafka/common/config/ConfigDef$Type;)Lio/debezium/config/Field;

参考回答:

这个错误可能是由于Flink CDC和Debezium版本不兼容导致的。请尝试以下解决方案:

- 确保您使用的Flink CDC和Debezium版本是兼容的。您可以查看官方文档或GitHub仓库中的兼容性信息,以确定支持的版本范围。

- 检查您的Flink和Debezium配置文件,确保所有设置都是正确的。特别是关于数据类型和字段映射的部分,确保它们与您的Doris数据库兼容。

- 如果问题仍然存在,您可以尝试在Flink和Debezium的GitHub仓库中提交一个issue,详细描述您遇到的问题和配置。这样,开发人员可以更好地了解您的问题,并为您提供更具体的解决方案。

关于本问题的更多回答可点击原文查看:

https://developer.aliyun.com/ask/577443

问题五:Flink CDC报的这个错怎么解决,我看到issues也有人提但是没解决方案?

Flink CDC报的这个错怎么解决,我看到issues也有人提但是没解决方案?

参考回答:

这个错应该是doris连接器那边的问题

关于本问题的更多回答可点击原文查看: