问题一:能不能描述下投机采样的设计思路及其在RTP-LLM中的实现方式?

能不能描述下投机采样的设计思路及其在RTP-LLM中的实现方式?

参考回答:

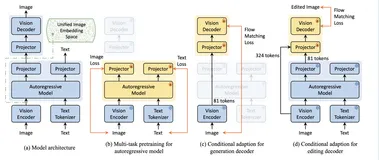

投机采样的设计思路基于两点认知:部分token生成难度低,可以用小模型生成;在小批次情况下,大模型的前向推理时间主要受加载模型权重影响。在RTP-LLM中,我们基于论文思路使用大小模型进行了投机采样的实践。代码设计上考虑系统可维护性,与原始流程解耦,封装了一层编排层提供统一API,内部组织参数顺序调用正常流程。

关于本问题的更多问答可点击原文查看:

https://developer.aliyun.com/ask/628443

问题二:投机采样在性能上引入的主要额外负担是什么?

投机采样在性能上引入的主要额外负担是什么?

参考回答:

投机采样引入的额外负担主要有两块:小模型顺序生成token的时间和采样。小模型推理会占用一定的时间,尤其在N较大且接受token数少的情况下开销会很大。此外,重复多次的采样也引入了巨大的开销。

关于本问题的更多问答可点击原文查看:

https://developer.aliyun.com/ask/628442

问题三:如何优化投机采样中的采样流程以减少额外负担?

如何优化投机采样中的采样流程以减少额外负担?

参考回答:

通过对采样流程进行优化来减少额外负担。具体做法是对存在top_k参数的情况使用融合算子,将原版采样流程分为两步:先进行TopK采样,再省略TopP步骤直接在采样过程中判断。改进后的流程大幅度减少了计算量和kernel数量,从而极大程度减少了采样需要的时间。

关于本问题的更多问答可点击原文查看:

https://developer.aliyun.com/ask/628449

问题四:投机采样在店铺起名和文案生成任务中的性能表现如何?

投机采样在店铺起名和文案生成任务中的性能表现如何?

参考回答:

在店铺起名和文案生成两类任务中,投机采样对模型均有加速效果,具体表现随接受token数和输入token长度变化。在测试条件下,投机采样在大多数情况下与原模型平均token时间相近或者优于原模型,只有在拒绝全部token的情况下会劣于原模型。

关于本问题的更多问答可点击原文查看:

https://developer.aliyun.com/ask/628448

问题五:prompt工程是什么,为什么它对于使用AI很重要?

prompt工程是什么,为什么它对于使用AI很重要?

参考回答:

prompt工程是指针对不同场景构造prompt的过程,以最大程度发挥大模型的能力。它对于使用AI非常重要,因为prompt直接关系到模型推理的结果。同一个问题使用不同的prompt可能会获得不同的答案。通过精心设计的prompt,用户可以更有效地利用AI模型,实现各种智能应用,如自动问答系统、自动客服等。

关于本问题的更多问答可点击原文查看: