问题一:跨云公网传输,大家基于flink有无比较好的数据安全方案?

跨云公网传输,大家基于flink有无比较好的数据安全方案?

参考答案:

使用SSL/TLS协议对网络传输层进行加密,保护数据在传输过程中不被窃取或篡改。实现身份验证和访问控制,确保只有授权的系统和用户才能访问数据。

关于本问题的更多回答可点击进行查看:

https://developer.aliyun.com/ask/579674

问题二:请教下Flink,一直有个问题,代码打包好后在客户端是怎么提交到JOBMANAGER上去的?

请教下Flink,一直有个问题,FLINK的CLIENT提交任务到JOBMANAGER上,那客户端是一台独立机器,JOBMANAGER在另外一台机器上,代码打包好后在客户端是怎么提交到JOBMANAGER上去的?

参考答案:

FLINK client 是提交任务,代码是提前上传好的

关于本问题的更多回答可点击进行查看:

https://developer.aliyun.com/ask/579673

问题三:Flink 有没有和 session 模式通过-C 指定额外的 jar 的相同功能啊?

Flink application on k8s 有没有和 session 模式通过-C 指定额外的 jar 的相同功能啊?

参考答案:

在Kubernetes上运行Flink应用程序时,你可以使用Flink Kubernetes Client提供的命令来提交作业。这些命令允许你指定额外的JAR文件和其他资源。

例如,你可以使用以下命令来提交一个Flink作业,同时指定一个额外的JAR文件:

./bin/flink run-cluster -Dkubernetes.cluster.id=<cluster_id> -Dkubernetes.namespace=<namespace> -Djobmanager.rpc.address=<jobmanager_hostname> -Djobmanager.execution.numberOfTaskSlots=<number_of_task_slots> -Drest.port=<rest_port> -Dparallelism.default=<parallelism> -Dstate.backend=filesystem -Dstate.fs.backend.file-system=hdfs://namenode:8020 -Dstate.fs.backend.checkpoint-dir=hdfs://namenode:8020/flink-checkpoints -Dstate.fs.backend.savepoint-dir=hdfs://namenode:8020/flink-savepoints -Dtaskmanager.numberOfTaskSlots=<number_of_task_slots> <your_jar_path> --class <main_class> --jar <extra_jar>

在这个命令中,<your_jar_path>是你的Flink作业的JAR文件的路径,<extra_jar>是你想要附加的额外JAR文件的路径。

请注意,你需要在你的Flink配置文件中启用额外的JAR支持。你可以在flink-conf.yaml文件中设置jobmanager.execution.additional-classpaths属性来添加额外的JAR文件。

关于本问题的更多回答可点击进行查看:

https://developer.aliyun.com/ask/579672

问题四:Flink 双流union,故障恢复后,一条流没有数据的情况下,有知道这个怎么解决吗?

Flink 双流union,故障恢复后,一条流没有数据的情况下,watermark不生成,有小伙伴知道这个怎么解决吗?

参考答案:

试试不用lamda表达式,直接写成匿名类,类里面加上private static final long serial VersionUID语句

关于本问题的更多回答可点击进行查看:

https://developer.aliyun.com/ask/579667

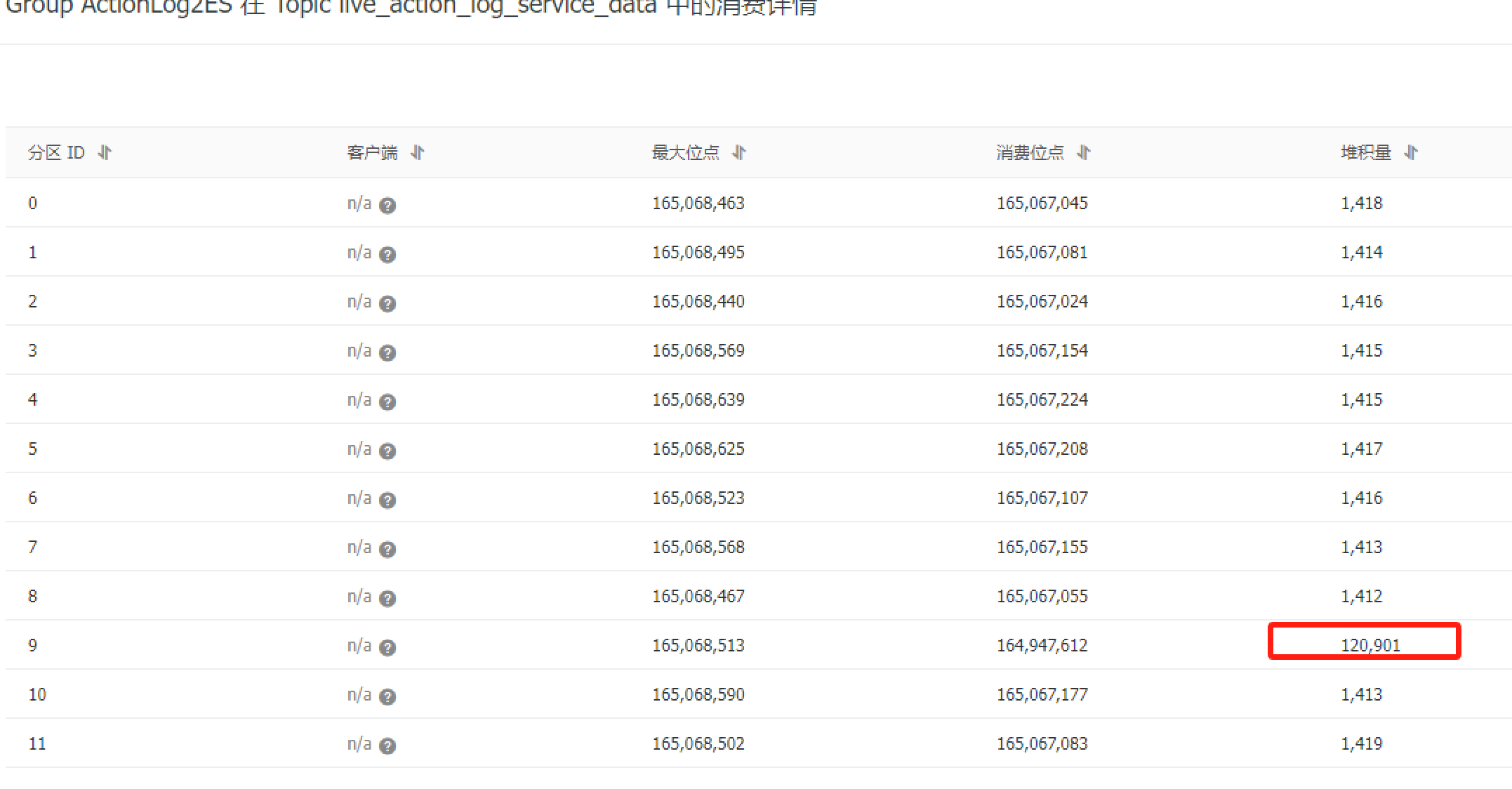

问题五:flink 消费kafka,之前任务正常的,突然有个分区没法消费了,重启下任务久正常了?

flink 消费kafka,之前任务正常的,突然有个分区没法消费了,重启下任务久正常了?

参考答案:

1、查看下kafka集群是否有异常日志。

2、用以下命令查看下对应的状态。

## 查询集群描述 bin/kafka-topics.sh --describe --zookeeper ## 显示某个消费组的消费详情(0.9版本 - 0.10.1.0 之前) bin/kafka-consumer-groups.sh --new-consumer --bootstrap-server localhost:9092 --describe --group test-7 ## 显示某个消费组的消费详情(0.10.1.0版本+) bin/kafka-consumer-groups.sh --bootstrap-server localhost:9092 --describe --group test-7

——参考链接。

关于本问题的更多回答可点击进行查看: