问题一:通过flink-connector-mongodb-cdc 2.4.2有没有遇见过这种问题?

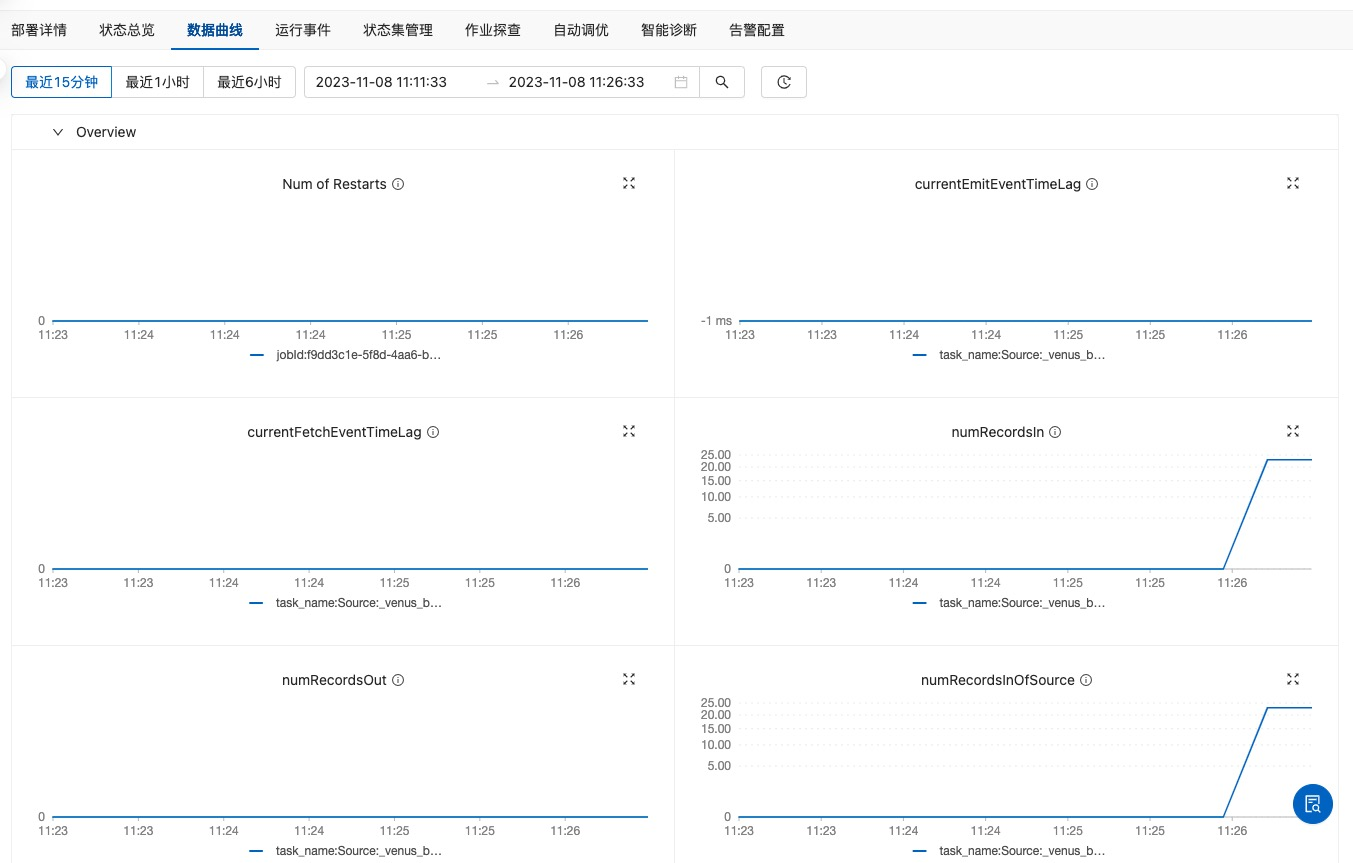

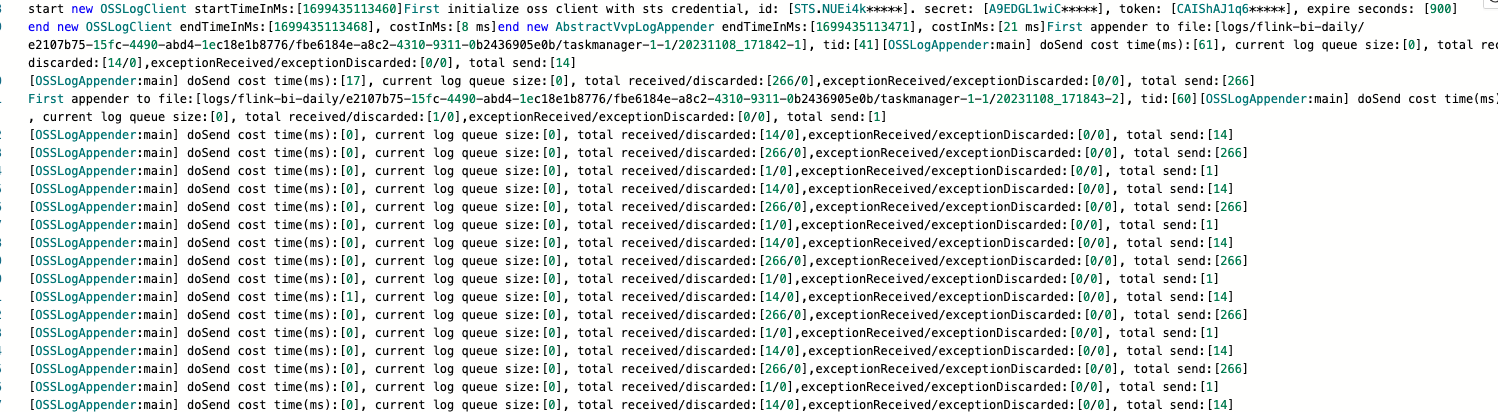

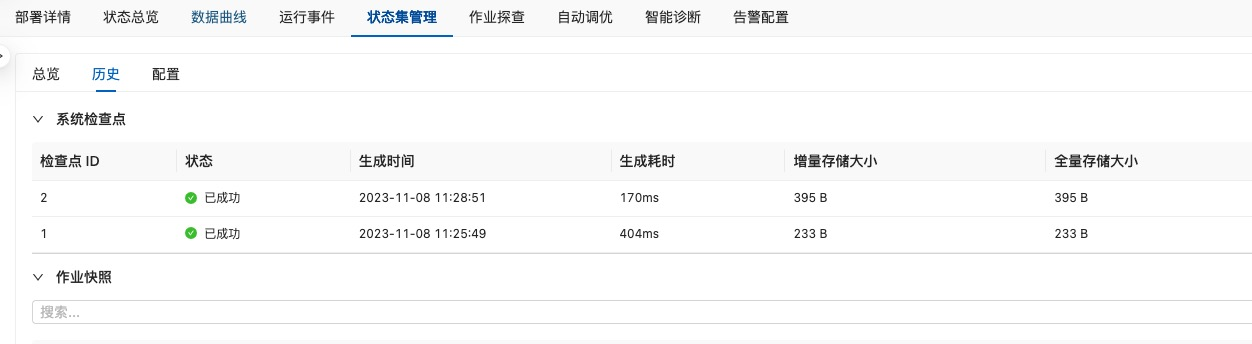

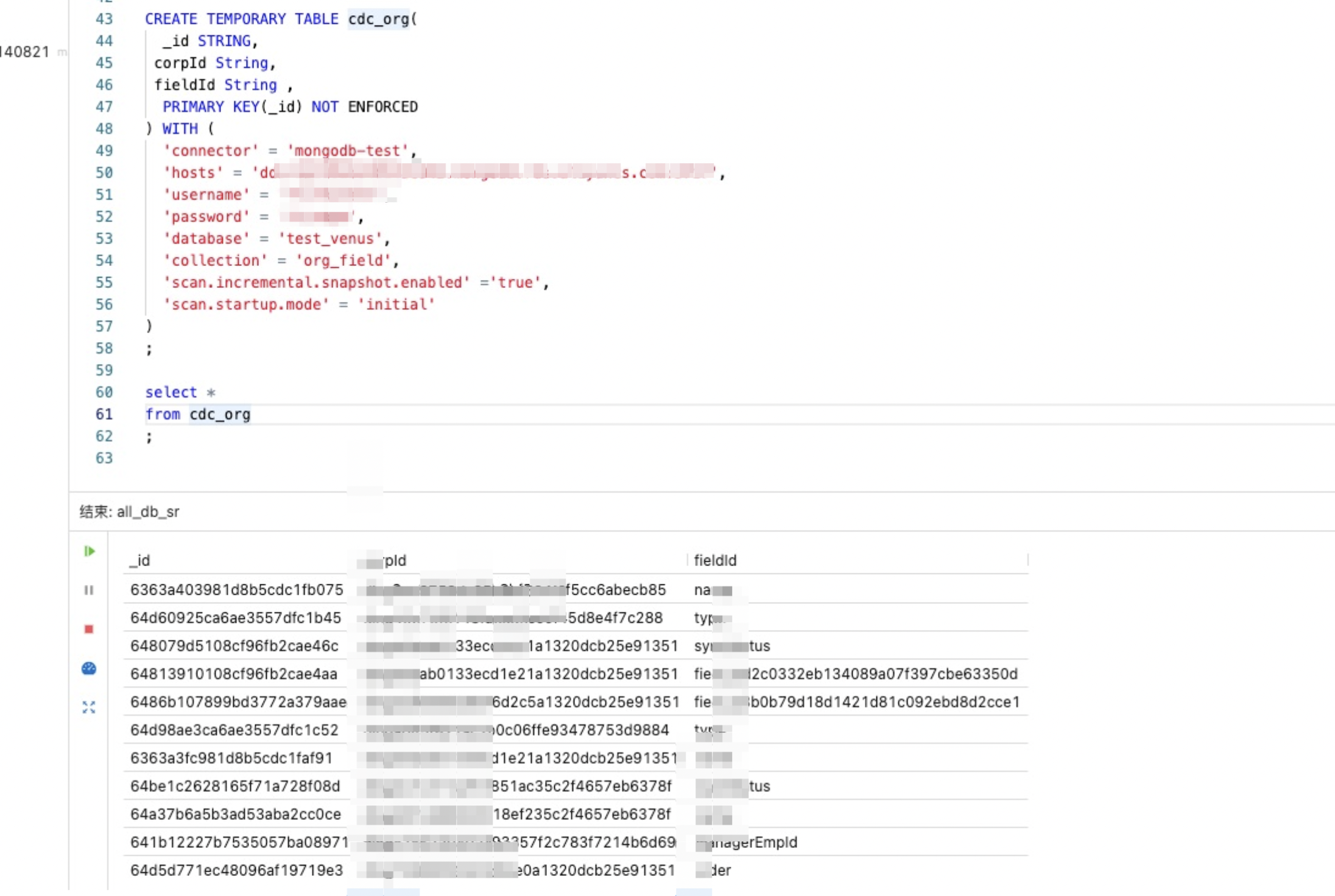

通过flink-connector-mongodb-cdc 2.4.2使用ds的增量快照读取mongodb数据在本地测试和本地集群都是可以拿到数据的,但是一上阿里云的vvr平台就读取不到数据,然后我换了阿里云的vvr的sql方式,测试了flink 1.15 和1.17使用增量快照都是可以拿到数据,这里datastream增量快照方式就是拿不到数据,tm日志正常,没有报错,但是metric一直是0,拆分算子后metric还是0,有没有大佬遇见过这种问题?ds方式,没有任何数据sql方式的mongodb'增量快照可以拿到数据

参考回答:

根据您的描述,您在使用flink-connector-mongodb-cdc 2.4.2的DataStream增量快照方式读取MongoDB数据时,在本地测试和本地集群都可以正常拿到数据,但在阿里云的VVR平台上无法读取到数据。而在阿里云的VVR上使用SQL方式,无论是Flink 1.15还是1.17版本,都可以正常拿到数据。

首先,请确保您的阿里云VVR平台与Flink集群之间的网络连接是正常的。如果网络连接没有问题,那么可以尝试以下方法:

- 检查阿里云VVR平台的日志,看是否有关于Flink任务执行的详细信息。这有助于了解任务在执行过程中是否遇到了问题。

- 在Flink任务中添加更多的日志输出,以便更好地了解任务的执行情况。例如,可以在

processElement方法中添加日志输出,以查看数据处理过程中是否有异常情况发生。 - 尝试使用其他版本的flink-connector-mongodb-cdc,看是否能解决问题。如果问题仍然存在,那么可能是阿里云VVR平台与该版本之间存在兼容性问题。

关于本问题的更多回答可点击原文查看:https://developer.aliyun.com/ask/570656

问题二:在a集群的flinkcdc去抓取部署在b集群的mysql数据变更么?

在a集群的flinkcdc去抓取部署在b集群的mysql数据变更么,b集群的mysql是部署在docker上的?

参考回答:

是的,Flink CDC可以在A集群的Flink应用程序中抓取B集群的MySQL数据库的数据变更。只要A集群的Flink应用程序能够连接到B集群的MySQL数据库,就可以进行数据的抓取和同步。

至于B集群的MySQL数据库是部署在Docker上,这并不会影响A集群的Flink应用程序的抓取操作。因为Flink CDC是通过网络连接来进行数据抓取的,只要网络连通性良好,就可以正常进行数据的抓取和同步。

但是,需要注意的是,如果B集群的MySQL数据库是在Docker容器内,那么你需要确保Docker容器的网络配置是正确的,例如,Docker容器的IP地址和端口是需要被正确配置的,以便A集群的Flink应用程序能够成功地连接到它。

关于本问题的更多回答可点击原文查看:https://developer.aliyun.com/ask/570655

问题三:怎么判断Flink CDC用xstream采集oracle有没有生效?

怎么判断Flink CDC用xstream采集oracle有没有生效?

参考回答:

要判断Flink CDC是否成功采集了Oracle数据库的数据,可以通过以下步骤进行验证:

- 检查Flink CDC的日志输出,查看是否有从Oracle数据库中读取到数据的相关记录。

- 在Flink应用程序中添加一个Sink操作,将采集到的数据输出到其他存储介质(如Kafka、HDFS等),然后观察该存储介质中是否有新增的数据。

- 在Flink应用程序中添加一个ProcessFunction操作,对采集到的数据进行处理和分析,并输出结果。通过观察处理结果是否符合预期,可以判断Flink CDC是否成功采集了Oracle数据库的数据。

- 如果以上方法都无法确定Flink CDC是否生效,可以尝试手动触发Oracle数据库中的一些变更事件(如插入、更新、删除等),然后观察Flink应用程序中是否有相应的数据处理和输出。

关于本问题的更多回答可点击原文查看:https://developer.aliyun.com/ask/570653

问题四:Flink CDC这个问题要怎么处理啊?

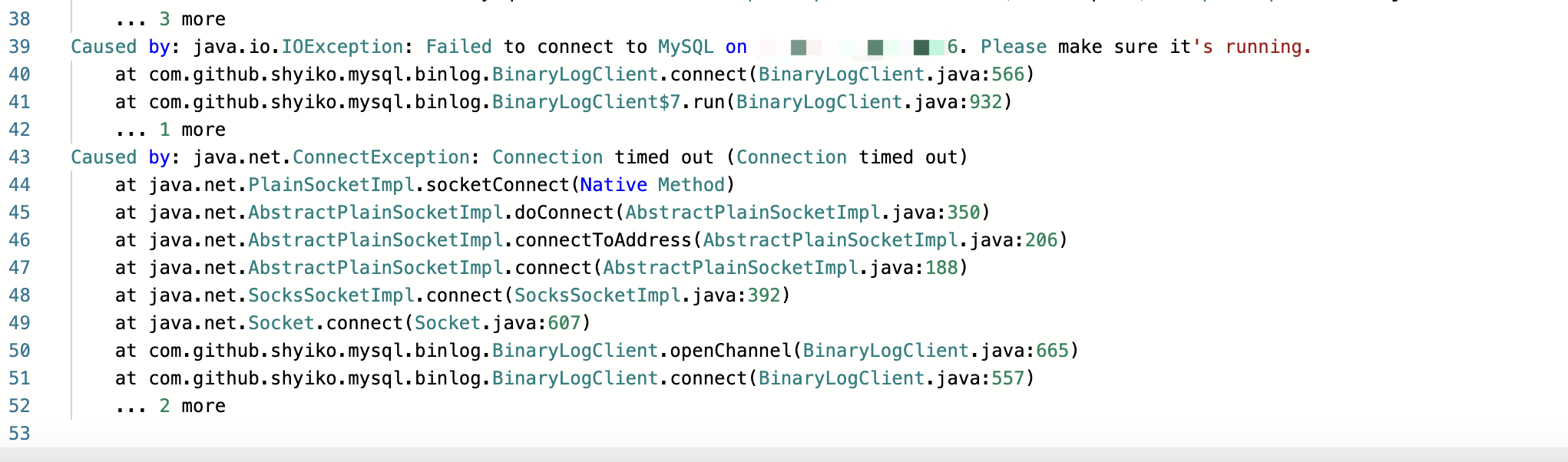

Flink CDC中用mysql-cdc 2.4.1版本的streamApi正则同步分库的一个表到kafka,有50个库里面,最大的一张表3千5百万左右。一共有9亿的数据,同步的时候总是提示mysql连接超时,我已经设置了cdc的connect.timeout=3600秒,但是过了几分钟就会提示这个超时. 目前还设置了,connection.poll.size=200,chunkSize设置的是60万。这个问题要怎么处理啊?

参考回答:

chunksize太大大大了

关于本问题的更多回答可点击原文查看:https://developer.aliyun.com/ask/570652

问题五:Flink CDC基于非主键列进行切割块是否支持?

Flink CDC基于非主键列进行切割块是否支持?

参考回答:

官网文档搜chunk column

关于本问题的更多回答可点击原文查看:https://developer.aliyun.com/ask/570231