引言

随着深度学习、高性能计算和大数据分析等领域的快速发展,GPU(图形处理器)因其强大的并行计算能力和浮点运算速度而成为首选的计算平台。然而,随着模型规模的增长和技术的进步,构建高效稳定的GPU算力平台面临着新的挑战。本文旨在探讨这些挑战、应对策略以及对未来发展的展望。

当前挑战

算力分配与资源优化

在多用户共享GPU集群的环境下,合理分配计算资源并确保每个任务能够高效运行是一项挑战。这不仅涉及到硬件资源的管理,还包括软件层面的任务调度。

稳定性与可扩展性

随着GPU数量的增加,如何保证系统的稳定性和可扩展性成为关键问题。这要求在架构设计上充分考虑冗余和容错机制。

冷启动与热插拔

对于云环境下的GPU资源,冷启动时间和热插拔支持也是重要的考量因素,尤其是在按需分配的场景下。

应对策略

优化软件栈

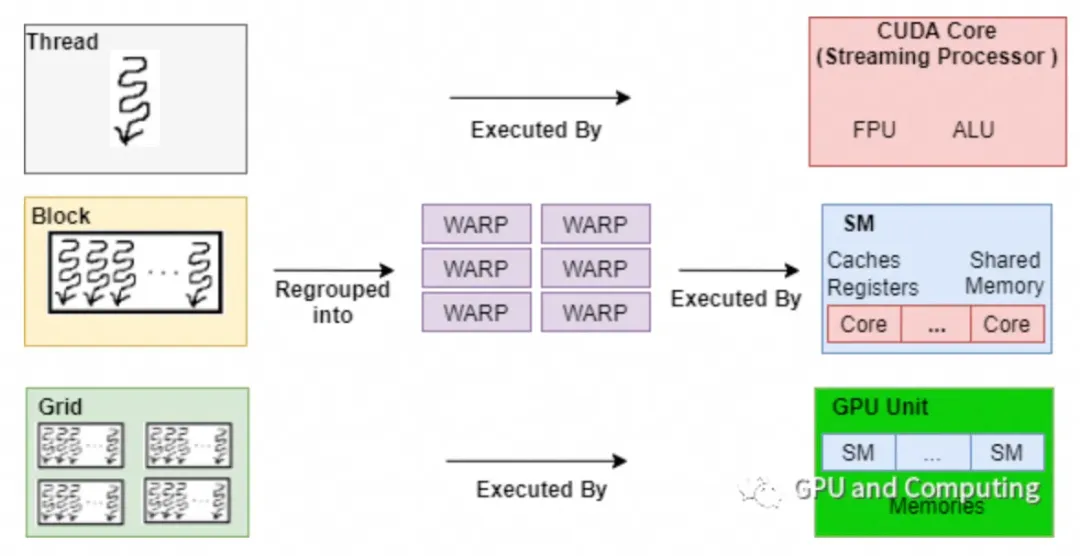

高效的GPU应用往往依赖于高度优化的软件栈。例如,使用CUDA或OpenCL等API来编写GPU程序,以及利用TensorFlow、PyTorch等深度学习框架。

示例代码:使用CUDA C++ 进行矩阵乘法优化

#include <cuda_runtime.h>

#include <iostream>

__global__ void matrixMulKernel(float *A, float *B, float *C, int N) {

int row = blockIdx.y * blockDim.y + threadIdx.y;

int col = blockIdx.x * blockDim.x + threadIdx.x;

if (row < N && col < N) {

float Cvalue = 0.0f;

for (int k = 0; k < N; ++k)

Cvalue += A[row * N + k] * B[k * N + col];

C[row * N + col] = Cvalue;

}

}

void matrixMultiplyCUDA(float *A, float *B, float *C, int N) {

dim3 threadsPerBlock(16, 16);

dim3 numBlocks((N + threadsPerBlock.x - 1) / threadsPerBlock.x,

(N + threadsPerBlock.y - 1) / threadsPerBlock.y);

matrixMulKernel<<<numBlocks, threadsPerBlock>>>(A, B, C, N);

cudaDeviceSynchronize();

}

int main() {

const int N = 1024;

float *A, *B, *C;

cudaMallocManaged(&A, N * N * sizeof(float));

cudaMallocManaged(&B, N * N * sizeof(float));

cudaMallocManaged(&C, N * N * sizeof(float));

// 初始化矩阵A和B

for (int i = 0; i < N * N; i++) {

A[i] = 1.0f;

B[i] = 2.0f;

}

// 调用CUDA函数执行矩阵乘法

matrixMultiplyCUDA(A, B, C, N);

// 输出结果矩阵C的一部分

for (int i = 0; i < 5; i++) {

for (int j = 0; j < 5; j++)

std::cout << C[i * N + j] << " ";

std::cout << std::endl;

}

cudaFree(A);

cudaFree(B);

cudaFree(C);

return 0;

}

资源管理和调度

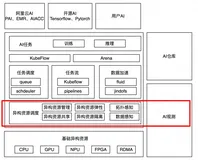

使用容器化技术如Docker和Kubernetes可以有效地管理GPU资源,确保任务的隔离性和可扩展性。

架构优化

采用最新的GPU架构和高速互连技术,如NVLink或InfiniBand,可以显著提高通信效率和带宽。

未来展望

技术创新

量子计算、神经形态计算等新兴技术可能会改变计算模式,影响GPU的设计和应用。

软件定义的GPU

随着软件定义网络(SDN)的成功,软件定义的GPU(SDGPU)概念也开始受到关注,它能够更好地适应动态变化的工作负载。

云边协同

边缘计算与云计算相结合的模式将进一步拓展GPU的应用范围,特别是在实时数据分析和处理方面。

结论

构建高效GPU算力平台是一个持续演进的过程,需要跨学科的知识和技术的支持。通过不断的技术创新和架构优化,我们可以期待GPU算力平台在未来发挥更大的作用。