Flink CDC+OceanBase全增量一体化数据集成方案

摘要:本文整理自OceanBase技术部,开源生态工具研发技术专家王赫,在深入浅出 OceanBase线上技术沙龙第二期的分享。

本篇内容主要分为五个部分:

1.CDC技术简介

2.OceanBase CDC组件介绍

3.Flink CDC简介

4.体验Flink CDC OceanBase Connector

5.总结

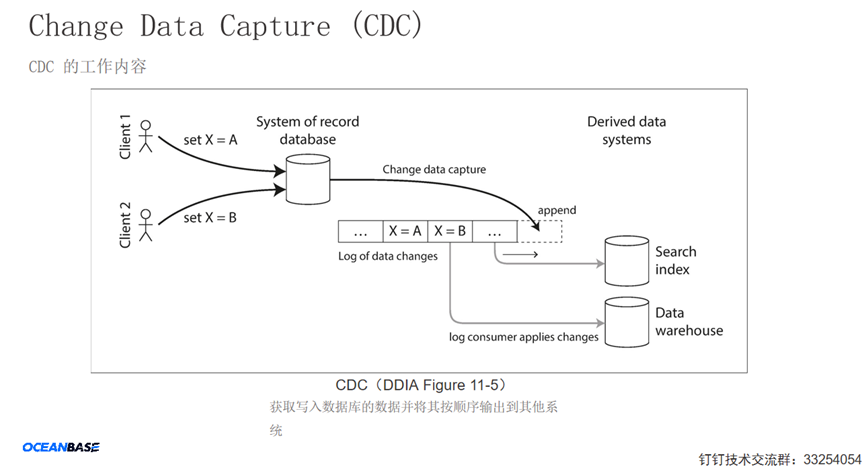

一、CDC技术简介

CDC是Change Data Capture变更数据获取的简称。其核心思想是监测并捕获数据库的变动。包括数据或数据表的插入INSERT、更新UPDATE、删除DELETE等。将这些变更按发生的顺序完整记录下来,写入到消息中间件中,以供其他服务进行订阅及消费。

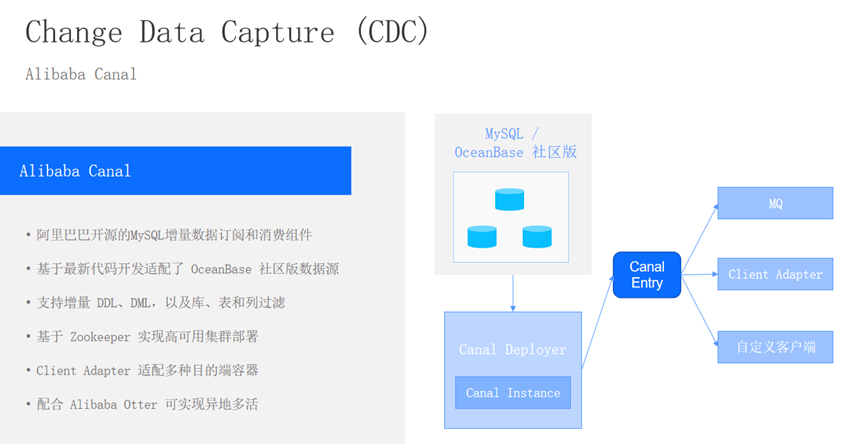

目前,国内比较流行的CDC开源技术是Alibaba Canal。早期主要用于阿里巴巴开源的MySQL增量数据订阅和消费组件。阿里巴巴基于最新代码开发适配了OceanBase社区版数据源,支持增量DDL、DML,以及库、表和列过滤。基于Zookeeper实现高可用集群部署。Client Adapter适配多种目的端容器,配合Alibaba Otter可实现异地多活。

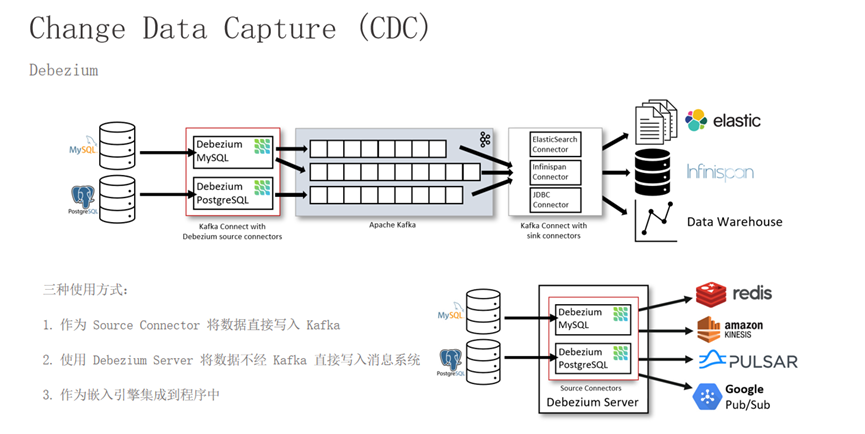

国外也有一个比较流行的开源CDC框架叫Debezium,支持DDL和DML的操作日志同步;支持使用数据的主键或唯一键作为消息体的key;支持快照模式和全量同步;除此之外,Debezium还支持多种数据源,使用 Debezium Server 可以将数据不经 Kafka 直接写入消息系统,作为嵌入引擎集成到程序中。

二、OceanBase CDC组件介绍

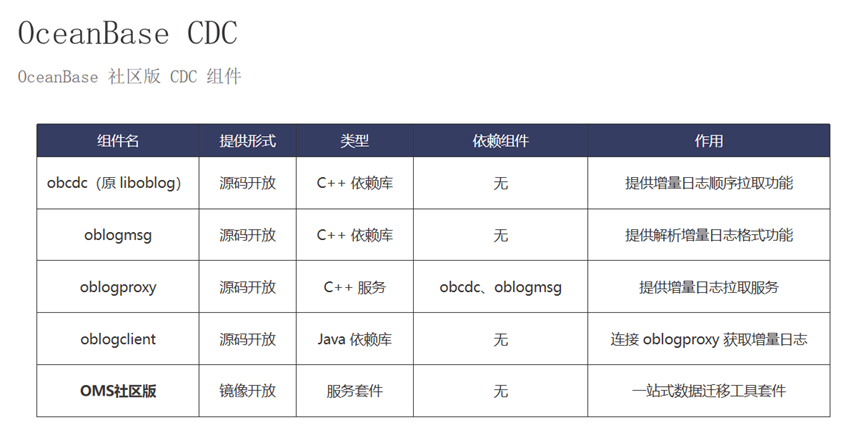

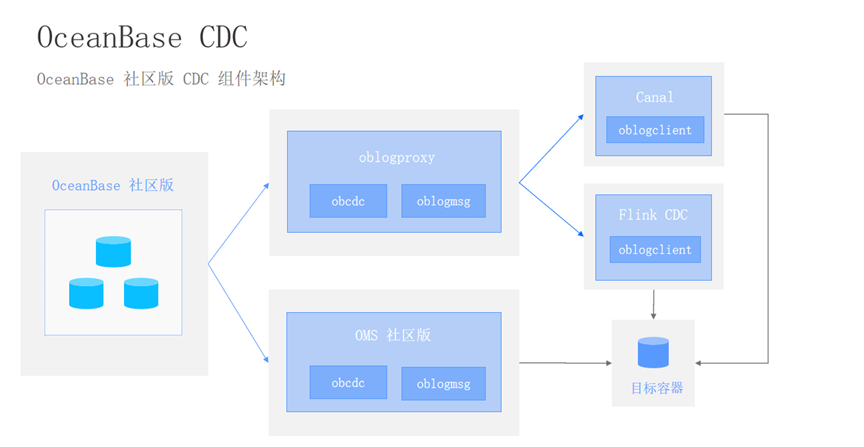

OceanBase社区版的CDC 组件主要有:obcdc(原liboblog)提供增量日志顺序拉取功能;oblogmsg提供解析增量日志格式功能;oblogproxy提供增量日志拉取服务;oblogclient连接 oblogproxy 获取增量日志。

除了以上几种源代码开放的项目之外,OMS社区版提供了OceanBase一站式数据迁移工具套件服务。它不但可以做增量数据的迁移,而且可以做全量数据迁移、全量数据校验等。

上图是OceanBase社区版CDC组件架构,主要包括oblogproxy和OMS社区版。oblogproxy的Canal和Flink CDC也支持oblogclient能力,通过连接oblogproxy获取增量日志。

三、Flink CDC简介

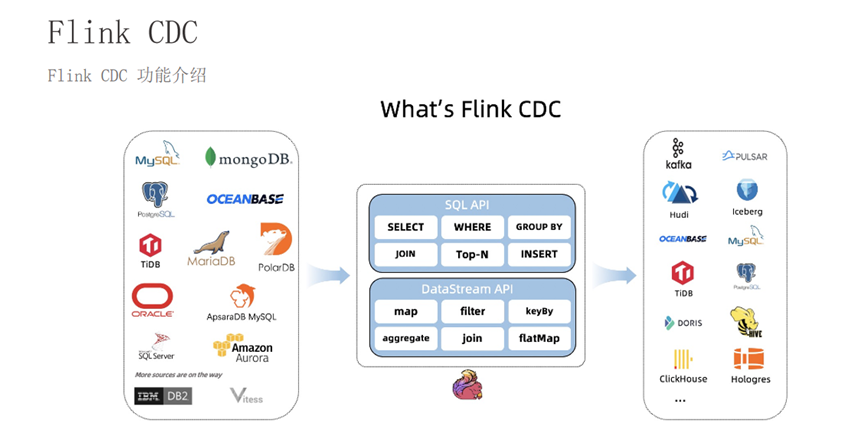

目前,Flink CDC支持多种数据源,如MySQL、PostgreSQL、Oracle等。Flink CDC提供了对多种数据库的全量和增量数据的读取能力,当数据读到Flink之后,会自动交由FlinkSQL引擎处理。

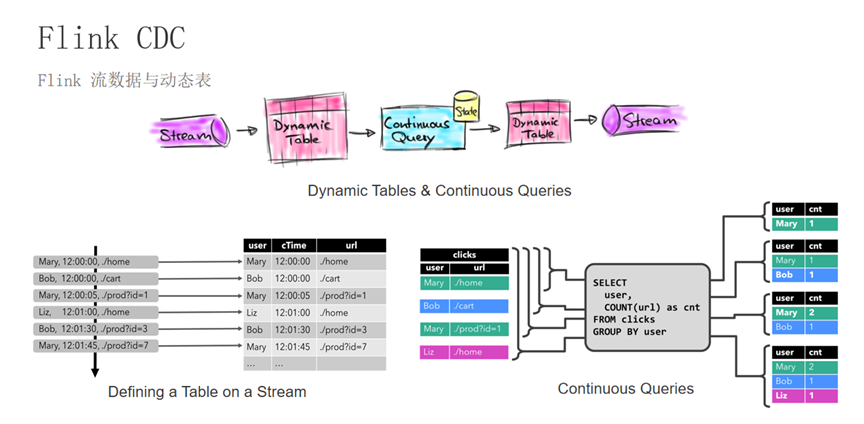

因为Flink是流批一体的处理引擎,所以Flink CDC提供了动态表结构。左图显示了流式数据和动态表的对应关系。右图显示了Continuous Queries的多次执行结果。

上图是Flink CDC的工作原理,基于Debezium实现了SourceFunction接口,支持MySQL、Oracle、MongoDB、PostgreSQL、SQLServer。

最新的MySQL数据源读取实现了Source接口,相比SourceFunction的实现增强了并发读取。

OceanBaseRichSourceFunction实现了SourceFunction接口,分别基于JDBC和oblogclient实现了全量和增量读取。

四、体验Flink CDC OceanBase Connector

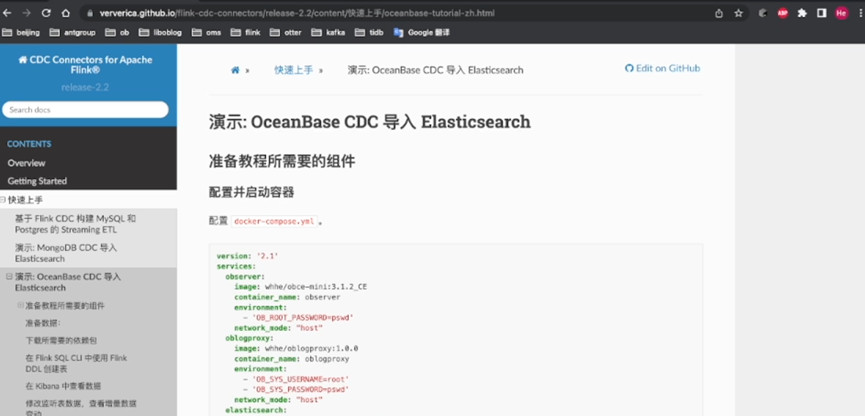

首先,配置docker-compose.yml,并启动容器。在docker-compose.yml所在目录下执行命令:docker-compose up-d启动需要的组件。

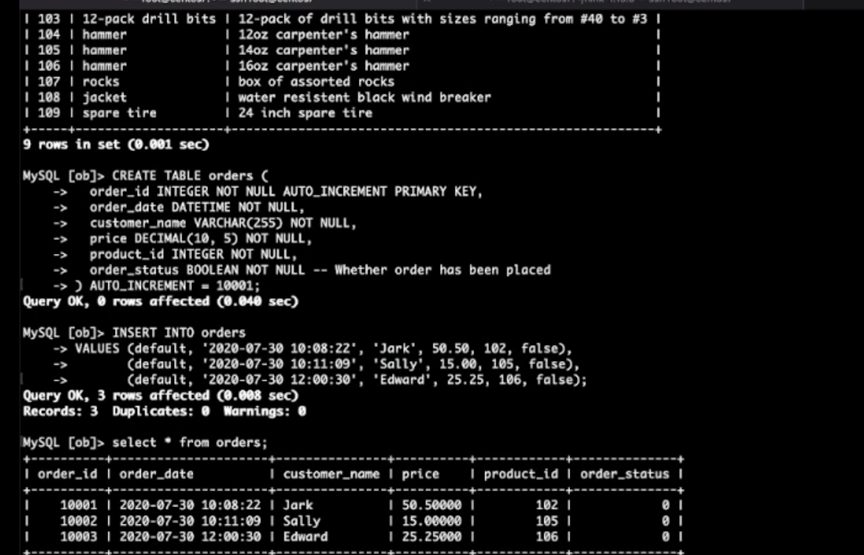

然后准备数据,使用新创建的用户名和密码进行登陆:docker-compose exec observer obclient-h127.0.0.1-P2881-uroot-ppsw。下载需要的依赖包,在Flink SQL CLI中使用Flink DDL创建表。

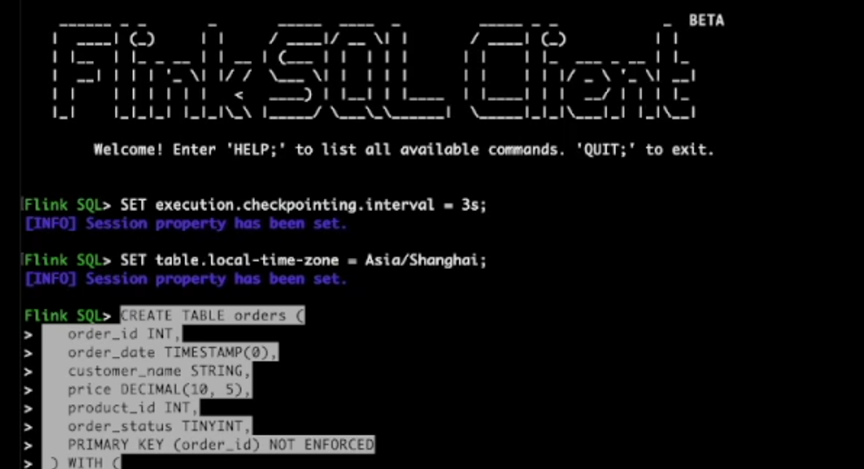

设置间隔时间为3秒,本地时区为 Asia/Shanghai,创建订单表,创建商品表,创建关联后的订单数据表。执行读取和写入 。

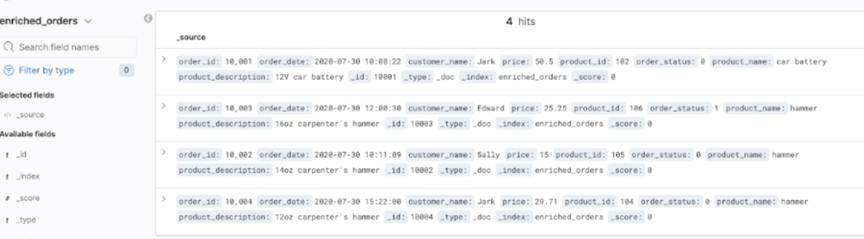

完成上述操作后,在Kibana中查看数据。访问:

http://localhost:5601/app/kibana#/management/kibana/index_pattern

创建index pattern enriched_orders, 之后可以在

http://localhost:5601/app/kibana#/discover看到写入的数据了。

修改监听表数据,查看增量数据变动。在OceanBase中依次执行如下修改操作,每执行一步就刷新一次Kibana,可以看到Kibana中显示的订单数据将实时更新。

最后,进行环境清理。将docker-compose.yml文件所在的目录,执行以下命令,停止所有容器:docker-compose down。进入Flink的部署目录,停止Flink集群:./bin/stop-cluster.sh。

五、总结

Flink CDC是一个全增量一体化的数据迁移方案,支持多种源端类型,并且可以借助Flink SQL实现对流式数据的ETL处理。截止Flink CDC 2.2发布,该项目累计有44位贡献者,4位Maintainer,社区用户群超过4000人。

Flink CDC从 2.2 开始加入了 OceanBase Connector,目前实现了对多库、多表的全量数据和增量 DML 的 at-least-once 读取。在未来的版本中,Flink CDC OceanBase Connector 会逐步添加对并发读取、增量DDL 和 exactly-once 的支持。

接下来,对比一下现有的CDC方案。OMS社区版是白屏操作工具,有一个统一的前端界面。提供了全量+增量+数据校验+运维的一站式服务,在线上久经考验。其缺点在于部署流程稍显繁琐,只支持MySQL和OceanBase社区版作为数据源和目的端,不支持增量DDL。

DataX+Canal/Otter是一个纯开源方案。Canal支持多种目的端和增量DDL,Otter支持双活。其不足在于全量迁移和增量迁移割裂。组件分散,不方便运维。

Flink CDC是纯开源方案,且社区活跃。支持多种数据源和目的端,全量+增量一体化,支持分库分表聚合和ETL。其不足在于当前OceanBase版本不支持增量DDL,当前版本不支持exactly-once。