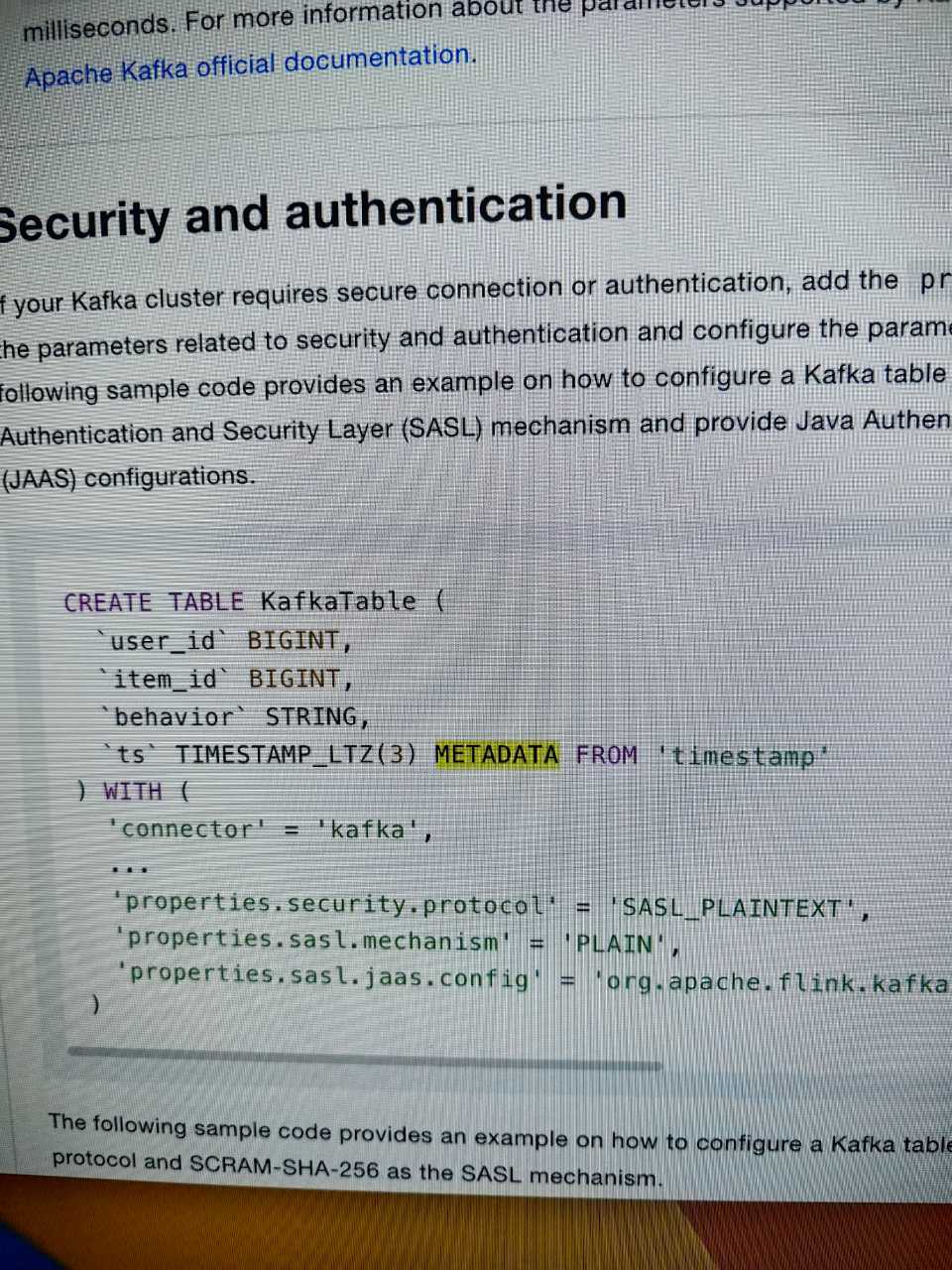

问题一:在Flink这个metadata 怎么赋值进去?

在Flink这个metadata 怎么赋值进去?

参考回答:

自动生成的,souce采用 meta。此回答整理自钉群“【②群】Apache Flink China社区”

关于本问题的更多回答可点击原文查看:

https://developer.aliyun.com/ask/576577

问题二:Flink rest能不能在main中执行多个串行的job?

Flink rest能不能在main中执行多个串行的job?

参考回答:

是的,Flink REST API可以在main方法中执行多个串行的job。

首先,你需要创建一个Flink执行环境(StreamExecutionEnvironment或BatchExecutionEnvironment),然后为每个job创建一个执行配置(StreamingExecutionConfiguration或BatchExecutionConfiguration)。

对于每个job,你可以使用执行环境的run方法来提交和执行它。这个方法会返回一个JobExecutionResult对象,你可以用这个对象来获取job的状态和结果。

关于本问题的更多回答可点击原文查看:

https://developer.aliyun.com/ask/576576

问题三:flink中如何能够产生-D的change log的呢?

flink中如何能够产生-D的change log的呢?

实际的业务场景是,我这边有一个滑动窗口,但是我希望根据第二次滑动后窗口产生的数据和第一次滑动后窗口产生的数据做对比,按照主键做对比,新增数据做insert,消失的数据做delete,分别产生需要insert和delete的数据。

但是网上不管怎么搜,都只有产生+I -U +U类型的example,就是没有产生-D的example

参考回答:

在Flink中,要产生-D的change log,可以通过自定义一个ChangelogProducer来实现。以下是一个简单的示例:

首先,创建一个自定义的ChangelogProducer类,继承自org.apache.flink.streaming.api.functions.source.SourceFunction>:

import org.apache.flink.streaming.api.functions.source.SourceFunction; import org.apache.flink.streaming.api.watermark.Watermark; import org.apache.flink.streaming.api.windowing.windows.TimeWindow; import org.apache.flink.util.Collector; public class CustomChangelogProducer<T> implements SourceFunction<ChangeEvent<T>> { private final Supplier<T> dataSupplier; private final long windowSize; private T currentData; public CustomChangelogProducer(Supplier<T> dataSupplier, long windowSize) { this.dataSupplier = dataSupplier; this.windowSize = windowSize; } @Override public void run(SourceContext<ChangeEvent<T>> ctx) throws Exception { while (true) { long currentTime = System.currentTimeMillis(); T newData = dataSupplier.get(); if (newData != null) { currentData = newData; ctx.collect(new ChangeEvent<>(currentTime, currentTime + windowSize, currentData)); } Thread.sleep(1000); } } @Override public void cancel() { // No-op } @Override public boolean isBounded() { return false; } @Override public void onElement(ChangeEvent<T> element, Context context, Collector<ChangeEvent<T>> collector) throws Exception { // Do nothing } @Override public void onTimeout(long timeout, TimeWindow window, Context context) throws Exception { // Do nothing } @Override public void onWatermark(Watermark mark) throws Exception { // Do nothing } }

然后,在你的Flink程序中使用这个自定义的ChangelogProducer:

import org.apache.flink.api.common.serialization.SimpleStringSchema; import org.apache.flink.streaming.api.datastream.DataStream; import org.apache.flink.streaming.api.environment.StreamExecutionEnvironment; import org.apache.flink.streaming.api.functions.source.SourceFunction; import org.apache.flink.streaming.api.watermark.WatermarkStrategy; import org.apache.flink.streaming.api.windowing.time.Time; import org.apache.flink.streaming.api.windowing.windows.TimeWindow; import org.apache.flink.util.Collector; public class Main { public static void main(String[] args) throws Exception { StreamExecutionEnvironment env = StreamExecutionEnvironment.getExecutionEnvironment(); // 使用自定义的ChangelogProducer DataStream<String> inputStream = env.addSource(new CustomChangelogProducer<>(() -> "example", 1000L)); // 对输入数据进行处理,例如按照主键进行对比,生成insert和delete的数据 // ... env.execute("Flink Changelog Example"); } }

这样,你就可以在Flink程序中产生-D的change log了。注意,这个示例仅用于演示目的,实际应用中可能需要根据具体需求进行调整。

关于本问题的更多回答可点击原文查看:

https://developer.aliyun.com/ask/576371

问题四:Flink这个问题除了增大心跳超时,有别的解决办法没?

请问有人遇到过因为某些task重启导致akka rpc压力过大导致心跳没办法正常进行,从而导致其他taskmanager也failover的问题么?Flink这个问题除了增大心跳超时,有别的解决办法没?

参考回答:

Flink 的 Akka RPC 压力过大的问题,可能有多种原因,包括但不限于:大量的 RPC 请求、网络问题、资源不足等。以下是一些可能的解决方案:

- 优化 RPC 调用:尽量减少不必要的 RPC 调用,或者使用批处理的方式来发送 RPC 请求。

- 增加资源:如果是因为资源不足导致的压力过大,可以尝试增加 Flink 的资源,如内存、CPU 等。

- 调整超时设置:除了增大心跳超时,还可以调整其他的超时设置,如 RPC 超时、任务执行超时等。

- 使用负载均衡:如果 Flink 集群中的任务分配不均匀,可能会导致某些 TaskManager 的压力过大。可以使用负载均衡来平衡各个 TaskManager 的负载。

- 监控和报警:通过监控 Flink 的运行情况,可以及时发现并解决各种问题。可以设置报警阈值,当达到阈值时,自动发送报警通知相关人员。

- 升级 Flink 版本:如果问题出现在特定的 Flink 版本上,可以尝试升级到最新的稳定版本,看是否能解决问题。

以上都是一些可能的解决方案,具体还需要根据 Flink 集群的运行情况进行分析和调整。

关于本问题的更多回答可点击原文查看:

https://developer.aliyun.com/ask/576370

问题五:flink 可以让他自动重启的时候都无状态重启吗?

flink 可以让他自动重启的时候都无状态重启吗?

参考回答:

是的,Flink 可以在自动重启时以无状态方式重启。为了实现这一点,你需要在 Flink job 的配置中设置 "restart-strategy" 为 "fixed-delay" 策略,并将 "failover-mode" 设置为 "standby"。这样,当任务失败并自动重启时,它们将无状态地启动,即不会保留任何先前运行的状态。

以下是一个简单的示例,展示了如何在 Flink job 中配置固定延迟重启策略和备用故障转移模式:

job.setRestartStrategy(RestartStrategies.fixedDelayRestart( int restartAttempts, long delayBetweenAttempts)); job.setFailoverStrategy(FailoverStrategies.standbyMode());

在这个配置中,restartAttempts 参数表示在任务失败后尝试重启的次数,而 delayBetweenAttempts 参数表示两次重启尝试之间的延迟(以毫秒为单位)。

关于本问题的更多回答可点击原文查看: