问题一:为什么FlinkKafkaConsumer能消费成功?

为什么FlinkKafkaConsumer能消费成功?Flink CDC版本是1.14.6 连接kafka用的驱动是flink-connector-kafka_2.12,分别测试了下FlinkKafkaConsumer

和KafkaSource这两个类,KakaSource这个类就报错 java.lang.NoSuchMethodError: org.apache.kafka.clients.consumer.KafkaConsumer.poll

参考答案:

版本兼容问题 排查下版本 比如kafka的版本或 scala的 2.11 和2.12

关于本问题的更多回答可点击进行查看:

https://developer.aliyun.com/ask/582243

问题二:flink cdc数据库历史主题或其内容完全或部分丢失。请检查数据库历史主题配置,然后重新执行快照?

flink cdc数据库历史主题或其内容完全或部分丢失。请检查数据库历史主题配置,然后重新执行快照? flink cdc2.4.0,flink:1.14.3, oracle 19.3.0.0,io.debezium.debezium异常:

参考答案:

快照过久,可以先尝试调整debezium的超时参数,flink cdc也有

关于本问题的更多回答可点击进行查看:

https://developer.aliyun.com/ask/582242

问题三:对于flinkcdc对与时间类型的字段会自动转化为unix时间戳类型,都是怎么给他复原的呀?

对于flinkcdc对与时间类型的字段会自动转化为unix时间戳类型,都是怎么给他复原的呀,有没有比较的简单的办法参考一下?

参考答案:

需要在 yml 文件里的 pipeline 加 local-time-zone: GMT-08:00 设置时区。

关于本问题的更多回答可点击进行查看:

https://developer.aliyun.com/ask/582238

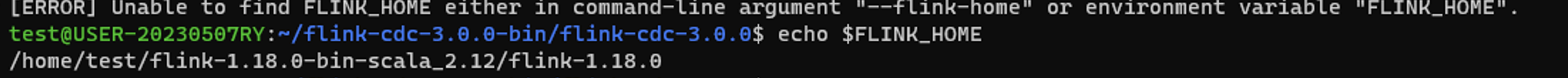

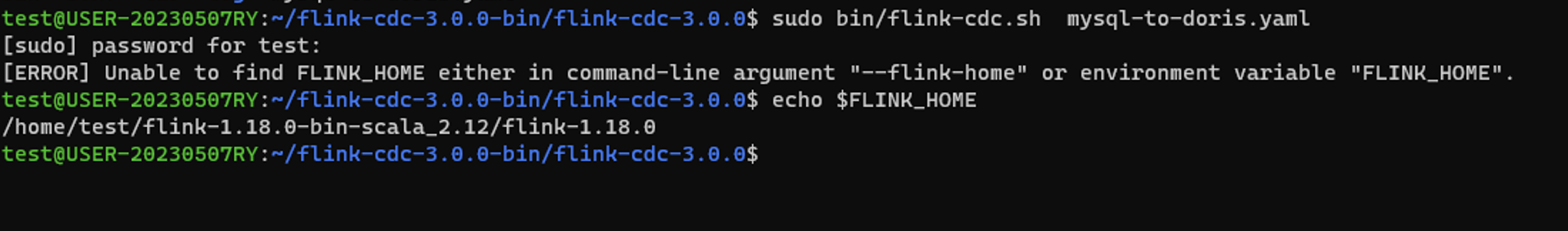

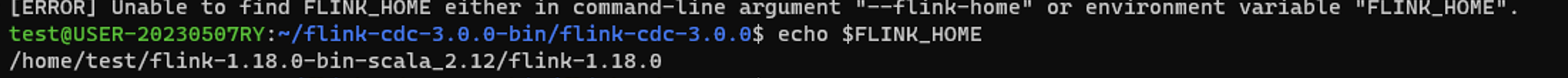

问题四:Flink CDC设置了环境变量不起作用怎么办?

Flink CDC设置了环境变量不起作用怎么办?

参考答案:

vim /etc/profile 设置环境变量后,记得source /etc/profile ,

ls一下这个目录

关于本问题的更多回答可点击进行查看:

https://developer.aliyun.com/ask/582235

问题五:Flink CDC有什么方案从mysql同步数据到mysql吗? 支持全量和增量的?

Flink CDC有什么方案从mysql同步数据到mysql吗? 支持全量和增量的?

参考答案:

阿里云dts吧,可以用flink-cdc 通过datastream的方式,手写同步通过jdbc写出去,或者sql(多少个任务,多少个insert,不支持ddl变更),亲测flink cdc stream api可以的,逻辑验证没问题,性能待验证 ,

关于本问题的更多回答可点击进行查看: