问题一:Flink CDC什么情况下会出现这种异常呢?

Flink CDC什么情况下会出现这种异常呢?

参考回答:

这个异常可能是由于以下原因导致的:

- Kafka连接问题:检查Kafka的地址、端口和Topic名称是否正确,以及Kafka是否正常运行。

- Doris连接问题:检查Doris的地址、端口、用户名、密码、数据库名和表名是否正确,以及Doris是否正常运行。

- 数据源或目标配置问题:检查Flink SQL中的Kafka数据源和Doris数据目标的配置是否正确。

- Debezium版本不兼容:确保Flink CDC使用的Debezium版本与MySQL和Doris的版本兼容。

- 网络问题:检查Flink、Kafka和Doris之间的网络连接是否正常。

为了解决这个问题,你可以尝试以下方法:

- 检查Kafka和Doris的日志,看是否有更详细的错误信息。

- 在Flink SQL中添加更多的调试日志,以便更好地了解问题所在。

- 尝试升级Flink CDC使用的Debezium版本,或者降级MySQL和Doris的版本,以找到一个兼容的组合。

关于本问题的更多回答可点击原文查看:

https://developer.aliyun.com/ask/575325

问题二:Flink CDC创建pg数据源,这个报错谁遇到过啊?

Flink CDC创建pg数据源,这个报错谁遇到过啊?org.postgresql.util.psqlexception: The connection attempt failed.

参考回答:

这个报错可能是由于以下原因导致的:

- PostgreSQL服务未启动或无法访问。请检查PostgreSQL服务是否已启动,以及防火墙设置是否允许Flink访问PostgreSQL服务。

- 连接参数错误。请检查Flink CDC创建pg数据源时使用的连接参数是否正确,包括主机名、端口号、数据库名、用户名和密码等。

- 网络问题。请检查Flink与PostgreSQL之间的网络连接是否正常,例如是否存在防火墙限制、路由器故障等。

- PostgreSQL版本不兼容。请确保Flink CDC支持的PostgreSQL版本与实际使用的版本一致。

- 权限问题。请检查Flink用户是否具有访问PostgreSQL数据库的权限。

关于本问题的更多回答可点击原文查看:

https://developer.aliyun.com/ask/575324

问题三:Flink CDC这个问题咋解决啊?

Flink CDC这个问题咋解决啊?Caused by: io.debezium.DebeziumException: Failed to deserialize data of EventHeaderV4{timestamp=1701093886000, eventType=EXT_UPDATE_ROWS, serverId=683728822, headerLength=19, dataLength=61, nextPosition=156730431, flags=0}

Caused by: com.github.shyiko.mysql.binlog.event.deserialization.EventDataDeserializationException: Failed to deserialize data of EventHeaderV4{timestamp=1701093886000, eventType=EXT_UPDATE_ROWS, serverId=683728822, headerLength=19, dataLength=61, nextPosition=156730431, flags=0}

Caused by: java.io.EOFException: Failed to read remaining 2 of 6 bytes from position 81814. Block length: 15. Initial block length: 57.

参考回答:

根据您提供的错误信息,这个问题可能是由于CDC库无法成功反序列化事件数据引起的。以下是一些解决这个问题的常见步骤和建议:

- 检查数据库连接:确保您连接到的MySQL数据库正常运行,并且网络连接正常。如果数据库或网络出现问题,可能会导致CDC库无法正确读取和解析binlog事件。

- 检查CDC版本:确认您使用的Flink CDC版本与MySQL数据库的版本兼容。某些CDC库可能对特定的MySQL版本有要求。

- 检查MySQL配置:确保MySQL数据库的binlog模式已启用,并且适当地配置了binlog格式和相关参数。CDC库依赖于MySQL的binlog来捕获和解析数据变更,因此正确的配置非常重要。

- 检查binlog日志文件:检查binlog日志文件是否完整和正确。如果文件损坏或数据不一致,CDC库可能无法正确解析其中的事件数据。

- 重新启动CDC应用程序:尝试重新启动Flink CDC应用程序,有时这可以解决一些临时的解析问题。

- 更新CDC库:如果问题持续存在,尝试升级或降级使用的CDC库版本。有时,特定版本的CDC库可能存在一些解析问题,通过切换到其他版本可能能够解决该问题。

- 联系社区或厂商支持:如果以上方法都无法解决问题,建议联系CDC库的开发者社区或厂商支持,向他们报告该问题并寻求专业的帮助和指导。

关于本问题的更多回答可点击原文查看:

https://developer.aliyun.com/ask/575307

问题四:Flink CDC使用postgresql cdc获取数据,有遇到这个问题的吗?

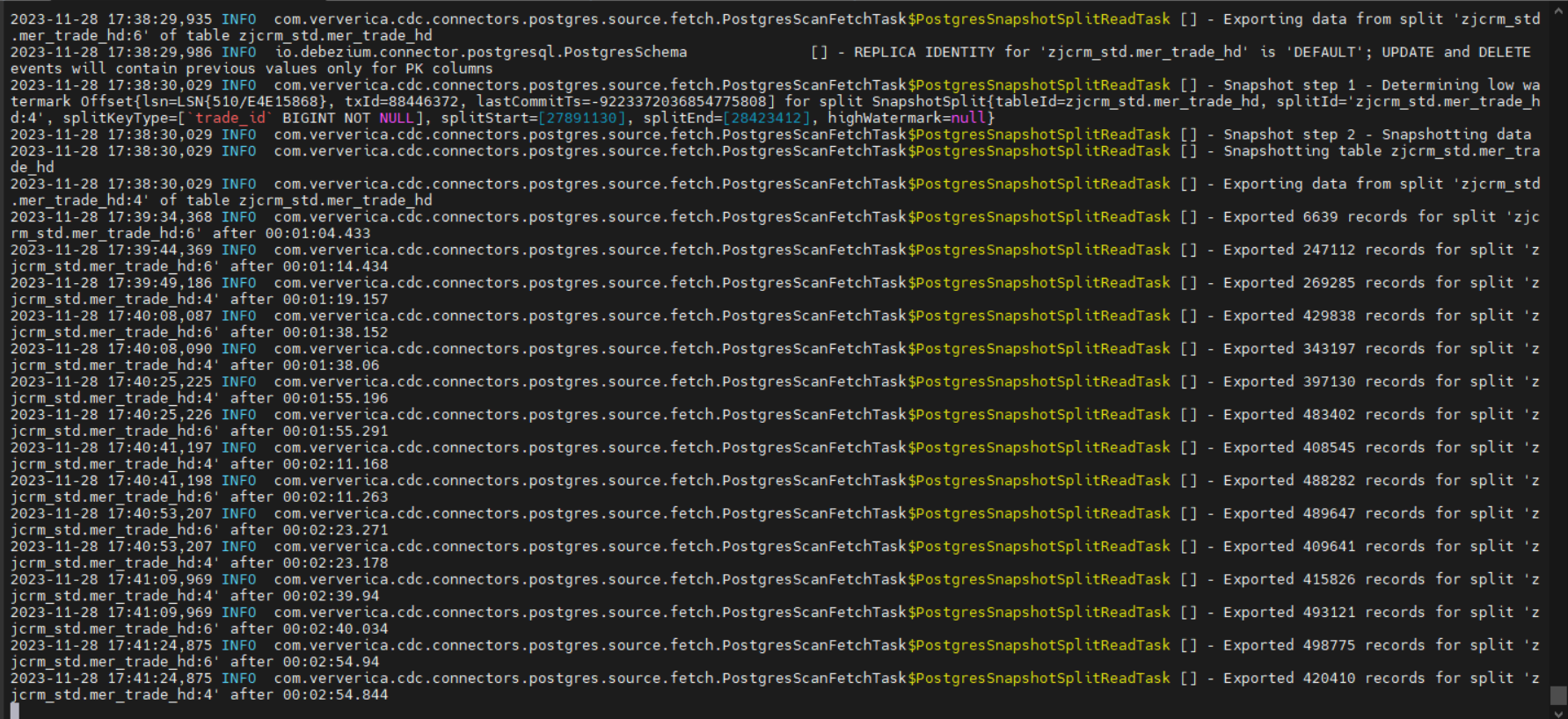

Flink CDC使用postgresql cdc获取数据,日志一直打印这个Exported 432162 records for split 'zjcrm_std.mer_trade_hd:4' after 00:03:44.535 ,最后直至task GC,有遇到这个问题的吗?

参考回答:

这个问题可能是由于Flink CDC在处理PostgreSQL CDC数据时遇到了性能问题。为了解决这个问题,你可以尝试以下方法:

- 增加Flink任务的并行度。这可以通过设置

taskmanager.numberOfTaskSlots参数来实现。例如,将其设置为4或更多,以便同时处理更多的记录。 - 调整Flink CDC的批处理大小。这可以通过设置

cdc.batch.size参数来实现。较大的批处理大小可能会提高性能,但也可能增加内存消耗。你可以根据你的资源限制来调整这个值。 - 优化PostgreSQL CDC的配置。例如,可以调整

max_replication_slots参数以允许更多的并发复制槽,或者调整wal_level和archive_mode参数以提高性能。 - 如果可能的话,尝试将数据分片到多个Flink任务中进行处理。这样可以减少单个任务的负载,从而提高整体性能。

- 检查你的Flink集群的资源使用情况,确保有足够的资源来处理CDC数据。如果资源不足,可以考虑增加节点或升级硬件。

关于本问题的更多回答可点击原文查看:

https://developer.aliyun.com/ask/575299

问题五:Flink CDC这个错误 是怎么回事?

Flink CDC这个错误 是怎么回事?Caused by: java.lang.IllegalStateException: The connector is trying to read binlog starting at Struct{version=1.6.4.Final,connector=mysql,name=mysql_binlog_source,ts_ms=1701152200970,db=,server_id=0,file=mysql-bin.001164,pos=121562280,row=0}, but this is no longer available on the server. Reconfigure the connector to use a snapshot when needed.2.3.0版本的腾讯云的 mysql

参考回答:

这个错误是由于Flink CDC连接器试图读取MySQL的binlog,但是该binlog在服务器上已经不存在了。具体来说,连接器正在尝试读取一个起始于Struct{version=1.6.4.Final,connector=mysql,name=mysql_binlog_source,ts_ms=1701152200970,db=,server_id=0,file=mysql-bin.001164,pos=121562280,row=0}位置的binlog,但是在服务器上找不到该文件。

为了解决这个问题,可以尝试以下方法:

- 重新配置连接器以使用快照(snapshot)模式。这样,连接器将不再依赖于binlog的位置,而是直接从指定的快照时间点开始读取数据。要启用快照模式,可以在Flink CDC连接器的配置中添加以下参数:

"connector.class": "io.debezium.connector.mysql.MySqlConnector", "tasks.max": "1", "snapshot.mode": "whenever", "snapshot.interval": "60000", "snapshot.timeout": "60000", "snapshot.retries": "30", "snapshot.delay": "3000", "database.whitelist": "your_database_name", "table.whitelist": "your_table_name",

其中,snapshot.mode设置为whenever表示启用快照模式,snapshot.interval和snapshot.timeout分别表示快照之间的间隔时间和超时时间,可以根据实际需求进行调整。其他参数也需要根据实际情况进行配置。

- 如果不想使用快照模式,可以尝试删除已存在的binlog文件,然后重新启动连接器。但请注意,这种方法可能会导致数据丢失。

关于本问题的更多回答可点击原文查看: