暂无个人介绍

自8月11日开源了第一版本证件照后,FaceChain迎来了最大版本的更新,不仅集中上线了一波非常有用的功能,在gradio界面上也做了大幅度优化

传统视频目标检测(Video Object Detection, VOD)任务以一段视频作为输入,利用视频的时序信息进行目标检测,并最终输出每一帧视频帧的检测结果。

在过去的不到一个月,FaceChain开源项目从无到有,成功突破了相关技术瓶颈,GitHub(https://github.com/modelscope/facechain)获得了超过4.6K star,为未来的应用发展奠定了坚实的基础。

百川智能宣布正式发布并开源Baichuan 2!开源包括Baichuan 2-7B、Baichuan 2-13B、Baichuan 2-13B-Chat与其4bit量化版本,并且均为免费可商用。

9月4日,OpenBuddy发布700亿参数跨语言大模型 OpenBuddy-LLaMA2-70B,并以可商用的形态全面开源!现在已经全面上架魔搭ModelScope社区。

魔搭社区推出适配开源大语言模型(LLM)的AI Agent(智能体)开发框架ModelScope-Agent。

最近魔搭上线了一项新能力——用手机环拍物体1min视频即可生成3D模型

这是一段特效短片,虽然只有四秒,但它在推特上斩获了十多万浏览。

SeqGPT是一个不限领域的文本理解大模型。无需训练,即可完成实体识别、文本分类、阅读理解等多种任务。该模型基于Bloomz在数以百计的任务数据上进行指令微调获得。模型可以在低至16G显存的显卡上免费使用。目前SeqGPT已经在魔搭社区开源,欢迎体验!

日常我们在艺术创作和产品设计中,需要多张风格相似的图片

酷蛙FaceChain项目计划后续联合社区的力量不断打磨该开源项目,解锁更多高阶玩法(比如人物表情包、人物连环画故事、虚拟试衣间……),并进行更深层次的算法创新,发表相应顶会论文。

近期,通义千问大规模视觉语言模型Qwen-VL上线魔搭社区,Qwen-VL以通义千问70亿参数模型Qwen-7B为基座语言模型研发,支持图文输入,具备多模态信息理解能力。

近期,一条由AI全流程制作的《流浪地球3》预告短片大火,不禁让人惊叹一把生成式AI真的有在悄悄惊艳所有人,也给AI驱动视频创作市场提供了更大的想象空间。

带你制作大片

8月21日,由中国工程院院刊《Engineering》、中国人工智能学会、中国工程院院刊信息与电子工程领域分刊《FITEE》联合主办的Engineering大讲堂暨“智行中国”第五期系列论坛在浙江大学举行,论坛围绕基座模型基础理论、AI+X垂直领域赋能应用及基座模型评测体系等问题邀请领域专家展开了深入探讨。

在魔搭社区,通义千问团队发布了Qwen-7B-Chat的Int4量化模型,Qwen-7B-Chat-Int4。该方案的优势在于,它能够实现几乎无损的性能表现,模型大小仅为5.5GB,内存消耗低,速度甚至超过BF16。

近日,在上海人工智能实验室发布的多模态大模型榜单MMBench中,来自达摩院的mPLUG-Owl 超过MiniGPT4,LLaVA,VisualGLM等14个多模态大模型,登顶榜首。目前,mPLUG-Owl最新的预训练,SFT模型都已在ModelScope开源,欢迎大家体验。

酷蛙FaceChain开源项目(https://github.com/modelscope/facechain)上线首周即获取超过3K Star,并登顶GitHub Trending榜单TOP 1。

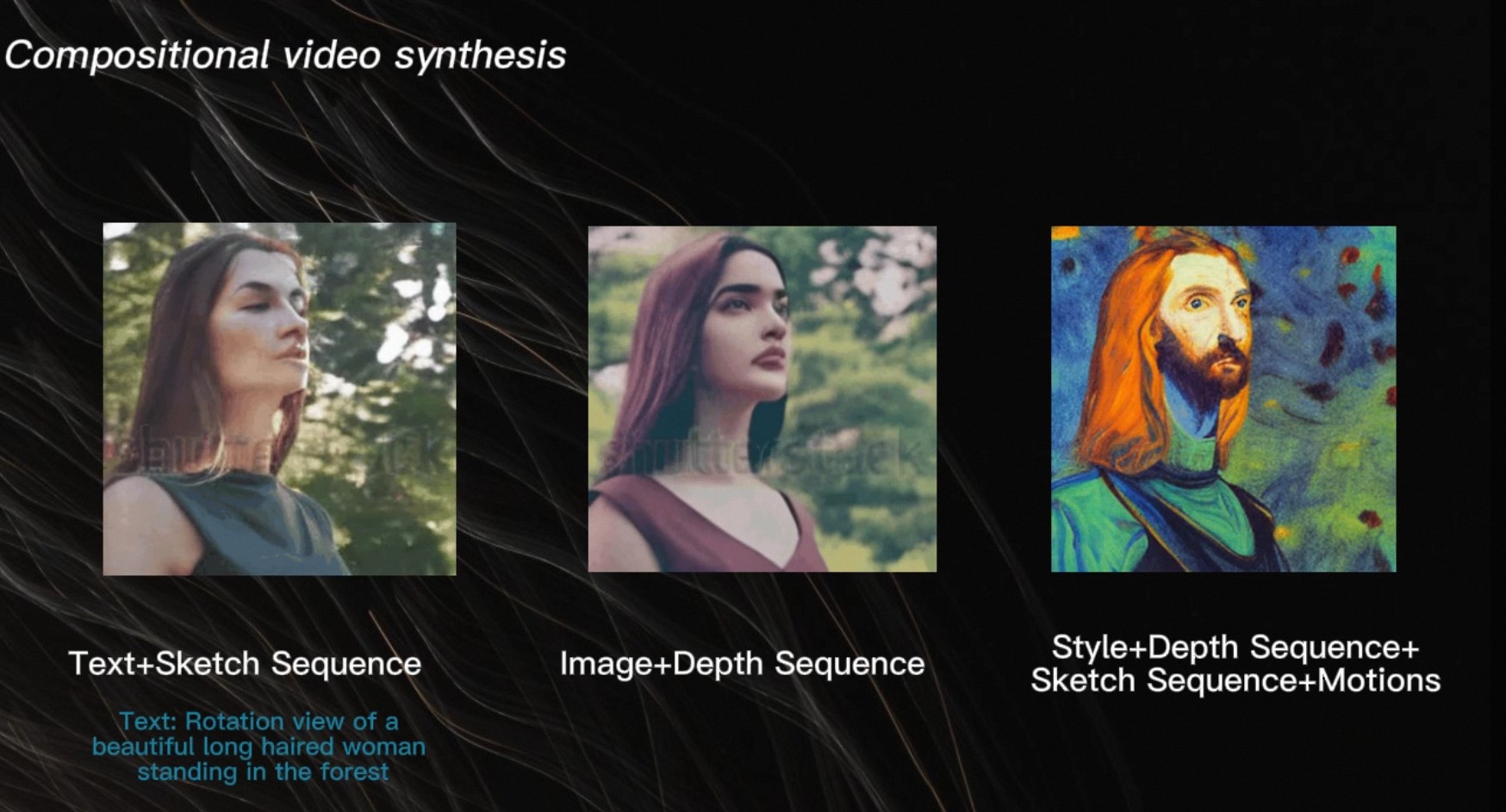

8月16日,时间、空间可控的视频生成模型 VideoComposer 在魔搭社区开源。

魔搭社区发布了一个名为“InsTagger”的工具,用于分析LLM(大语言模型)中符合人类偏好的监督微调(SFT)数据。InsTagger 是基于 InsTag 方法训练的本地指令标签标注器,用于为符合人类偏好的监督微调数据集中的指令标注描述其意图和语义的标签,从而指导指令的分流或监督微调数据集的分析。

上期,我们介绍了通义千问7B模型的微调+部署方式,但在实际使用时,很多开发者还是希望能够结合特定的行业知识来增强模型效果,这时就需要通过外接知识库,让大模型能够返回更精确的结果。

8月,魔搭社区联合香港中文大学(深圳)、深圳市大数据研究院、阿里云开发者社区、阿里云开发者评测发布中文竞技场大模型评测活动,汇聚了包括Baichuan-13B、ChatGLM2-6B、Qwen-Chat-7B、moss-moon-003-sft、Ziya-LLaMa-13B-v1等十余款开源大模型在中文对话场域同台PK。

OpenBuddy继接连开源OpenBuddy-LLaMA1-13B、OpenBuddy-LLaMA1-30B后,8月10日,一鼓作气发布了650亿参数的大型跨语言对话模型 OpenBuddy-LLaMA1-65B。

各类AI写真软件由于其精准的个人形象+精美的生成效果引爆了朋友圈传播,证件照满足了用户刚需,古装照等风格照满足了用户“美照”的需求。

最近魔搭上线了一项新能力——仅需输入单张人像照片,利用文字或语音驱动即可秒级生成数字人AI视频!这让小编的短视频UP梦又重新启航燃起了希望!它完全解救了社恐星人,图生视频能力替你说话、唱歌、讲段子、吟诗....无需再对着摄像头NG,一整个绝绝子叠buff!

心理大模型——漫谈(MindChat)期望从心理咨询、心理评估、心理诊断、心理治疗四个维度帮助人们纾解心理压力与解决心理困惑,提高心理健康水平。

通义千问开源!阿里云开源通义千问70亿参数模型,包括通用模型Qwen-7B-Base和对话模型Qwen-7B-Chat,两款模型均已上线ModelScope魔搭社区,开源、免费、可商用,欢迎大家来体验。

来魔搭社区,探索超赞的SDXL 1.0画图功能!

魔搭社区每周速递(7.20-7.26)

openBuddy基于LLaMA2跨语言对话模型首发魇搭社区!

openBuddy基于LLaMA2跨语言对话模型首发魇搭社区!

编程助手 | CodeGeeX2-6B模型发布及魔搭最佳实践

AI谱曲 | 基于RWKV的最佳开源AI作曲模型魔搭推理实践

魔搭社区每周速递(7.13-7.19)

LLaMA 2系列来啦!内含魔搭最佳实践

LLaMA 2系列来啦!内含魔搭最佳实践

Stable Diffusion模型魔搭最佳实践:训一只你的萌柯基

ChatGLM2-6B模型发布及魔搭最佳实践

百川13B模型发布及魔搭最佳实践

国内首发,百川13B大模型上架魔搭

AI人像动漫

AI人像动漫

图像(目标)检测入门理论课程

图像(目标)检测入门理论课程

人脸检测实战

底层视觉与黑白图像上色

底层视觉与黑白图像上色

图像分类基础与实战(1)

图像分类基础与实战

图像分类基础与实战

发表了文章

2024-05-15

发表了文章

2024-05-15

发表了文章

2024-05-15

发表了文章

2024-05-15

发表了文章

2024-05-15

发表了文章

2024-05-15

发表了文章

2024-05-15

发表了文章

2024-05-15

发表了文章

2024-05-15

发表了文章

2024-05-15

发表了文章

2024-05-15

发表了文章

2024-05-15

发表了文章

2024-05-15

发表了文章

2024-05-15

发表了文章

2024-05-15

发表了文章

2024-05-15

发表了文章

2024-05-15

发表了文章

2024-05-15

发表了文章

2024-05-15

发表了文章

2024-05-15

发表了文章

2024-05-15

发表了文章

2024-05-15

发表了文章

2024-05-15

发表了文章

2024-05-15

发表了文章

2024-05-15

发表了文章

2024-05-15

发表了文章

2024-05-15

发表了文章

2024-05-15

发表了文章

2024-05-15

发表了文章

2024-05-15

发表了文章

2024-05-15

发表了文章

2024-05-15

发表了文章

2024-05-15

发表了文章

2024-05-15

发表了文章

2024-05-15

发表了文章

2024-05-15

发表了文章

2024-05-15

发表了文章

2024-05-15

发表了文章

2024-05-15

发表了文章

2024-05-15

提交了问题

2024-05-27

提交了问题

2024-05-27

提交了问题

2023-09-27

提交了问题

2023-09-27

回答了问题

2022-11-08

回答了问题

2022-11-08

提交了问题

2022-11-07

提交了问题

2022-11-07

提交了问题

2022-11-07

提交了问题

2022-11-07

提交了问题

2022-11-07

提交了问题

2022-11-07

提交了问题

2022-11-07

提交了问题

2022-11-07

提交了问题

2022-11-07

提交了问题

2022-11-07

提交了问题

2022-11-07

提交了问题

2022-11-07

提交了问题

2022-11-07

提交了问题

2022-11-07

提交了问题

2022-11-07

提交了问题

2022-11-07

提交了问题

2022-11-07

提交了问题

2022-11-07

提交了问题

2022-11-07

提交了问题

2022-11-07

提交了问题

2022-11-07

提交了问题

2022-11-07

提交了问题

2022-11-07

提交了问题

2022-11-07

提交了问题

2022-11-07

提交了问题

2022-11-07

提交了问题

2022-11-07

提交了问题

2022-11-07

回答了问题

2022-11-07

回答了问题

2022-11-07

回答了问题

2022-11-07

回答了问题

2022-11-07

回答了问题

2022-11-07

回答了问题

2022-11-07