引言

上一篇中,我们了解了高质量数据集建设的政策蓝图、核心分类与“场景驱动”的逻辑框架。然而,从认知到落地,挑战往往隐藏在具体的实施环节中,如何将模糊的业务需求转化为精确的数据指标?如何在多源异构的数据中确保质量与一致性?这里我们将深入建设一线,剖析从需求转化、数据规划到采集处理的全流程实战经验。

建设管理模式

在开始建设时,我们务必要先确立建设管理模式、建设目标和整体架构。这里先说建设管理模式。

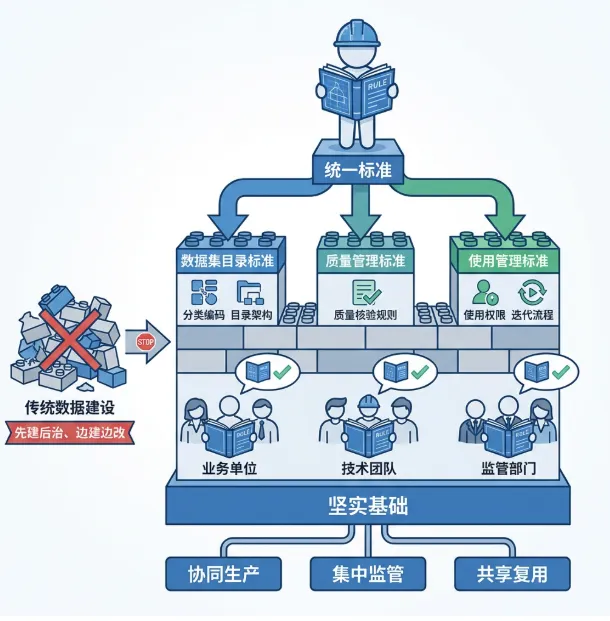

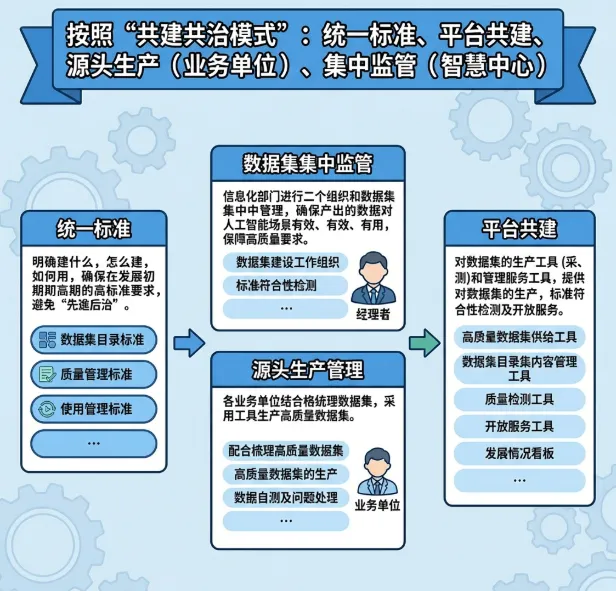

结合高质量数据集建设的全流程需求与多主体协同的实际场景,需要采用共建共治模式作为核心管理架构,以统一标准、平台共建、源头生产、集中监管为核心运行原则,从规划设计、数据生产、质量管控到工具支撑形成全链条闭环,从顶层设计上规避分散建设、标准不一、监管缺失、重复建设等行业共性问题,让数据集建设从零散无序走向体系化、标准化、长效化。

前期要做的第一件事就是要统一标准,明确建什么、怎么建、如何用,以高标准、严规范锚定整体建设方向,从源头杜绝传统数据建设中 “先建后治、边建边改” 的被动局面。系统性制定数据集目录标准、质量管理标准、使用管理标准等全套规范文件,对数据集的分类编码、目录架构、质量核验规则、使用权限、迭代流程做出统一界定,让所有参与建设的业务单位、技术团队、监管部门都有统一的执行依据,确保不同场景、不同领域产出的数据集在基础规范上保持一致,这样才能为后续的协同生产、集中监管、共享复用打下坚实基础。

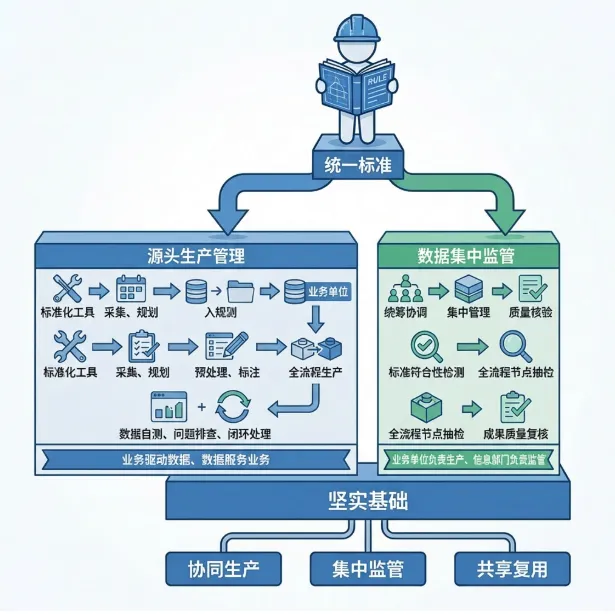

在统一标准的约束下,我们将数据生产环节下沉至源头生产管理,明确各业务单位作为数据生产的核心主体,依托自身对业务场景、实际需求的深度理解,针对性梳理适配场景的高质量数据集,借助标准化工具完成数据集的采集、规划、预处理、标注等全流程生产工作,同时自主开展数据自测、问题排查与闭环处理,让数据生产贴合真实业务逻辑,避免技术团队脱离场景盲目造数,真正实现 “业务驱动数据、数据服务业务” 的初衷,也与前文场景驱动、需求先行的建设逻辑形成高度呼应。

同时,同步搭建数据集集中监管体系,由信息化部门牵头组建专项建设工作组织,承担统筹协调、集中管理、质量核验的核心职责。通过开展标准符合性检测、全流程节点抽检、成果质量复核等工作,对业务单位生产的数据集进行全方位监管核查,确保每一份产出的数据都符合既定标准,能够真正适配人工智能场景的训练、微调与推理需求,保障数据集的有效性与实用性,构建 “业务单位负责生产、信息部门负责监管” 的权责清晰、双向制衡的管理机制。

整个流程最终也会落地成一个大平台,将共建共治的制度要求、标准规范转化为可操作、可落地的数字化工具能力,围绕数据集生产全流程搭建高质量数据集供给工具、目录内容管理工具、质量检测工具、开放服务工具及发展情况看板等核心模块,全面覆盖采、处、标、测全生产环节,同时提供标准检测、开放共享、动态管控、进度可视化等配套服务。

建设目标

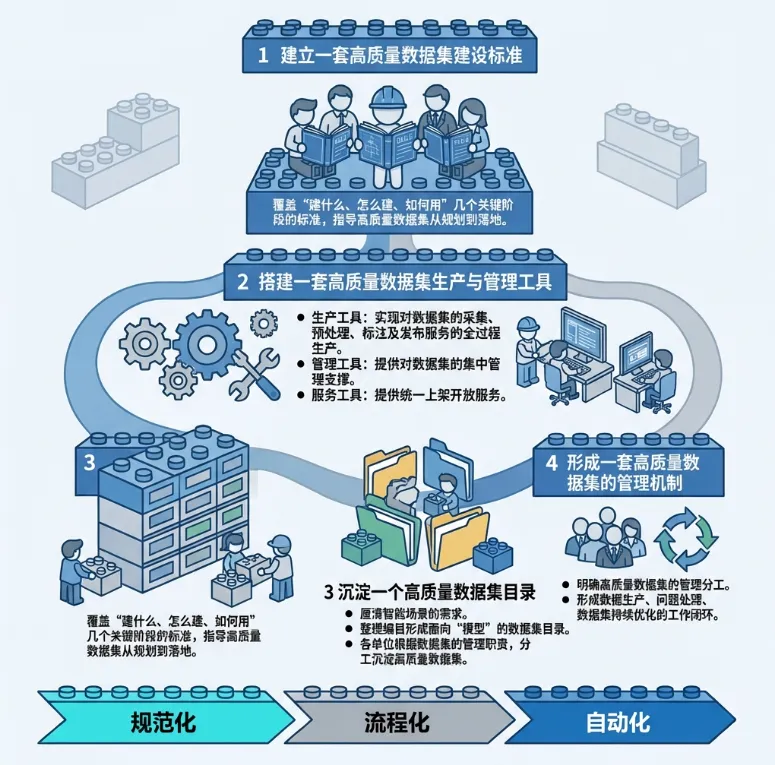

在确立共建共治的建设管理模式后,接下来需要明确核心建设目标,即构建高质量数据集协同共建共治体系,以规范化为基础、流程化为支撑、自动化为方向,通过四大核心任务层层推进,让数据集建设从零散无序走向体系闭环,实现标准、工具、目录、机制的全面打通,为 AI 场景落地提供全维度的数据保障。

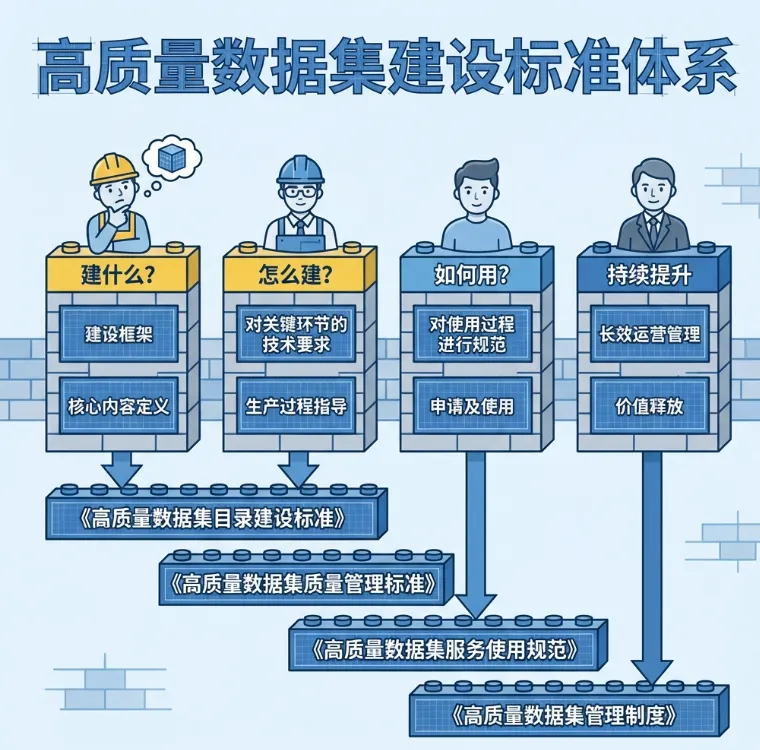

第一项核心任务,是建立一套高质量数据集建设标准,覆盖 “建什么、怎么建、如何用” 全关键阶段,从顶层规划到落地执行形成完整的标准指引体系。这套标准将贯穿需求调研、数据规划、采集预处理、标注验证全流程,明确各类数据集的建设规范、质量要求、使用准则,让所有参与建设的主体都有统一的执行依据,在项目初期就锚定高标准要求,彻底规避传统建设中标准混乱、无规可依的问题,以标准化为根基,为后续所有建设工作划定统一框架,这也是共建共治模式能够落地的核心前提。

在标准体系的支撑下,第二项核心任务是搭建一套高质量数据集生产与管理工具,将标准化流程转化为可实操、可落地的数字化工具能力,分为生产、管理、服务三大核心模块。生产工具聚焦数据集全生命周期作业,覆盖采集、预处理、标注、发布服务全环节,让数据生产环节线上化、高效化;管理工具提供集中化的管控支撑,实现对数据集的统一统筹、质量监测、过程管控;服务工具则打通数据复用链路,提供统一的上架、开放、调用服务,通过工具化赋能,让数据集建设从人工粗放式操作,转向高效便捷的数字化作业,为流程化落地提供技术载体。

第三项核心任务,是沉淀一个高质量数据集目录,立足智能场景的真实需求,完成目录的系统性梳理与搭建,打造面向模型、适配场景的专属数据集目录。一方面深度厘清各智能场景对数据的类型、粒度、质量需求,让目录内容与场景、模型高度适配;另一方面按照各单位的管理职责分工,分领域、分场景有序沉淀数据集,打破数据孤岛,形成可查询、可复用、可迭代的统一数据目录,让分散在各业务单位的数据集实现集中归集、统一管理,让数据资产从 “隐性” 变为 “显性”,为数据的规模化复用打下基础。

最后,通过前三步的建设积累,最终形成一套高质量数据集的管理机制,明确全流程的管理分工,厘清各部门、各单位在数据集建设、监管、使用、迭代中的权责边界。同时搭建起 “数据生产、问题处理、数据集持续优化” 的完整工作闭环,以闭环机制驱动数据集动态迭代更新,结合场景变化、模型升级、需求迭代持续优化数据内容与质量,让数据集建设从 “一次性建设” 转向 “长效化运营”。

总体架构

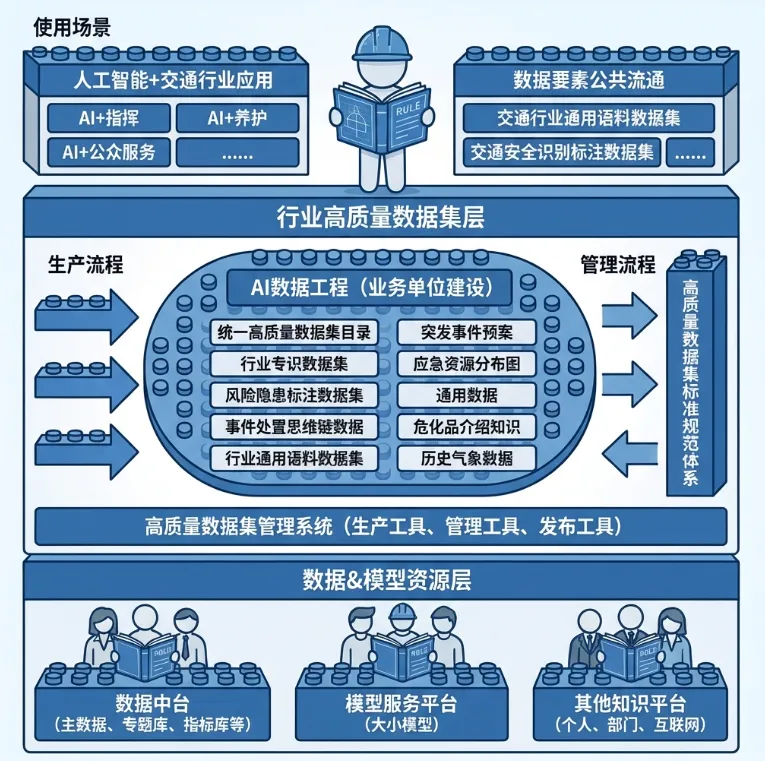

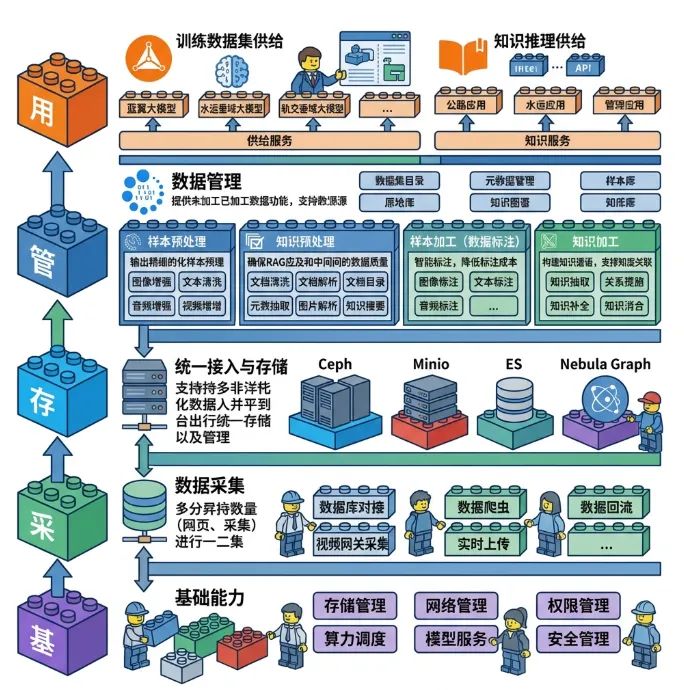

总体架构图基本示意图如下:

一套标准,完善内部“高质量数据集”的标准规范

根据上一篇文章中提到的《高质量数据集目录建设标准》、《高质量数据集质量管理标准》、《高质量数据集服务使用规范》、《高质量数据集管理制度》,需要逐步构建起自己内部的高质量数据集标准规范,主要阶段及依据如下图所示:

标准规范示例格式如下:

1 范围

2 规范性引用文件

3 术语和定义

3.1 模型

3.2 高质量数据集

3.3 元数据

3.4 值域

3.5 数据标注

4 高质量数据集总体定义

4.1 高质量数据集内容框架

4.2 高质量数据集分类体系

4.3 高质量数据集分级要求

4.4 高质量数据集编目要求

5 行业通识数据集

5.1 XX数据集1

5.1.1 基本信息:名称/内容介绍/分类分级

5.1.2 适用场景

5.1.3 数据信息:数据集内容

5.1.4 源头管理信息

5.2 xxx数据集2

6 行业专识数据集

6.1 xxx数据集1

7 附件1:数据集样例

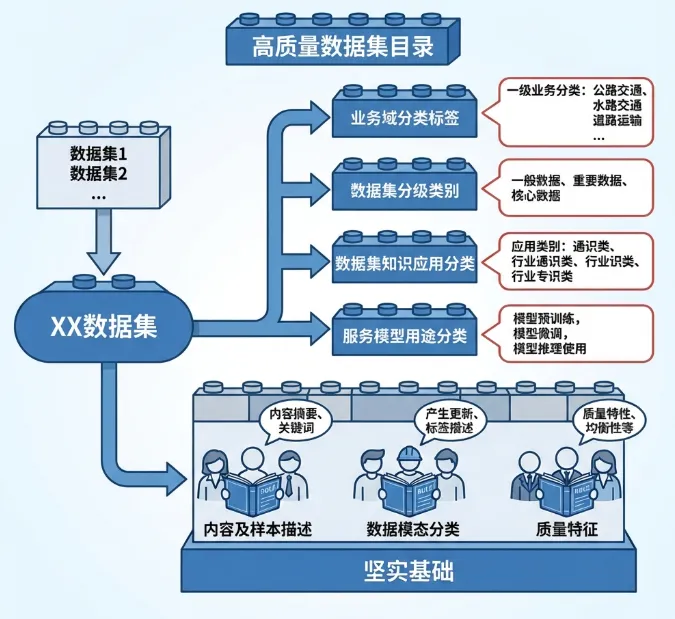

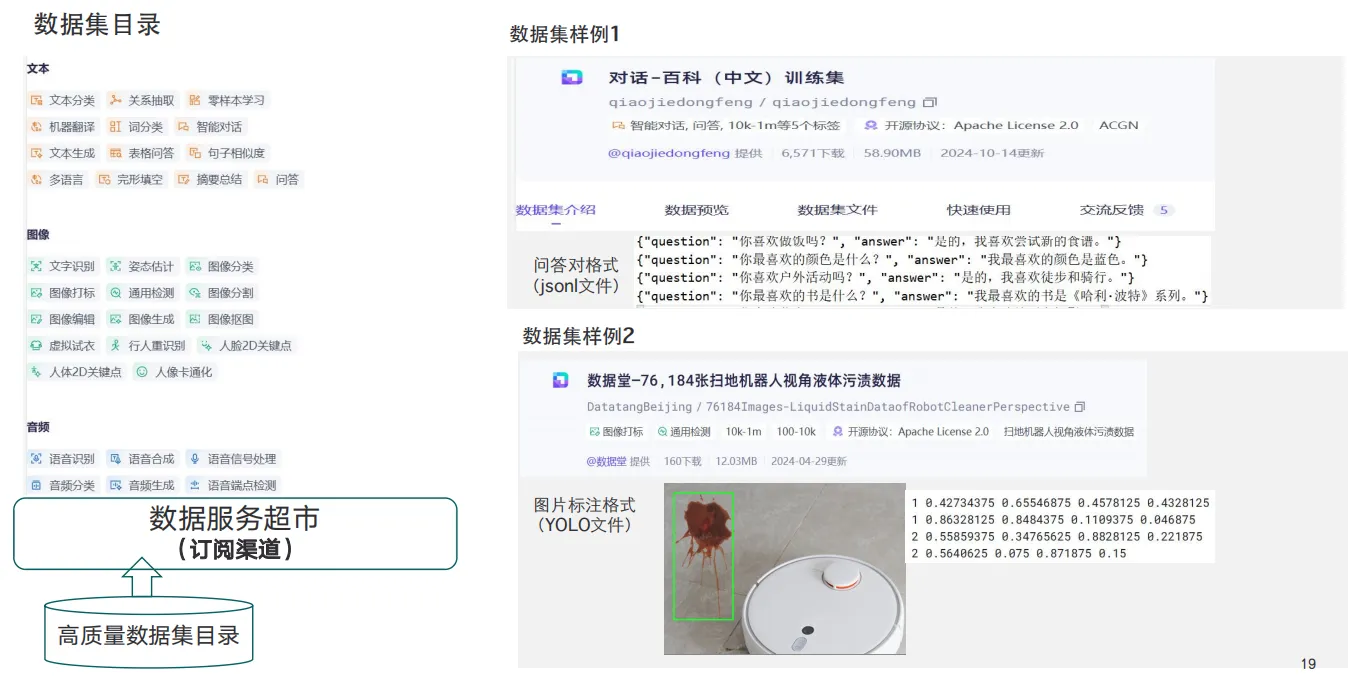

一个目录,包含信息资源分类分级属性+高质量数据集特有属性

高质量数据集目录的建设,并非是简单罗列数据集名称,而是包含信息资源分类分级属性+高质量数据集特有属性两大部分。

信息资源分类分级属性,是数据集的 “身份标签”,从业务归属、重要程度、知识深度、模型用途四大维度,清晰界定每一份数据的定位,主要包含以下内容:

业务域分类标签:从一级业务分类(公路交通、水路交通、道路运输等)延伸至二级业务场景类(公路建设管理、公路养护管理、道路货运管理等),精准锚定数据集所属的业务场景,让使用者能快速定位到对应业务领域的数据,解决 “数据属于哪个业务” 的核心问题,让数据供给与业务需求精准对接。

数据集分级类别:按照一般数据、重要数据、核心数据进行分级,明确数据的重要程度与管控要求,为数据安全管理、权限管控提供直接依据,既保障核心数据的合规使用,也让不同级别的数据适配不同场景的开放需求。

数据集知识应用分类:划分为通识类、行业通识类、行业专识类,清晰界定数据集的知识深度与应用范围 ( 通识类数据可支撑通用模型训练、行业通识类覆盖行业共性知识、行业专识类则聚焦垂直场景的专业能力),让数据供给与模型的能力需求精准匹配。

服务模型用途分类:明确数据集用于模型预训练、模型微调、模型推理使用等不同用途,完美贴合前文 “围绕模型全生命周期供给数据” 的核心逻辑,让目录能直接指引数据在模型不同阶段的适配使用,避免 “数据与模型用途脱节” 的问题。

扩展编目属性域,即高质量数据集特有属性,从内容描述、模态特征、质量水平三大维度,让数据的核心信息一目了然,主要包含以下内容:

内容及样本描述:通过内容摘要、关键词、产生 / 更新时间、时间跨度、样本特征、标签描述等信息,让使用者在未接触原始数据前,就能快速了解数据集的核心内容、覆盖范围与样本特点,大幅降低数据发现与评估的成本,提升数据选型效率。

数据模态分类:从数据模态(单模态、多模态)、模态构成(文本、图像、音频、视频、多模态)以及质量基本要求(文件大小、编码格式、清晰度等)进行界定,明确数据的形态与适配场景(比如多模态数据集可支撑多模态大模型训练,图像数据则适配视觉类模型的需求),让数据形态与模型能力形成精准匹配。

质量特征:从完整性、准确性、一致性、多样性、均衡性等维度刻画数据质量,将前文抽象的数据质量模型具象化,让每一份数据集的质量水平可量化、可评估,为模型训练前的数据选型提供明确依据,从源头保障模型训练的效果。

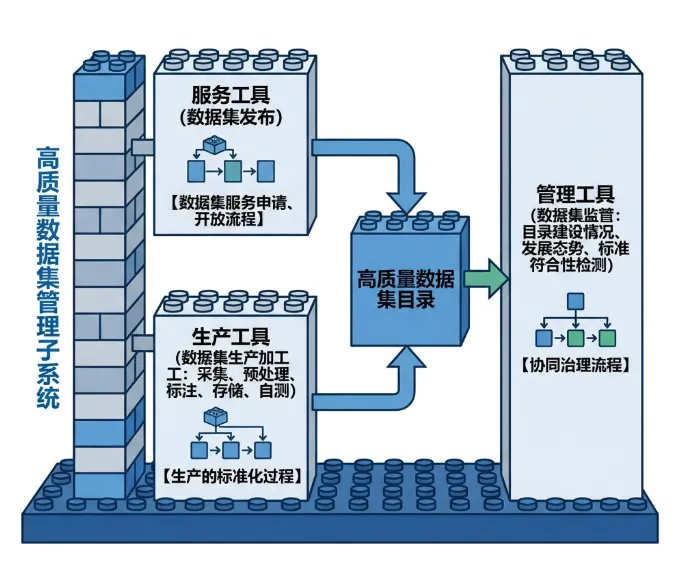

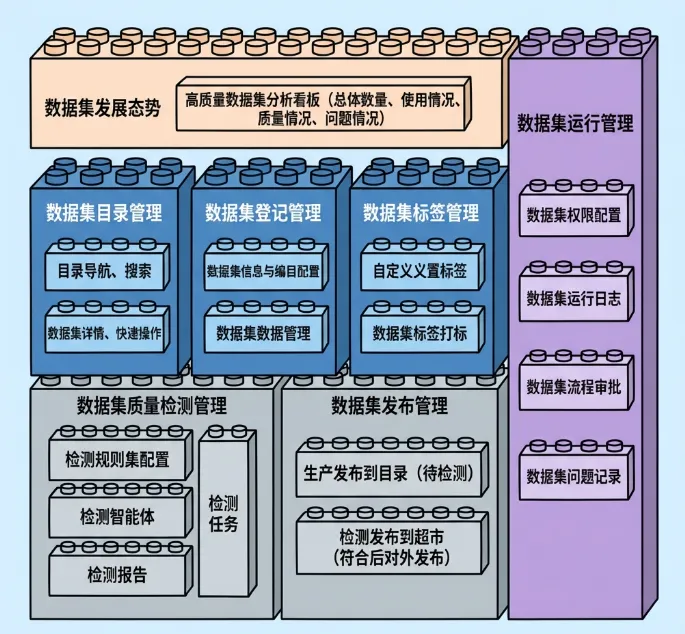

一套工具,围绕数据集目录建设,工具支撑生产、管理及服务业务流程开展

高质量数据集的管理与应用不再依赖人工经验,而是通过高质量数据集管理子系统实现全流程数字化、标准化管控。这套系统以 “生产 - 服务 - 管理” 三大工具模块为核心,以高质量数据集目录为纽带,将之前的共建共治理念、标准规范、目录编目全部转化为可落地的数字化能力,形成 “生产有标准、服务有流程、管理有抓手” 的闭环体系。

生产工具聚焦数据集的全流程生产加工,覆盖采集、预处理、标注、存储、自测全环节,核心是将 “生产的标准化过程” 固化为系统能力。它会严格遵循统一建设标准,自动对接数据源完成采集,按照预设规则开展数据清洗、特征提取等预处理,规范标注流程与质量校验,同时内置数据自测模块,对照数据质量模型完成完整性、准确性等维度的自检,从源头确保每一份产出的数据集都符合目录规范与质量要求,让数据生产从 “人工粗放式” 转向 “系统标准化”。

服务工具以 “数据集发布” 为核心,承载数据集服务申请、开放流程,让数据集从 “可用” 升级为 “易用”。它依托高质量数据集目录,为用户提供精准检索、权限申请、合规开放等全流程服务 —— 使用者可通过业务域、模型用途、数据模态等维度快速定位目标数据集,提交申请后系统自动完成权限审核,通过标准化流程实现数据的安全开放,同时记录数据使用轨迹,为后续优化与溯源提供依据,让数据复用更高效、更合规。

管理工具承担数据集全生命周期监管职责,覆盖目录建设情况、发展态势、标准符合性检测,核心是落地 “协同治理流程”。它会实时监控各业务单位的数据集生产进度与质量,自动检测数据集是否符合目录编目标准与质量管理规范,通过可视化看板呈现整体发展态势,一旦发现问题便触发协同治理流程,协调责任单位完成整改,确保共建共治模式高效运转,让数据管理从 “事后补救” 转向 “事前管控、事中监测”。

三大工具模块并非孤立运行,而是以高质量数据集目录为核心纽带深度协同:生产工具产出的数据集自动同步至目录并完成多维度属性标注,服务工具基于目录提供精准检索与开放服务,管理工具通过目录实现全量数据的态势感知与合规管控。这种 “目录为核、工具赋能” 的架构,彻底打破了传统数据管理中 “生产分散、服务零散、管理滞后” 的痛点,将标准化流程、协同治理机制、目录编目能力全部嵌入系统,让高质量数据集的建设从 “人工驱动” 转向 “系统驱动”,既提升了生产效率与质量,又保障了数据的安全合规与高效复用,为协同共建共治体系提供了坚实的技术支撑,让数据真正成为 AI 场景落地的核心动能。

未完待续~