几个世纪以来,人类一直在试图了解大脑是如何工作的,以及它是如何获取信息的。虽然神经科学家现在已经很好地了解了大脑的不同部分是如何工作的以及它们的功能是什么,但仍有许多问题没有得到解答。因此,仍然缺乏统一的神经科学理论。近年来,计算机科学家一直在尝试创建出能够人工重建人脑功能和过程的计算工具。加拿大莱斯布里奇大学(University of Lethbridge)的研究人员最近进行了一项研究,调查单个神经元如何学习和预测未来。表明单个神经元预测其未来活动的能力可以提供一种新的学习机制。该研究结果以「Neurons learn by predicting future activity」为题,于 2 月 25 日发表在《Nature Machine Intelligence》上。「神经科学现在所处的阶段和生物学在达尔文之前所处的阶段一样,」该研究的研究人员之一 Artur Luczak说。「它有无数详细的观察结果,但没有一个理论可以解释它们之间的联系。因此,神经科学的一大任务是找到统一的原则来解释大脑是如何工作的。我们的工作旨在为这一探索做出贡献。」更好地理解大脑使用的学习算法可能是发展统一的大脑功能理论的核心。研究大脑学习机制的主要方法有两种:(1)实验性的,神经元活动的持续变化是由特定干预引起的;(2)计算性的,开发算法以实现特定的计算目标,同时仍然满足选定的目标生物限制。在这篇文章中,研究人员探索了一个额外的选项(3)理论推导,其中学习规则来自基本的细胞原理,即来自最大化细胞的代谢能量。有多种证据表明大脑是作为一个预测系统运作的。然而,关于如何在大脑中实现精确的预测编码仍然存在争议。大多数提出的模型假设一个预测电路,但研究人员提出了一个替代方案,其中神经元中有一个内部预测模型。建议使用预测学习规则的单个神经元可以提供一个基本单元,从中可以构建各种预测性大脑。有趣的是,研究人员提出的预测学习规则也可以通过修改时间差异学习算法来获得,使其在生物学上更合理。时间差异学习是关于如何在大脑中实现类似反向传播的算法的最有希望的想法之一。它基于使用神经元活动的差异来近似自上而下的误差信号。这种算法的一个典型例子是对比赫布(Hebbian)学习,它被证明在某些假设下等同于反向传播。

图示:算法的基础。(来源:论文)

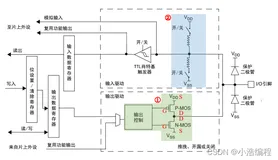

预测学习规则和对比赫比学习对比 Hebbian 学习算法要求网络在两个独立的学习阶段收敛到稳态平衡,因此必须呈现两次完全相同的刺激。然而,在实际大脑中不太可能出现这种情况。在这里,研究人员建议通过将两个活动阶段合二为一来解决这个问题,这是受到皮层感觉处理的启发。这里的新见解是,最初的自下而上活动足以让神经元预测自由相活动的稳态部分,然后可以将预测的自由相和钳制相(clamped phase)之间的不匹配用作教学信号。为了验证神经元能否正确预测未来的自由相活动,研究人员仔细研究了样本神经元。研究表明预测学习规则运作良好,每个神经元准确地预测了其未来的活动。图示:预期活动的神经元预测。(来源:论文)此外,还在多个其他网络架构中测试了预测学习规则,这些架构旨在反映生物神经元网络的其他方面。研究表明所提预测学习规则在各种生物驱动的网络架构中表现良好。

图示:在多层卷积神经网络中实现预测学习规则。(来源:论文)

清醒动物的预测学习规则验证为了测试真正的神经元是否也可以预测它们未来的活动,研究人员分析了来自清醒大鼠听觉皮层的神经元记录。作为刺激,呈现了六个音调,每个音调长 1 秒,并穿插 1 秒的静默,连续重复超过 20 分钟。对于六种音调中的每一种,分别计算了平均起始和偏移响应,为每个神经元提供了 12 种不同的活动曲线。对于每个刺激,15-25 ms 时间窗口中的活动用于预测 30-40 ms 窗口内的平均未来活动。

图示:预测皮层神经元的未来活动。(来源:论文)

研究表明神经元具有可预测的动态,并且从最初的神经元反应,可以估计它们未来的活动。然而,通过预测皮质活动的长期变化提供了支持学习规则的更有力的证据。重要的是,根据所提模型,可以推断出哪些单个神经元会增加,哪些神经元会降低其放电率。图示:模型和皮质神经元中神经元活动的长期变化。(来源:论文)该研究可能对神经科学和机器学习领域产生许多有趣的影响。总体而言,他们的研究结果表明,支持单个神经元功能的预测机制可能在学习中发挥关键作用。「在未来,这个想法还可能有助于创建更强大的人工神经网络来解决具有挑战性的现实生活问题,」Luczak 说。「我相信我们公布的预测学习规则是朝着找到统一的大脑理论迈出的重要一步。然而,实现这一目标还需要更多的步骤,我们很高兴能继续这一旅程。」

论文链接:https://www.nature.com/articles/s42256-021-00430-y

参考内容:https://techxplore.com/news/2022-02-individual-neurons-future.html