各位大佬辛苦帮忙看下ModelScope这个问题。我在damo/nlp_gpt3_text-generation_1.3B这个模型的基础上进行二次开发训练,但是使用训练后的模型进行预测结果跟没有训练的模型是一模一样的,这个是什么原因呢。loss是在收敛的。是训练数据太少吗。还是预测时候引入的模型不对。 参照的是这个文档:https://www.modelscope.cn/models/damo/nlp_gpt3_text-generation_1.3B/summary

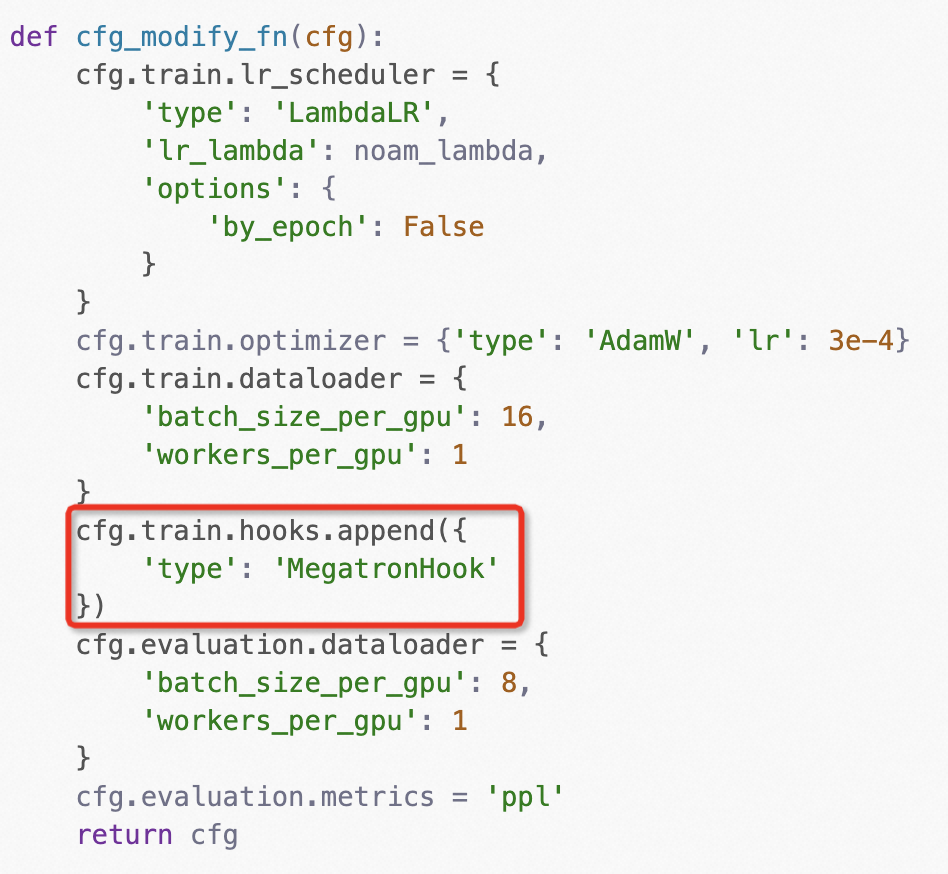

您好,我看您的 train.py 文件中没有加入 MegatronHook,需要有这个 hook 才能正常保存 checkpoint~可以参考 https://modelscope.cn/models/damo/nlp_gpt3_text-generation_1.3B/summary model card 中的训练代码示例  ,此回答整理自钉群“魔搭ModelScope开发者联盟群 ①”

,此回答整理自钉群“魔搭ModelScope开发者联盟群 ①”

ModelScope旨在打造下一代开源的模型即服务共享平台,为泛AI开发者提供灵活、易用、低成本的一站式模型服务产品,让模型应用更简单!欢迎加入技术交流群:微信公众号:魔搭ModelScope社区,钉钉答疑群:44837352