问题一:多轮对话复用KV cache的策略是如何解决FTT变长问题的?

多轮对话复用KV cache的策略是如何解决FTT变长问题的?

参考回答:

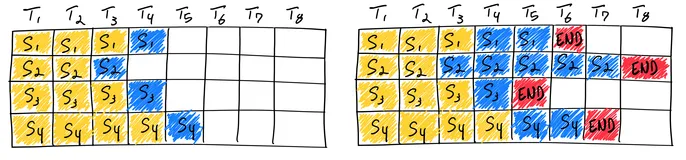

多轮对话复用KV cache的策略是通过保存上一轮对话产生的KV cache,供下一轮对话时复用。由于大部分自回归模型的Attention Mask都是下三角矩阵,即某一位置token的注意力与后续token无关,因此两轮对话公共前缀部分的KV cache是一致的。通过复用这些KV cache,可以减少下一轮需要生成KV cache的token数,从而减少FTT。

关于本问题的更多问答可点击原文查看:

https://developer.aliyun.com/ask/628438

问题二:能不能举例说明多轮对话复用KV cache策略的应用场景?

能不能举例说明多轮对话复用KV cache策略的应用场景?

参考回答:

多轮对话复用KV cache策略的应用场景包括两类:一是问答类的场景,每次请求模型时会拼接之前的问答;二是LangChain应用,它在模型生成结束后会调用外部插件,拼接插件返回的结果再次请求模型。在这两类场景中,由于前一轮对话的输出构成后一轮对话输入的一部分,或者存在较长的公共前缀,因此可以通过复用KV cache来减少FTT。

关于本问题的更多问答可点击原文查看:

https://developer.aliyun.com/ask/628439

问题三:在实现多轮对话复用KV cache策略时,有哪些关键技巧?

在实现多轮对话复用KV cache策略时,有哪些关键技巧?

参考回答:

在实现多轮对话复用KV cache策略时,需要注意的关键技巧包括确保公共前缀部分的KV cache的一致性,以及有效地管理和更新缓存数据。此外,还需要注意处理那些不在公共前缀中的新token,确保它们能够正确地生成和更新KV cache。具体的实现方式可能会根据具体的模型架构和业务需求而有所不同。

关于本问题的更多问答可点击原文查看:

https://developer.aliyun.com/ask/628440

问题四:在生产环境中,为什么多轮对话复用KV cache的策略难以直接实现?

在生产环境中,为什么多轮对话复用KV cache的策略难以直接实现?

参考回答:

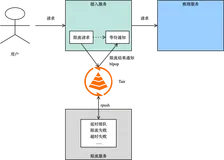

在生产环境中,模型通常部署在由多台机器组成的机器集群中,用户层的请求通过统一域名服务转发到机器集群中的某一台机器。这样的架构设计导致不同轮次的对话命中同一台机器的概率微乎其微,因为每次请求可能被转发到不同的机器上,而这些机器上的显存中存放的KV cache是独立的。

关于本问题的更多问答可点击原文查看:

https://developer.aliyun.com/ask/628441

问题五:如何解决生产环境中多轮对话复用KV cache的挑战?

如何解决生产环境中多轮对话复用KV cache的挑战?

参考回答:

可以通过增加一层转发层来解决这个挑战。用户将多轮请求携带同样的标识id并发送给转发层,转发层感知集群信息并使用统一的哈希算法将相同id哈希到固定的机器。这样不同轮对话就能打到同一台存有KV cache的下游机器。

关于本问题的更多问答可点击原文查看: