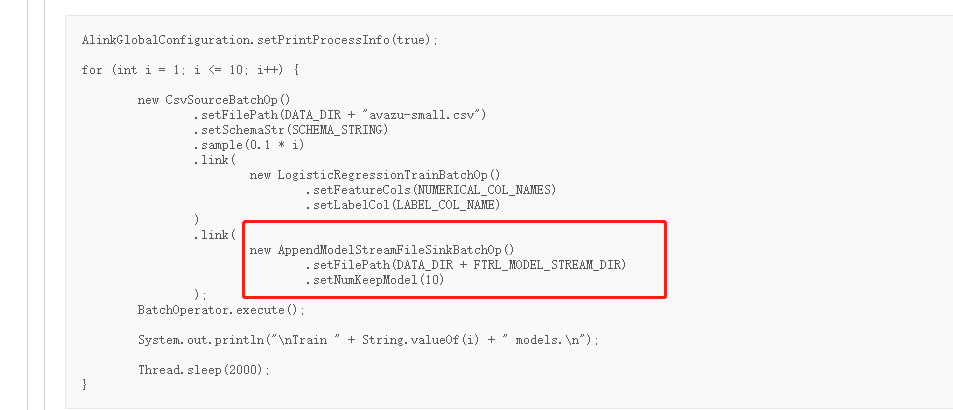

如图,机器学习PAI的离线模型存储成流式模型之后,用哪种方式读入的的话每次对应的也是这样的格式?

问题一:如图,机器学习PAI的离线模型(batchoperator)这样存储成流式模型之后,用哪种方式读入的话每次对应的也是batchoperator的格式,作为ftrl的初始模型batchoperator的格式?

初始模型在批量变化,作为ftrl的初始模型,用哪种方式读入的话,能够流式的转为batchoperator的格式?

问题二:就是每次批量更新的模型,写在在线流的那个流式模型的那个路径中,然后在线就会学进去,就相当于更新了initmodel是吗?nitmodel的更新不需要单独的一个模型流,跟在线流一个流式路径?

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

-

北京阿里云ACE会长

利用Flink将离线模型转换为流式模式的一种做法是:

将离线训练的模型保存为文件,如JSON/PROTOBUF格式。

定义SourceFunction从文件中读取模型文件作为初始模型。

使用Flink ML库提供的OnlineLearningAlgorithm,设置initModel()接口加载初始模型。

2023-08-10 23:22:59赞同 展开评论 -

针对问题一的回答:setModelStreamFilePath

这个可以指定一个模型流的路径

com.alibaba.alink.params.ModelStreamScanParams

这个里边的几个方法可以指定模型流的一些参数

路径指定成你的appendmodelstream那个op写的路径,就会读模型流了

—此回答来自钉群“Alink开源--用户群”2023-08-09 11:14:12赞同 展开评论

人工智能平台 PAI(Platform for AI,原机器学习平台PAI)是面向开发者和企业的机器学习/深度学习工程平台,提供包含数据标注、模型构建、模型训练、模型部署、推理优化在内的AI开发全链路服务,内置140+种优化算法,具备丰富的行业场景插件,为用户提供低门槛、高性能的云原生AI工程化能力。