opdscmd如何上传资源?

opdscmd如何上传资源?

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

-

公众号:网络技术联盟站,InfoQ签约作者,阿里云社区签约作者,华为云 云享专家,BOSS直聘 创作王者,腾讯课堂创作领航员,博客+论坛:https://www.wljslmz.cn,工程师导航:https://www.wljslmz.com

在阿里云DataWorks中,opdscmd是操作数据开发工作区的命令行工具。通过opdscmd工具,您可以上传资源到DataWorks。

上传资源需要进行以下步骤:

-

首先,使用 opdscmd login 命令以阿里云账号登录,确保当前账号有对应的工作空间和项目的权限。

-

使用 opdscmd import 命令上传资源,例如:

opdscmd import hdfs -c hdfs_instance -p "/user/test/" -f localfile.txt -t RES_GROUP具体参数说明如下:

-c:HDFS实例名称。

-p:在HDFS集群中的目标路径。

-f:本地文件的绝对路径。

-t:资源组名称。

2023-05-01 08:55:44赞同 展开评论 -

-

【上传资源】

注:超过30M的资源上传请使用tunnel上传,上传完成后您可以通过"maxcompute资源"加载到数据开发。

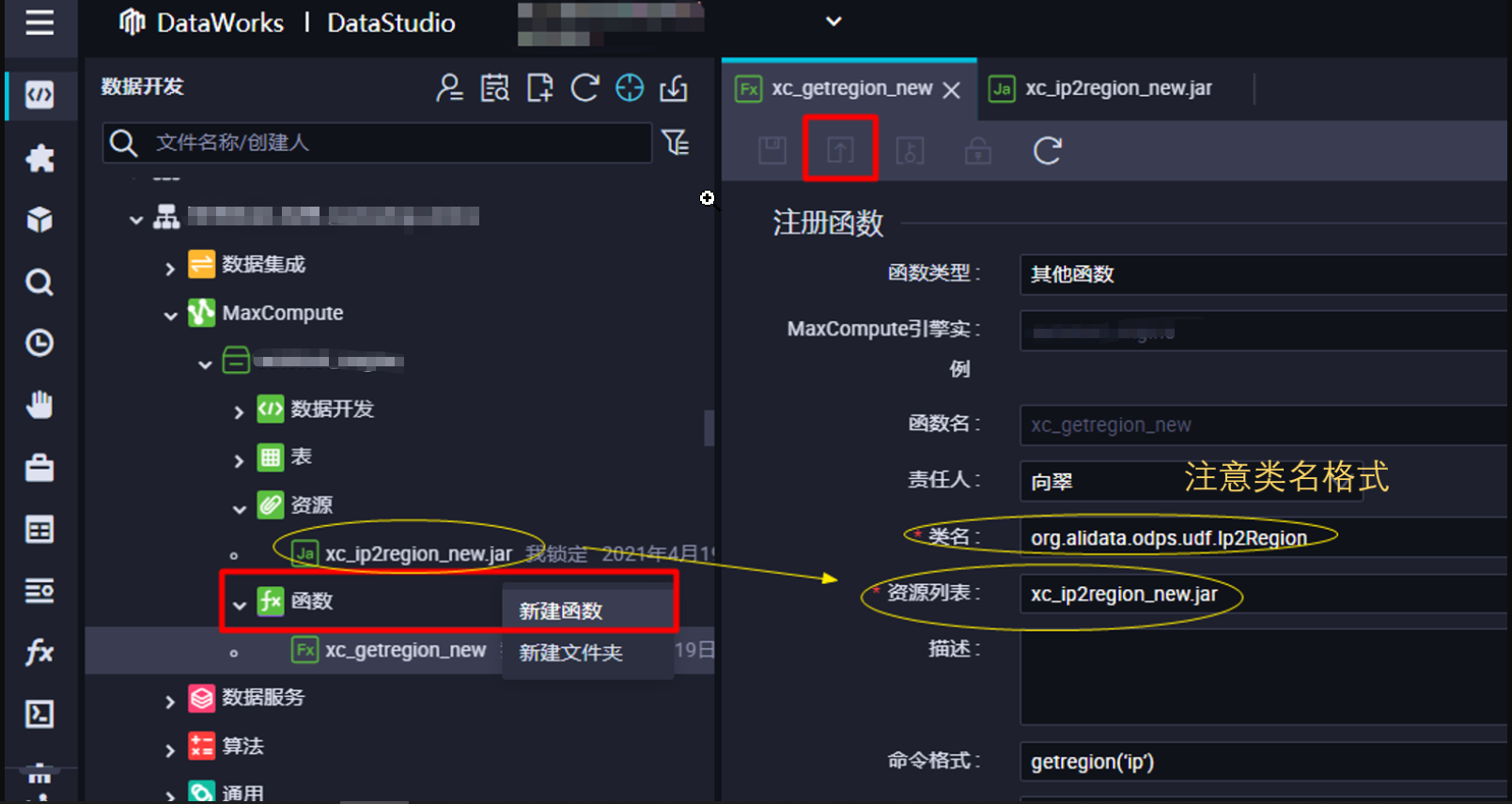

【注册函数】

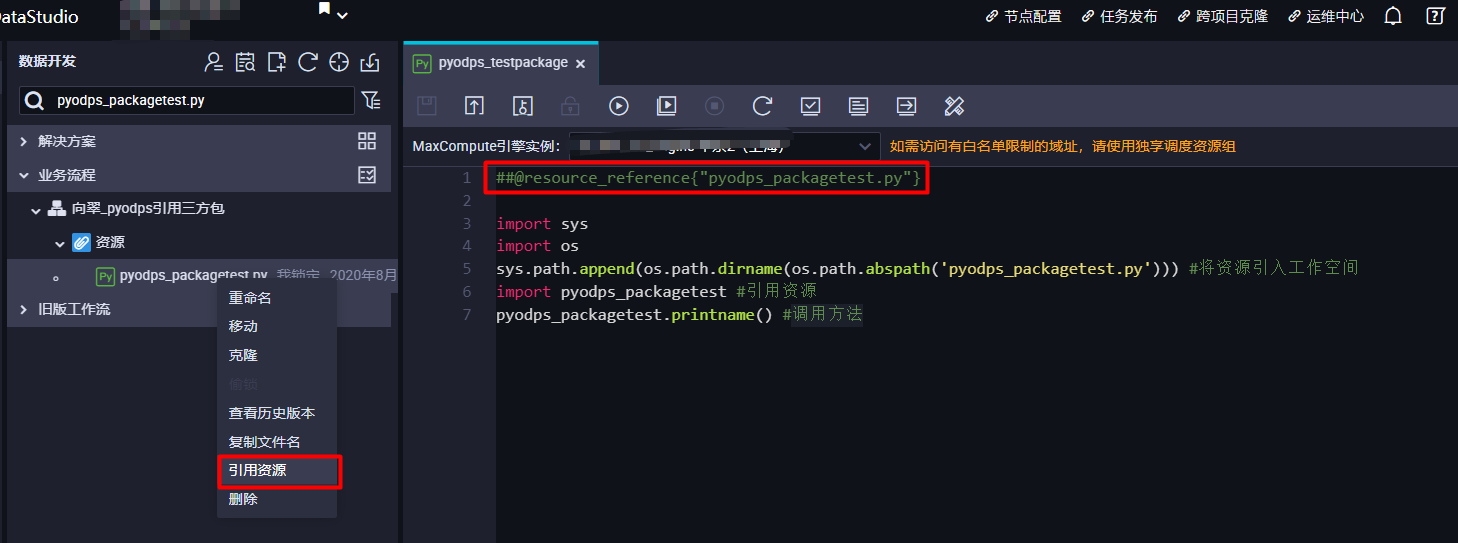

【节点内引用资源】 右键资源-引用资源,会在代码最上方自动添加一条注释。

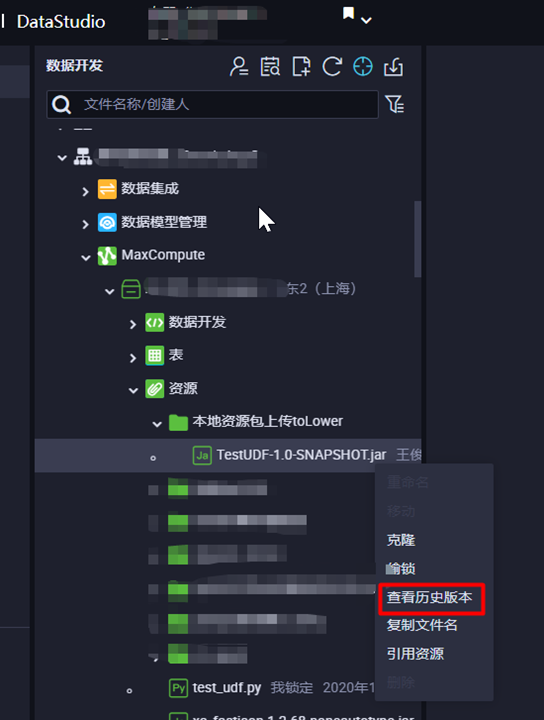

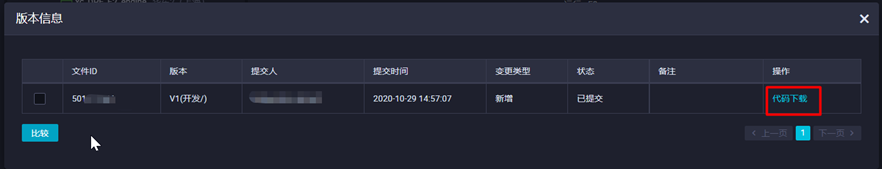

【下载资源】

【下载资源】

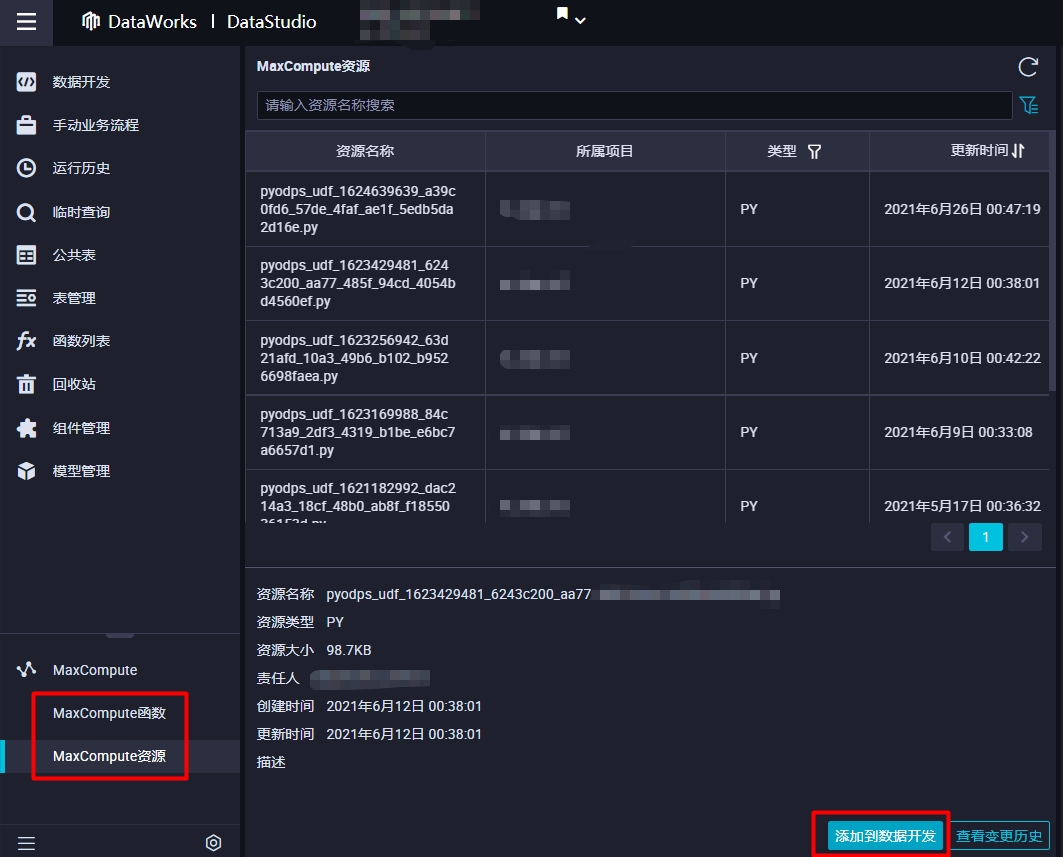

【通过odpscmd上传资源加载到DataWorks】

通过cmd上传的资源,注册的函数需要在数据开发DataStudio的"MaxCompute资源"和“MaxCompute函数”处加载到数据开发具体的业务流程才能在数据开发DataStudio界面看到和使用,记得提交发布哦。

,此回答整理自钉群“DataWorks交流群(答疑@机器人)”

2023-04-20 12:51:58赞同 展开评论 -

资深技术专家。主攻技术开发,擅长分享、写文、测评。

打开终端或命令行窗口,输入以下命令以登录到OpenDistro for Elasticsearch:

opdscmd login --user admin --password <your_password> 登录成功后,进入要上传资源的目录。

输入以下命令上传资源(假设您要上传的资源名称为“my_resource”):

opdscmd put-resource --resource-name my_resource 然后,输入以下命令指定要上传的资源文件:

opdscmd set-resource-file --file <path_to_your_resource_file> 最后,输入以下命令启动上传过程:

opdscmd upload-resource

2023-04-20 11:02:37赞同 展开评论

DataWorks基于MaxCompute/Hologres/EMR/CDP等大数据引擎,为数据仓库/数据湖/湖仓一体等解决方案提供统一的全链路大数据开发治理平台。