论文标题:Graph Contrastive Learning with Adaptive Augmentation

论文链接:https://arxiv.org/abs/2010.14945

论文来源:WWW 2021

一、概述

图对比学习中的数据增强在近来的方法中被证明是一个关键的部分,然而对于图数据增强的方法的研究却是不充分的。对于图像和文本来说,数据增强有很多种方式,然而对于图数据来说,数据增强是不容易的,这是由图数据的非欧几里得特性引起的。本文认为过去的图数据增强方法有两个缺点:

①简单的数据增强,比如DGI中的特征打乱,对于生成节点多样化的邻域(也就是上下文)是不充分的,尤其是节点特征较为稀疏时,会导致对比目标函数的优化是困难的;

②在执行数据增强时忽略了不同节点和不同边的影响。

数据增强应该保留原始数据最本质的特征,举例来说,对一张猫的图片进行数据增强(比如对其进行翻转),应该使得增强后的图仍然是一只猫,而不能使其丢失其作为猫的本质特征,这样模型才可以通过对比来学习到猫的特征。同样的,如果在对图通过随机删除边的方式进行数据增强时,某些重要的边被删除掉就会影响最终学习到的embedding的质量,也就是说图的不同节点和不同边在数据增强时产生的影响是不同的,在数据增强时应该尽可能的保留重要的边以及重要的节点特征,而一些图数据增强采用随机处理的方式,这样势必造成性能的损伤。

对比学习得到的表示应该对通过数据增强引入的破坏具备一定的不变性,因而数据增强策略应自适应输入的图,以反映其内在模式。同样的以删除边的数据增强方式为例,我们应该给不重要的边以大的移除概率,给重要的边以小的移除概率。然后,该方案能够引导模型忽略不重要边上引入的噪声,从而学习输入图下的重要模式。

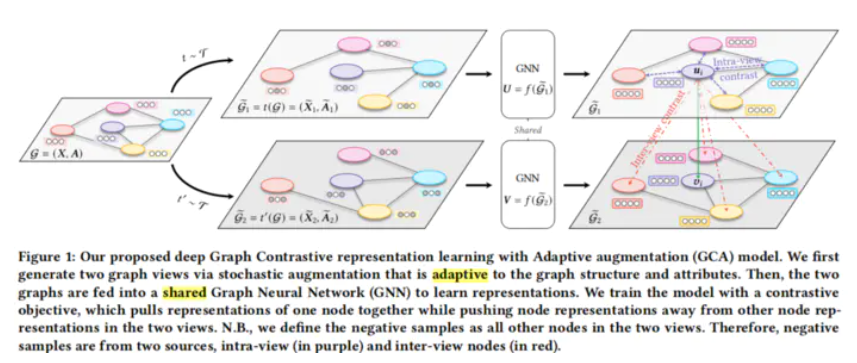

本文提出了Graph Contrastive learning with Adaptive augmentation(GCA)框架来利用自适应的数据增强策略进行图的节点表示学习,整体框架图如下:

框架

本文采用的自适应图数据增强的主要思想是给不重要的边以更大的移除概率,给不重要的节点特征维度以更大的mask概率。

二、方法

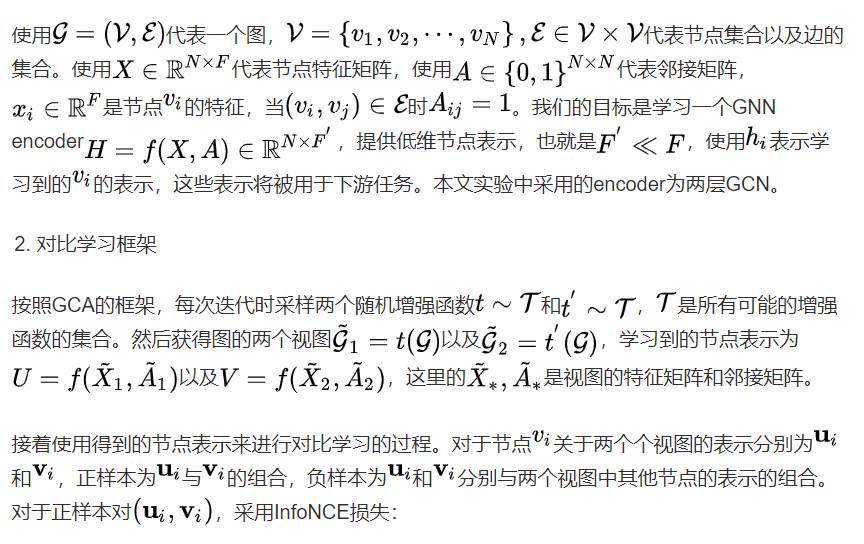

- 定义

整个模型的算法如下:

算法

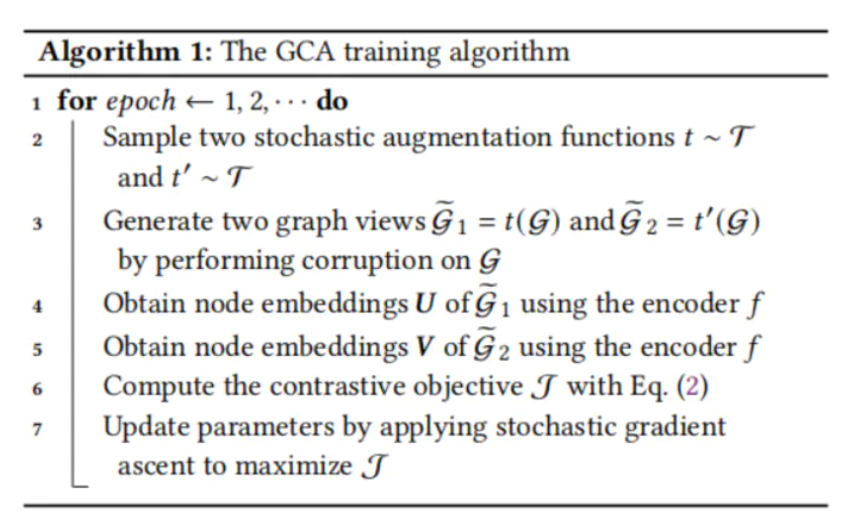

- 自适应图数据增强

本文研究的重点在于自适应的图数据增强方法,希望数据增强在扰乱不重要的连接和特征时能够保持重要的结构和属性不变。本文采用随机删除边和mask节点属性的方式来进行数据增强,但是删除和mask的概率应该向不重要的边或特征倾斜,也就是对于不重要的边或特征删除或mask的概率要大,对于重要的要小,这是本文数据增强方法设计的基本思想。

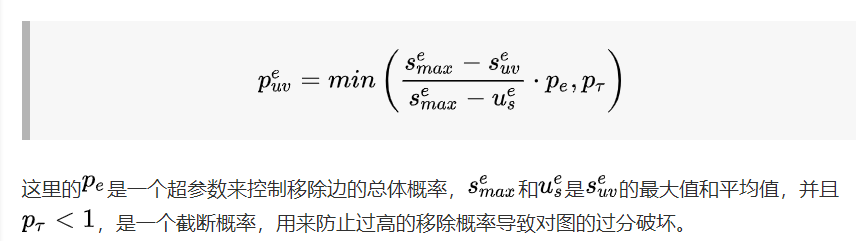

- 拓扑结构的数据增强

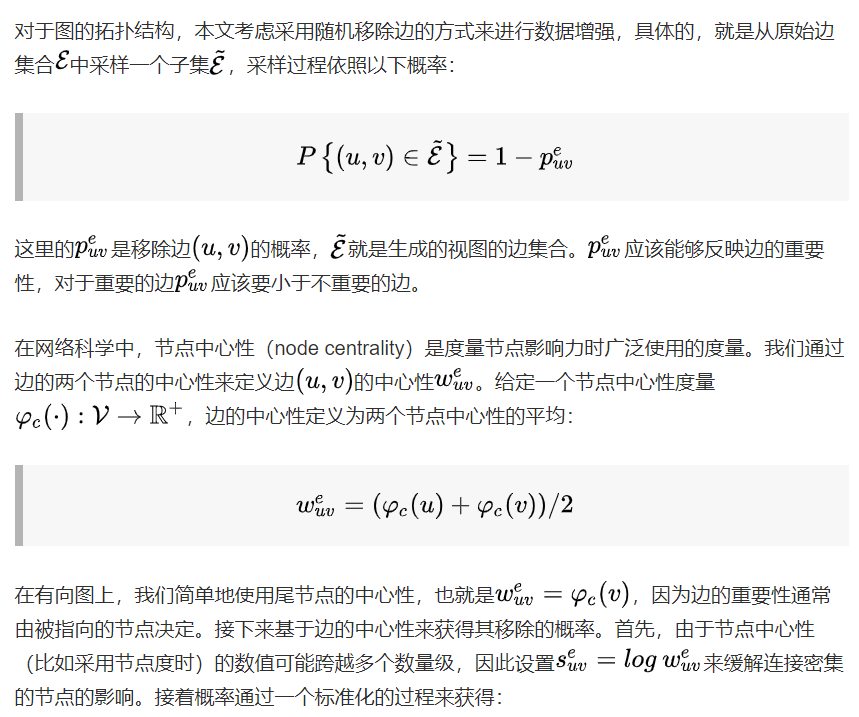

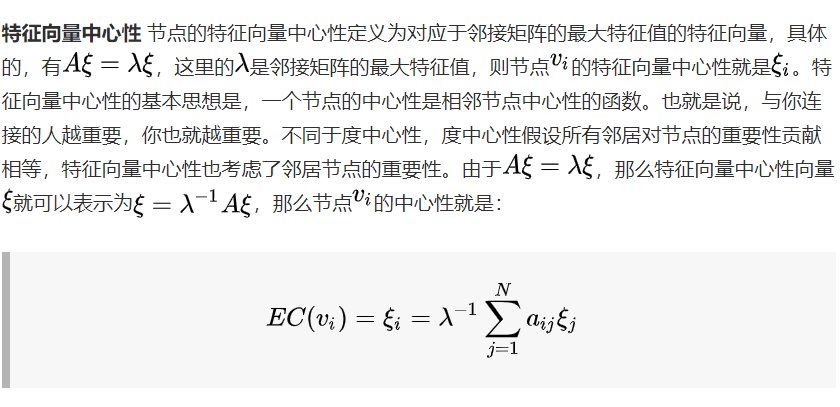

对于节点中心性的度量,采用以下三种:度中心性、特征向量中心性以及PageRank中心性。这三种度量是简单而高效的。

度中心性 节点的度本身可以作为中心性的度量。在有向图中采用节点的入度。尽管节点度是最简单的中心性度量之一,但它非常有效且具有启发性。这一度量背后的假设是重要的节点就是拥有许多连接的节点。

上面的式子表明节点的中心性相当于对其邻居节点的中心性做了平均。当一个节点与很多节点相连或者与高影响力的节点相连时会有比较高的节点中心性。在有向图上,我们使用右特征向量来计算中心性,它对应节点的入边。注意,由于只需要最大特征值的特征向量,计算特征向量中心性的计算负担是可以忽略的。

PageRank中心性 PageRank中心性定义为PageRank算法计算得到的PageRank权重。该算法将影响沿有向边传播,将聚集的影响最大的节点视为重要节点。具体的,中心性数值定义为:

下图展示了3种不同的中心性度量的应用:

中心性

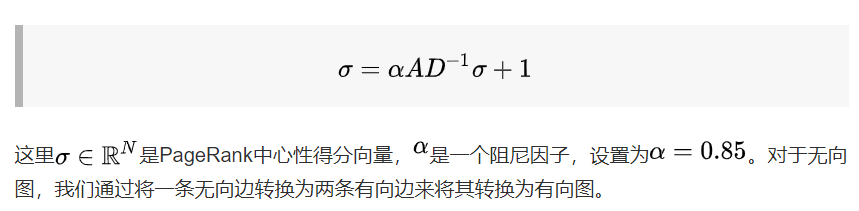

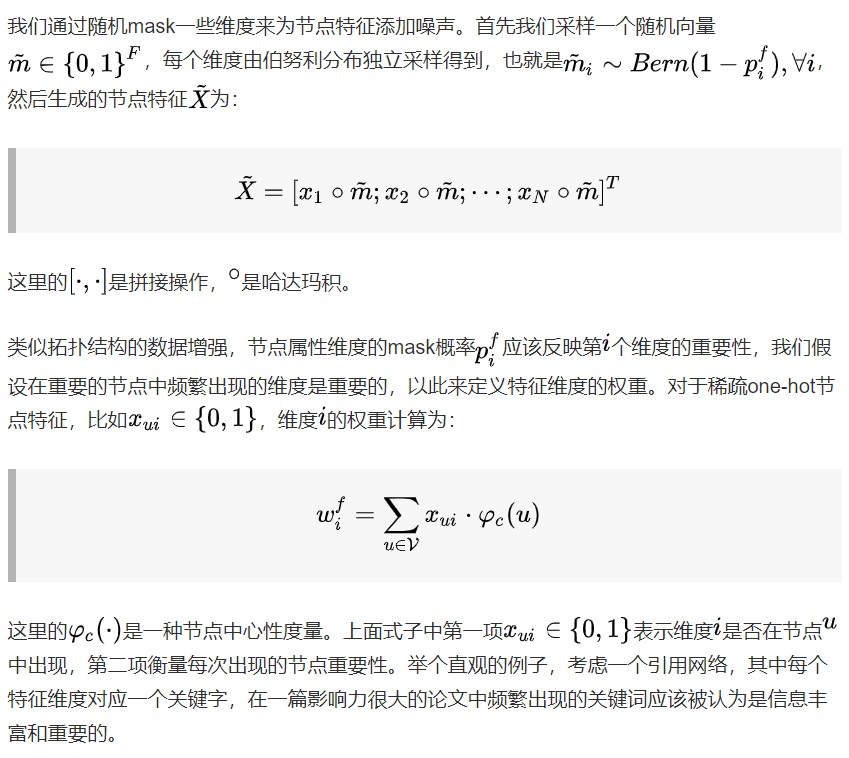

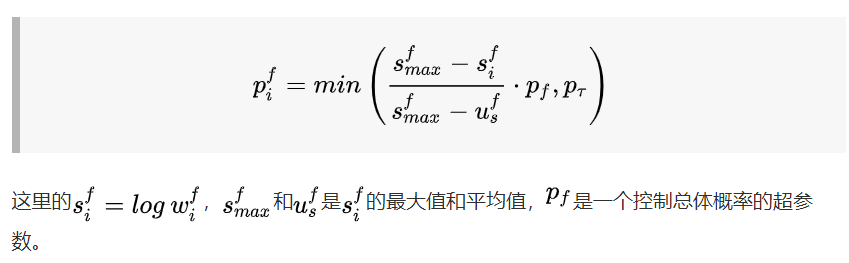

- 节点属性的数据增强

对于稠密连续的节点特征,采用以下方式:

类似的,以标准化的方式获得概率:

三、实验

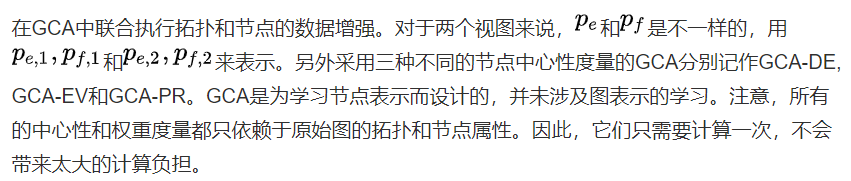

- 数据集

本文实验采用以下数据集:

数据集

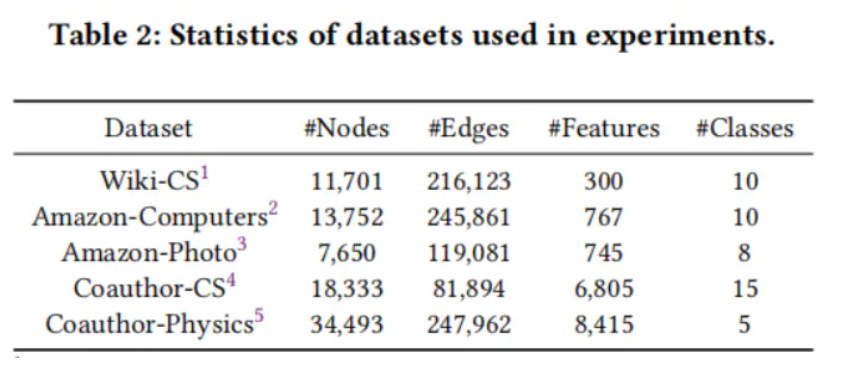

- 实验

下表为上面数据集上的节点分类任务性能指标:

实验

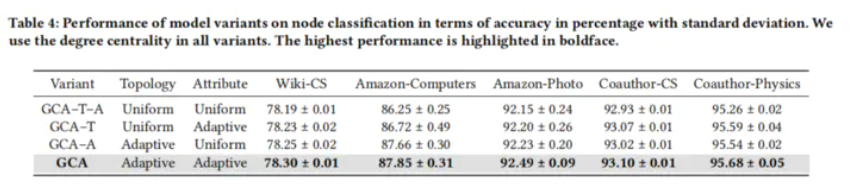

- 消融实验

下面的消融实验探究了两种数据增强方式的影响:

消融实验

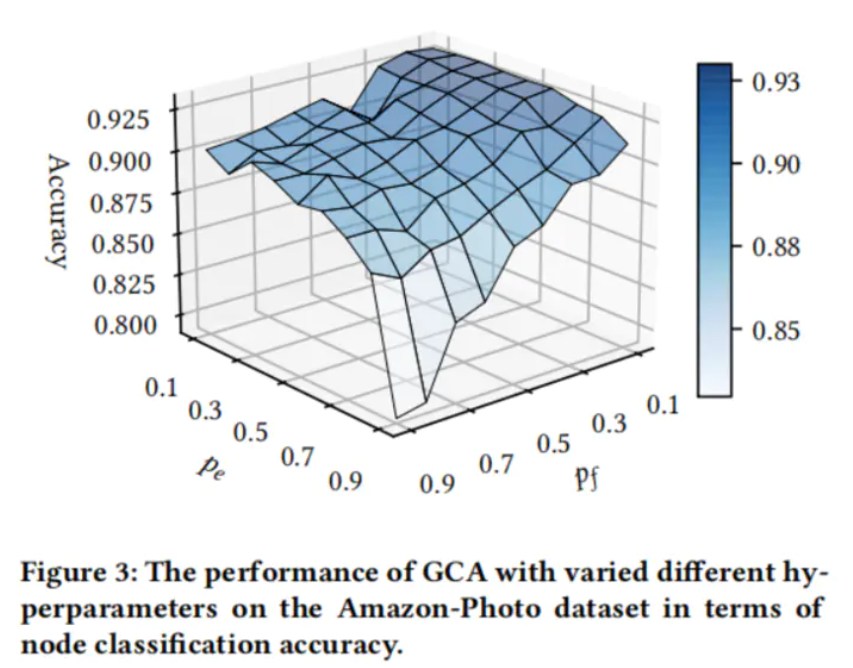

下图展示了不同的概率对性能的影响:

消融实验