在Windows下按这个编译之后,运行modelscope-funasr-wss-client-2pass这个文件,不能指定--mode 2pass,各位有知道这是什么原因吗?

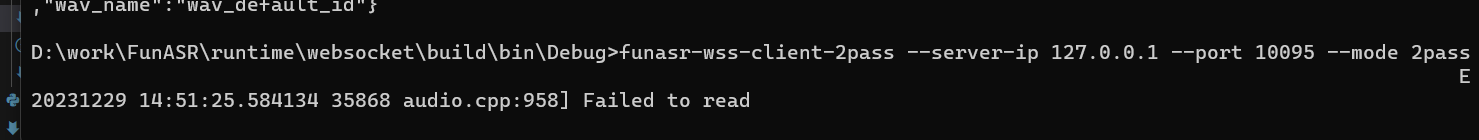

总是要求必须指定wav-path才能运行,而且我指定wav-path就可以显示自己音频的文字,不指定就是显示读取失败,客户端这边目前是不支持使用mic说话来实时转文字嘛?

"modelscope-funasr-wss-client-2pass"是一个基于深度学习的开源语音识别系统,它支持实时语音听写服务(online)、非实时一句话转写(offline)与实时与非实时一体化协同(2pass)3种服务模式。如果您在运行这个文件时不能指定参数,可能的原因是您没有按照正确的步骤来操作。

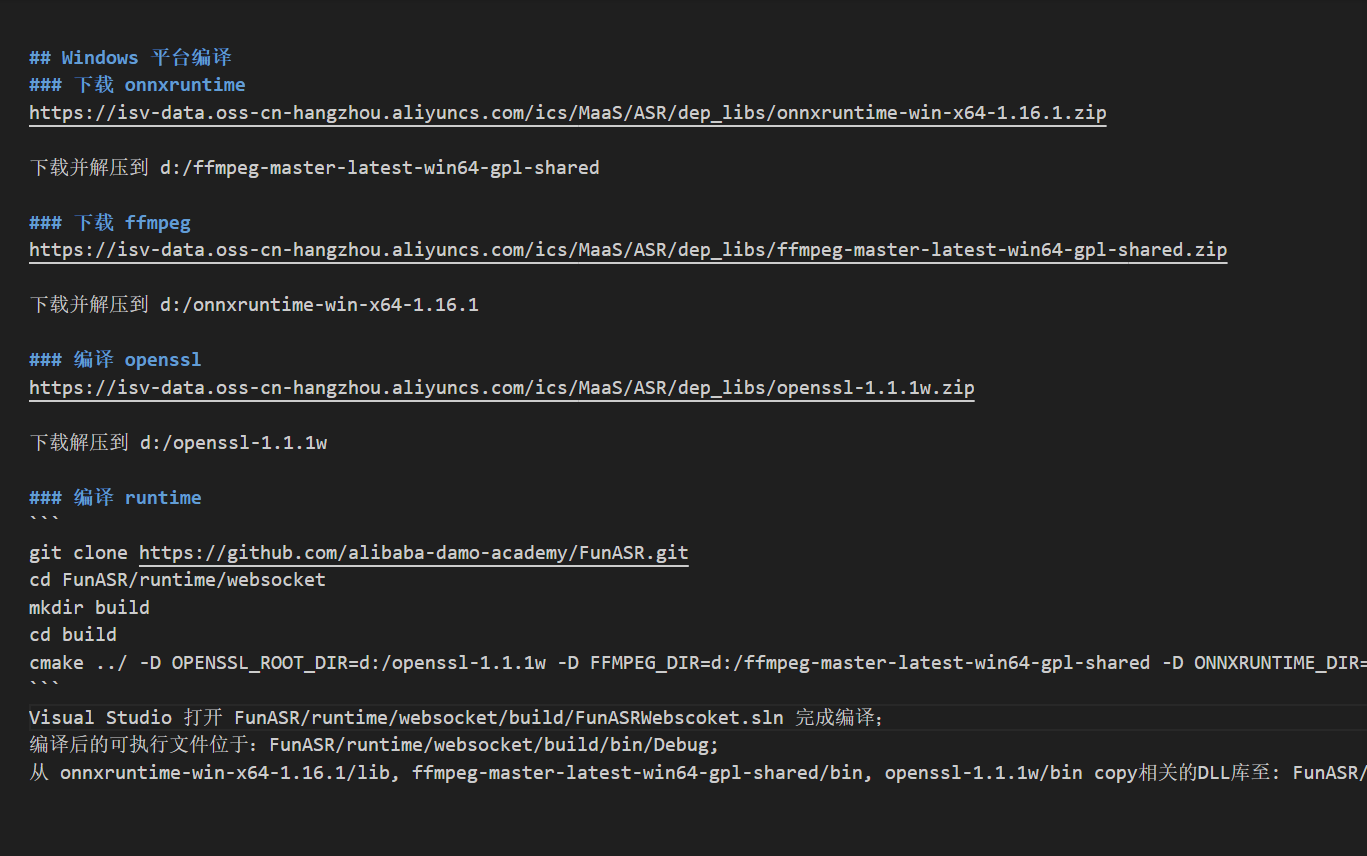

首先,确保您已经正确安装了所有必要的依赖项,包括Python和相关的库。然后,您需要下载FunASR的代码并克隆或下载到本地。接着,您需要在FunASR的配置文件中设置模型参数,例如语言模型路径、字典文件等。最后,您需要准备用于训练和验证的语音数据集,并按照FunASR的要求进行预处理。

在启动服务后,您可以在docker镜像里面执行以下命令:cd FunASR/runtime; nohup bash run_server_2pass.sh --download-model-dir /workspace/models --vad-dir damo/speech_fsmn_vad_zh-cn-16k-common-onnx --model-dir damo/speech_paraformer-large_asr_nat-zh-cn-16k-common-vocab8404-onnx --online-model-dir ...。

在Windows下运行modelscope-funasr-wss-client-2pass文件不能指定--mode 2pass的问题,可能的原因有很多。一种可能性是您的客户端版本不支持2pass模式。FunASR支持实时语音听写服务(online)、非实时一句话转写(offline)与实时与非实时一体化协同(2pass)三种服务模式,但并非所有版本的客户端都支持这三种模式。另一种可能性是您的命令输入有误,确保您正确地输入了参数。

关于必须指定wav-path才能运行的问题,这可能是因为客户端没有正确读取到音频文件,或者音频文件的路径没有设置正确。请检查您的音频文件路径是否正确,以及文件是否损坏。如果问题仍然存在,可能需要进一步检查代码或者联系技术支持。

至于客户端是否支持使用mic说话来实时转文字,根据FunASR的介绍,它支持实时语音转写服务,但具体是否支持mic输入并没有明确提及。建议您查阅相关的文档或者向技术支持咨询。

funasr-wss-client-2pass是客户端,需要指定wav-path读取音频文件。试试--record 1,这个属性cpp可以看到,文档我们后续补充一下。此回答整理自钉群“modelscope-funasr社区交流”

ModelScope旨在打造下一代开源的模型即服务共享平台,为泛AI开发者提供灵活、易用、低成本的一站式模型服务产品,让模型应用更简单!欢迎加入技术交流群:微信公众号:魔搭ModelScope社区,钉钉群号:44837352