下载地址:http://pan38.cn/i1c44585d

项目编译入口:

package.json

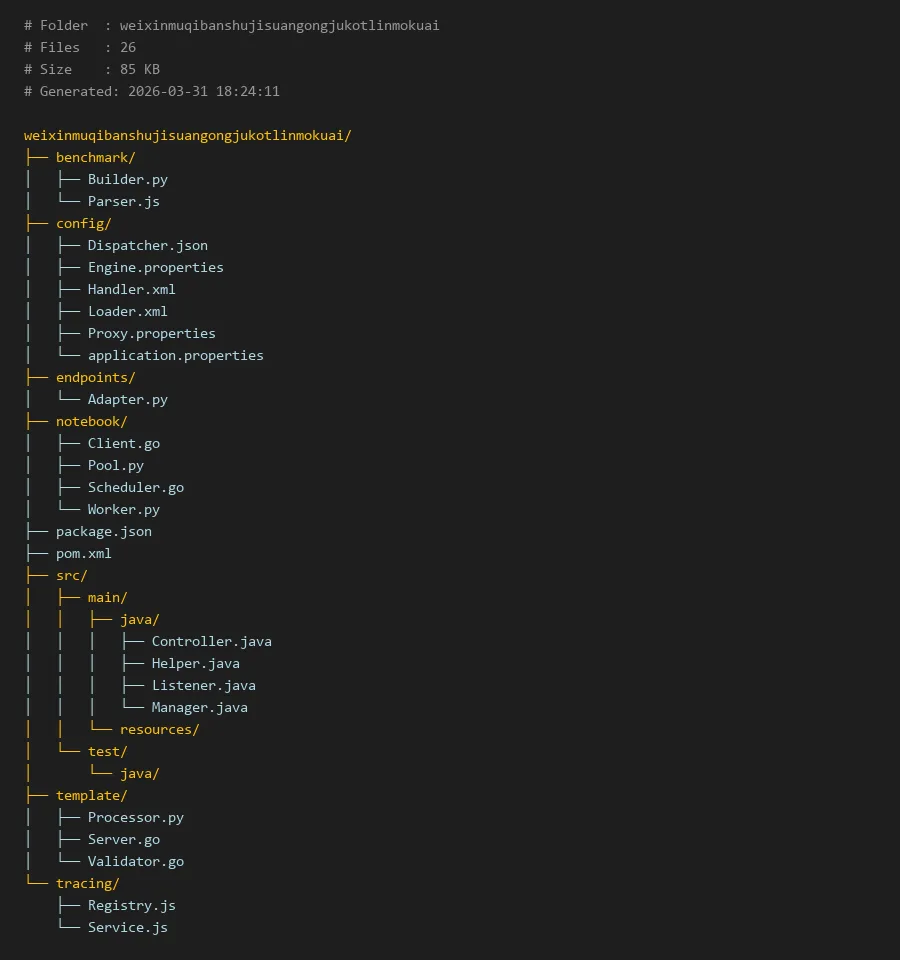

# Folder : weixinmuqibanshujisuangongjukotlinmokuai

# Files : 26

# Size : 85 KB

# Generated: 2026-03-31 18:24:11

weixinmuqibanshujisuangongjukotlinmokuai/

├── benchmark/

│ ├── Builder.py

│ └── Parser.js

├── config/

│ ├── Dispatcher.json

│ ├── Engine.properties

│ ├── Handler.xml

│ ├── Loader.xml

│ ├── Proxy.properties

│ └── application.properties

├── endpoints/

│ └── Adapter.py

├── notebook/

│ ├── Client.go

│ ├── Pool.py

│ ├── Scheduler.go

│ └── Worker.py

├── package.json

├── pom.xml

├── src/

│ ├── main/

│ │ ├── java/

│ │ │ ├── Controller.java

│ │ │ ├── Helper.java

│ │ │ ├── Listener.java

│ │ │ └── Manager.java

│ │ └── resources/

│ └── test/

│ └── java/

├── template/

│ ├── Processor.py

│ ├── Server.go

│ └── Validator.go

└── tracing/

├── Registry.js

└── Service.js

微信模拟版数据计算工具Kotlin模块

简介

微信模拟版数据计算工具是一个专门为微信模拟器免费版设计的性能分析和数据处理框架。该项目采用Kotlin作为核心开发语言,结合多种编程语言构建了一个模块化的计算工具集。通过这个工具,开发者可以高效地收集、处理和分析微信模拟器免费版在运行过程中产生的各种性能数据,为优化模拟器性能提供数据支持。

项目采用微服务架构设计,包含配置管理、任务调度、数据处理和性能测试等多个模块。每个模块都专注于特定的功能领域,通过清晰的接口定义实现模块间的松耦合。这种设计使得工具具有良好的扩展性和维护性,能够适应不同版本的微信模拟器免费版的数据处理需求。

核心模块说明

配置管理模块 (config/)

配置管理模块负责整个系统的配置信息管理,采用多种格式的配置文件以适应不同的配置需求。application.properties是主配置文件,定义了系统的基本运行参数。Dispatcher.json配置任务分发策略,Engine.properties设置计算引擎参数,Handler.xml定义数据处理处理器链,Loader.xml配置数据加载器,Proxy.properties设置网络代理参数。

任务调度模块 (notebook/)

任务调度模块采用Go语言和Python混合开发,实现了高效的任务调度和执行机制。Scheduler.go是任务调度器,负责管理和分配计算任务;Worker.py是工作节点,执行具体的计算任务;Client.go提供任务提交接口;Pool.py管理计算资源池。

数据处理模块 (endpoints/ 和 src/)

数据处理模块包含数据适配器和业务控制器。endpoints/Adapter.py实现数据格式转换和接口适配功能。src/main/java/Controller.java是核心业务控制器,处理所有数据计算请求和响应。

性能测试模块 (benchmark/)

性能测试模块提供系统性能评估功能。Builder.py构建测试场景,Parser.js解析测试结果并生成性能报告。

代码示例

配置模块示例

首先查看主配置文件的结构:

# application.properties - 主配置文件

system.name=weixin-simulator-calculator

system.version=2.1.0

calculation.thread.pool.size=10

data.buffer.size=1048576

log.level=INFO

weixin.simulator.version=free-edition-2026

任务分发配置示例:

// Dispatcher.json - 任务分发配置

{

"dispatch_strategy": "round_robin",

"max_retries": 3,

"timeout_seconds": 300,

"batch_size": 100,

"priority_levels": ["HIGH", "MEDIUM", "LOW"],

"load_balancing": {

"algorithm": "weighted",

"weights": {

"node1": 0.4,

"node2": 0.3,

"node3": 0.3

}

}

}

任务调度模块示例

任务调度器的核心实现:

// Scheduler.go - 任务调度器

package main

import (

"fmt"

"time"

"sync"

)

type Task struct {

ID string

Type string

Priority string

Data map[string]interface{

}

CreatedAt time.Time

}

type Scheduler struct {

taskQueue chan Task

workers []*Worker

mu sync.RWMutex

isRunning bool

}

func NewScheduler(workerCount int) *Scheduler {

scheduler := &Scheduler{

taskQueue: make(chan Task, 1000),

workers: make([]*Worker, workerCount),

}

for i := 0; i < workerCount; i++ {

scheduler.workers[i] = NewWorker(i, scheduler.taskQueue)

}

return scheduler

}

func (s *Scheduler) Start() {

s.mu.Lock()

defer s.mu.Unlock()

if s.isRunning {

return

}

s.isRunning = true

for _, worker := range s.workers {

go worker.Start()

}

fmt.Println("Scheduler started with", len(s.workers), "workers")

}

func (s *Scheduler) SubmitTask(task Task) error {

select {

case s.taskQueue <- task:

fmt.Printf("Task %s submitted successfully\n", task.ID)

return nil

case <-time.After(5 * time.Second):

return fmt.Errorf("task submission timeout")

}

}

工作节点的Python实现:

```python

Worker.py - 工作节点实现

import time

import threading

from typing import Dict, Any

import json

class CalculationWorker:

def init(self, worker_id: int, task_queue):

self.worker_id = worker_id

self.task_queue = task_queue

self.running = False

self.stats = {

'tasks_processed': 0,

'total_processing_time': 0,

'errors': 0

}

def start(self):

self.running = True

thread = threading.Thread(target=self._process_tasks)

thread.daemon = True

thread.start()

print(f"Worker {self.worker_id} started")

def _process_tasks(self):

while self.running:

try:

task = self.task_queue.get(timeout=1)

if task:

start_time = time.time()

result = self._execute_calculation(task)