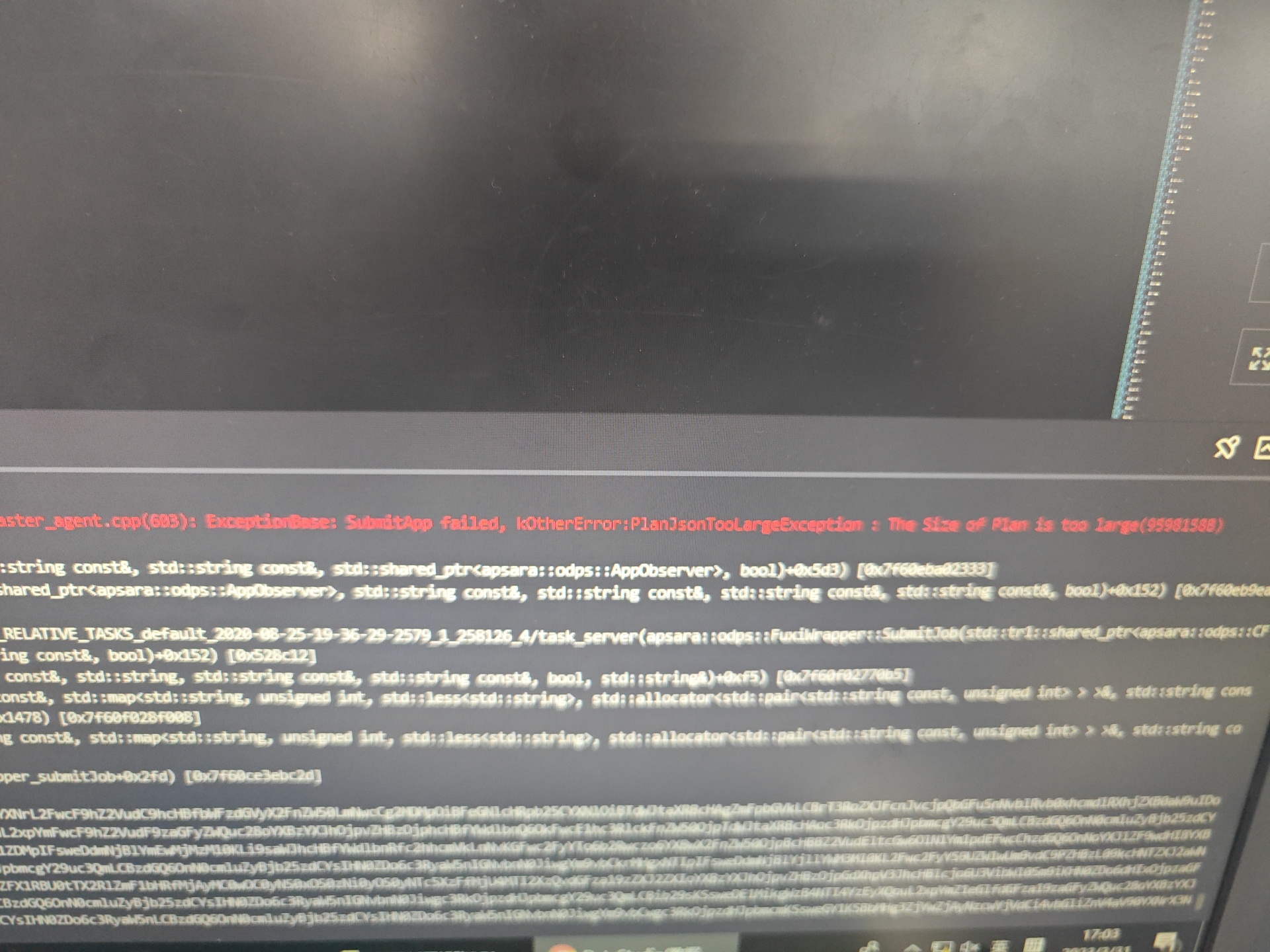

the size of plan is too large这个问题是什么 该怎么解决?

the size of plan is too large这个问题是什么 该怎么解决?

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

-

公众号:网络技术联盟站,InfoQ签约作者,阿里云社区签约作者,华为云 云享专家,BOSS直聘 创作王者,腾讯课堂创作领航员,博客+论坛:https://www.wljslmz.cn,工程师导航:https://www.wljslmz.com

在阿里云 DataWorks 中,当你在提交一个工作流(workflow)或作业(job)时,可能会遇到 "The size of plan is too large" 的错误提示。这个错误通常发生在你的工作流或作业中包含了大量的任务或节点,导致计划(plan)的大小超过了 DataWorks 的限制。

这个错误提示的意思是你的工作流或作业计划(plan)的大小超过了 DataWorks 的限制。DataWorks 对计划的大小有限制,这是为了保护系统的性能和稳定性,防止超大计划导致资源占用过多或执行时间过长。

解决这个问题的方法有以下几种:

1、简化工作流或作业:检查你的工作流或作业,看是否可以简化流程,减少任务或节点的数量,从而减小计划的大小。

2、分拆工作流或作业:如果工作流或作业中包含了大量的任务或节点,可以考虑将其分拆成多个较小的工作流或作业,以降低计划的大小。

3、使用增强版节点:DataWorks 提供了增强版节点(Enhanced Node),它可以显著减小计划的大小。如果可能的话,可以尝试将工作流或作业中的节点类型更换为增强版节点。

4、联系 DataWorks 支持:如果以上方法无法解决问题,可以联系 DataWorks 官方支持,寻求进一步的帮助和解决方案。

总的来说,解决 "The size of plan is too large" 的问题需要根据具体情况来选择合适的方法,包括简化工作流或作业、分拆工作流或作业、使用增强版节点或联系 DataWorks 支持等。

2023-04-10 11:13:39赞同 展开评论 -

从事java行业9年至今,热爱技术,热爱以博文记录日常工作,csdn博主,座右铭是:让技术不再枯燥,让每一位技术人爱上技术

这个错误的意思就是说你创建的执行计划的大小超过了dataworks限制的执行计划的最大值,建议优化执行计划,将大的执行计划更改为多个小的执行计划执行。

2023-04-08 20:41:52赞同 展开评论 -

-

-

坚持这件事孤独又漫长。

当你的数据集较大时,会遇到

The size of plan is too large这个错误。这是由于DataWorks限制了执行计划的大小,因此如果执行计划超过此大小限制,则会发生此错误。为了解决这个问题,可以尝试以下方法:-

减小数据集的大小。可以尝试用更小的数据集进行测试,看是否会发生相同的错误。

-

增加资源配置。可以尝试增加DataWorks所在的最大CPU和内存资源,以支持更大的执行计划。

-

优化您的SQL语句。可以尝试优化您的SQL语句,以减小查询计划的大小。

-

分批处理数据。可以将数据分成多个批次进行处理,以避免超过执行计划的大小限制。

2023-04-06 15:25:41赞同 展开评论 -

DataWorks基于MaxCompute/Hologres/EMR/CDP等大数据引擎,为数据仓库/数据湖/湖仓一体等解决方案提供统一的全链路大数据开发治理平台。