上一篇我们讲了 Hadoop集群部署和启动与关闭,今天我们讲一下Spark集群部署和启动与关闭。

一、Spark集群部署模式

首先我们先来了解一下Spark集群部署模式,分别有以下三种:

Standalone

Standalone(独立模式)是Spark一种简单的集群部署模式,自带完整的服务可单独部署到一个集群中,无需依赖任何其他资源调度管理系统。

Mesos

Mesos(Spark on Mesos模式)是一款资源调度管理系统,可以为Spark提供资源调度服务,由于Spark与Mesos存在密切的关系,所以在设计Spark框架时充分考虑到了对Mesos的集成。

YARN

YARN(Spark on YARN模式)是一款资源调度管理系统,支持动态资源分配策略,可以为Spark提供资源调度服务,由于在生产环境中,很多时候都要与Hadoop同在一个集群,所以采用YARN来管理资源调度,可以降低运维成本和提高资源利用率,避免出现多个资源管理器造成资源分配的混乱无序的问题。

Standalone与Spark On YARN模式下Spark程序运行过程:

Standalone模式下Spark通过SparkContext向Cluster Manager(资源管理器,即Master)申请所需执行的资源,Cluster Manager分配应用程序执行需要的资源,在Worker节点上创建Executor,SparkContext将程序(jar包或python文件)和Task任务发送给Executor执行,并收集结果给Driver。

Spark On YARN模式下Spark通过SparkContext向ResourceManager(资源管理器)申请所需执行的资源,ResourceManager分配应用程序执行需要的资源,为NodeManager分配一个Container,并在该Container中启动AppMaster,此时 AppMaster上运行的是SparkDriver。

SparkDriver在Container上启动SparkExecutor,并调度SparkContext提交的程序和SparkTask在SparkExecutor上运行,等到所有的任务执行完毕后,向AppManager取消注册并释放资源。

二、Spark集群安装配置

下载Spark

访问Apache资源网站下载Linux操作系统的Spark安装包spark-2.3.2-bin-hadoop2.7.tgz。

上传Spark安装包

使用SecureCRT远程连接工具连接虚拟机Spark01,在存放应用安装包的目录/export/software/下执行“rz”命令上传Spark安装包。

安装Spark

在虚拟机Spark01中,通过解压缩的方式安装Spark,将Spark安装到存放应用的目录/export/servers/。

tar -zxvf /export/software/spark-2.3.2-bin-hadoop2.7.tgz -C /export/servers/

修改Spark配置文件

在Spark安装目录下的conf目录存在Spark配置文件的样例文件spark-env.sh.template,需要执行“cp spark-env.sh.template spark-env.sh”命令,通过复制样例文件方式创建Spark配置文件spark-env.sh,执行“vi spark-env.sh”命令编辑配置文件

spark-env.sh ,指定JDK安装目录和Hadoop配置文件所在目录。

export JAVA_HOME=${JAVA_HOME} export HADOOP_CONF_DIR=/export/servers/hadoop-2.7.4/etc/hadoop/

配置Spark环境变量

在虚拟机Spark01,执行“vi /etc/profile”命令编辑系统环境变量文件profile,配置Spark环境变量。

export SPARK_HOME=/export/servers/spark-2.3.2-bin-hadoop2.7 export PATH=$SPARK_HOME/bin:$SPARK_HOME/sbin:$PATH

系统环境变量文件profile配置完成后保存并退出即可,随后执行“source /etc/profile”命令初始化系统环境变量使配置内容生效。

Spark环境验证

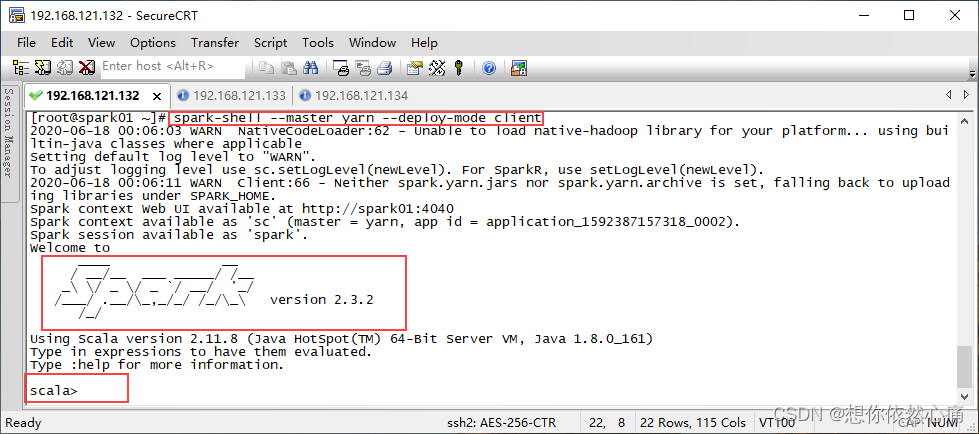

在虚拟机Spark01,执行“spark-shell --master yarn --deploy-mode client”命令进入6.Spark Shell交互界面。

在这里插入图片描述

三、Spark集群测试

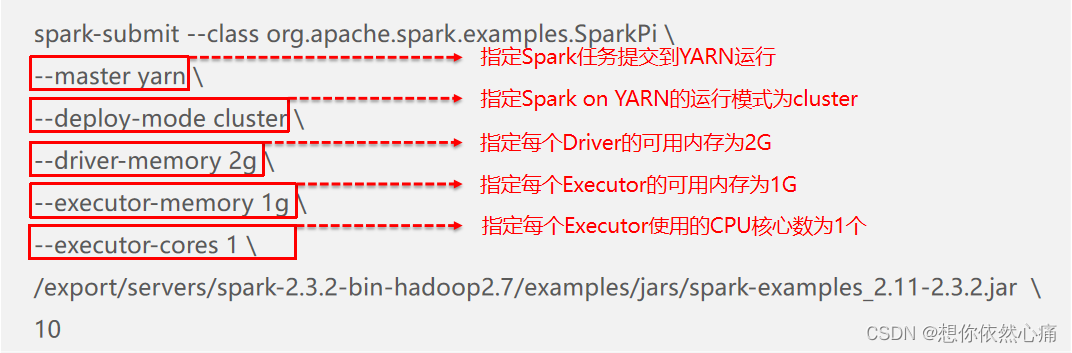

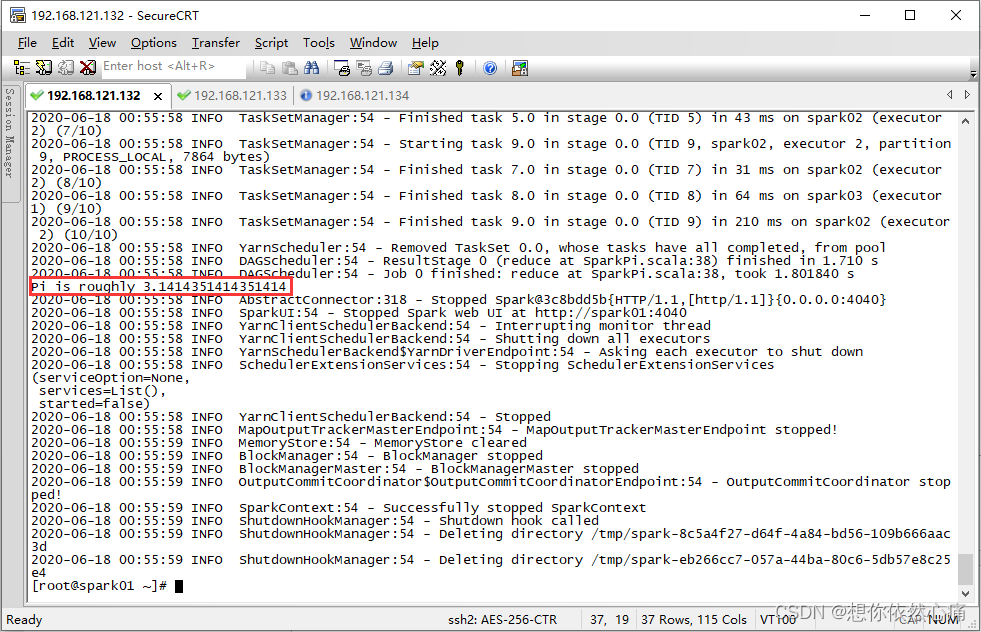

- 在虚拟机Spark01,使用Spark官方示例SparkPi,验证Spark任务是否可以成功提交到YARN中运行。

spark-submit --class org.apache.spark.examples.SparkPi \ --master yarn \ --deploy-mode cluster \ --driver-memory 2g \ --executor-memory 1g \ --executor-cores 1 \ /export/servers/spark-2.3.2-bin-hadoop2.7/examples/jars/spark-examples_2.11-2.3.2.jar \ 10

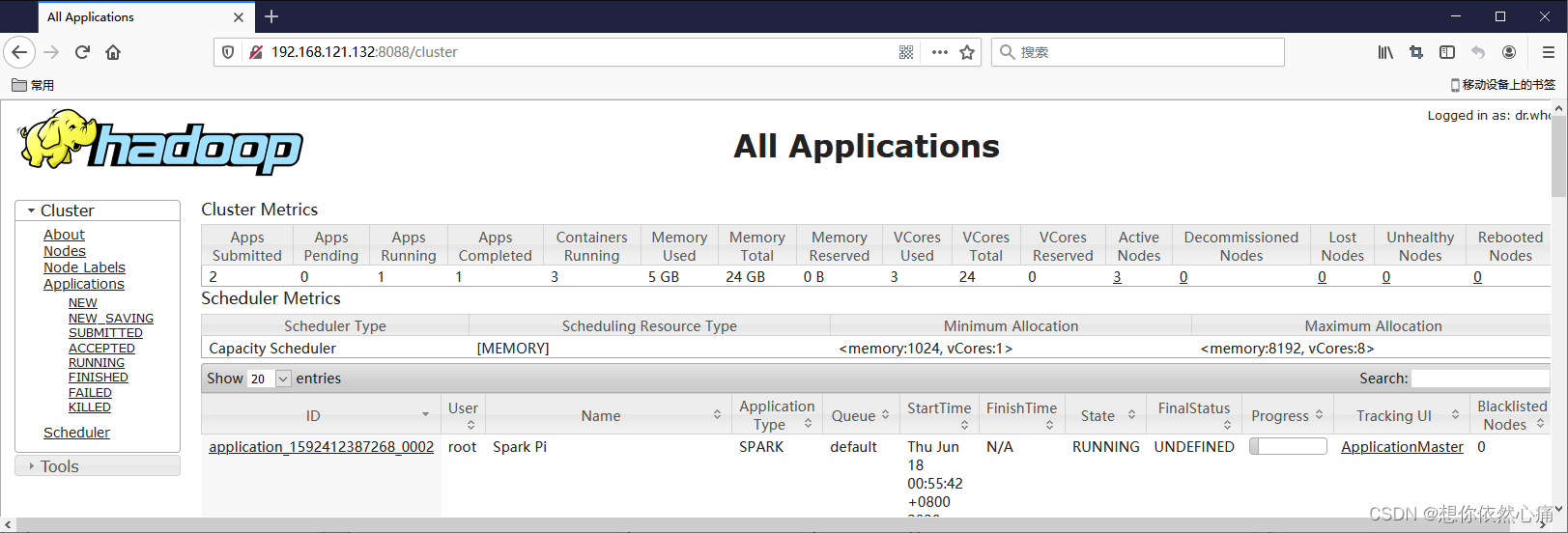

在浏览器输入http://192.168.121.132:8088查看YARN管理界面,State为“RUNNING”表示当前YARN中正在执行的Spark任务。

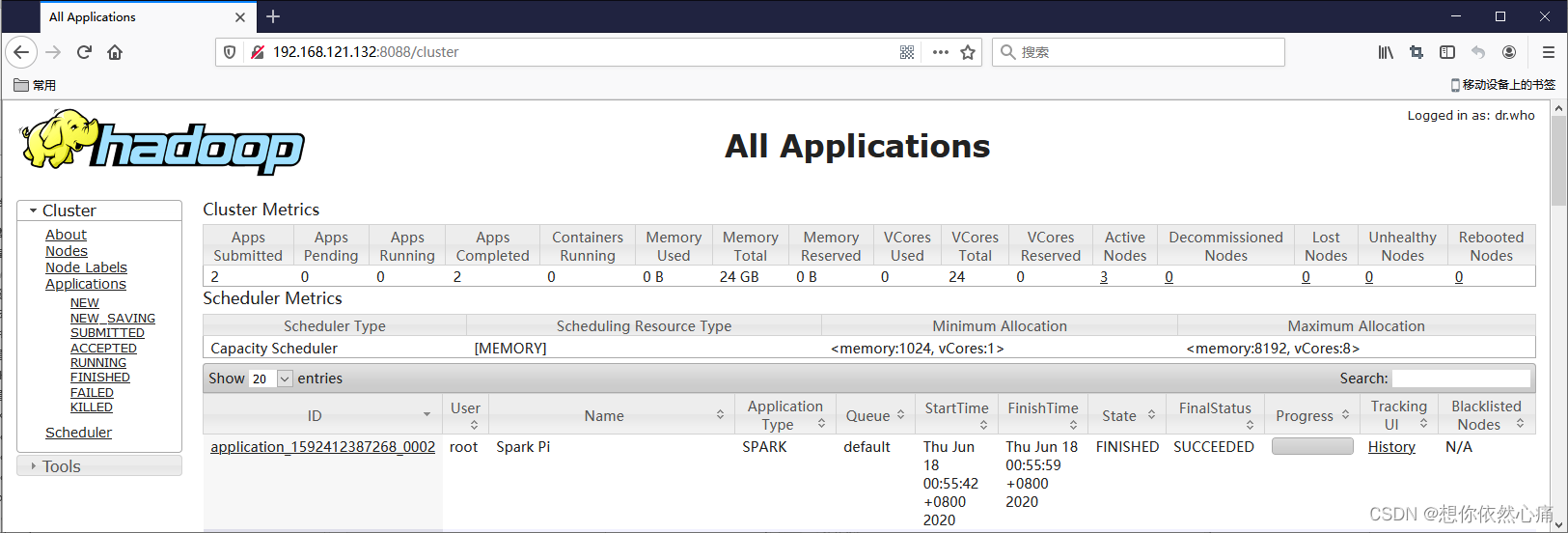

State为“FINISHED”表示当前YARN的Spark任务执行完成,并且FinalStatus为“SUCCEEDED”表示当前Spark任务执行成功。

执行几秒后刷新页面

在虚拟机Spark01查看Spark任务执行结果。

注意:解决Spark提交任务要YARN异常问题

为了防止提交Spark任务时,YARN可能将Spark任务Kill掉,导致“Failed to send RPC xxxxxx”异常,可以在Hadoop配置文件yarn-site.xml中添加如下内容

<property> <name>yarn.nodemanager.pmem-check-enabled</name>#是否启动一个线程检查每个任务正使用的物理内存量,如果任务超出分配值,则直接将其杀掉,默认是true。 <value>false</value> </property> <property> <name>yarn.nodemanager.vmem-check-enabled</name>#是否启动一个线程检查每个任务正使用的虚拟内存量,如果任务超出分配值,则直接将其杀掉,默认是true。 <value>false</value> </property>

好了,Spark的集群部署和启动与关闭我们就讲到这里了,下一篇我们将讲解HBase集群部署和启动与关闭