本题良心正解

冰中月在这道题解上花了很多时间(从晚上8点写到10点),所以请点个赞

我并不能保证你能学会,但是肯定是有收获的~

所以,不要偷懒啦~

给冰中月点个关注和给这篇题解点个赞吧~

谢谢啦~

好了好了,来点儿正经的:

很多萌新在偷看题解的时候,一看题解这么多字就很害怕,看不下去了(包括我)

所以,我每篇题解都尽量的省了,请大家认真看好吗~

还有一个问题就是,点开题解看了好久,突然发现和Y总讲的方法不一样(崩溃)

但是又想记住Y总的方法,

所以,我的题解都是和Y总的方法一样的(如果有Y总讲解的话),你可以放心把它复制粘贴到代码框AC这道题

希望各位能看懂~

还是那句话:求关注,求点赞,求收藏~

下面详解见,灰灰~

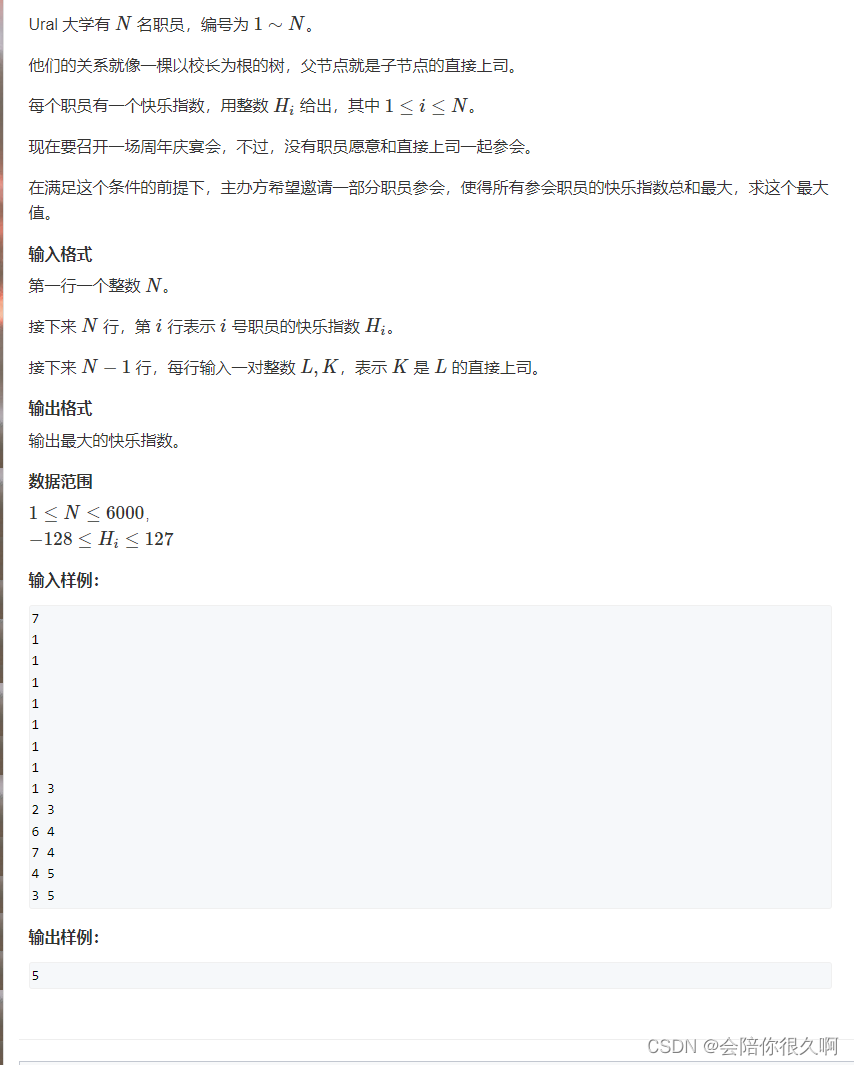

题目描述

UralUral 大学有 NN 名职员,编号为 1∼N1∼N。

他们的关系就像一棵以校长为根的树,父节点就是子节点的直接上司。

每个职员有一个快乐指数,用整数 HiHi 给出,其中 1≤i≤N1≤i≤N。

现在要召开一场周年庆宴会,不过,没有职员愿意和直接上司一起参会。

在满足这个条件的前提下,主办方希望邀请一部分职员参会,使得所有参会职员的快乐指数总和最大,求这个最大值。

输入格式

第一行一个整数 NN。

接下来 NN 行,第 ii 行表示 ii 号职员的快乐指数 HiHi。

接下来 N−1N−1 行,每行输入一对整数 L,KL,K,表示 KK 是 LL 的直接上司。

输出格式

输出最大的快乐指数。

数据范围

1≤N≤60001≤N≤6000,

−128≤Hi≤127−128≤Hi≤127

输入样例:

7

1

1

1

1

1

1

1

1 3

2 3

6 4

7 4

4 5

3 5

输出样例:

5

解释一下题目

这道题题目看上去花里胡哨的,但其实挺好理解的

前NN行表示第ii号职工的快乐指数

后面的N−1N−1行输入两个整数L,KL,K,表示 KK 是 LL 的直接 的爸爸 上司,如图。

要求使得所有参会职员的快乐指数总和最大。

在这儿讲解一下样例

根据这个样例,我们可以画出一张图(如果还不知道样例是什么意思的看上面),如下:

那输出样例的5是怎么来的呢?

请看:

根据画图得出,⑤是根节点(校长)。

在这个样例里,我们必须选校长,为什么呢?

比如我们选了③,那他的下属全部KO,或者选了④,也是一样

那我们的最大快乐值就变成了2,错误

只有我们选了⑤,那剩下的①、②、⑥、⑦才能苟活被选中

我们现在选了⑤,那我们就可以有五个人参加,且快乐值是最大的,为5,选中的表高光,如图:

注意:

如果选了当前节点u,那么他所有的儿子都不能选

如果不选当前节点u,那么他所有的儿子既可以选,也可以不选

弱弱地问一句,题目看懂并理解了吧…

算法1

(树形DP) O(n)O(n)

看图:

这里可以去听一下Y总的视频QWQ,因为必须用文字和图片表述,可能不太清楚~

祝你看得懂~

时间复杂度

参考文献

C++ 代码

#include #include #include using namespace std; const int N = 6010; int n; int happy[N]; //每个职工的高兴度 int f[N][2]; //上面有解释哦~ int e[N],ne[N],h[N],idx; //链表,用来模拟建一个树 bool has_father[N]; //判断当前节点是否有父节点 void add(int a,int b){ //把a插入树中 e[idx] = b,ne[idx] = h[a],h[a] = idx ++; } void dfs(int u){ //开始求解题目 f[u][1] = happy[u]; //如果选当前节点u,就可以把f[u,1]先怼上他的高兴度 for(int i = h[u];~i;i = ne[i]){ //遍历树 int j = e[i]; dfs(j); //回溯 //状态转移部分,上面有详细讲解~ f[u][0] += max(f[j][1],f[j][0]); f[u][1] += f[j][0]; } } int main(){ scanf(“%d”,&n); for(int i = 1;i <= n;i ++) scanf(“%d”,&happy[i]); //输入每个人的高兴度 memset(h,-1,sizeof h); //把h都赋值为-1 for(int i = 1;i < n;i ++){ int a,b; //对应题目中的L,K,表示b是a的上司 scanf(“%d%d”,&a,&b); //输入~ has_father[a] = true; //说明a他有爸爸(划掉)上司 add(b,a); //把a加入到b的后面 } int root = 1; //用来找根节点 while(has_father[root]) root ++; //找根节点 dfs(root); //从根节点开始搜索 printf(“%d\n”,max(f[root][0],f[root][1])); //输出不选根节点与选根节点的最大值 return 0; }

如果你学不会的话

你可以怀疑一下自己的智商,或者找冰中月帮你怀疑一下

再看一遍或者再康一遍Y总的讲解视频。

。

算法1

(树形DP) O(n)O(n)

题解里的人都建图了啊,但是这题明明可以不用这么麻烦的……

本题稍加思索即可得出为树形dp。

每个人只有两种状态,则设dp[0][i]dp[0][i]为第ii个人不来,他的下属所能获得的最大快乐值;dp[1][i]dp[1][i]为第ii个人来,他的下属所能获得的最大快乐值。

所以容易推出状态转移方程:

dp[0][i]=∑u=sonsmax(dp[1][u],dp[0][u])dp[0][i]=∑u=sonsmax(dp[1][u],dp[0][u])当前节点不选,那么子节点随意

dp[1][i]=∑u=sonsdp[0][u]+happy[i]dp[1][i]=∑u=sonsdp[0][u]+happy[i]当前节点选,子节点不能选

分析可得,每个人的状态要在下属的状态更新完了才能更新,所以用类似拓扑的方法,只记录每个子节点的父亲,最后从所有入度为00的点开始跑就行了。在更新每个子节点时顺便让父节点加上自己的权值,最后访问父节点时权值已经更新好了,就可以省去建图的麻烦。

C++ 代码

#include #include using namespace std; int dp[2][6010];//dp解释见上 int f[2][6010];//f[0]为父亲,f[1]为高兴值 int ind[6010];//入度 int vis[6010];//访问标记 int root;//树的根 void dfs(int u){//递归从后往前更新 if(!u) return; vis[u]=1;//已访问 root=u;//最后一个访问到的一定是根,所以一直更新根就行了 dp[0][f[0][u]]+=max(dp[1][u]+f[1][u],dp[0][u]);//给父亲更新 dp[1][f[0][u]]+=dp[0][u]; ind[f[0][u]]–;//更新完一个子节点 if(!ind[f[0][u]]) dfs(f[0][u]);//在所有子节点更新后再更新(入度为0) } int main(){ int n=0; scanf(“%d”,&n); for(int i=1;i<=n;i++) scanf(“%d”,&f[1][i]); int a,b; for(int i=1;i<n;i++){ scanf(“%d%d”,&a,&b); f[0][a]=b;//保存节点信息 ind[b]++; } for(int i=1;i<=n;i++) if(!vis[i]&&!ind[i])//没有被访问过,没有入度,说明是叶子节点 dfs(i); printf(“%d\n”,max(dp[0][root],dp[1][root]+f[1][root]));//取根节点两种方案的最大值 return 0; }