https://modelscope.cn/docs/LLM%E9%87%8F%E5%8C%96%E6%96%87%E6%A1%A3 链接中对原始模型量化,类似这样的命令:

CUDA_VISIBLE_DEVICES=0 swift export \

--model_type qwen1half-7b-chat --quant_bits 4 \

--dataset alpaca-zh alpaca-en sharegpt-gpt4:default --quant_method awq

想给各专家了解下如下几个问题:

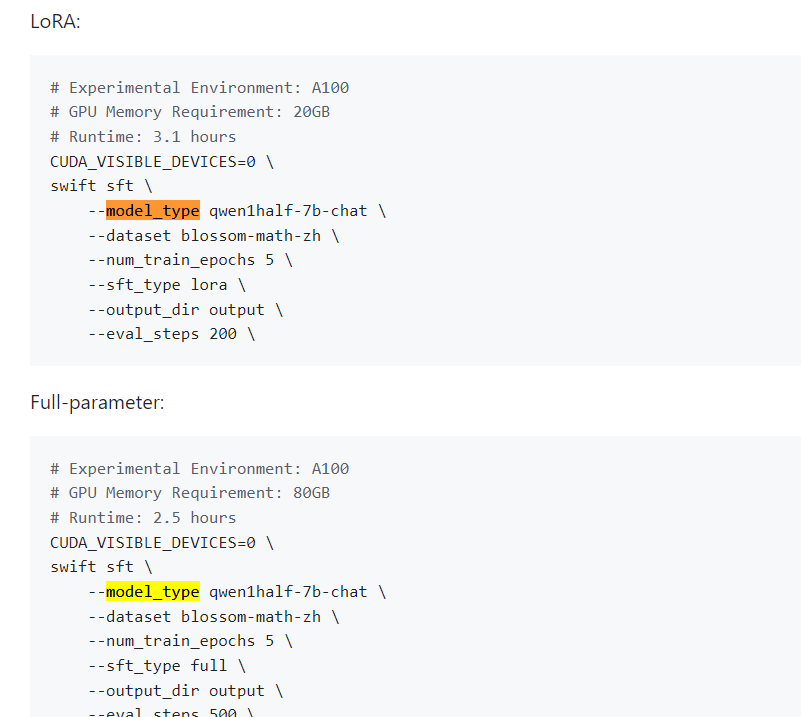

1、命令中的model_type取值都有哪些呢?怎么去确定这个取值

2、如果模型已经下载到本地,是不是有其他参数可以指定(swift 没找到查看相关选项,命令的操作)

3、在该文档中所有操作涉及到的--model_type含义都是一养的吗?比如推理

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

https://github.com/modelscope/swift

quant_bits:指定量化的位数,量化可以减少模型的精度,以换取更快的推理速度和更小的模型大小。

dataset:指定用于模型训练或评估的数据集。

阿里云自主研发的千问大模型,凭借万亿级超大规模数据训练和领先的算法框架,实现全模态高效精准的模型服务调用。https://www.aliyun.com/product/tongyi