"

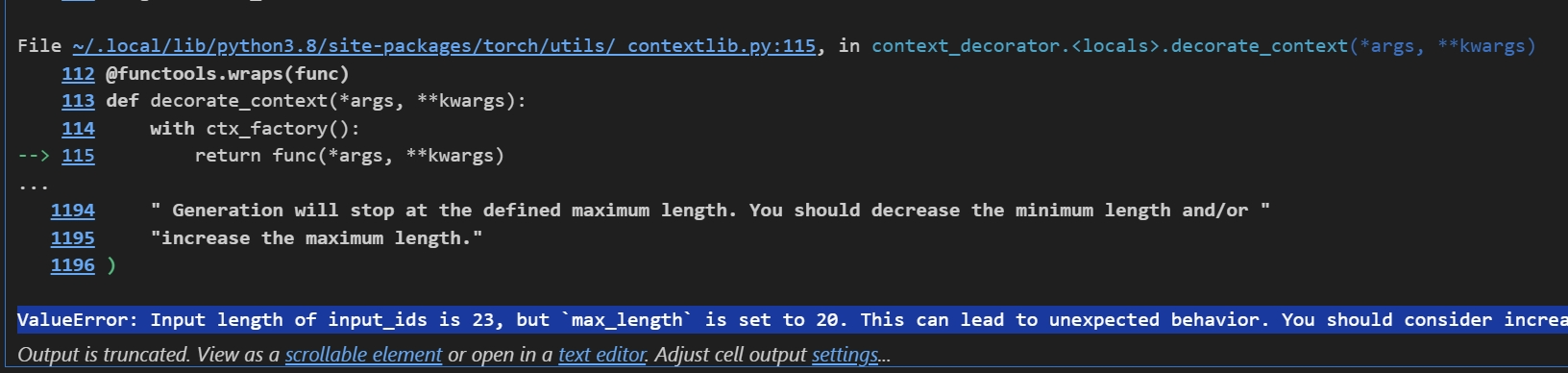

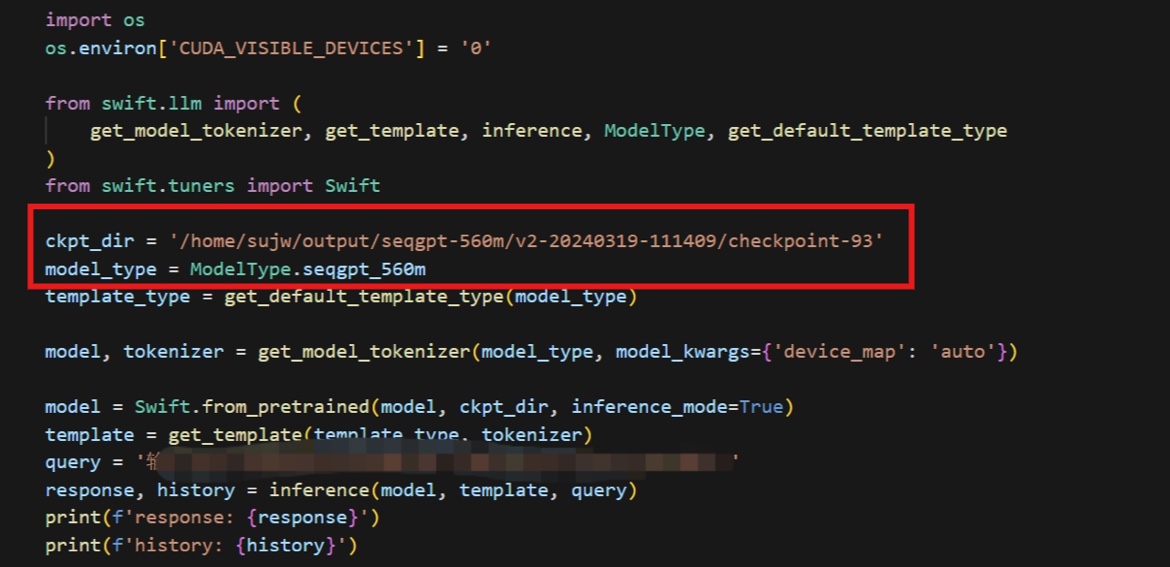

ModelScope训练之后推理报错了,已经尝试设置max_length为1024,没有作用?"

如果在ModelScope训练之后的推理过程中遇到报错,并且设置max_length为1024没有解决问题,可能的原因包括:

val和type键。max_length不会超过模型能够处理的最大长度。综上所述,解决ModelScope训练后的推理问题需要综合考虑多个方面,从配置到数据,再到模型本身,逐一排查可能的问题所在。如果上述方法仍然无法解决问题,建议联系ModelScope的客户支持或技术团队寻求帮助。

ModelScope旨在打造下一代开源的模型即服务共享平台,为泛AI开发者提供灵活、易用、低成本的一站式模型服务产品,让模型应用更简单!欢迎加入技术交流群:微信公众号:魔搭ModelScope社区,钉钉答疑群:44837352