微调输出的路径与文件与ModelScope 的文档里不太一样,不知道这个微调后的模型要怎么调用?

当你使用ModelScope进行微调后,生成的微调模型文件路径和文件名可能与ModelScope文档中的示例不完全一样。这是因为具体的路径和文件名取决于你在微调过程中所指定的输出路径和命名规则。

要调用微调后的模型,你需要了解微调模型的文件路径和结构,并使用相应的代码加载该模型。以下是一般步骤:

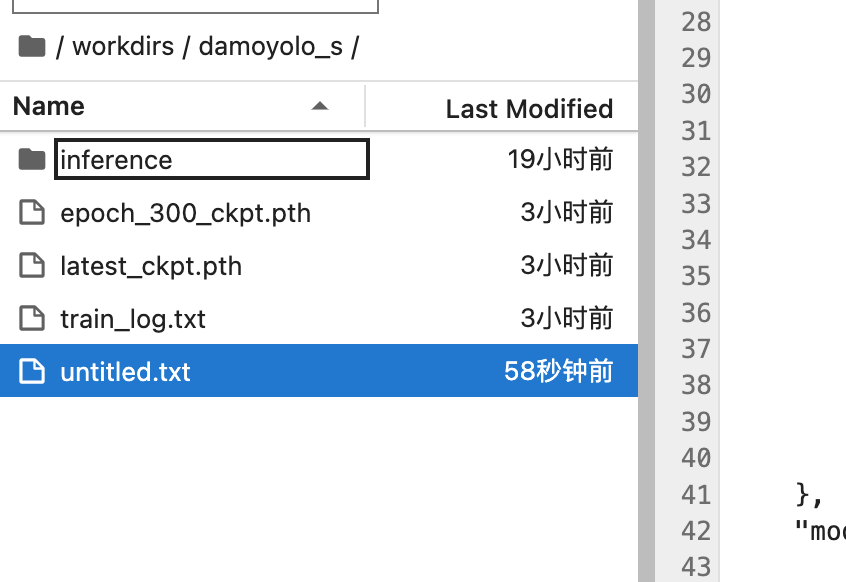

确认微调模型的保存位置:检查你在微调过程中指定的输出路径,确认微调模型的保存位置。这通常是一个文件夹或目录。

检查微调模型的文件结构:浏览微调模型所在的文件夹,确保其中包含了正确的模型文件和相关文件(例如权重文件、配置文件等)。

使用适当的代码加载模型:根据你选择的深度学习框架和编程语言,使用相应的代码来加载微调模型。不同的框架和库有不同的调用方式,你可以参考相应的文档和示例代码来了解如何加载模型。

进行模型推断:一旦成功加载了微调模型,你可以使用相应的代码进行模型推断。根据你的任务和模型类型,你可能需要提供输入数据,并处理模型的输出结果。

在微调模型后,通常需要将微调后的模型保存到磁盘上,并在后续的推理或部署过程中加载和使用它。在 ModelScope 中,您可以使用以下方法来保存和加载微调后的模型:

保存微调后的模型:在微调模型后,您可以使用 TensorFlow 或 PyTorch 等深度学习框架提供的保存模型方法,将微调后的模型保存到磁盘上。例如,使用 TensorFlow 保存模型可以使用以下代码:

python

Copy

model.save('my_finetuned_model')

这将保存名为 "my_finetuned_model" 的模型到当前目录下。

加载微调后的模型:在后续的推理或部署过程中,您可以使用 ModelScope 提供的模型加载方法来加载微调后的模型。例如,使用以下代码加载 TensorFlow 模型:

python

Copy

from models.tensorflow import TensorFlowModel

model = TensorFlowModel.from_saved_model('my_finetuned_model')

这将加载名为 "my_finetuned_model" 的 TensorFlow 模型,并返回一个 TensorFlowModel 对象,可以使用它进行推理等操作。