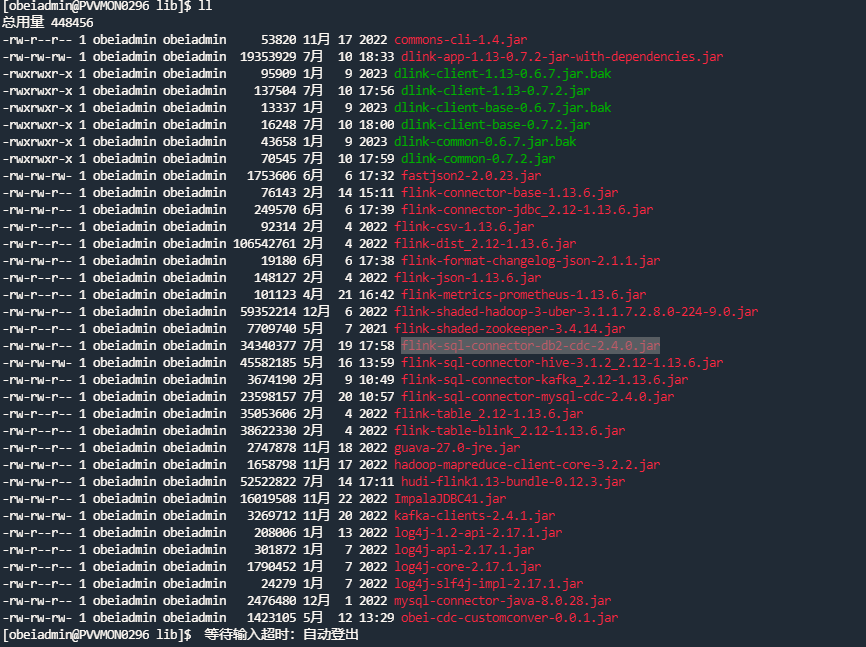

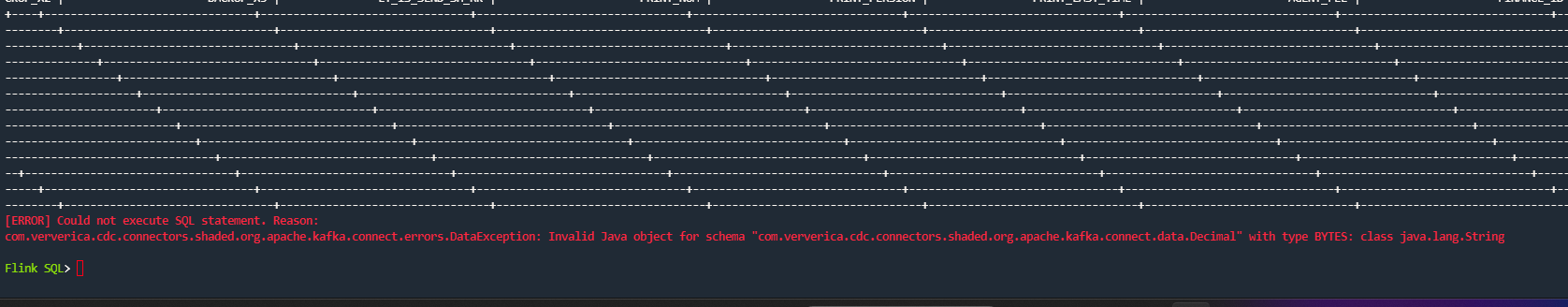

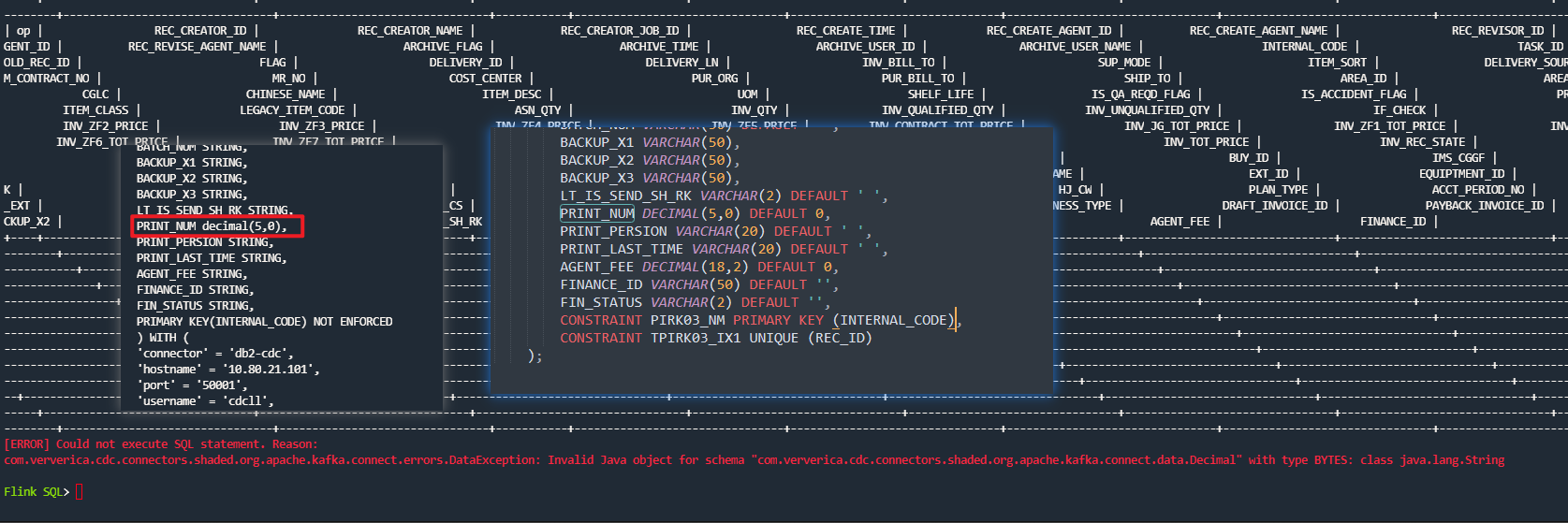

"Flink CDC中这个报错有遇到过吗?读取MySQL的数据和Kafka有什么关系?怎么会报一个Kafka的类型问题?

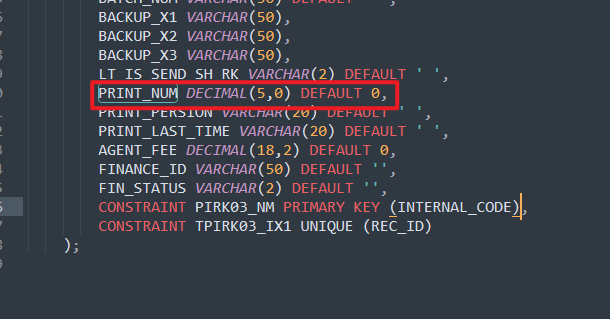

这张源表给的是decimal类型,但是看changelog的default 值是一个string。

"

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

在你的问题中没有提到具体的报错信息,因此无法确定是否遇到了特定的错误。但是我可以回答你关于 Flink CDC 读取 MySQL 数据和 Kafka 的关系的问题。

Flink CDC 是用于捕获和处理关系型数据库(如 MySQL)中的变更事件,并将其转发到目标系统(如 Kafka、HDFS、Elasticsearch 等)。因此,Flink CDC 与 Kafka 之间确实存在一定的关系。

具体来说,Flink CDC 提供了 MySQL 和其他关系型数据库的连接器,以便订阅并获取这些数据库中的变更事件。然后,它将这些变更事件转换为 Flink DataStream 流,并将其发送到目标系统(如 Kafka)。

通过使用 Flink CDC 将 MySQL 数据库中的变更事件发送到 Kafka,你可以实现实时数据流同步、消息队列构建、数据湖集成等应用场景。Kafka 可以作为一个可靠的分布式消息队列,持久化存储和传递这些变更事件,供其他消费者进行实时或离线处理。

简而言之,在 Flink CDC 中,MySQL 数据库充当源端,Flink CDC 通过连接器从 MySQL 中读取数据变更,然后将其发送到 Kafka 中。Kafka 可以作为中间层,接收和分发这些变更事件,以供其他系统或应用程序消费和处理。

Flink CDC 会从 MySQL 中的 binlog 日志中读取数据变更事件,并将其转换为 Flink 数据流进行处理。然后,可以使用 Flink 的 Kafka Connector 将处理后的数据写入到 Kafka 中,或者使用 Flink 的其他 Sink 进行数据下沉。

如果您遇到了 Flink CDC 中的报错,可以根据报错信息进行排查。通常情况下,常见的报错类型包括数据库连接失败、数据格式不匹配、数据丢失、数据重复等。您可以检查 Flink CDC 的配置、数据源的状态、CDC Connector 的日志等信息,以确定问题的根源和解决方案。

需要注意的是,在将数据从 MySQL 同步到 Kafka 时,可能会存在数据格式转换的问题,例如将 MySQL 中的数据类型转换为 Kafka 中的数据类型。在进行数据类型转换时,需要注意类型的匹配和兼容性,避免出现数据丢失或数据错误的情况

实时计算Flink版是阿里云提供的全托管Serverless Flink云服务,基于 Apache Flink 构建的企业级、高性能实时大数据处理系统。提供全托管版 Flink 集群和引擎,提高作业开发运维效率。