有大佬知道怎么使用flink cdc同步MySQL数据库数据到oceanbase数据库吗?

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

使用 Apache Flink 实现 MySQL 数据库到 OceanBase 数据库的 CDC (Change Data Capture) 同步,可以通过以下步骤进行:

前置条件:

设置 MySQL CDC Source:

# Debezium MySQL Source 示例配置

mysql-source:

type: debezium-mysql

url: jdbc:mysql://mysql_host:3306/mydb

username: myuser

password: mypass

database-whitelist: "mydatabase"

table-whitelist: "myschema.mytable"

...

配置 OceanBase Sink:

# OceanBase JDBC Sink 示例配置

oceanbase-sink:

type: jdbc

url: jdbc:oceanbase://ob_host:2881/mytenant

tableName: "target_schema.target_table"

username: obuser

password: obpass

sink.buffer-flush.max-rows: 1000

sink.buffer-flush.interval: 1s

...

构建 Flink Job:

CREATE TABLE mysql_source (

-- 根据Debezium解析出来的字段定义表结构

) WITH (...);

CREATE TABLE oceanbase_sink (

-- 根据OceanBase的目标表结构定义表

) WITH (...);

INSERT INTO oceanbase_sink

SELECT * FROM mysql_source;

或者在 DataStream API 中:

StreamExecutionEnvironment env = StreamExecutionEnvironment.getExecutionEnvironment();

StreamTableEnvironment tEnv = StreamTableEnvironment.create(env);

// 配置MySQL source表

tEnv.executeSql(...);

// 配置OceanBase sink表

tEnv.executeSql(...);

tEnv.toRetractStream(...)

.map(...) // 处理数据类型映射和转换

.addSink(JdbcSink.sink(...)); // 将数据写入OceanBase

在Flink作业中配置MySQL源,提供必要的MySQL连接信息以读取binlog。

配置OceanBase Sink,指定目标数据库的相关参数,包括但不限于主机地址、端口、用户名、密码以及表映射关系。

楼主你好,要使用阿里云Flink CDC将MySQL数据库数据同步到OceanBase数据库,可以按照以下步骤进行操作:

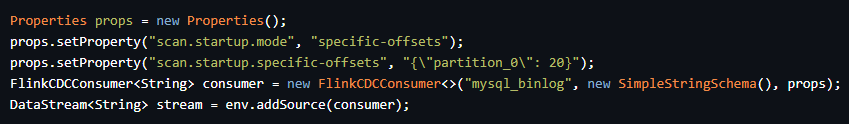

Properties props = new Properties();

props.setProperty("scan.startup.mode", "specific-offsets");

props.setProperty("scan.startup.specific-offsets", "{\"partition_0\": 20}");

FlinkCDCConsumer<String> consumer = new FlinkCDCConsumer<>("mysql_binlog", new SimpleStringSchema(), props);

DataStream<String> stream = env.addSource(consumer);

这里的mysql_binlog是Flink CDC source connector的名字,可以自行设置。

可选的话,对MySQL的数据进行ETL转换处理,如数据清洗、格式转换等。可以使用Flink提供的各种转换算子,如map(), flatMap(), filter()等。

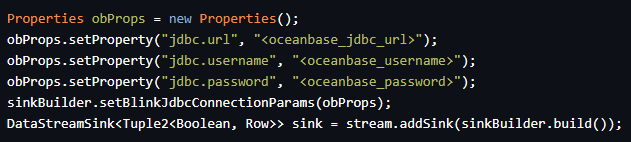

创建一个Flink的sink connector来将数据写入OceanBase数据库。可以使用以下代码示例创建一个OceanBase sink connector:

Properties obProps = new Properties();

obProps.setProperty("jdbc.url", "<oceanbase_jdbc_url>");

obProps.setProperty("jdbc.username", "<oceanbase_username>");

obProps.setProperty("jdbc.password", "<oceanbase_password>");

sinkBuilder.setBlinkJdbcConnectionParams(obProps);

DataStreamSink<Tuple2<Boolean, Row>> sink = stream.addSink(sinkBuilder.build());

这里的<oceanbase_jdbc_url>是OceanBase数据库的JDBC连接URL,<oceanbase_username>和<oceanbase_password>是OceanBase数据库的登录用户名和密码。

以上步骤仅为大致的操作流程,具体的实现需要根据实际环境和需求进行调整。

a. 配置Flink CDC和MySQL CDC的连接信息,包括MySQL数据库的IP地址、端口、用户名、密码等信息,以及Flink CDC的连接信息,包括项目名称、作业名称、日志路径等信息。

b. 在Flink CDC的配置文件中配置源表和目标表的映射关系,包括源表的名称、字段映射关系等信息,以及目标表的名称、字段映射关系等信息。

c. 配置Flink CDC的触发器,使其在源表发生变化时触发同步操作。可以使用主动模式同步或被动模式同步。

d. 启动Flink CDC作业,并在指定的数据同步频率下执行同步操作。

e. 在OceanBase数据库中配置数据同步接口,以便接收Flink CDC同步过来的数据。

目前 Flink CDC 仅支持 MySQL 数据库,不支持 OceanBase 数据库。如果您想将 MySQL 数据库的数据同步到 OceanBase 数据库,可以考虑以下两种方式:

使用 Flink CDC 从 MySQL 数据库同步数据到 OceanBase 数据库https://www.oceanbase.com/docs/common-oceanbase-database-cn-1000000000218002

实时计算Flink版是阿里云提供的全托管Serverless Flink云服务,基于 Apache Flink 构建的企业级、高性能实时大数据处理系统。提供全托管版 Flink 集群和引擎,提高作业开发运维效率。