Flink CDC oracle的历史数据,可以正常获取,但是新增数据,立马报错

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

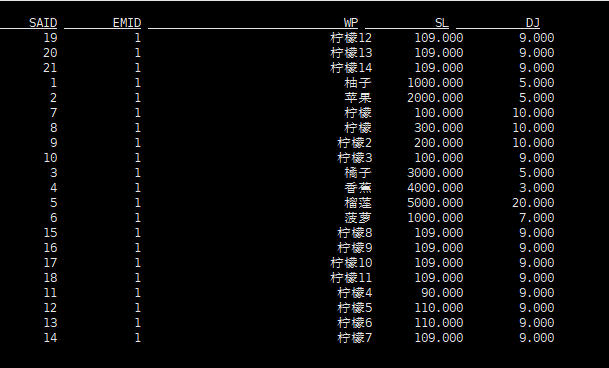

问题描述: 用户在使用Flink CDC从Oracle数据库同步数据时,发现能够正常获取历史数据,但在尝试捕获新增数据时立即遇到错误。

解决方案:

检查LogMiner配置与权限:首先确认Oracle LogMiner是否正确配置且具有读取redo log和archive log的必要权限。确保V$LOGMNR_CONTENTS视图可被当前用户访问。

表名长度限制:确认所有需要同步的表名及列名长度不超过30个字符,因为Oracle LogMiner对此有限制。

字段名称匹配:确保Flink作业中定义的字段名称(包括大小写)与Oracle表中的字段完全一致,避免因字段名称不匹配导致的“file is not a valid field name”错误。

优化读取效率:如果报错与读取性能相关,考虑调整Oracle CDC的架构或采用更高效的数据集成工具如Dataphin,以提高增量数据处理速度。

监控与资源调整:检查是否有资源不足或反压情况,根据实时计算任务的资源需求适当调整资源配置,确保source能及时消费Binlog数据。

注意事项:

常见问题排查:

通过上述步骤,可以系统地诊断并解决Flink CDC在Oracle环境下同步新增数据时遇到的问题。务必逐一排查,从基础配置到高级优化,确保每个环节都符合要求。您可以复制页面截图提供更多信息,我可以进一步帮您分析问题原因。

实时计算Flink版是阿里云提供的全托管Serverless Flink云服务,基于 Apache Flink 构建的企业级、高性能实时大数据处理系统。提供全托管版 Flink 集群和引擎,提高作业开发运维效率。