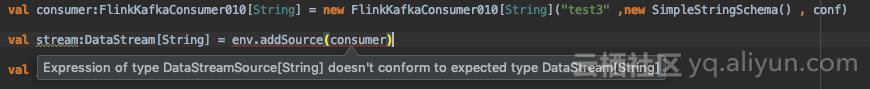

不知道DataStreamSource到DataStream要怎么处理

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

在阿里云DataWorks(原Data IDE)中,从DataStreamSource到DataStream的处理,实际上是指将数据源接入到数据流处理中的过程。这涉及到数据集成、数据开发等环节。下面是一个简化的流程说明,帮助您理解如何进行操作:

创建数据源(DataStreamSource):

创建数据同步任务:

数据开发(转换为DataStream):

调度与运行:

结果查看与验证:

整个过程涉及到了数据的抽取(Extract)、转换(Transform)、加载(Load),即ETL流程,是大数据处理中非常常见的场景。阿里云DataWorks提供了丰富的工具和服务,支持用户高效地完成这些操作。