欢迎访问我的GitHub

这里分类和汇总了欣宸的全部原创(含配套源码): https://github.com/zq2599/blog_demos

关于Flink on Yarn三部曲

- 本文是《Flink on Yarn三部曲》的第一篇,整个系列由以下三篇组成:

- 准备工作:搭建Flink on Yarn环境前,将所有硬件、软件资源准备好;

- 部署和设置:部署CDH和Flink,然后做相关设置

- Flink实战:在Yarn环境提交Flink任务

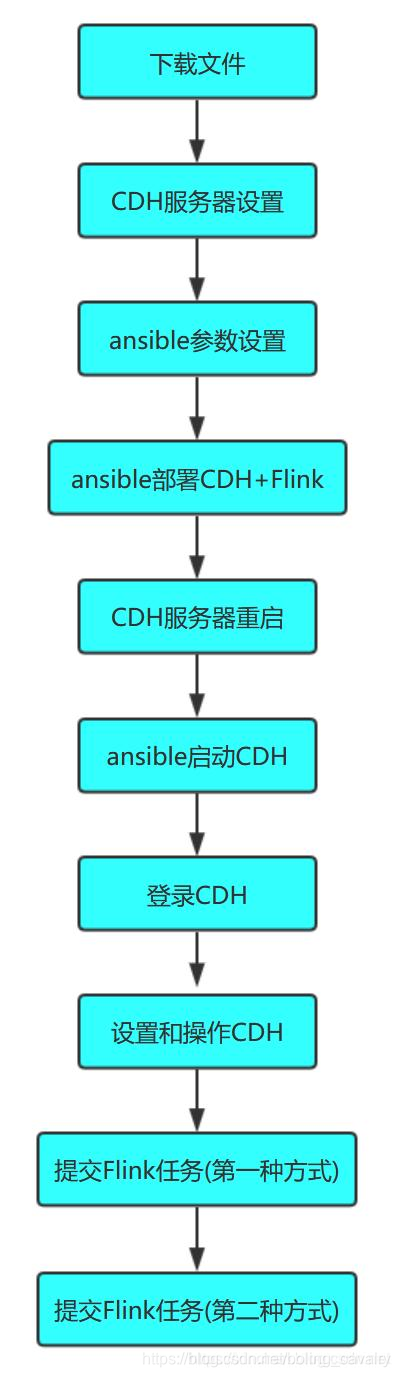

- 整个三部曲的实战内容如下图所示:

- 接下来就从最基本的准备工作开始吧。

关于Flink on Yarn

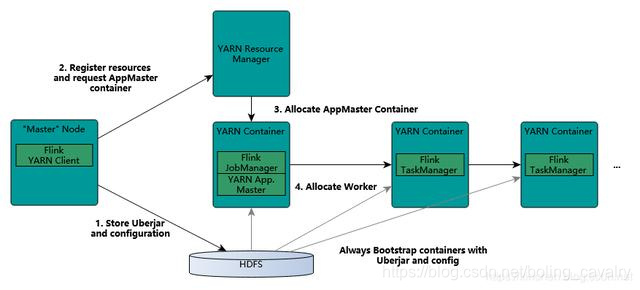

- 除了常见的standalone模式,Flink还支持将任务提交到Yarn环境执行,任务所需的计算资源由Yarn Remource Manager来分配,如下图(来自Flink官网):

- 因此需要搭建一套Yarn环境,通过CDH部署Yarn、HDFS等服务是常见方式,接下来就采用此方式来部署;

部署方式

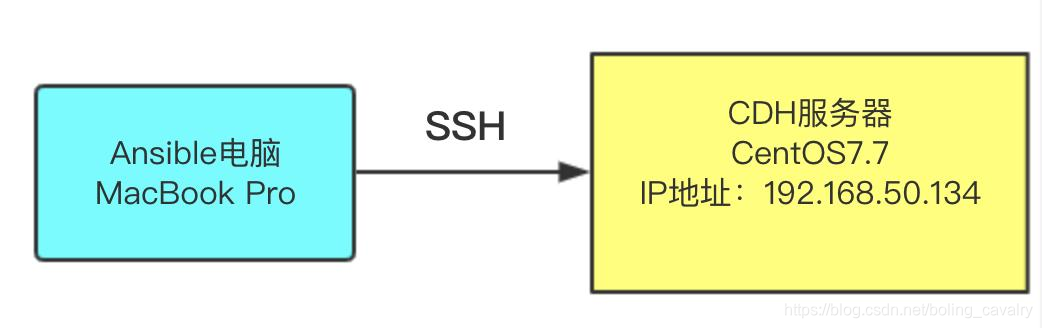

- ansible是常用的运维工具,可以大幅度简化整个部署过程,接下来会使用ansible来完成部署工作,如果您对ansible还不够了解,请参考《ansible2.4安装和体验》,部署操作如下图所示,在一台安装了ansible的电脑上运行脚本,由ansible远程连接到一台CentOS7.7的服务器上,完成部署工作:

硬件准备

- 一台可以运行ansible的电脑,我这里用的是MacBook Pro,也用CentOS验证过,都可以顺利完成部署;

- 一台CentOS7.7的电脑用于运行Yarn和Flink(文中的CDH服务器就是指该电脑),为了操作简单,本次实战将CDH、Yarn、HDFS、Flink都部署在这一台机器上,实测发现,此电脑CPU至少要双核,内存不低于16G,如果您想用多台电脑部署CDH,建议自行修改ansible脚本来分别部署,脚本地址后面会给出;

软件版本

- ansible电脑操作系统:macOS Catalina 10.15(实测用CentOS也能成功)

- CDH服务器操作系统:CentOS Linux release 7.7.1908

- cm版本:6.3.1

- parcel版本:5.16.2

- flink版本:1.7.2

注意:因为flink需要hadoop2.6版本,所以parcel选择了5.16.2,这里面对应的hadoop是2.6版

CDH服务器设置

- 需要登录CDH服务器执行以下设置:

- 检查/etc/hostname文件是否正确,如下图:

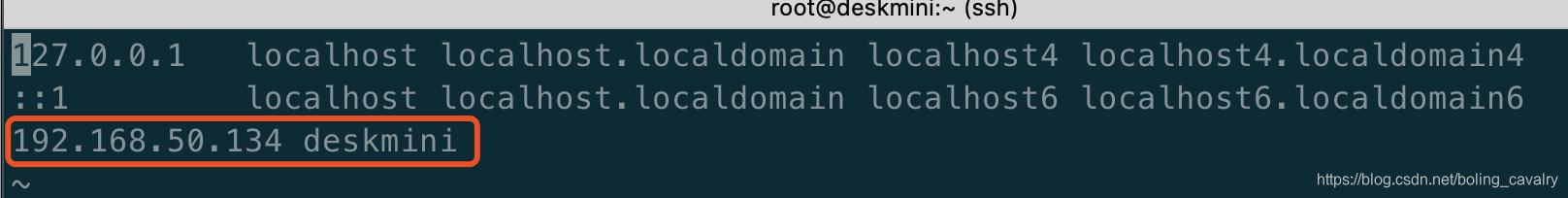

- 修改/etc/hosts文件,将自己的IP地址和hostname配置上去,如下图红框所示(事实证明这一步很重要,如果不做可能导致在部署时一直卡在"分配"阶段,看agent日志显示agent下载parcel的进度一直是百分之零):

下载文件(ansible电脑)

- 本次实战要准备13个文件,如下表所示(后面会给出每个文件的获取方式):

| 编号 | 文件名 | 简介 |

|---|---|---|

| 1 | jdk-8u191-linux-x64.tar.gz | Linux版的jdk安装包 |

| 2 | mysql-connector-java-5.1.34.jar | mysql的JDBC驱动 |

| 3 | cloudera-manager-server-6.3.1-1466458.el7.x86_64.rpm | cm的server安装包 |

| 4 | cloudera-manager-daemons-6.3.1-1466458.el7.x86_64.rpm | cm的daemon安装包 |

| 5 | cloudera-manager-agent-6.3.1-1466458.el7.x86_64.rpm | cm的agent安装包 |

| 6 | CDH-5.16.2-1.cdh5.16.2.p0.8-el7.parcel | CDH应用离线安装包 |

| 7 | CDH-5.16.2-1.cdh5.16.2.p0.8-el7.parcel.sha | CDH应用离线安装包sha验证码 |

| 8 | flink-1.7.2-bin-hadoop26-scala_2.11.tgz | flink安装包 |

| 9 | hosts | ansible用到的远程主机配置,里面记录了CDH6服务器的信息 |

| 10 | ansible.cfg | ansible用到的配置信息 |

| 11 | cm6-cdh5-flink1.7-single-install.yml | 部署CDH时用到的ansible脚本 |

| 12 | cdh-single-start.yml | 初次启动CDH时用到的ansible脚本 |

| 13 | var.yml | 脚本中用到的变量都在在此设值, 例如CDH包名、flink文件名等,便于维护 |

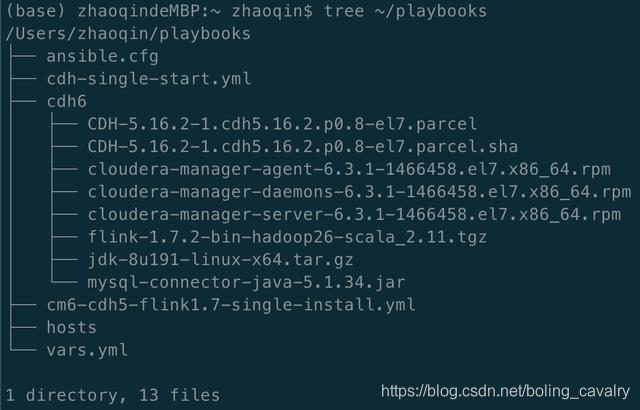

请按照如下位置摆放,这样才能顺利完成部署:

- 在家目录下新建名为playbooks的文件夹:mkdir ~/playbooks

- 把这五个文件放入playbooks文件夹:hosts、ansible.cfg、cm6-cdh5-flink1.7-single-install.yml、cdh-single-start.yml、vars.yml

- 在playbooks文件夹里新建名为cdh6的子文件夹;

- 把这八个文件放入cdh6文件夹(即剩余的八个):jdk-8u191-linux-x64.tar.gz、mysql-connector-java-5.1.34.jar、cloudera-manager-server-6.3.1-1466458.el7.x86_64.rpm、cloudera-manager-daemons-6.3.1-1466458.el7.x86_64.rpm、cloudera-manager-agent-6.3.1-1466458.el7.x86_64.rpm、CDH-5.16.2-1.cdh5.16.2.p0.8-el7.parcel、CDH-5.16.2-1.cdh5.16.2.p0.8-el7.parcel.sha、flink-1.7.2-bin-hadoop26-scala_2.11.tgz

- 摆放完毕后目录和文件情况如下图,再次提醒:文件夹playbooks一定要放在家目录下(即:~/):

ansible参数设置(ansible电脑)

- ansible参数设置的操作设置很简单:配置好CDH服务器的访问参数即可,包括IP地址、登录账号、密码等,修改~/playbooks/hosts文件,内容如下所示,您需要根据自身情况修改deskmini、ansible_host、ansible_port、ansible_user、ansible_password:

[cdh_group]deskmini ansible_host=192.168.50.134 ansible_port=22 ansible_user=root ansible_password=888888- 至此,所有准备工作已完成,下一篇文章我们将完成这些操作:

- 部署CDH和Flink

- 启动CDH

- 设置CDH、在线安装Yarn、HDFS等

- 调整Yarn参数,使Flink任务可以提交成功

欢迎关注阿里云开发者社区博客:程序员欣宸

学习路上,你不孤单,欣宸原创一路相伴...