下载地址:http://pan38.cn/ice000636

项目编译入口:

package.json

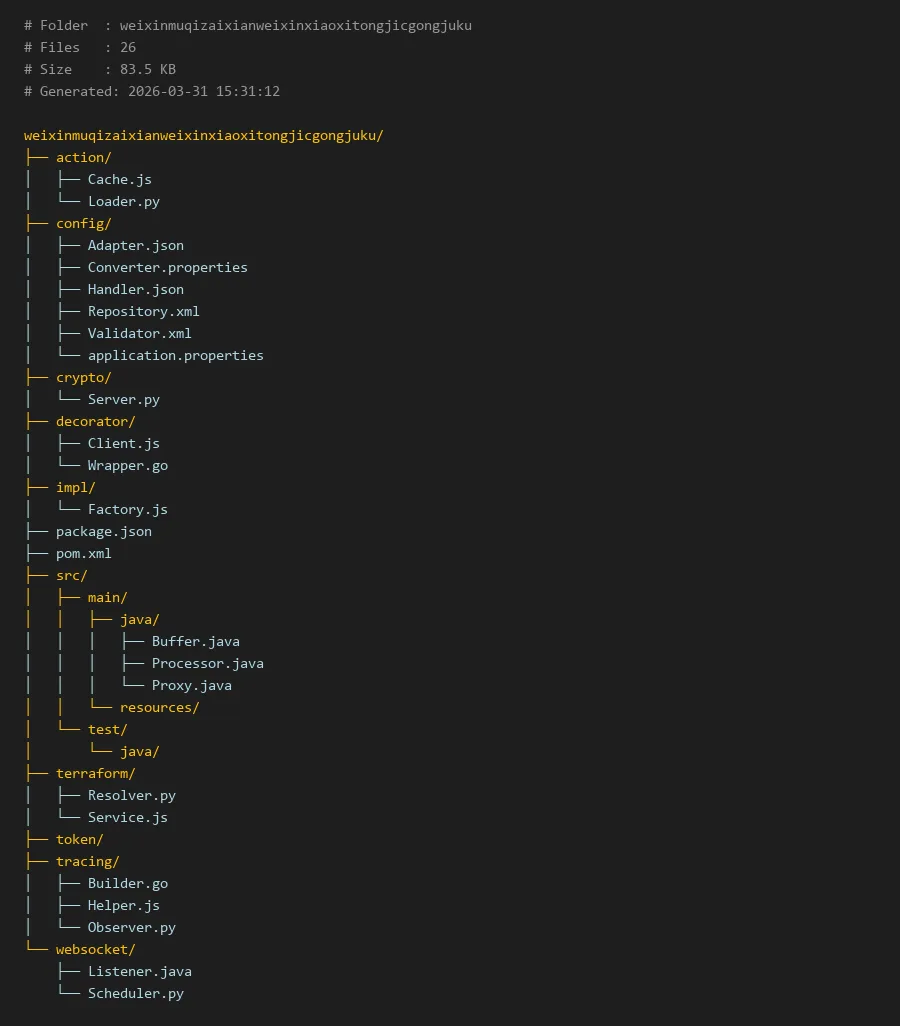

# Folder : weixinmuqizaixianweixinxiaoxitongjicgongjuku

# Files : 26

# Size : 83.5 KB

# Generated: 2026-03-31 15:31:12

weixinmuqizaixianweixinxiaoxitongjicgongjuku/

├── action/

│ ├── Cache.js

│ └── Loader.py

├── config/

│ ├── Adapter.json

│ ├── Converter.properties

│ ├── Handler.json

│ ├── Repository.xml

│ ├── Validator.xml

│ └── application.properties

├── crypto/

│ └── Server.py

├── decorator/

│ ├── Client.js

│ └── Wrapper.go

├── impl/

│ └── Factory.js

├── package.json

├── pom.xml

├── src/

│ ├── main/

│ │ ├── java/

│ │ │ ├── Buffer.java

│ │ │ ├── Processor.java

│ │ │ └── Proxy.java

│ │ └── resources/

│ └── test/

│ └── java/

├── terraform/

│ ├── Resolver.py

│ └── Service.js

├── token/

├── tracing/

│ ├── Builder.go

│ ├── Helper.js

│ └── Observer.py

└── websocket/

├── Listener.java

└── Scheduler.py

weixinmuqizaixianweixinxiaoxitongjicgongjuku:构建在线微信消息系统的技术实践

简介

weixinmuqizaixianweixinxiaoxitongjicgongjuku 是一个用于模拟微信在线消息系统的工具库。该项目旨在为开发者提供一个可扩展、模块化的基础框架,用于构建需要模拟微信消息交互的各类应用,例如自动化测试、聊天机器人原型开发或教学演示。通过这个库,开发者可以快速搭建一个功能完整的微信聊天模拟器在线环境,而无需深入微信官方API的复杂细节。本文将深入解析该项目的核心模块,并通过具体的代码示例展示其使用方法。

核心模块说明

该项目采用分层和模块化的设计思想,主要目录结构清晰,职责分明:

action/: 包含核心的行为逻辑,如数据加载和缓存管理。config/: 存放所有配置文件,支持多种格式(JSON、XML、Properties),用于灵活配置系统组件。crypto/: 负责消息的加密解密逻辑,确保模拟环境中的通信安全。decorator/: 实现了装饰器模式,用于动态地为对象添加功能,增强系统的可扩展性。impl/: 包含核心的工厂类实现,用于创建和管理各种组件实例。src/main/java/: Java核心源代码目录,包含如缓冲区管理等基础工具类。

这种结构使得每个模块都可以独立开发和测试,共同协作构建出一个稳定的微信聊天模拟器在线系统。

代码示例

以下将通过几个关键文件展示项目的核心实现。

1. 工厂模式实现 (impl/Factory.js)

工厂类是系统的中枢,负责根据配置实例化不同的处理器、适配器等组件。

// impl/Factory.js

const config = require('../config/Handler.json');

const adapters = require('../config/Adapter.json');

class ComponentFactory {

static createHandler(handlerType) {

const handlerConfig = config.handlers.find(h => h.type === handlerType);

if (!handlerConfig) {

throw new Error(`Handler type ${

handlerType} not configured.`);

}

// 动态加载模块

const HandlerClass = require(`../action/${

handlerConfig.class}`);

return new HandlerClass(handlerConfig.params);

}

static createAdapter(adapterName) {

const adapterConfig = adapters[adapterName];

if (!adapterConfig) {

throw new Error(`Adapter ${

adapterName} not found.`);

}

// 示例:创建消息转换适配器

return {

convert: (message) => {

// 转换逻辑

return `[${

adapterConfig.prefix}] ${

message}`;

}

};

}

}

module.exports = ComponentFactory;

2. 消息加载与缓存 (action/Loader.py 和 action/Cache.js)

Loader.py 负责从数据源加载原始消息,而 Cache.js 则提供缓存机制以提升性能。

# action/Loader.py

import json

import time

class MessageLoader:

def __init__(self, data_source_path):

self.data_source = data_source_path

def load_messages(self, user_id):

"""模拟从文件或数据库加载用户消息"""

try:

with open(self.data_source, 'r', encoding='utf-8') as f:

all_data = json.load(f)

return all_data.get(user_id, [])

except FileNotFoundError:

print(f"数据源 {self.data_source} 未找到,返回空消息列表。")

return []

// action/Cache.js

class LRUCache {

constructor(capacity = 100) {

this.capacity = capacity;

this.cache = new Map(); // 使用Map保持插入顺序

}

get(key) {

if (!this.cache.has(key)) {

return null;

}

// 使用过,提到最前(最新)

const value = this.cache.get(key);

this.cache.delete(key);

this.cache.set(key, value);

return value;

}

put(key, value) {

if (this.cache.has(key)) {

this.cache.delete(key);

} else if (this.cache.size >= this.capacity) {

// 删除最久未使用的(Map的第一个键)

const oldestKey = this.cache.keys().next().value;

this.cache.delete(oldestKey);

}

this.cache.set(key, value);

}

}

module.exports = LRUCache;

3. 核心消息缓冲区 (src/main/java/Buffer.java)

这是Java部分的核心,负责管理待发送和已接收消息的临时存储。

```java

// src/main/java/Buffer.java

package com.weixinmuqizaixian.core;

import java.util.concurrent.BlockingQueue;

import java.util.concurrent.LinkedBlockingQueue;

public class MessageBuffer {

private final BlockingQueue inboundQueue; // 接收消息队列

private final BlockingQueue outboundQueue; // 发送消息队列

private final int maxBufferSize;

public MessageBuffer(int maxBufferSize) {

this.maxBufferSize = maxBufferSize;

this.inboundQueue = new LinkedBlockingQueue<>(maxBufferSize);

this.outboundQueue = new LinkedBlockingQueue<>(maxBufferSize);

}

/**

* 放入一条待发送消息

*/