每天,企业都在产生海量数据:订单记录、用户点击、设备日志...但这些原始数据往往分散各处、格式混乱,无法直接用于分析。

ETL(提取、转换、加载),正是打通这条“数据流水线”的核心技术,它将原始数据加工成可供决策使用的高质量数据资产。这篇文章就一步步拆解ETL处理数据的全流程,从前期准备到核心处理再到后期优化,告诉你如何高效、可靠地构建这条数据生命线。

一、ETL是什么

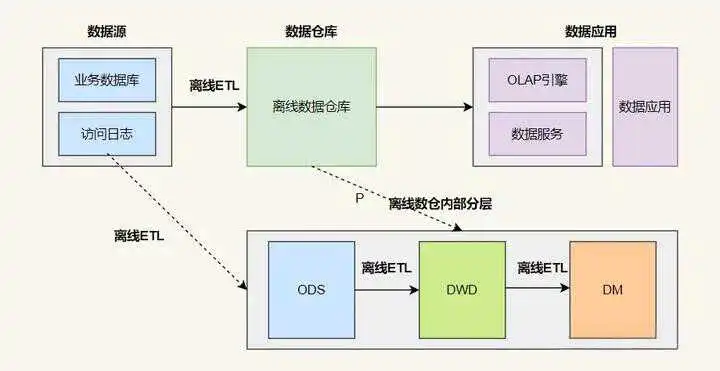

ETL 是数据处理领域的核心技术流程,由提取(Extract)、转换(Transform)、加载(Load)三个关键阶段构成。

1.ETL的三个主要阶段

(1)提取阶段:从关系型数据库、非结构化日志文件、API 接口等多样化的数据源中抽取原始数据,解决数据存储分散的问题。

(2)转换阶段:通过数据清洗、格式标准化、业务逻辑加工等操作,对原始数据进行处理,确保符合目标数据模型的规范和质量要求。

(3)加载阶段:将处理后的结构化数据高效、稳定地写入目标存储系统,如数据仓库、数据湖或分析型数据库。

其本质是构建一条从原始数据到可用数据资产的标准化处理链路,实现数据从生产端到分析端的有序流动。

2.ETL的核心优势

ETL在数据处理中具有不可替代的优势:

(1)数据同步:打破系统孤岛,实现跨业务数据的统一接入。

(2)质量管控:在数据加载前进行清洗、验证和标准化,保障下游分析的可靠性。

(3)逻辑集中:将复杂的业务规则在ETL层固化,避免下游系统的重复计算。

(4)性能优化:通过预处理降低查询负载,提升数据仓库的响应速度。

3.ETL的局限性及应对策略

尽管ETL具有很多优势,但传统ETL也存在一些局限性:

(1)批处理延迟性:传统ETL基于定时调度,难以满足实时分析需求。应对策略包括采用流式ETL(如Kafka+Flink)、微批处理和CDC(ChangeDataCapture)技术。

(2)扩展性不足:在海量数据处理场景下,单节点处理容易成为性能瓶颈。应对策略包括使用分布式计算框架和云原生无服务器架构。

(3)业务与技术断层:需求频繁变更时,ETL流程可能变得僵化,导致响应迟缓。应对策略包括采用ELT模式,将转换逻辑后移至数据仓库层,提升灵活性。

二、ETL全流程包括哪些

明确了ETL的核心定位与能力边界后,接下来看看ETL全生命周期流程包括哪些。这一过程不仅涉及技术工具的选择与使用,更需要从业务需求出发,构建覆盖前期准备、核心处理、后期优化的完整链路。

1.前期准备阶段

(1)需求精准对齐:明确业务目标、数据范围和输出指标口径,避免因需求不明确导致的开发问题,保障数据连接的准确性。

(2)数据源深度探查:

①结构分析:梳理数据源的表结构、字段类型、约束关系,识别数据存储的逻辑架构。

②内容分析:通过计算字段的最小值、最大值、平均值等进行统计分析,通过检测空值率、重复值比例评估原始数据的质量状况。

③变更监控设计:建立数据源结构变更的监控机制,如通过数据库触发器捕获 DDL 变更事件,避免因源数据结构变化导致 ETL 流程中断。

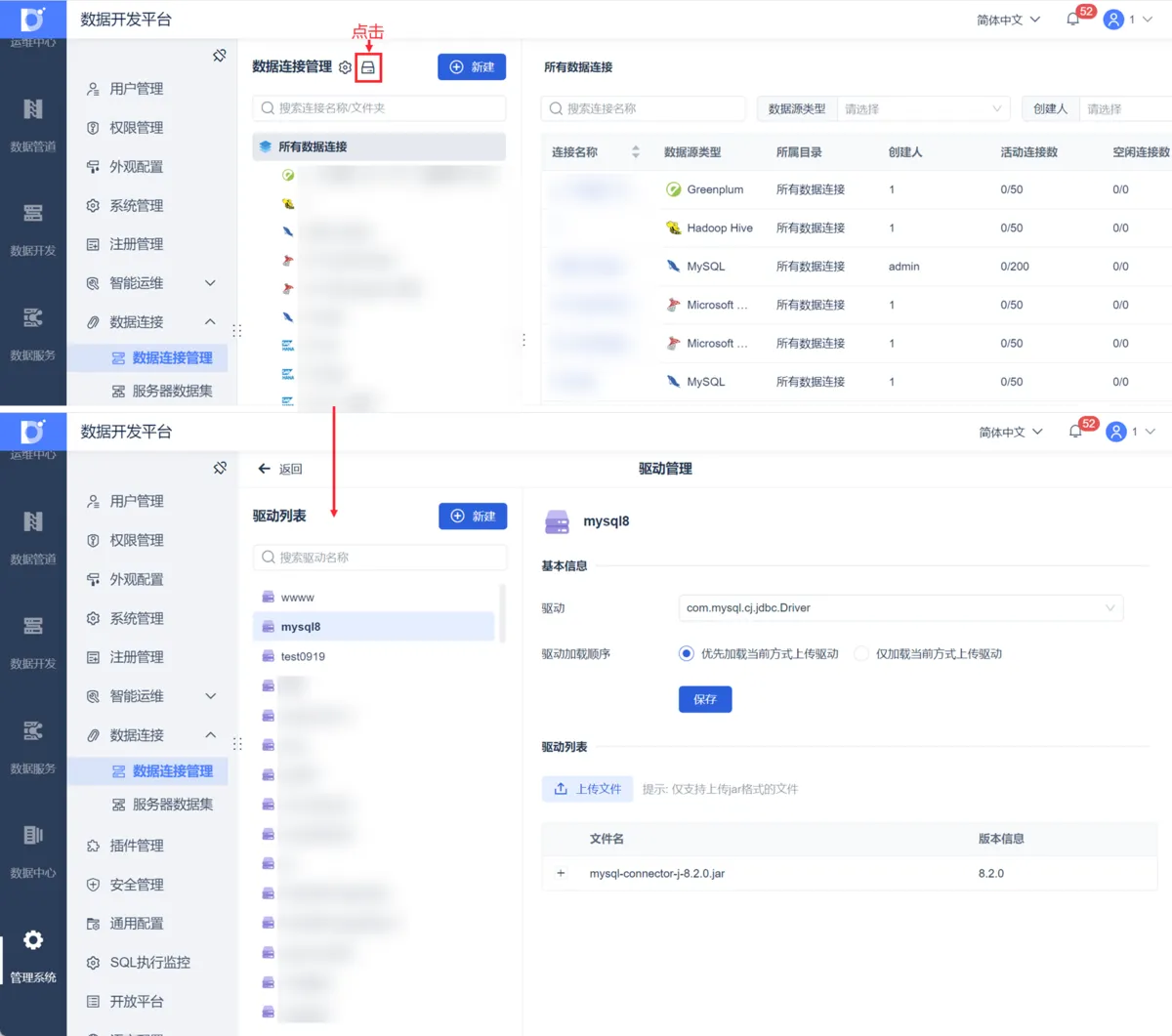

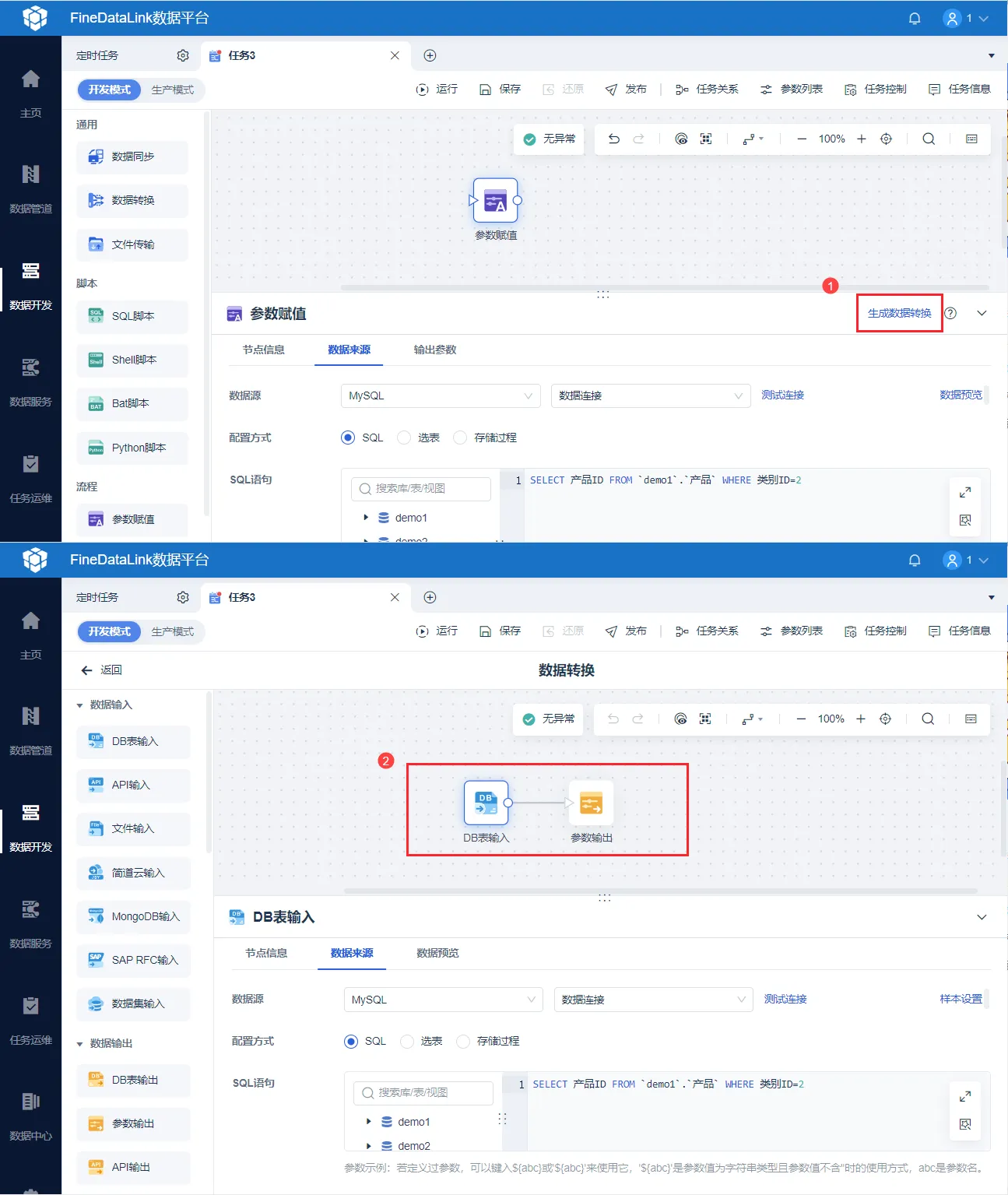

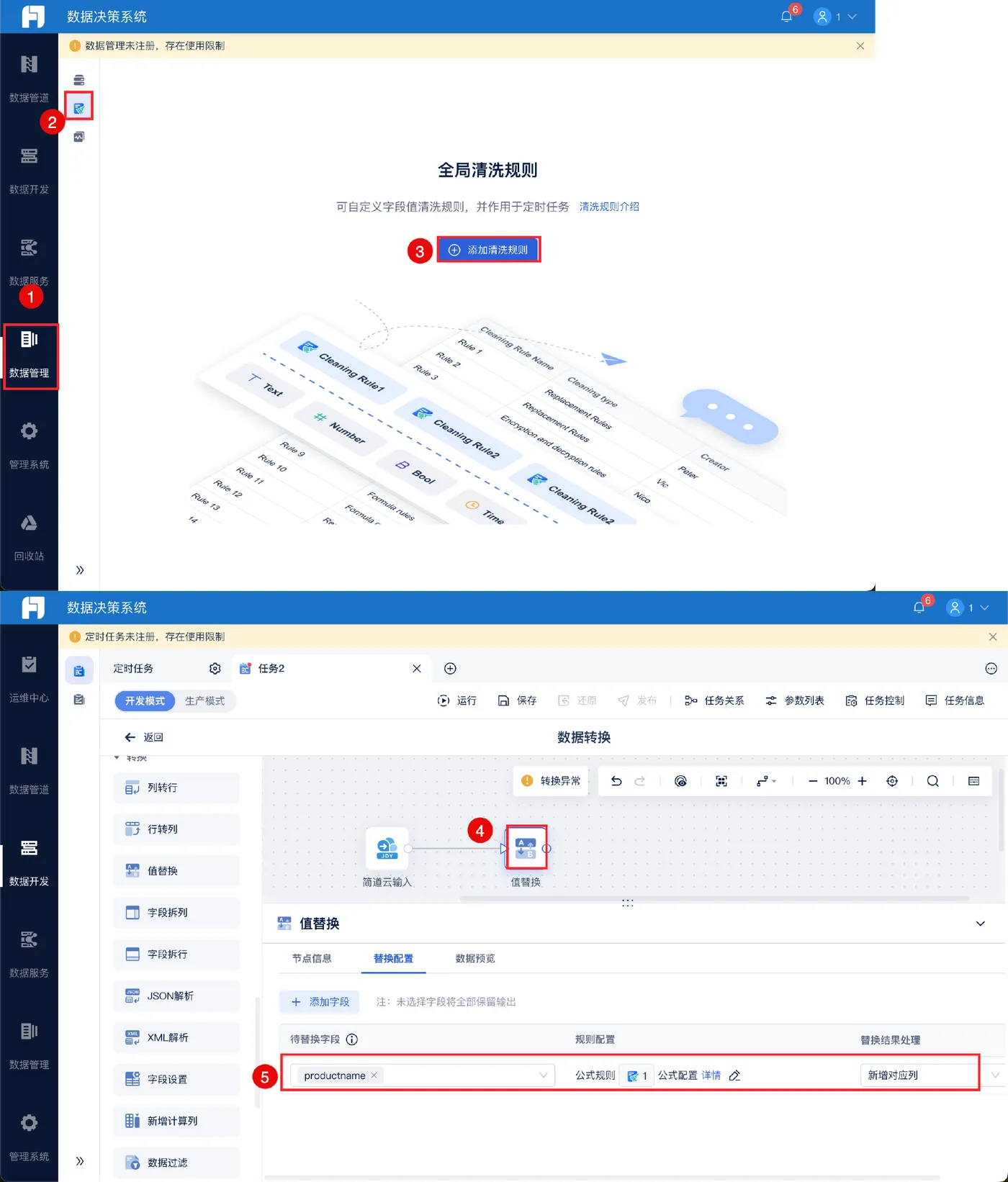

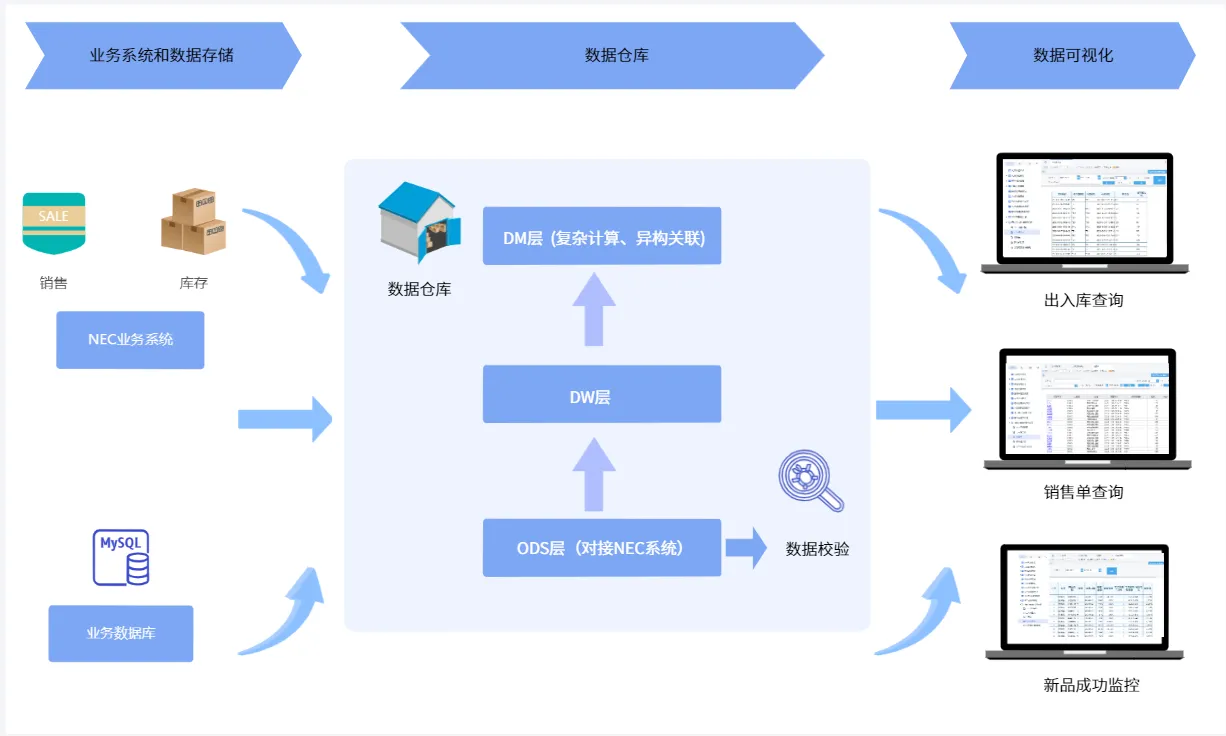

(3)设计 ETL 架构与技术选型:根据业务需求和数据源特点,选择合适的 ETL 架构与工具。常见的 ETL 工具包括开源工具Apache NiFi、Kettle等,商业软件如FineDataLink、Talend以及基于代码开发的自定义方案Python+Pandas等。之前我们合作公司IT人员都在用的FineDataLink,通过整合可视化多源异构数据,高效搭建数仓,同时在实时性与效率方面,支持全量 / 增量提取,增量模式通过时间戳、日志解析等技术精准捕获变更数据,有效减少冗余传输。

2.核心处理阶段

核心处理阶段是ETL的关键环节,需要在精准与效率之间找到平衡:

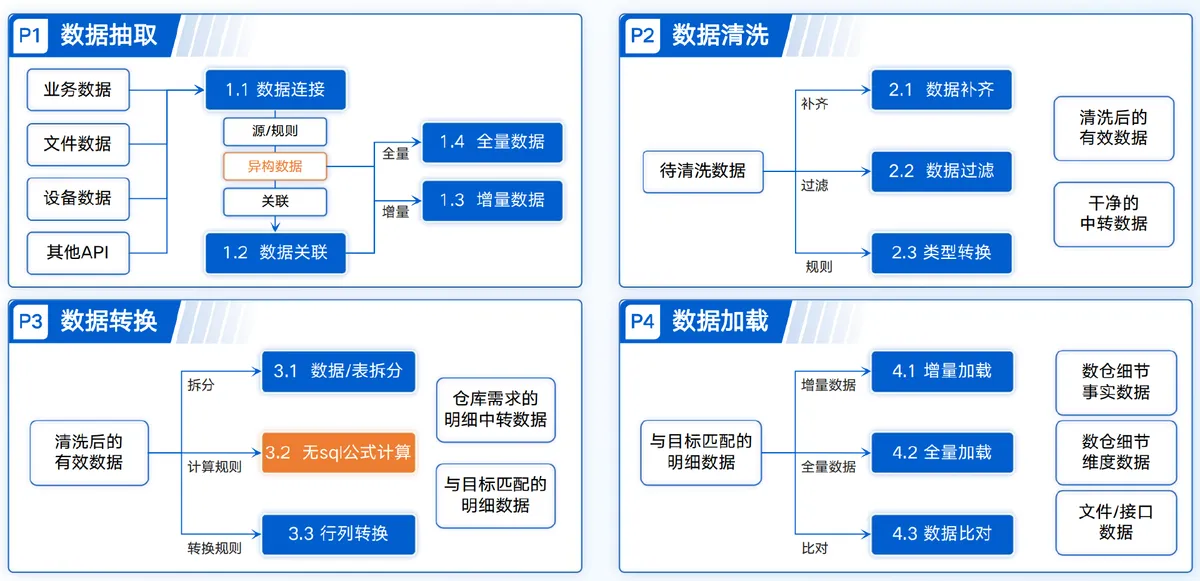

(1)Extract(提取):根据需求选择全量拉取或增量识别,优化连接池、实现断点续传、确保数据加密传输和流量控制。

(2)Transform(转换):设计幂等性,重跑不产生副作用,采用模块化开发。

①清洗:剔除重复记录、填充空值(基于业务规则)、修正异常值。

②转换:进行字段拆分/合并、编码标准化(如性别转为0/1)、统一度量单位。

③集成:处理多表JOIN(避免笛卡尔积)、处理缓慢变化维(SCD,如Type1/2/3)。

④计算:进行聚合(如sum、count)、窗口函数(如排名、移动平均)和自定义UDF(用户自定义函数)。

(3)Load(加载):根据需求选择Truncate-Reload(全量加载)或Merge/Upsert(增量加载)。确保ACID特性,尤其是在分布式系统中,避免脏读,采用批量提交、分区加载和索引管理优化性能。

3.后期校验与持续优化阶段

后期校验与优化是ETL流程的生命线,确保数据质量和系统性能:

(1)数据质量监控:

①规则引擎:设置字段非空校验、唯一性约束、数值范围阈值和逻辑一致性。

②自动化告警:对任务失败、延迟和数据波动异常进行实时告警。

(2)性能调优:

①瓶颈分析:通过CPU、IO、内存等资源监控和SparkUI等慢任务诊断找出性能瓶颈。

②优化手段:处理数据倾斜、复用缓存和计算下推。

(3)元数据管理:

①记录血缘关系:追踪表、任务和字段级的血缘关系,便于影响分析。

②维护数据字典:记录字段含义和加工逻辑,降低维护成本。

(4)自动化与CI/CD:将ETL脚本纳入Git管理,实现自动化测试和发布部署。

三、ETL的应用场景

理解了ETL 的技术框架后,下面我结合制造业与零售业的典型需求,带大家一起看看ETL如何通过数据整合与处理,解决业务痛点并驱动数字化转型,展现ETL在具体行业场景中的落地逻辑、实践路径与应用价值。

1.制造业

(1)场景需求:整合设备物联网(IoT)传感器数据、制造执行系统(MES)生产数据、企业资源计划(ERP)库存数据,解决数据分散导致的生产效率分析困难、质量追溯成本高等问题。

(2)ETL 实践:

①实时采集设备状态数据:通过流式ETL实时采集设备状态数据,计算设备综合效率(OEE)。

②整合生产数据:将MES工单信息与质检结果整合,构建产品全流程追溯视图。

(3)价值输出:为生产瓶颈分析、预测性维护模型、质量改进方案提供高质量数据输入,助力制造业实现智能化生产和精细化管理。

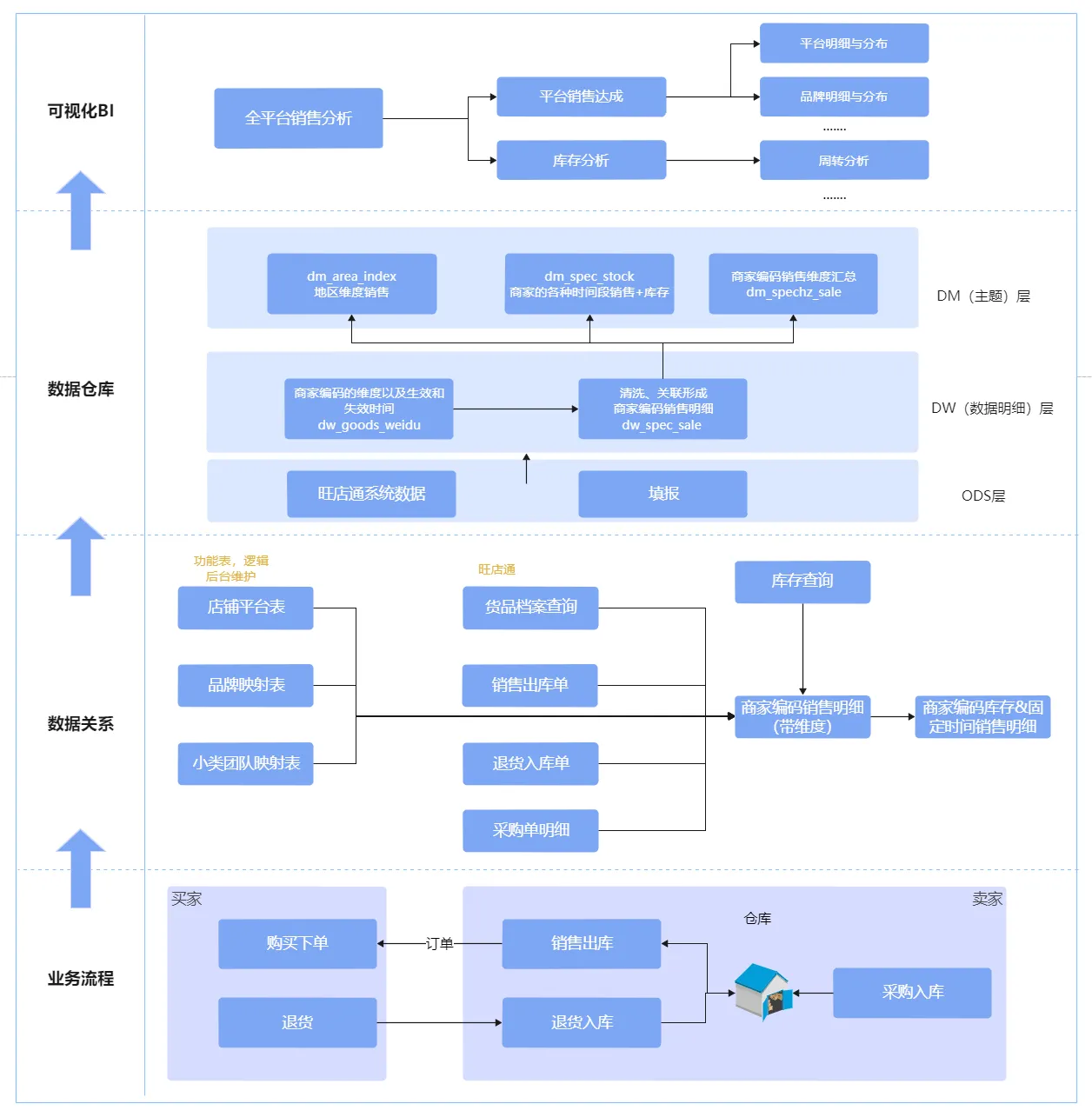

2.零售业

(1)场景需求:打通线上电商平台订单数据、线下门店 POS 交易数据、会员管理系统(CRM)客户信息、供应链系统库存数据,解决数据割裂导致的用户画像不完整、库存周转率低等问题。

(2)ETL 实践:

①清洗交易数据:清洗POS交易数据,处理退货和折扣异常,标准化商品类目。

②融合多渠道数据:将电商行为日志(点击流)与CRM会员信息融合,构建360°用户画像。

(3)价值输出:为动态库存优化、精准营销活动、门店销量预测提供数据支撑,提升零售业的市场竞争力和客户满意度。

四、总结

ETL并非简单的数据“搬运”,而是融合了工程严谨性与业务理解的数据价值链核心环节。随着技术的不断演进,现代ETL已经走向实时化、智能化和云原生化,但核心目标始终如一:将原始数据转化为可信、可用的高价值资产,驱动业务决策从经验走向实证。这样,每一次ETL任务的成功执行,都在为企业沉淀一份可复用的数据资本。