在人工智能领域,大型语言模型(LLMs)的高效运用一直是研究的热点。随着技术的不断进步,LLMs在处理复杂任务时展现出了强大的能力,但同时也面临着计算成本高和信息处理效率低的问题。为了解决这些问题,研究者们提出了一种新的方法——LLMLingua-2,这是一种面向高效忠实任务无关性提示压缩的数据蒸馏方法。

LLMLingua-2的核心思想是通过对大型语言模型中的提示进行压缩,以提高模型的泛化能力和效率。在自然语言处理中,提示的压缩是一个重要环节,它能够帮助模型更快地理解和处理信息。然而,传统的压缩方法往往依赖于信息熵等经验性指标,这可能导致压缩后的提示丢失关键信息。LLMLingua-2通过数据蒸馏过程,从LLM中提取知识,有效压缩提示的同时保留了关键信息,这一点在实践中显示出了显著的优势。

LLMLingua-2的另一个创新之处在于,它将提示压缩问题视为一个标记分类问题,通过使用Transformer编码器作为基础架构,能够从完整的双向上下文中捕获所有关键信息。这种方法不仅提高了压缩后提示的忠实度,也显著降低了模型的延迟,使得LLMs能够更快速地响应和处理信息。

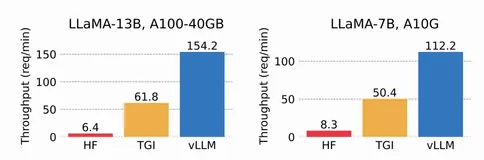

在实验部分,LLMLingua-2在多个数据集上进行了测试,包括LongBench、ZeroSCROLLS、GSM8K和Big Bench Hard等。实验结果显示,LLMLingua-2在不同基线上都展现出了优越的性能,并且在压缩延迟方面实现了显著的改进。这些实验结果证明了LLMLingua-2在不同任务和领域上的泛化能力,以及其在提高LLMs效率方面的潜力。

尽管LLMLingua-2在多个方面都取得了显著的成果,但它也存在一些局限性。首先,LLMLingua-2的数据集构建主要依赖于来自MeetingBank的训练示例,这可能会影响其在其他领域的泛化能力。虽然研究者通过在其他基准测试上的评估来证明其泛化能力,但这仍然是一个值得进一步研究的问题。其次,LLMLingua-2在扩展数据集后的性能提升并不显著,这表明虽然模型能够从更多数据中学习,但可能已经接近其性能的极限。