基于深度学习的稀疏训练(Sparse Training)是一种在训练过程中直接构建和优化稀疏模型的技术,旨在减少深度神经网络中的冗余计算和存储需求,提高训练效率和推理速度,同时保持模型性能。稀疏训练已经成为深度学习研究中的一个重要方向,特别是在处理大型模型和数据集时表现出显著优势。

1. 稀疏训练的背景与动机

深度神经网络(DNN)通常包含大量的参数和计算需求,这些模型在实际应用中面临以下挑战:

高计算复杂度:大型深度神经网络在训练和推理时需要大量的浮点运算,导致计算成本高昂。

内存和存储限制:模型参数的规模可能超过硬件的内存和存储能力,特别是在边缘设备或嵌入式系统中。

能耗高:训练和推理过程中消耗大量能源,不利于节能和环保的要求。

稀疏训练通过减少网络中的非零参数和计算操作,降低计算复杂度和内存需求,有效解决了上述问题。

2. 稀疏训练的主要方法

2.1 不同类型的稀疏性

稀疏性主要指在模型的参数矩阵中大部分元素为零。以下是几种常见的稀疏性类型:

全局稀疏性(Global Sparsity):整个模型的参数矩阵中的非零元素比例较低。

层级稀疏性(Layer-wise Sparsity):特定层的参数或特定通道中存在稀疏性。

结构化稀疏性(Structured Sparsity):整个神经元、卷积核、通道等具有稀疏结构,便于在硬件上高效实现。

非结构化稀疏性(Unstructured Sparsity):随机分布的稀疏参数,通常需要特殊的硬件优化来获得性能提升。

2.2 动态稀疏性训练(Dynamic Sparse Training)

动态稀疏训练通过在训练过程中不断调整稀疏结构,使得网络在不同阶段具有最优的稀疏性配置。

稀疏模式调整:动态调整模型中的稀疏连接,以便在训练期间优化重要参数的分布。

动态修剪与增长:根据重要性度量标准,定期修剪(剪掉不重要的权重)和增长(重新引入新的非零权重)参数,保持模型的稀疏性和性能。

2.3 修剪(Pruning)

修剪是一种常见的稀疏化方法,通过去除模型中的不重要权重来实现稀疏性。

权重修剪:根据权重的绝对值大小或梯度贡献,去除较小的权重。

神经元修剪:去除对最终输出影响不大的神经元或特征通道。

结构化修剪:去除整个卷积核或通道,保留网络的结构完整性,便于硬件加速。

2.4 稀疏正则化

通过添加稀疏正则化项(如L1正则化)到损失函数中,鼓励模型在训练过程中学习到稀疏的参数。

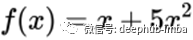

L1正则化:通过在损失函数中添加参数的绝对值之和,惩罚大部分参数不为零的情况。

L0正则化:直接最小化参数矩阵中非零元素的数量,但由于不可微性,通常需要近似优化。

2.5 量化感知稀疏性

将稀疏性与量化技术结合,进一步降低模型的存储和计算需求。

量化稀疏模型:在保持稀疏性的同时对非零参数进行量化(如8位整数表示),减少存储和计算成本。

混合精度训练:在保持关键参数精度的同时,压缩和稀疏其他不重要的参数。

3. 稀疏训练的技术实现与优化

3.1 梯度稀疏化

梯度稀疏化是在训练过程中只计算和传输稀疏的梯度,以减少计算和通信成本。

梯度裁剪(Gradient Clipping):将梯度超过一定阈值的部分裁剪,限制其对模型参数的影响。

稀疏更新(Sparse Updates):只更新梯度变化大的参数,避免频繁更新不重要的参数。

3.2 稀疏优化器

使用专门的优化器支持稀疏模型训练,如稀疏版本的SGD(随机梯度下降)或Adam优化器。

稀疏SGD:只计算和更新非零参数的梯度,加速训练过程。

稀疏Adam:适应性学习率方法,专门设计处理稀疏参数的更新。

3.3 硬件加速优化

为了更好地支持稀疏训练,需要硬件上的优化,如稀疏矩阵乘法加速器。

专用硬件架构:如TPU(Tensor Processing Unit)、NPU(Neural Processing Unit)等,针对稀疏计算进行了优化。

软件框架支持:深度学习框架(如TensorFlow、PyTorch)已经逐渐引入稀疏操作支持和加速库。

4. 稀疏训练的应用场景

4.1 边缘计算设备

在边缘计算设备(如智能手机、物联网设备)中,稀疏训练使得深度学习模型能够在计算和存储资源有限的环境中高效运行。

4.2 大规模分布式训练

在大规模分布式深度学习训练中,稀疏训练可以显著减少通信开销,提高整体训练效率。

4.3 实时推理应用

在要求低延迟和高吞吐量的实时推理应用中,稀疏训练使得模型能够在更短的时间内进行推理,提高用户体验。

5. 挑战与未来发展

5.1 稀疏性与模型性能的平衡

如何在保持稀疏性的同时,尽量减少对模型性能的负面影响,是稀疏训练面临的主要挑战。未来的研究可能会侧重于优化稀疏性策略,进一步提升模型性能。

5.2 自动化稀疏技术

自动化稀疏技术(如AutoML)有望自动选择和优化稀疏策略,使得模型能够自适应地学习到最优的稀疏结构。

5.3 硬件与稀疏算法的协同设计

针对不同的硬件架构优化稀疏训练算法,或者根据稀疏性设计新的硬件架构,进一步提升稀疏训练的效率。