Hadoop的性能瓶颈可能出现在多个方面,这些瓶颈可能限制了Hadoop集群的处理能力和效率。以下是一些常见的Hadoop性能瓶颈:

- 硬件资源限制:包括CPU、内存、存储和网络带宽等硬件资源的限制。Hadoop集群需要足够的硬件资源来支持其运行的大型数据处理任务。如果硬件资源不足,可能会导致集群性能下降。

- 网络带宽限制:Hadoop集群中的大量数据传输需要高带宽的网络支持。如果网络带宽受限,可能会影响数据传输效率,从而导致集群性能下降。

- 调度和资源管理:Hadoop集群中的作业调度和资源管理也可能成为瓶颈。如果作业之间竞争资源或者调度算法不合理,可能会导致性能下降。

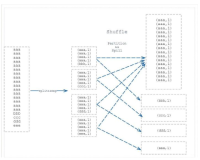

- 数据倾斜:数据倾斜是指某些节点上的任务负载过重,而其他节点负载较轻的情况。这可能会导致集群的整体性能下降,因为一些节点可能会成为瓶颈,拖慢整个集群的处理速度。

- HDFS小文件问题:Hadoop分布式文件系统(HDFS)在处理大量小文件时可能会遇到性能问题。因为HDFS是为处理大文件而设计的,所以存储和管理大量小文件可能会导致性能下降。

- 单点故障和空间容量不足:Hadoop的master/slaves架构虽然管理起来简单,但存在单点故障和空间容量不足等缺点。这可能会限制Hadoop的可扩展性和性能。

- 数据压缩和解压缩:虽然数据压缩可以提高数据传输和存储的效率,但解压缩数据可能会消耗大量的CPU资源,从而影响Hadoop集群的性能。

为了优化Hadoop的性能,可以采取以下措施:

- 硬件升级:增加CPU、内存、存储和网络带宽等硬件资源,以满足Hadoop集群的需求。

- 优化作业调度和资源管理:通过改进作业调度算法和合理分配资源,可以减少作业之间的资源竞争,提高集群性能。

- 数据倾斜处理:通过数据预分区、负载均衡等技术,可以减少数据倾斜的影响,提高集群性能。

- 处理HDFS小文件问题:通过合并小文件、使用归档文件等方式,可以减少HDFS中的小文件数量,提高性能。

- 提高可扩展性:通过改进Hadoop的架构和引入新的技术,如分布式存储和计算框架,可以提高Hadoop的可扩展性和性能。

- 优化数据压缩和解压缩:选择合适的压缩算法和参数,以减少解压缩的CPU消耗,提高性能。

- 监控和调优:定期监控Hadoop集群的运行状态,及时识别和调整性能瓶颈,优化集群的性能。