1 简介

本文给大家介绍一下蚂蚁集团(机器智能-人机结合团队、搜索算法团队)、浙江大学、麦考瑞大学合作的被ICDE2023接收的基于因果纠偏的直接全空间多任务转化率预测模型

《DCMT: A Direct Entire-Space Causal Multi-Task Framework for Post-Click Conversion Estimation》。

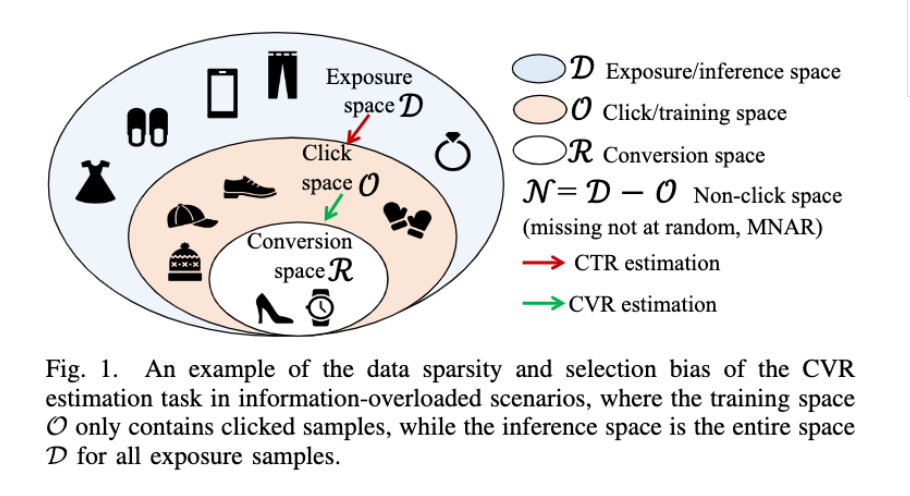

在搜推广场景中,推荐系统+用户主要遵循“曝光(系统)->点击(用户)->转化(用户)”行为逻辑。DCMT试图解决的还是点击后转化率预测的两个老问题,即数据稀疏和选择偏差问题。由于文章运用了因果推断的思想,理解起来有点麻烦,我们尽量展开介绍。

2.1 数据稀疏

主要是“曝光->点击->转化”这系列行为逻辑漏斗越来越小,即只有很少曝光物品/服务被点击,更少的物品/服务被转化。传统的点击后转化率预测模型往往在点击空间(click space)训练而成,而不是在全曝光空间进行训练。那么不可避免的只有很少的点击样本用来训练。例如,阿里公开的Ali-CCP数据集,大约3.75%的曝光样本被点击,而其中只有大约0.025%的样本被转化。数据稀疏问题不单单造成训练集样本过少,还造成转化的正、负样本太过不平衡。

2.2 选择偏差

选择偏差的产生主要原因是上述的训练空间和推断空间之间的差异。传统点击后转化率预测模型在点击空间(click space)训练而成,但是模型推断的时候,却要给全曝光的样本(exposure space)进行预测排序。两者(点击空间、全曝光空间)之间的样本分布是不一致的。点击空间的样本虽然来源于全曝光空间样本,但是往往点击、转化率比较高的样本才能进入点击空间,那些点击、转化率较低的很难进入到点击空间。这些曝光&未点击(未点击空间)的样本并没有随机消失(not missing at random)于点击空间,而是因为用户的选择导致它们进不了点击空间。这就意味着,基于点击空间样本训练出来的转化率预测模型预测值往往和实际值之间有偏差(一般是偏大)。

3 现有的解决方案

接下来,我们分析一下现有模型以及它们的优缺点。

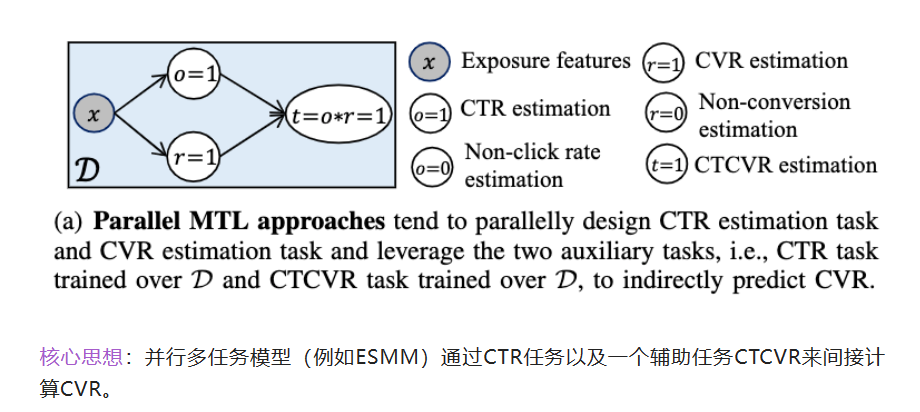

3.1 并行多任务模型 (例如 ESMM,ESM2)

核心思想:并行多任务模型(例如ESMM)通过CTR任务以及一个辅助任务CTCVR来间接计算CVR。

优点:这样做的好处是CTR和CTCVR任务都可以在全曝光样本上训练,而模型在线预测的时候,也在全曝光样本空间进行预测排序。并行多任务模型是通过 ,在全曝光空间,先求出点击率 和点击转化率 ,再间接求出点击后转化率 。这样就消除了训练空间与推断空间之间不匹配的问题,因而可以缓解点击空间训练数据稀疏、选择偏差的问题。

缺点:并行结构,忽略了点击到转化之间的依赖关系,也就是PIP(potential independence priority)问题。现有的并行多任务模型结构实际上对应的是另一个概率公式,即: 。

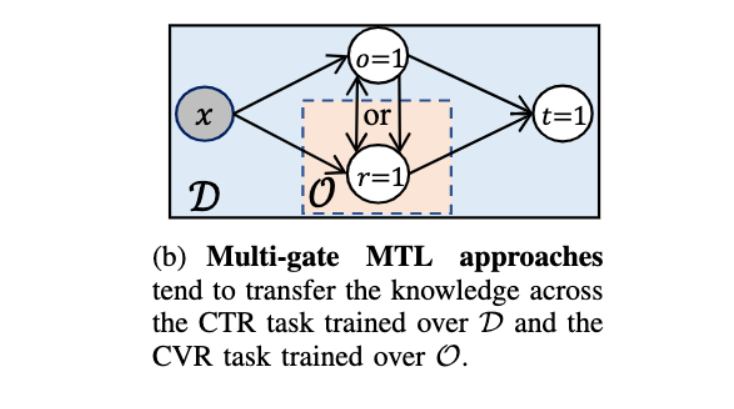

3.2 多门的多任务学习模型 (例如:Cross Stitch、MMOE、PLE、MOSE、AITM)

核心思想、优点:多门(Multi-Gate)多任务学习模型考虑了不同任务之间的相关性和差异性,用Gate的方式来控制不同专家的组合方式。在曝光空间预测CTR, 在点击空间预测CVR。

缺点:这些模型还是没有解决数据Missing not at radom(MNAR)的问题。

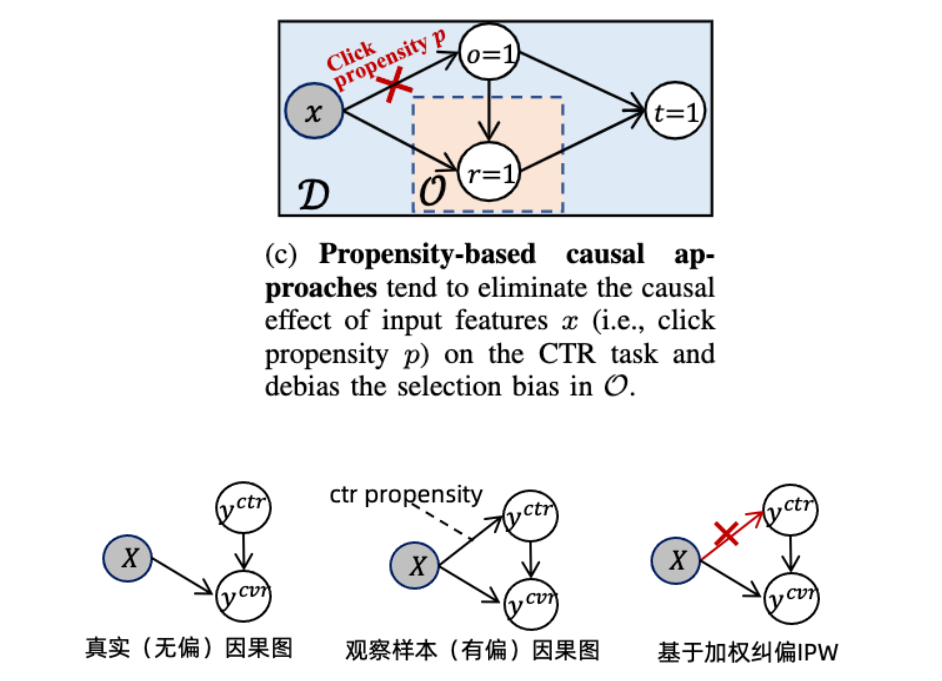

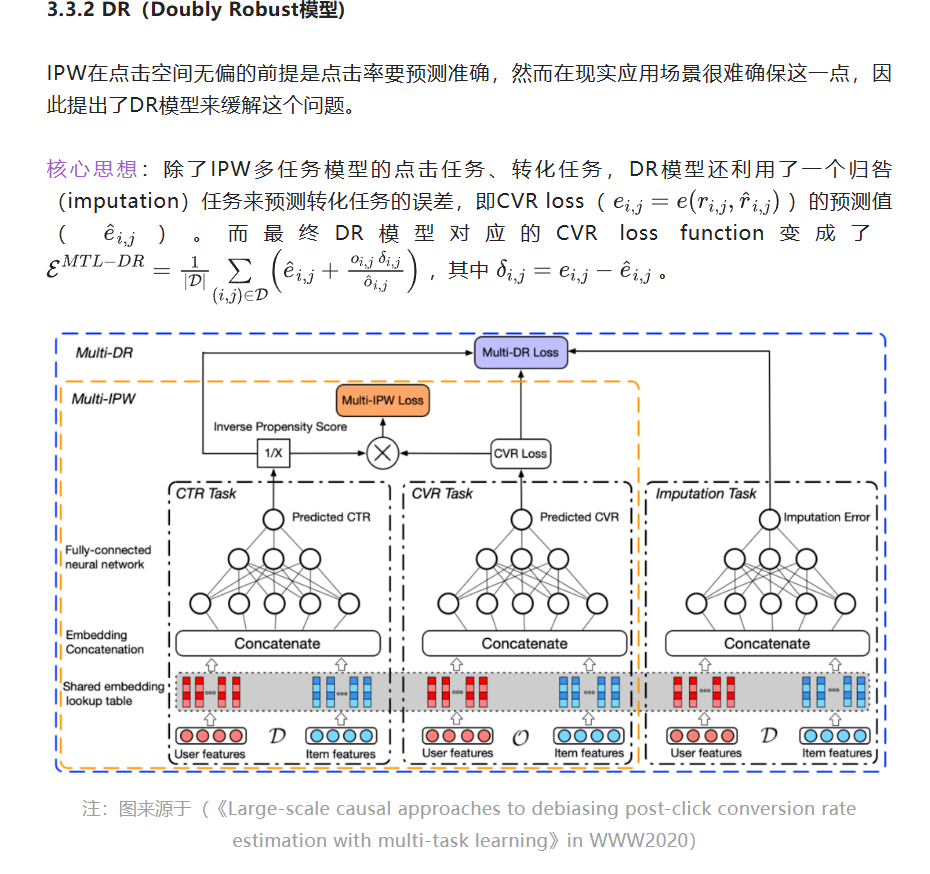

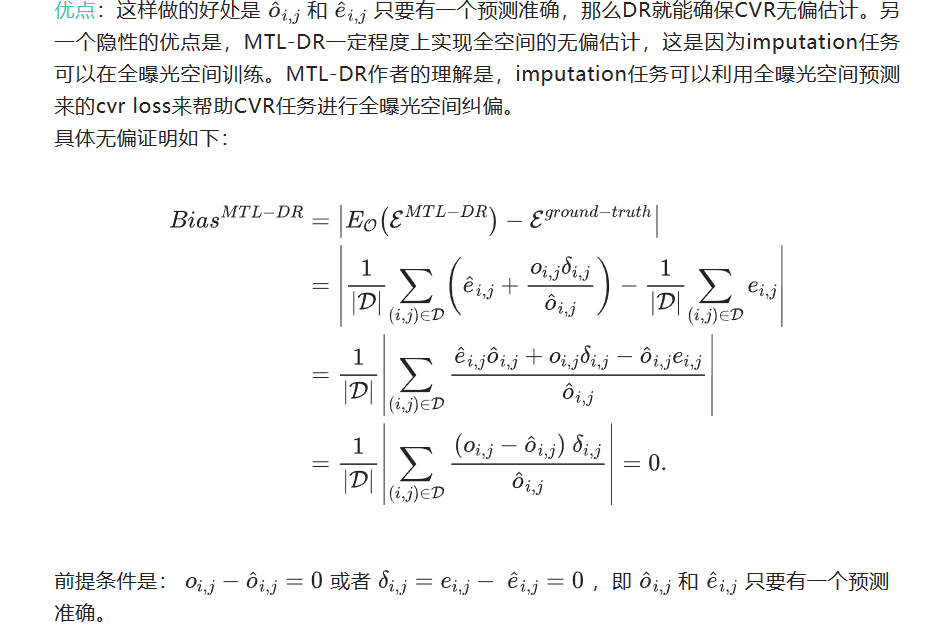

3.3 基于倾向性的因果纠偏模型 (例如IPW和DR)

由于我们的方法也是使用倾向性的因果纠偏,因此这一类的现有解决方案我们会详细介绍。

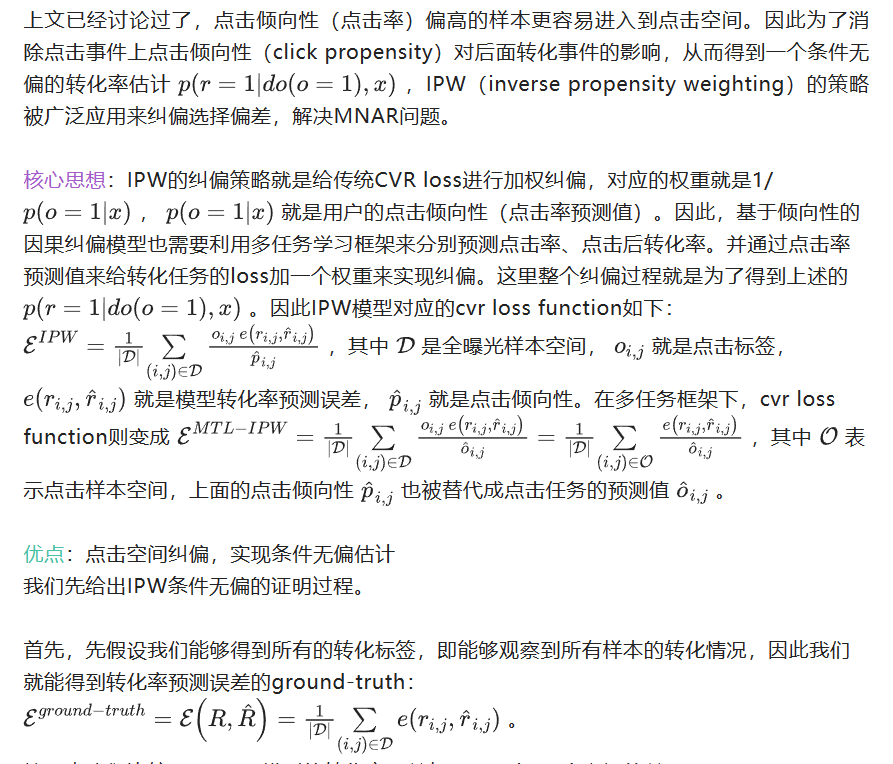

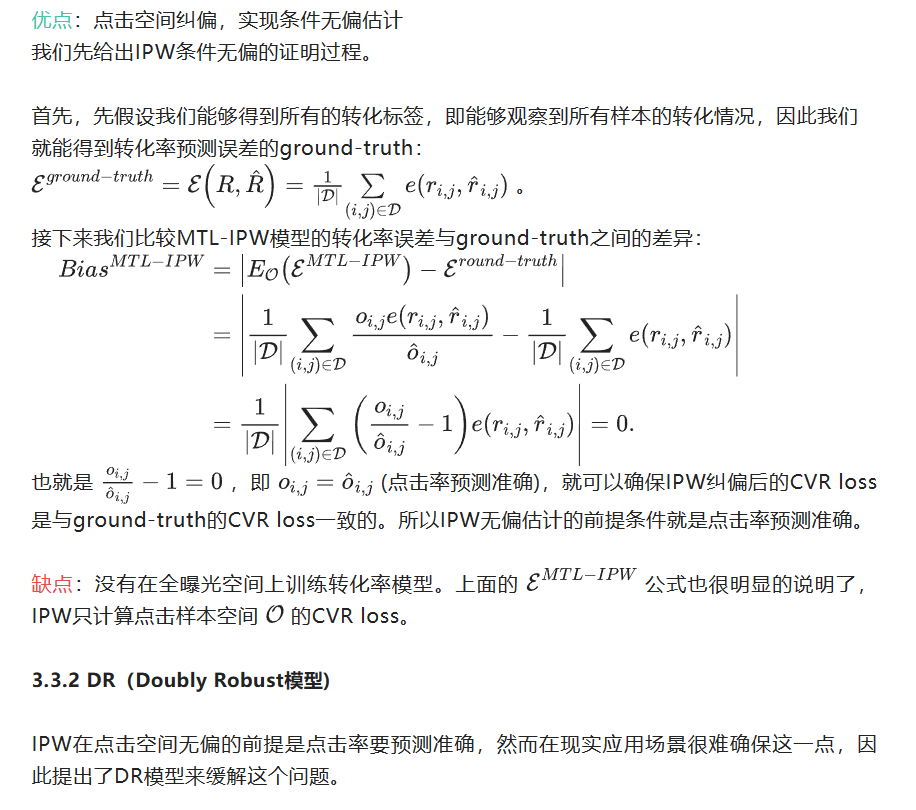

3.3.1 IPW(inverse propensity weighting,逆倾向加权模型)

4.1 核心思想

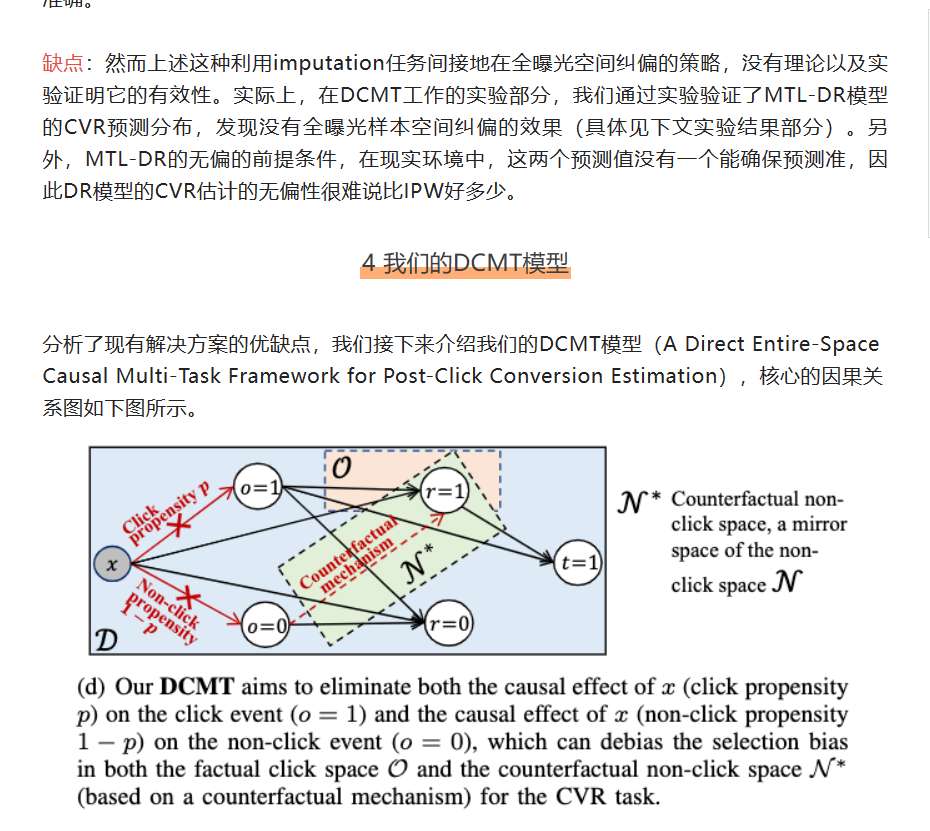

上文现有解决方案的分析,让我们意识到,我们需要直接在全曝光空间去纠偏,而不是只在点击空间(例如IPW)或者间接在全曝光空间(DR)上纠偏。在全曝光空间训练模型的好处就是(1)数据稀疏问题得到缓解(2)训练空间和推断空间直接对齐了。

然而,在全曝光空间训练CVR模型存在最大的瓶颈问题就是:(1)全曝光空间里,对于转化任务而言,存在大量的假负样本。在全曝光空间里,由于不存在“未点击->转化”这样的正样本,这些样本会混在“未点击->未转化”样本中充当假负样本。这些假负样本可能仅仅是因为曝光位置、曝光风格原因,没有被用户察觉到或者点击到。但是如果这些样本被用户点击了,是可以转化的。如果在全曝光空间训练,CVR模型过度拟合这些真假难辨的转化负样本,CVR的预测结果则会偏低。(2)另外,在全曝光样本空间直接训练CVR模型,选择偏差问题仍然存在。所以需要在全曝光空间进行纠偏而不单单在点击空间进行纠偏(如IPW和DR)。这是因为,如果我们认同IPW的思想,即在点击样本空间,点击倾向性会对点击空间样本造成选择偏差。那么在未点击空间,同样也会有不点击倾向性导致选择偏差。

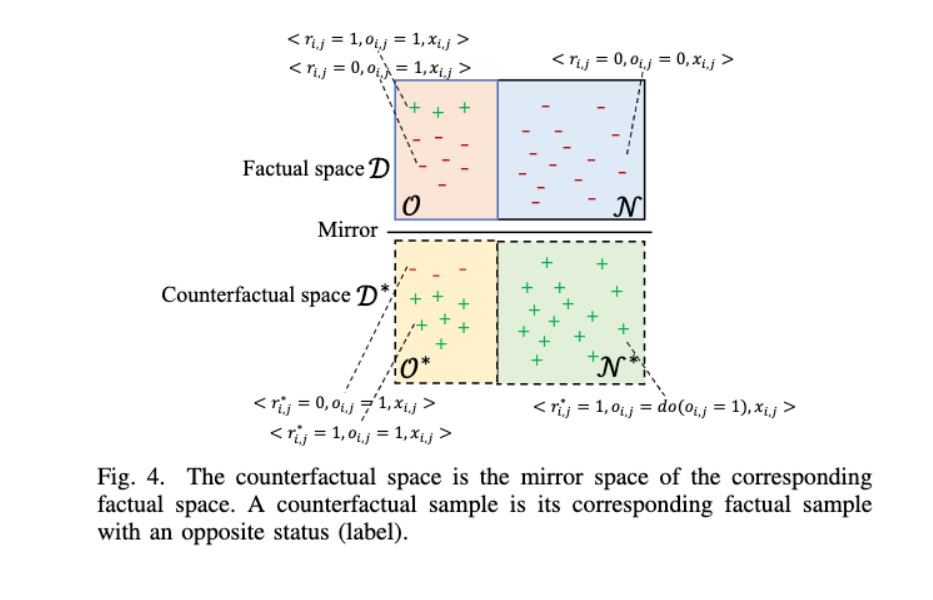

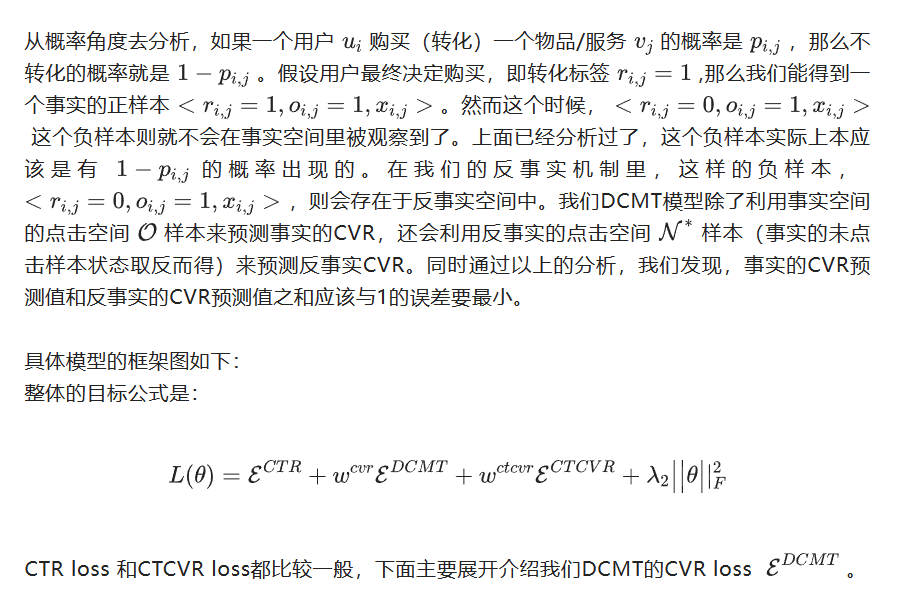

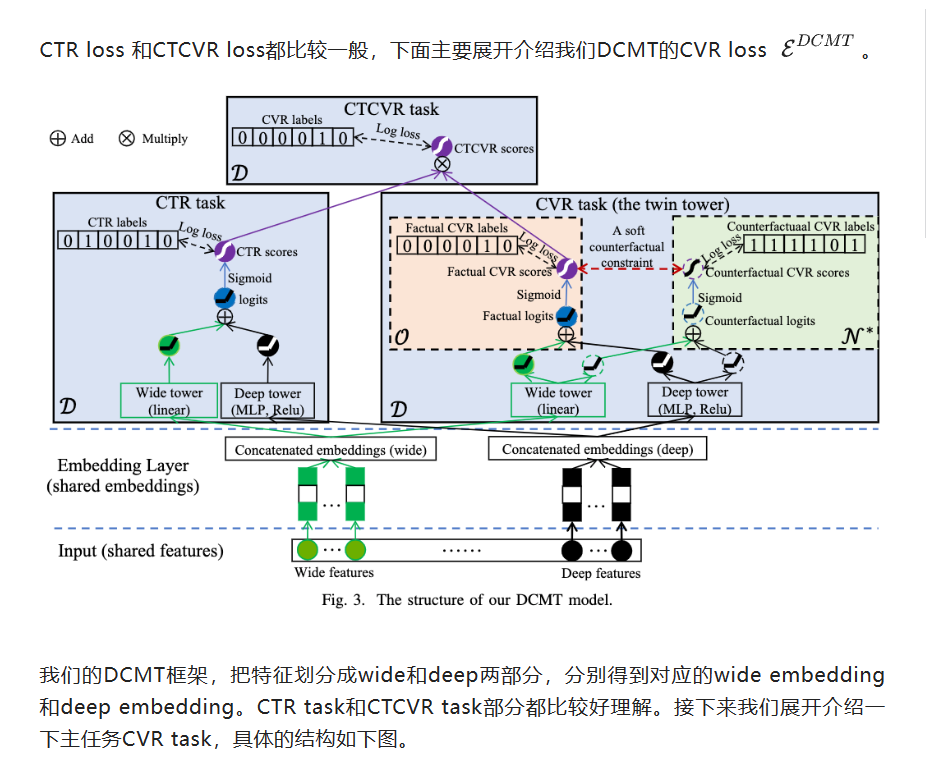

4.2 反事实机制

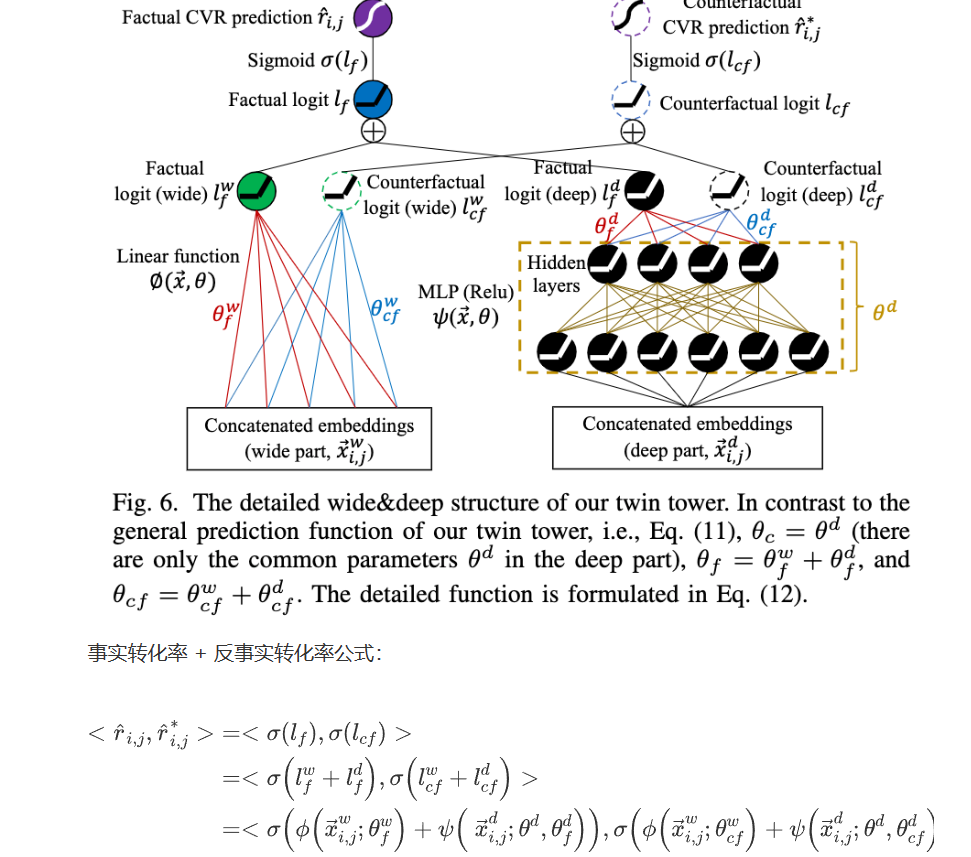

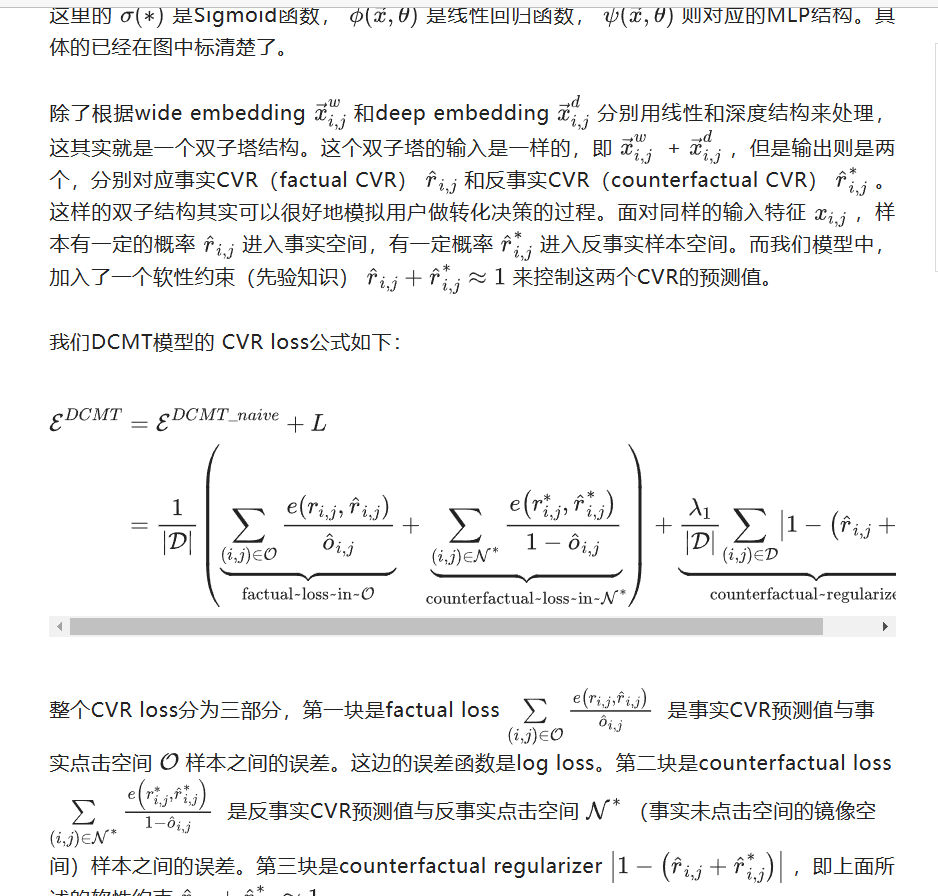

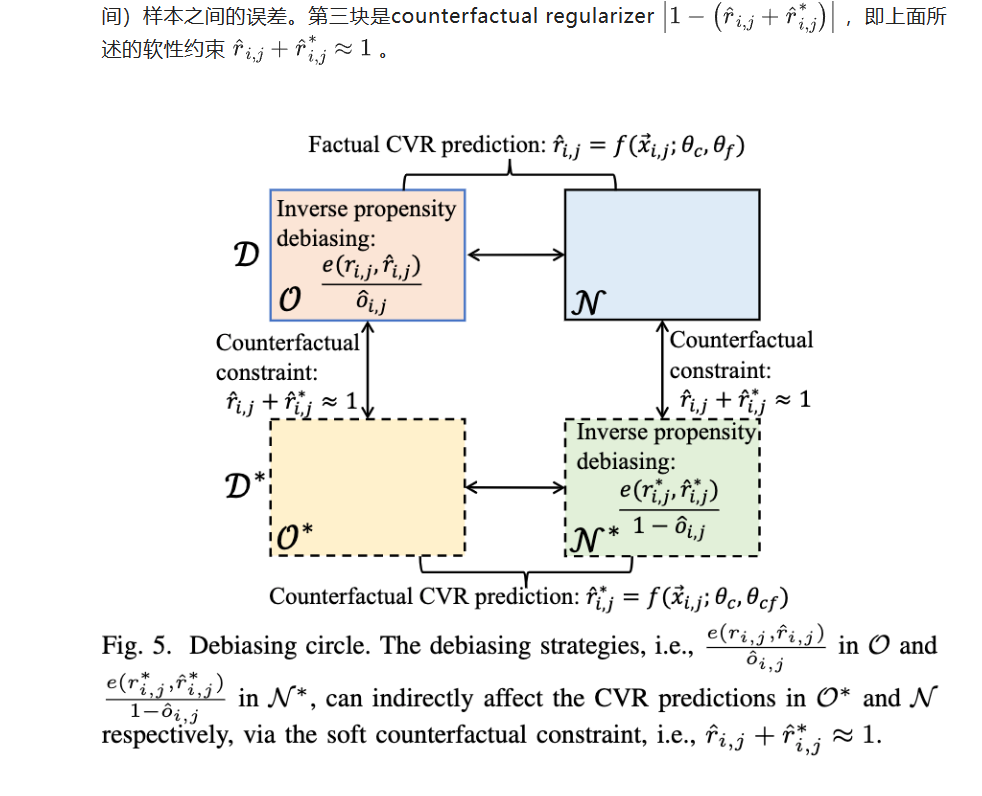

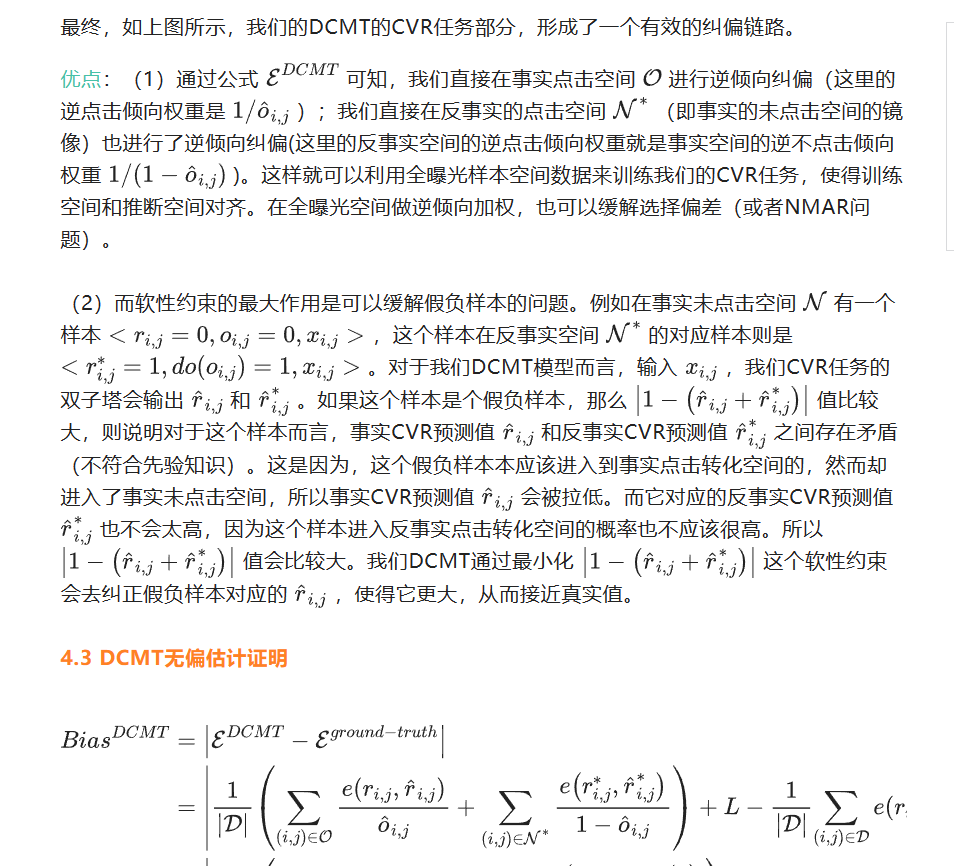

为了解决以上的问题,我们提出了一个反事实的机制。由于受到用户在做转化决策的过程的启发,我们提出了事实样本空间(factual space)和反事实样本空间(counterfactual space)的概念。这里的事实空间和反事实空间如下图所示: