情况如下:

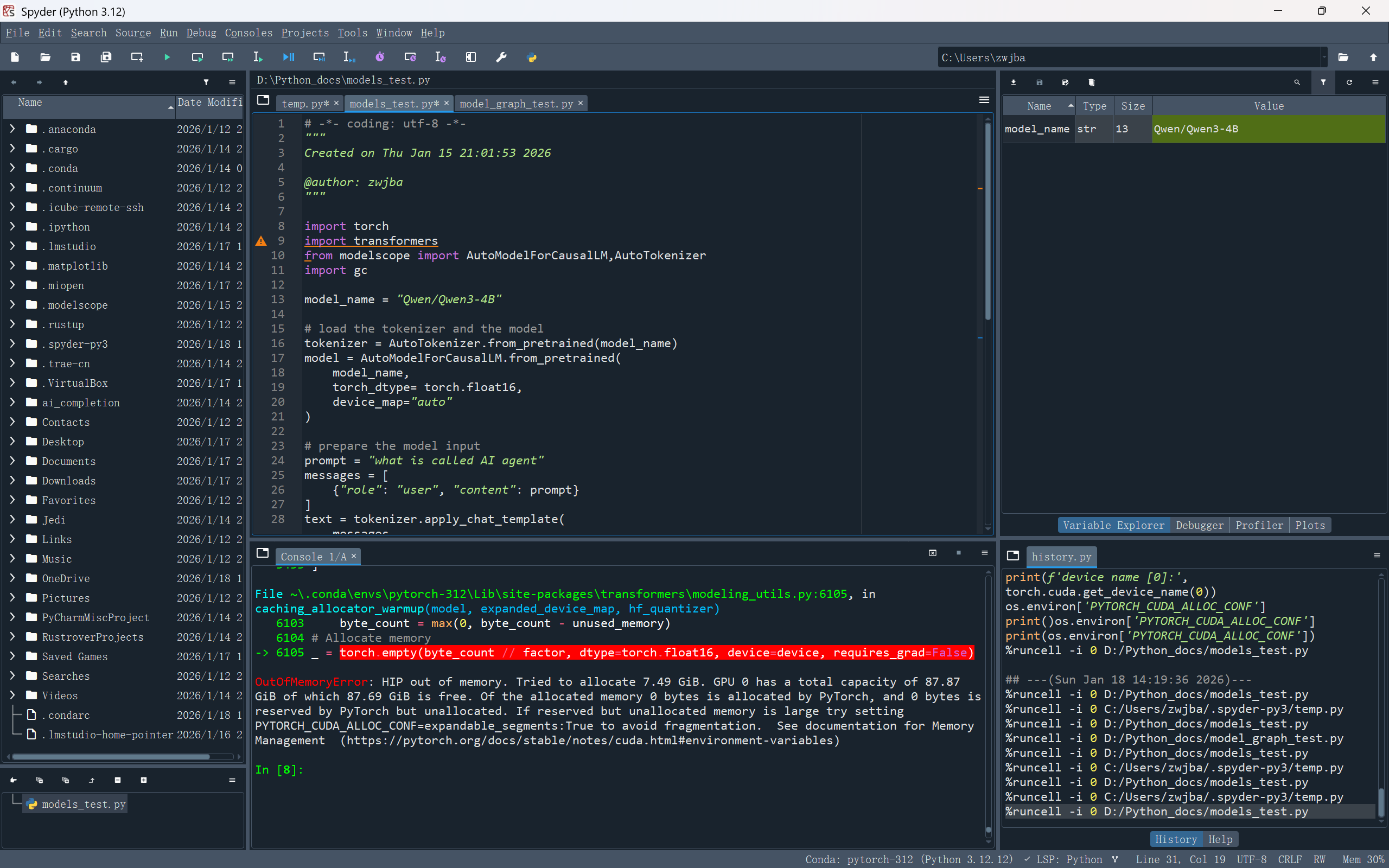

在机器本地配置大模型进行输出测试运行,使用ROCm环境,最早能成功输出回答,但过1天后再运行会报HIP out of memory错误,并且显示可调用内存/保留内存均为0,但总剩余内存显示还有87GB。

设置过环境变量PYTORCH_CUDA_ALLOC_CONF=expandable_segments:True,但是从代码运行的提示来看在ROCm环境下这个环境变量不起作用。

请问还有什么设置方法能够让模型调用正常起来呢?

测试模型:Qwen3-4B、Qwen3-32B、Z-Image-Turbo

代码为modelscope上模型使用的示例代码,仅调整了torch_dtype = torch.float16

硬件平台:AMD AI MAX+ 395,128GB内存,划分64GB给显存

ROCm版本:7.1.1

pytorch版本:2.9.0

ModelScope旨在打造下一代开源的模型即服务共享平台,为泛AI开发者提供灵活、易用、低成本的一站式模型服务产品,让模型应用更简单!欢迎加入技术交流群:微信公众号:魔搭ModelScope社区,钉钉答疑群:44837352