为什么选择Flink和Hudi作为增量化方案的核心组件?

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

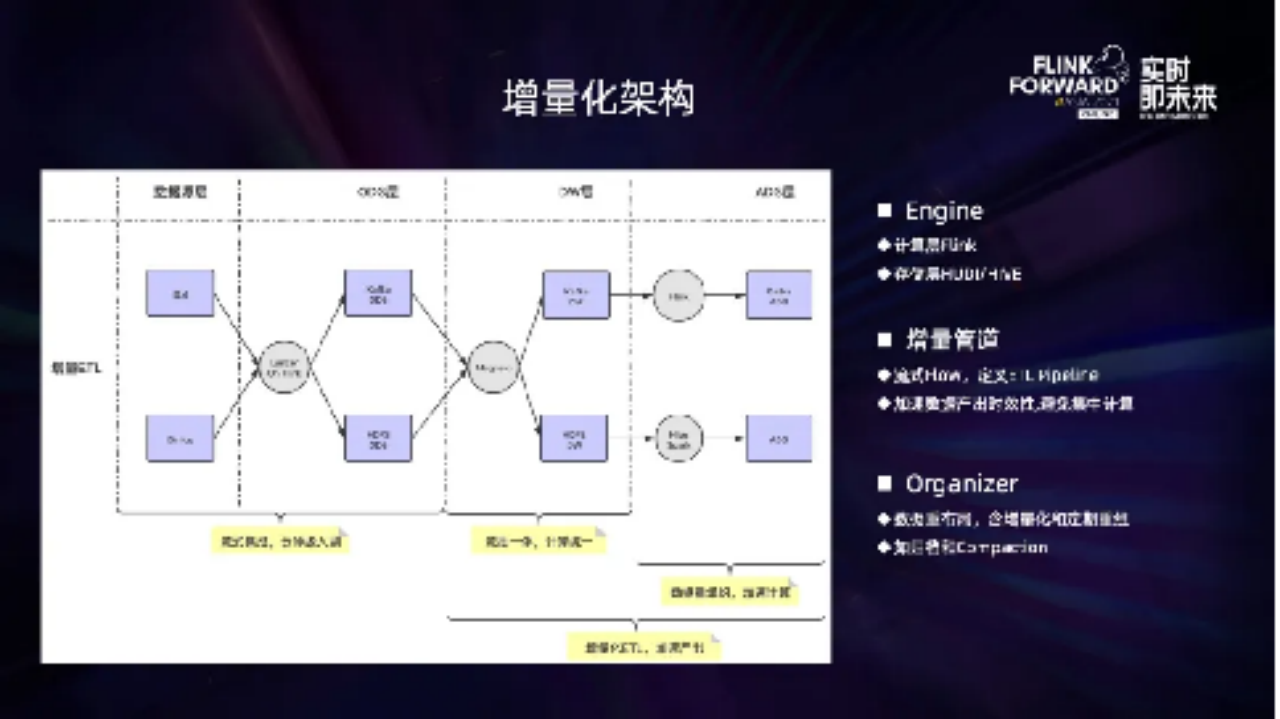

选择Flink作为计算引擎是因为其checkpoint机制是天然的增量化机制,可以高效地处理增量数据。而选择Hudi作为存储引擎,是因为它能支持update操作,具备一定的数据布局能力,且能优化HDFS的小文件问题,适合处理日志和binlog等数据源。