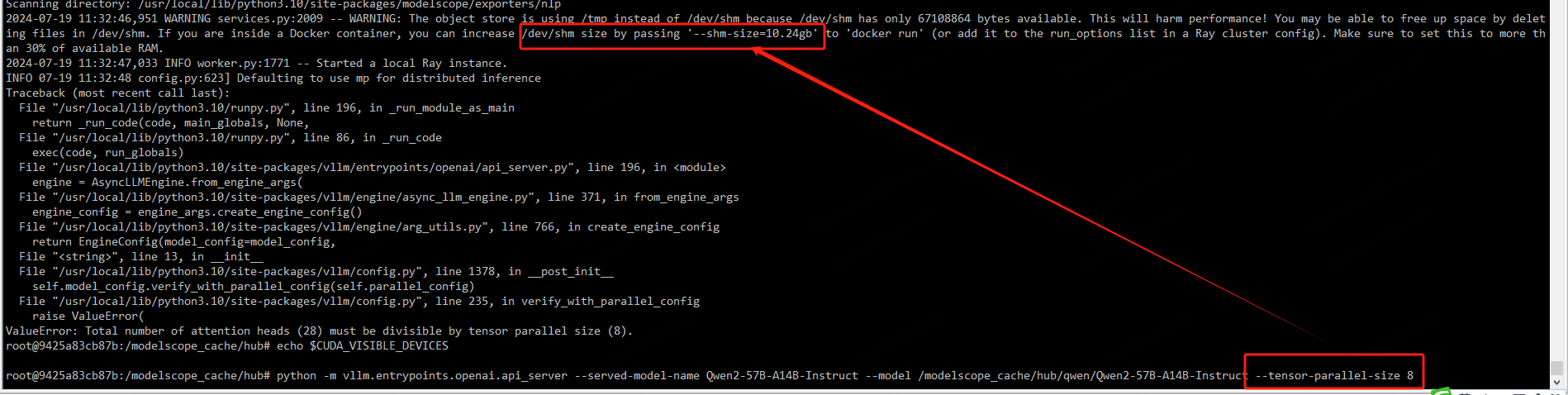

"python -m vllm.entrypoints.openai.api_server --served-model-name Qwen2-57B-A14B-Instruct --model /modelscope_cache/hub/qwen/Qwen2-57B-A14B-Instruct --tensor-parallel-size 8 ModelScope中,执行该命令时又报新错误了,看来是要设置 docker --shm-size=10.24gb 吗?

"

ModelScope旨在打造下一代开源的模型即服务共享平台,为泛AI开发者提供灵活、易用、低成本的一站式模型服务产品,让模型应用更简单!欢迎加入技术交流群:微信公众号:魔搭ModelScope社区,钉钉答疑群:44837352