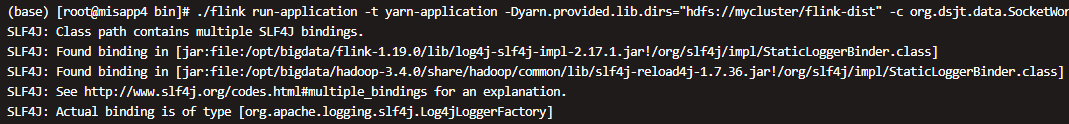

Flink和Hadoop下面的slf4j,冲突了,怎么处理?

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

在Flink和Hadoop项目中,slf4j冲突是一个常见的依赖冲突问题。以下是解决该问题的详细步骤和方法:

当slf4j相关依赖版本不一致时,可能会导致以下错误: - java.lang.NoSuchMethodError - java.lang.ClassNotFoundException - 日志输出异常或日志配置不生效

这些问题通常是由于slf4j的实现(如log4j-over-slf4j、slf4j-log4j12等)与其他日志框架(如log4j)存在冲突。

通过以下命令检查项目的依赖树,定位冲突的slf4j依赖:

mvn dependency:tree

重点关注以下依赖: - org.slf4j:slf4j-api - org.slf4j:log4j-over-slf4j - org.slf4j:slf4j-log4j12 - log4j:log4j

如果发现多个版本的slf4j或log4j依赖,需要进行版本统一或排除冲突的依赖。

slf4j版本在pom.xml中显式声明slf4j的版本,确保所有模块使用相同的版本。例如:

<dependency>

<groupId>org.slf4j</groupId>

<artifactId>slf4j-api</artifactId>

<version>1.7.36</version>

</dependency>

如果某些依赖间接引入了冲突的slf4j实现,可以通过<exclusions>标签排除这些依赖。例如:

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-common</artifactId>

<version>${hadoop.version}</version>

<exclusions>

<exclusion>

<groupId>org.slf4j</groupId>

<artifactId>slf4j-log4j12</artifactId>

</exclusion>

<exclusion>

<groupId>log4j</groupId>

<artifactId>log4j</artifactId>

</exclusion>

</exclusions>

</dependency>

maven-shade-plugin进行类重定位如果必须使用不同版本的slf4j或log4j,可以通过maven-shade-plugin对冲突的类进行重定位(relocation)。例如:

<build>

<plugins>

<plugin>

<groupId>org.apache.maven.plugins</groupId>

<artifactId>maven-shade-plugin</artifactId>

<version>3.2.4</version>

<executions>

<execution>

<phase>package</phase>

<goals>

<goal>shade</goal>

</goals>

<configuration>

<relocations>

<relocation>

<pattern>org.slf4j</pattern>

<shadedPattern>com.shaded.slf4j</shadedPattern>

</relocation>

</relocations>

</configuration>

</execution>

</executions>

</plugin>

</plugins>

</build>

log4j-over-slf4j与log4j不共存log4j-over-slf4j和log4j不能同时存在于同一个项目中,否则会导致冲突。如果项目中使用了log4j-over-slf4j,需要删除log4j依赖。例如:

<dependency>

<groupId>org.slf4j</groupId>

<artifactId>log4j-over-slf4j</artifactId>

<version>1.7.36</version>

</dependency>

同时,确保log4j依赖被排除:

<exclusions>

<exclusion>

<groupId>log4j</groupId>

<artifactId>log4j</artifactId>

</exclusion>

</exclusions>

完成上述修改后,执行以下步骤验证问题是否解决: 1. 再次运行mvn dependency:tree,确认slf4j和log4j依赖已统一。 2. 打包并运行项目,观察日志输出是否正常。 3. 如果仍有问题,开启Debug日志,进一步排查依赖冲突的具体原因。

logback或log4j),避免多实现共存。provided作用域:对于Flink和Hadoop相关的依赖,建议将scope设置为provided,以减少打包时的冲突风险。通过以上步骤,您可以有效解决Flink和Hadoop项目中slf4j冲突的问题。如果问题仍未解决,请提供更多上下文信息以便进一步分析。

实时计算Flink版是阿里云提供的全托管Serverless Flink云服务,基于 Apache Flink 构建的企业级、高性能实时大数据处理系统。提供全托管版 Flink 集群和引擎,提高作业开发运维效率。