Flink CDC里我有张mysql表,配置的是init,试了好几次,每次都是同步一条数据,然后就不继续同步数据了,可能是啥原因?

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

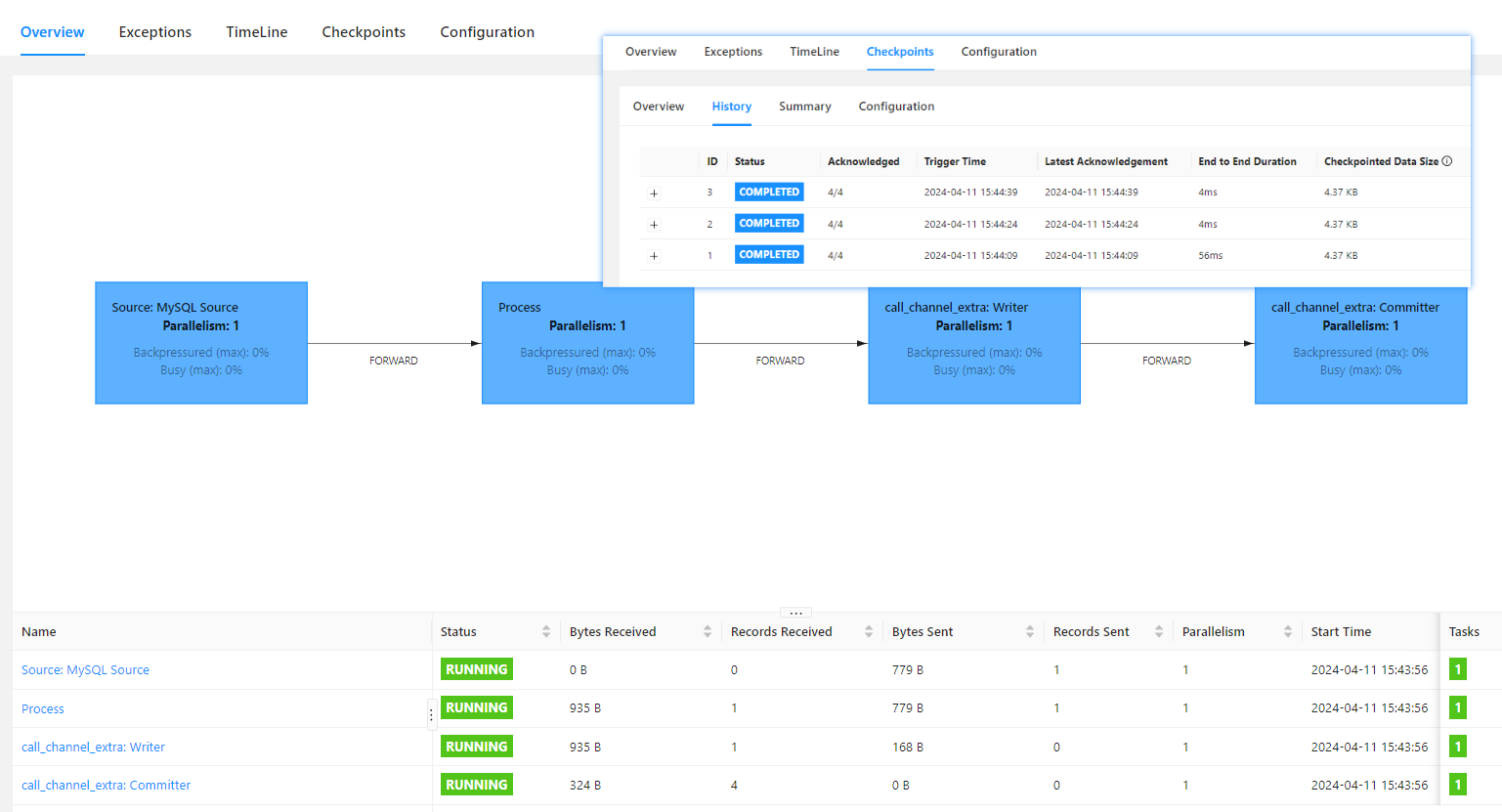

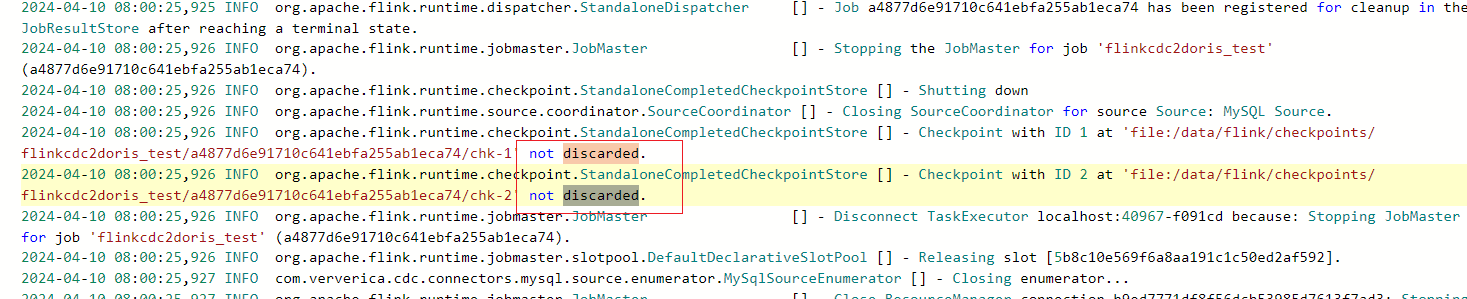

根据您描述的问题,Flink CDC配置为init模式时,仅同步一条数据后停止继续同步,可能的原因和解决方案如下:

检查点:

ROW模式。Binlog_Do_DB或Binlog_Ignore_DB过滤器,导致某些库或表的变更未被记录到Binlog中。可以通过以下命令确认:

SHOW MASTER STATUS;

查看Binlog_Do_DB和Binlog_Ignore_DB字段是否限制了目标表的Binlog记录。

解决方案:

my.cnf),确保以下参数已设置:

log-bin=mysql-bin

binlog-format=ROW

server-id=1

env.enableCheckpointing(30000); // 设置Checkpoint间隔为30秒

WITH参数中的server-id范围是否与MySQL实例匹配。CREATE TABLE IF NOT EXISTS target_table

WITH ('server-id'='6000-6018')

AS TABLE source_table;

database_name、table_name等),需确保下游表能够正确解析这些列。根据上述分析,您可以按照以下步骤逐一排查问题: 1. 检查MySQL Binlog配置,确保增量数据能够被记录。 2. 调整Flink作业的Checkpoint间隔时间,避免全量到增量切换延迟。 3. 确认MySQL实例类型,避免使用只读实例。 4. 验证MySQL表是否有数据变更操作。 5. 检查Flink作业的资源配置,确保Task Manager有足够的CPU资源。 6. 核对CTAS/CDAS语句配置,确保参数正确。

如果以上方法仍无法解决问题,建议提供更详细的日志信息(如Flink作业日志、MySQL Binlog状态)以便进一步分析。

实时计算Flink版是阿里云提供的全托管Serverless Flink云服务,基于 Apache Flink 构建的企业级、高性能实时大数据处理系统。提供全托管版 Flink 集群和引擎,提高作业开发运维效率。