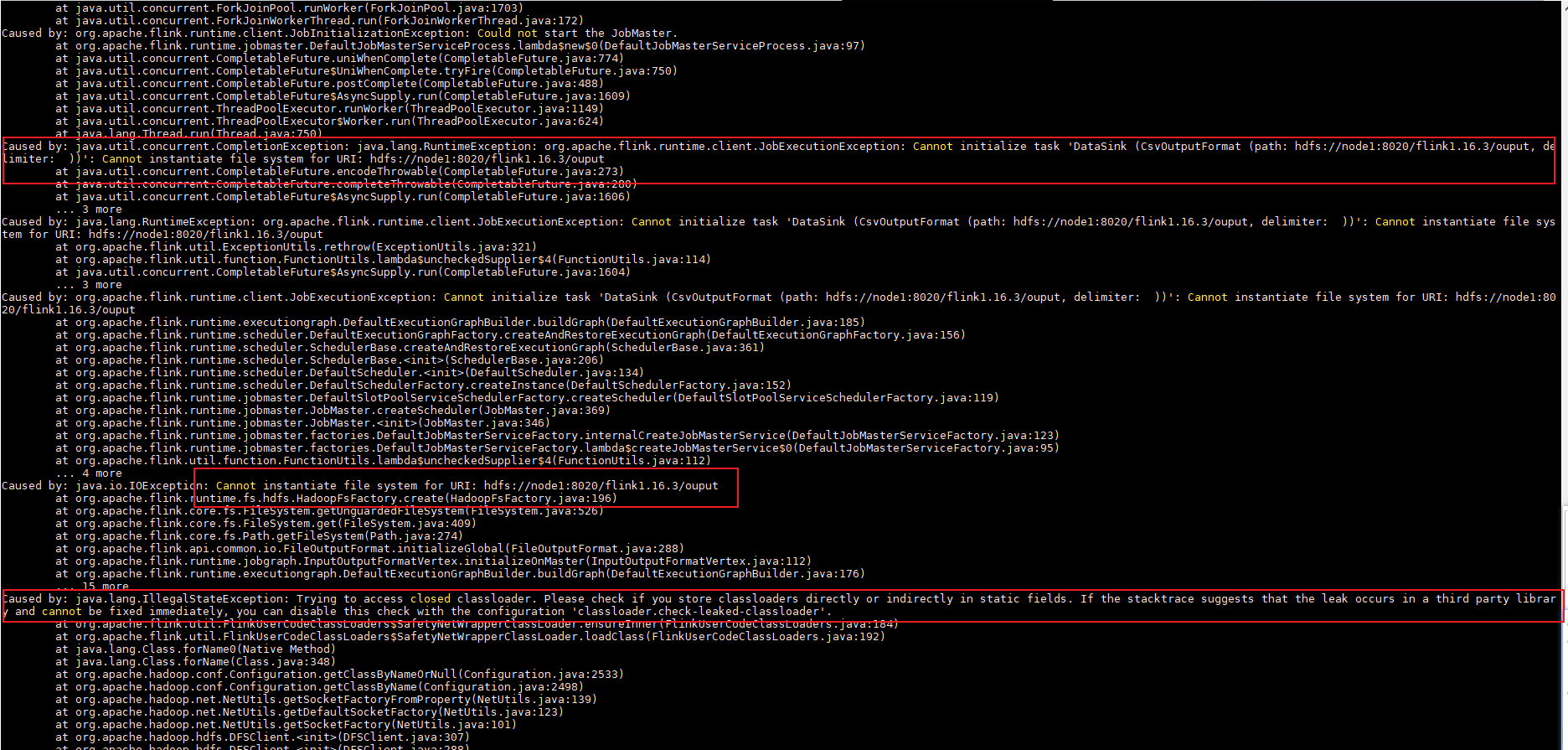

请教下 flink on yarn 模式 跑wordcount run ./examples/batch/WordCount.jar --input hdfs://node1:8020/flink1.16.3/input/wordcount.txt --output hdfs://node1:8020/flink1.16.3/ouput 报错 hdfs dfs -ls 可以正常执行?

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

这个问题可能是由于Flink在Yarn模式下运行时,无法正确访问HDFS导致的。请尝试以下解决方案:

fs.defaultFS指向正确的HDFS地址。hdfs dfs -ls命令,看是否能够正常列出HDFS上的文件。如果可以,那么问题可能出在Flink的配置上;如果不能,那么问题可能出在HDFS本身。根据您提供的信息,报错信息可能是由于Flink在执行WordCount任务时无法访问HDFS。请尝试以下解决方案:

确保HDFS集群正常运行,并且可以从您的机器上访问。您可以使用hdfs dfs -ls /flink1.16.3/input命令检查HDFS上的文件是否存在。

检查Flink的配置文件(flink-conf.yaml)中的HDFS配置是否正确。确保fs.defaultFS和yarn.application-master的值与您的HDFS集群设置相匹配。例如:

fs.defaultFS: hdfs://node1:8020

yarn.application-master: yarn-cluster

检查Flink的日志文件以获取更多关于错误的详细信息。您可以在Flink安装目录下的log文件夹中找到日志文件。

如果问题仍然存在,您可以尝试在Flink的命令行中添加一些调试选项,以便查看更详细的错误信息。例如:

./bin/flink run -d -p 1 ./examples/batch/WordCount.jar --input hdfs://node1:8020/flink1.16.3/input/wordcount.txt --output hdfs://node1:8020/flink1.16.3/ouput -Dlog.level=DEBUG

实时计算Flink版是阿里云提供的全托管Serverless Flink云服务,基于 Apache Flink 构建的企业级、高性能实时大数据处理系统。提供全托管版 Flink 集群和引擎,提高作业开发运维效率。