ModelScope实现长录音文件转文本,需要支持国内大部分方言,同时多人录音区分出来,同一个录音文件中,不同的说话人,不同时间的录音转文本后区分出来,这种需求,我应该使用哪个模型好啊,魔搭里太多了不知道怎么选?

ModelScope确实和hugging face有一些相似之处,但更适合中国的开发者。对于你的需求——长录音文件转文本,支持国内大部分方言,多人录音区分出来,同一个录音文件中,不同的说话人,不同时间的录音转文本后区分出来,你可以考虑使用AISHELL-3这样的语音识别模型。

AISHELL-3包含两百多个发音人录音,每个发音人数据量在20~30分钟不等,因此它能够很好地处理多人录音并区分出不同的说话人。同时,这个模型也支持离线语音识别场景,如录音文件转写,配合GPU推理效果更加。

你的需求比较复杂,需要同时处理长录音文件、方言识别和说话人分离。在ModelScope中,你可以考虑使用以下模型的组合来实现这个需求:

语音识别模型:首先,你需要一个语音识别模型来将录音文件转换为文本。你可以使用ModelScope中的语音识别模型,如DeepSpeech 2,它支持多种方言和口音。

说话人分离模型:然后,你需要一个说话人分离模型来区分不同的说话人。你可以使用ModelScope中的说话人分离模型,如SpeakerDiarization,它可以从多人的录音中分离出每个人的声音。

文本处理模型:最后,你可能还需要一个文本处理模型来处理转换后的文本。你可以使用ModelScope中的文本处理模型,如BERT,它可以帮助你理解文本的含义,从而区分不同的说话人。

需要注意的是,这些模型可能需要大量的计算资源和时间来处理你的需求。因此,你可能需要考虑使用ModelScope的云服务或者自己的高性能计算设备来运行这些模型。

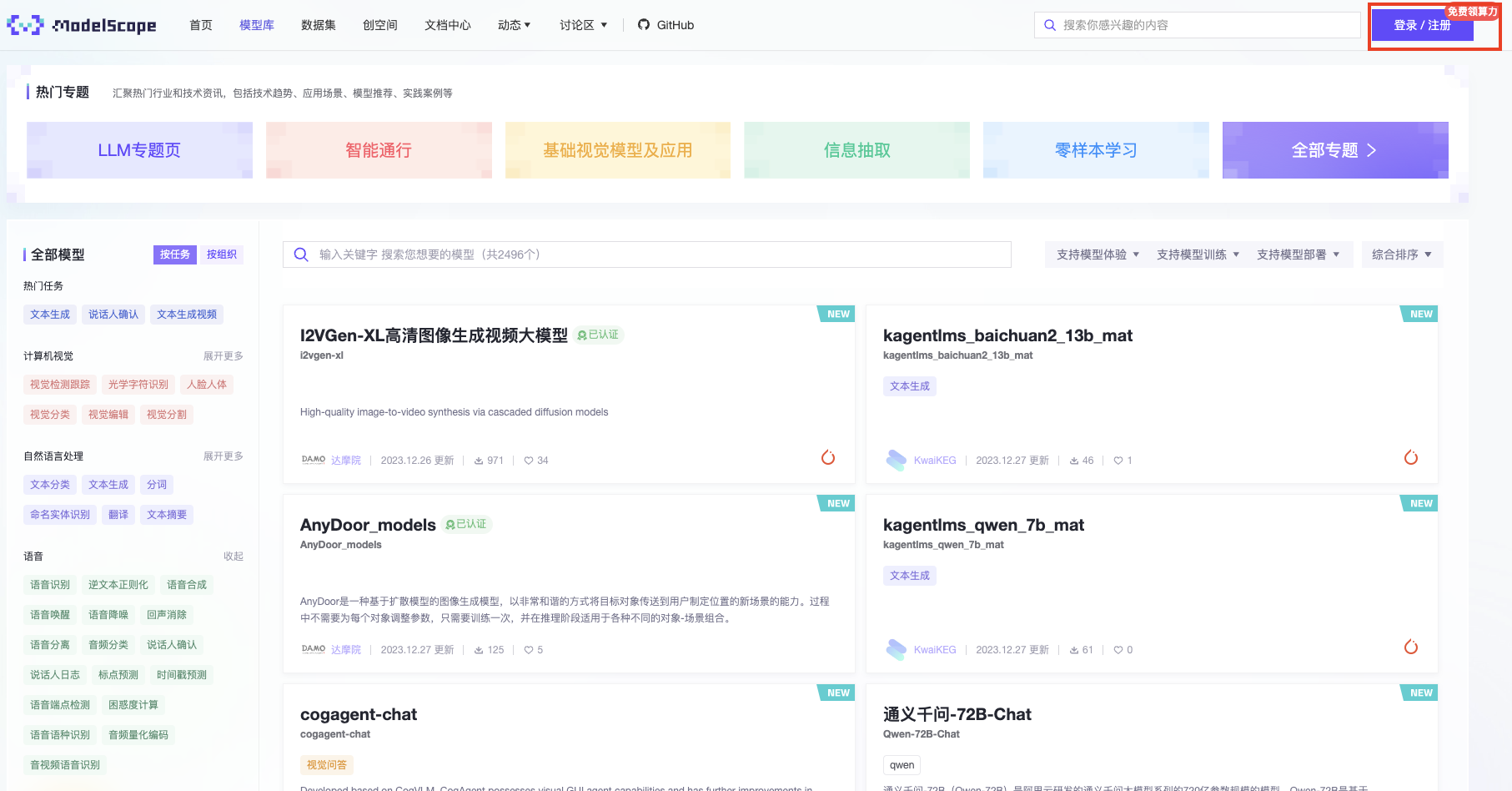

模型库 / 语音 / 说话人日志您看下。https://modelscope.cn/models?page=1&type=audio

https://modelscope.cn/models

,此回答整理自钉群“魔搭ModelScope开发者联盟群 ①”