Flink CDC这些是不是会小一些?

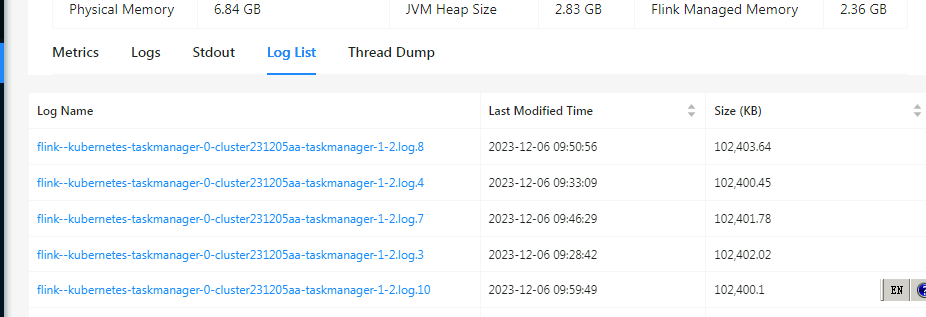

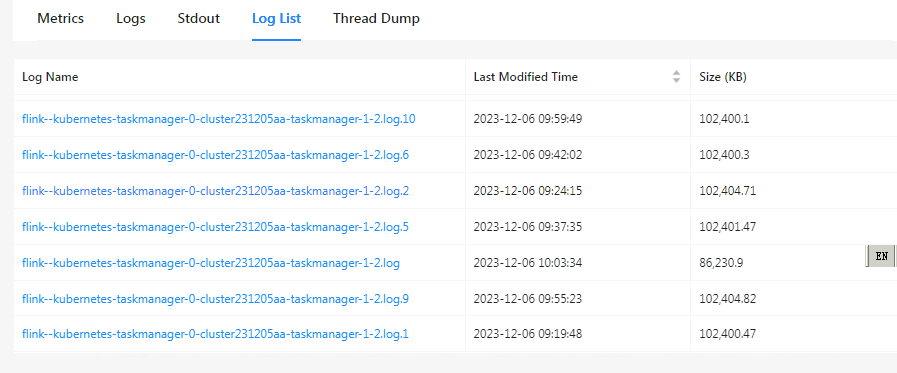

是不是空间不足呀,这些Tm每个都有100M了

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

根据您提供的信息和知识库中的相关资料,以下是对问题的详细解答:

您提到“Flink CDC这些是不是会小一些?是不是空间不足呀,这些TM每个都有100M了”,这可能涉及到Flink作业运行时TaskManager(TM)的磁盘空间使用情况。以下是可能导致磁盘空间不足的原因及解决方案。

TaskManager磁盘空间分配机制

根据知识库中的描述,TaskManager的磁盘空间与其分配的CPU核心数成比例,每个CPU核心配额为20 GiB的磁盘空间。如果您的TaskManager配置了较多的Slot(即并发度较高),可能会导致磁盘空间被快速占用。

小文件过多

在CDC场景下,尤其是全量阶段,可能会生成大量小文件。这些小文件不仅占用磁盘空间,还会影响后续的增量读取性能。如果未对小文件进行有效管理,可能会导致磁盘空间不足。

Checkpoint和状态存储

Flink作业在运行过程中会定期生成Checkpoint,用于容错和恢复。如果状态数据较大,Checkpoint文件也会占用较多磁盘空间。此外,企业级状态后端的优化虽然减少了状态存储空间,但在大状态场景下仍可能占用较多资源。

Binlog数据量过大

在MySQL CDC场景中,Binlog是实例级别的,即使只读取部分表的数据,Flink CDC仍然需要处理整个实例的Binlog数据。这种情况下,可能会导致带宽和磁盘空间的额外消耗。

'num-sorted-run.stop-trigger' = '2147483647',

'sort-spill-threshold' = '10',

'changelog-producer.lookup-wait' = 'false'

这些参数的作用如下: - num-sorted-run.stop-trigger:控制分桶内小文件数量的阈值,设置为较大值后,小文件合并将完全异步进行。 - sort-spill-threshold:当小文件数量超过该阈值时,使用外部排序代替内存归并排序,减少堆内存消耗。 - changelog-producer.lookup-wait:设置为false时,允许已完成小文件合并的并发继续处理后续数据,提高CPU利用率。

Files系统表,监控分桶中小文件的数量,评估是否需要进一步优化。通过以上优化措施,您可以有效缓解Flink CDC作业中TaskManager磁盘空间不足的问题。如果问题仍然存在,建议进一步分析具体的作业日志和监控数据,定位根本原因。

实时计算Flink版是阿里云提供的全托管Serverless Flink云服务,基于 Apache Flink 构建的企业级、高性能实时大数据处理系统。提供全托管版 Flink 集群和引擎,提高作业开发运维效率。