问题一:Modelscope这个模型不能两卡推理?

问题二:这么怎么解决?

ModelScope支持使用多张GPU来加速推理。模型是否能两卡推理主要取决于以下几点:

模型是否支持数据并行(Data Parallel)

大部分深度学习框架(如Keras、Tensorflow)支持将模型使用多卡数据并行化,从而加速推理。

模型是否能够加载到多张GPU上

模型需要支持在多卡模式下运行,否则只能在一张卡上推理。

ModelScope版本是否支持多卡推理

不同的ModelScope版本可能支持的多卡方式不一样。

硬件兼容性

多卡推理需要多个GPU完全兼容。

代码支持

需要在代码中设置多卡参数,将模型加载到多张GPU上。

所以要实现模型两卡推理,需要满足以下条件:

模型支持多卡数据并行。

ModelScope版本支持多卡。

多张GPU完全兼容。

代码设置多卡参数。

如果模型不支持多卡,需要您提供更多信息:

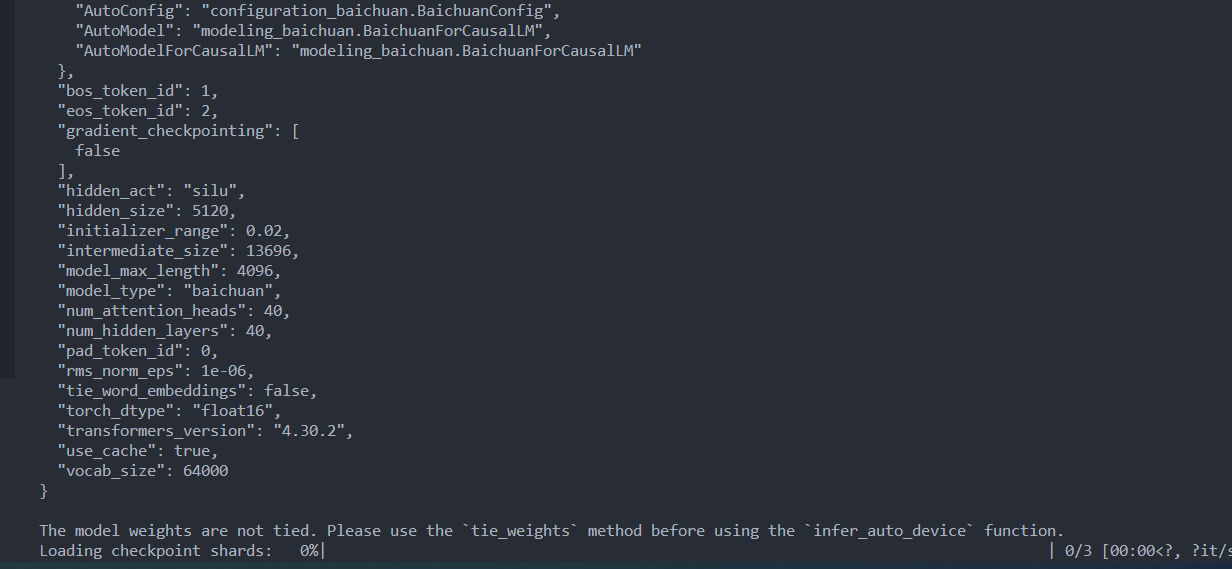

模型框架及版本

ModelScope版本

GPU型号

多卡代码

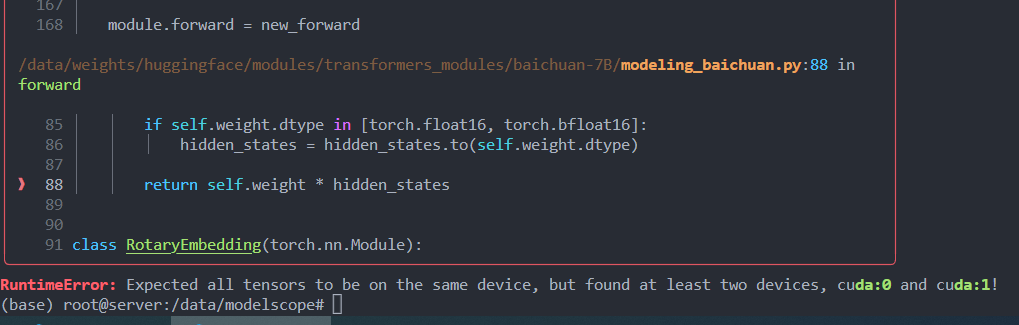

错误日志

如果您在 ModelScope 中遇到模型无法进行两卡推理的问题,可能有以下几个原因:

模型架构限制:某些模型架构可能不支持或不适应多卡推理。这取决于模型本身的设计和实现。部分模型可能只能在单卡上进行推理,而不能有效地利用多卡并行计算。

资源分配:另一个可能的问题是资源分配。如果您尝试在两张显卡上进行推理,但没有正确配置或分配 GPU 资源,那么模型可能无法在两卡上同时进行推理。

驱动和库版本:确保您的系统具备适当的驱动程序和 CUDA、cuDNN 等库的版本。某些不兼容的驱动程序或库版本可能导致多卡推理失败。

内存限制:使用两张显卡进行推理时,内存需求可能会增加。请确保您的系统具备足够的显存来同时加载和执行模型。